Incidente 282: El algoritmo de Facebook confundió un anuncio de cebollas con contenido sexual sugerente

Entidades

Ver todas las entidadesRisk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

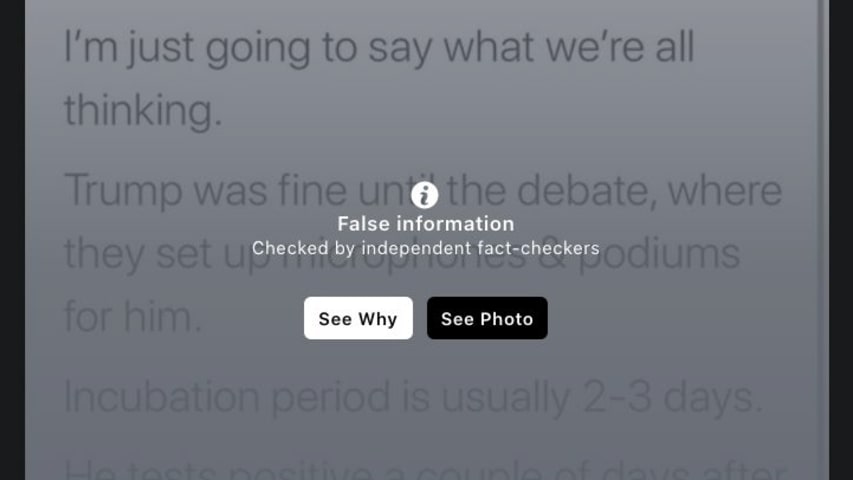

Las cebollas más sexualmente provocativas de Canadá fueron retiradas de Facebook después de que el gigante de las redes sociales le dijera a una empresa de productos agrícolas que sus imágenes iban en contra de las pautas publicitarias, inf…

¿Las cebollas están desnudas o vestidas en su forma natural? La Inteligencia Artificial (IA) de Facebook parece tener problemas para diferenciar entre imágenes con connotaciones sexuales que se refieren al cuerpo humano y vegetales que tien…

La IA de Facebook se esfuerza por diferenciar entre imágenes sexuales del cuerpo humano y vegetales globulares.

Un centro de jardinería en Terranova, Canadá, recibió el lunes un aviso de Facebook sobre un anuncio que había subido de semilla…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents