概要: 新たなディープフェイク動画は、リー・シェンロン首相がリターン保証付きの投資商品を推奨しているという虚偽の映像を流した。詐欺師たちは、首相の2023年建国記念日演説の実際の映像に偽の音声を合成し、あたかも首相が実際に推奨しているかのように見せかけた。リー首相はこれを「極めて憂慮すべき事態」と呼び、ディープフェイク詐欺はますます巧妙化していると警告した。そして、このような詐欺を見つけた場合は、政府のScamShieldボットを通じて通報するよう国民に呼びかけた。

Editor Notes: Two significant AI incidents involving Lee Hsien Loong occurred several months apart from each other. This incident pertains to the June 2024 one. The other one, Incident 985, pertains to a December 2023 incident while he was Prime Minister. See also Incident 988 for information pertaining to disinformation-related deepfakes of Lee that emerged in late June 2024.

Alleged: Unknown deepfake technology developers と Unknown voice cloning technology developers developed an AI system deployed by Scammers impersonating Lee Hsien Loong と Unknown scammers, which harmed Lee Hsien Loong と General public of Singapore.

関与が疑われるAIシステム: Unknown voice cloning technology と Unknown deepfake apps

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

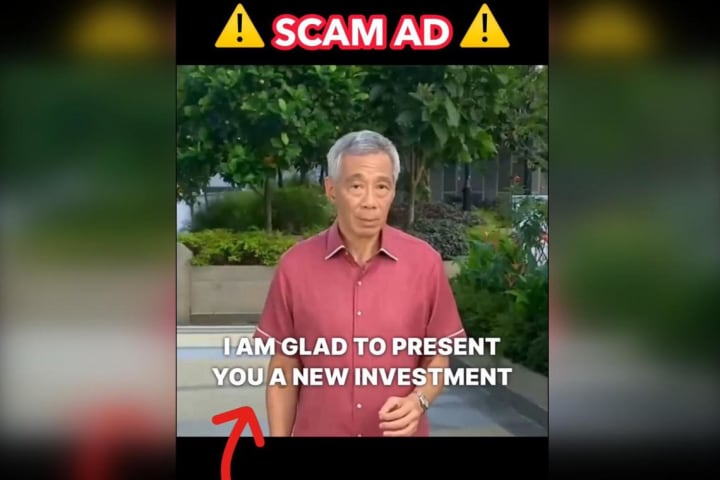

シンガポール - シンガポール国民は、ディープフェイク詐欺から自分と周囲の人々を守るために警戒を怠ってはならない、とリー・シェンロン上級大臣は述べた。同上級大臣は、再びそのような詐欺の1つで投資商品を宣伝している姿が描かれている。

6月2日のフェイスブック投稿で、リー上級大臣は、保証されたリターンを提供すると主張する投資商品にサインアップするよう視聴者に求めるディープフェイク動画があると述べた。

彼は、オンラインで出回っている動画のスクリーンショットを投稿に含め、サブタイトル…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?