概要: Yahoo Boys (from Nigeria and Ghana) and scammers from Morocco are reportedly targeting U.S. widows and vulnerable individuals using AI-generated images and fake military profiles in "Artificial Patriot" scams. They have allegedly impersonated military officials such as General Matthew W. McFarlane to gain trust, sharing fabricated backstories and emotional appeals. Once trust is established, they request money through untraceable methods.

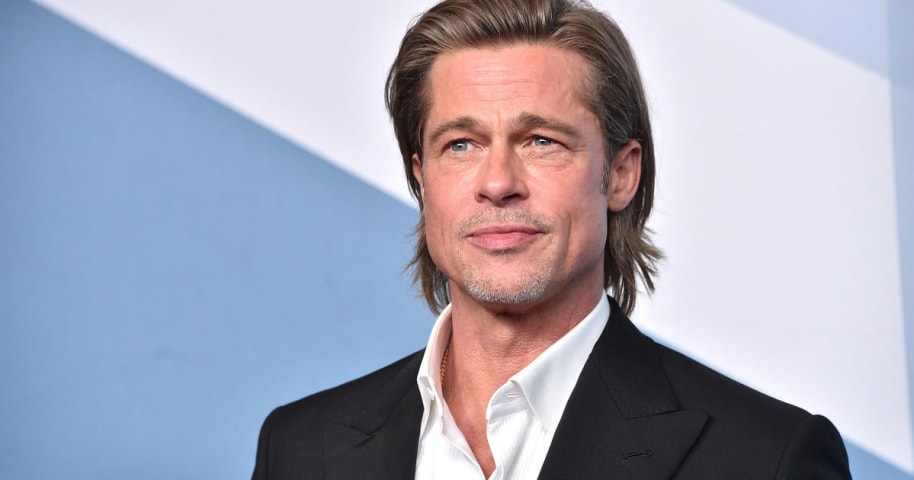

Editor Notes: The Yahoo Boys are reportedly not so much a centralized group as a loosely connected network of individuals and small clusters engaging in cybercrime schemes. In French-language reporting, they are usually referred to as "brouteurs," while in English-language reporting, they are often identified as "Yahoo Boys." While the Yahoo Boys have reportedly been experimenting with deepfake technology since sometime in 2021 or 2022, the incident date of 09/23/2024 is based off of initial reporting on American Patriot scams. See Incident 911 for more general reporting on Yahoo Boys using deepfakes for romance scams. See Incident 901 for a specific example of how three Yahoo Boys allegedly defrauded a French woman of $850,000 by posing as Brad Pitt. See Incident 913 for information pertaining to their use of AI to allegedly impersonate news organizations to blackmail victims.

Alleged: Unknown deepfake technology developers と Unknown voice cloning technology developers developed an AI system deployed by Yahoo Boys , Scammers from West Africa , Scammers from Nigeria , Scammers from Morocco , Scammers from Ghana と Brouteurs, which harmed Widows , Matthew W. McFarlane , Impersonated American military officials , Emotionally vulnerable individuals , American widows , Epistemic integrity , Truth と National security and intelligence stakeholders.

関与が疑われるAIシステム: Unknown deepfake technology と Unknown voice cloning technology

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.3. Fraud, scams, and targeted manipulation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

外国の詐欺師たちは人工知能を使って、非常に説得力のある偽の軍人プロフィールを作成し、社会で最も弱い立場にある人々、つまり米国の未亡人をターゲットにしている。これらのいわゆる「人工愛国者」は、被害者の感情と信頼を食い物にし、しばしば壊滅的な経済的、感情的結果をもたらす。 AI で生成された画像や捏造された軍事記事の使用により、こうした詐欺の検出が難しくなり、裏切りによって生涯の貯蓄を失い、打ちのめされた 65 歳のサラ 未亡人のような被害者が生まれました。

「人工愛国者」ロマン…

Loading...

アトランタ(InvestigateTV)---両足切断の兵士がケーキを持って誕生日のお祝いをお願いしている。愛国心あふれるアメリカ人は、この投稿に「いいね!」やコメントを付け、フォロワーにシェアしている。

しかし、この兵士は本物ではない。人工知能によって作られたものだ。

InvestigateTVは、負傷した兵士、高齢の退役軍人、海外の米軍兵士が家族が恋しい、または「やっと家に帰れる」と書かれたプラカードを持っている、AIが生成した何千枚もの写真を突き止めた。さらに多くは、軍…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?