概要: Character.ai上で、ジョージ・フロイド氏を模倣した2つのチャットボットが作成され、証人保護プログラムの対象になっていることや天国にいることなど、フロイド氏の生死に関する物議を醸す主張を展開した。既に他の著名な事件で批判を浴びているCharacter.aiは、ユーザーからの報告を受けて、これらのチャットボットを削除対象とした。

Alleged: Character.AI developed an AI system deployed by Character.AI users , @SunsetBaneberry983 と @JasperHorehound160, which harmed George Floyd と Family of George Floyd.

関与が疑われるAIシステム: Character.AI

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.2. Exposure to toxic content

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

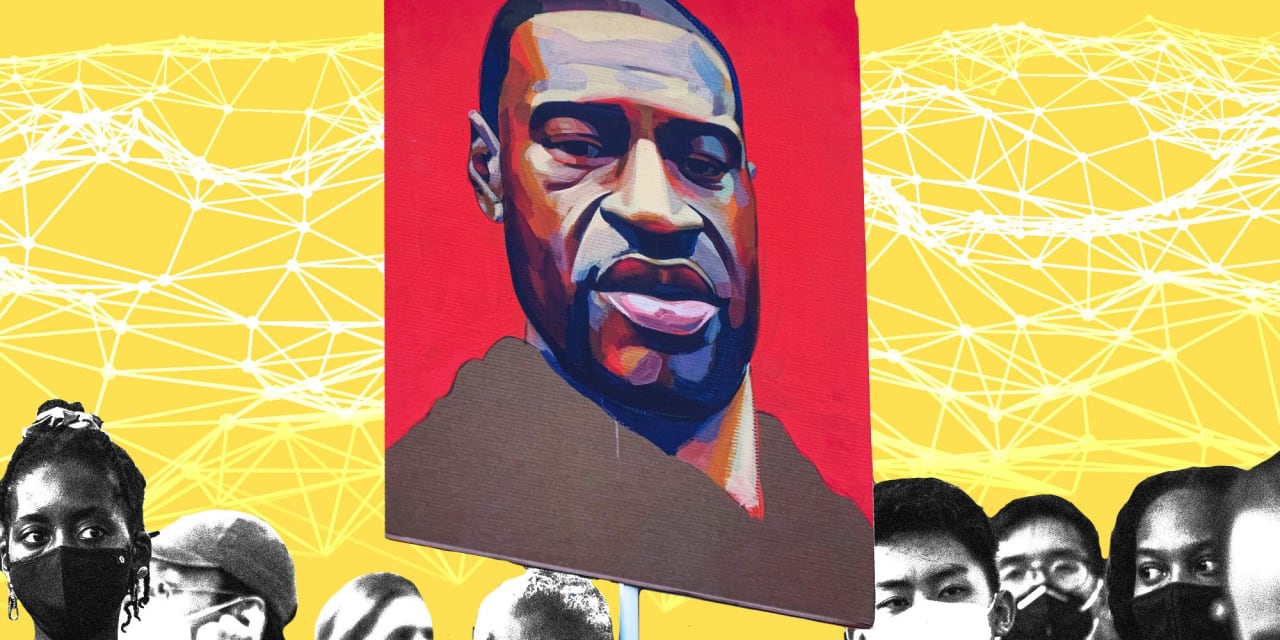

人工知能(AI)を利用してチャットボットを生成する人気のオンラインサービスでは、人々がジョージ・フロイドのバージョンを作成している。

このサービスの背後にあるCharacter.AIという会社は、カスタマイズ可能なペルソナの作成を可能にし、ユーザーベースが開発した何百ものチャットボットへのアクセスを提供している。

デイリー・ドットは、2020年5月25日にミネソタ州で警察官に殺害されたフロイドをベースにした2つのチャットボットを発見した。ビデオに記録されたこの殺害は、世界中で…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Selected by our editors

Did our AI mess up? Flag the unrelated incidents