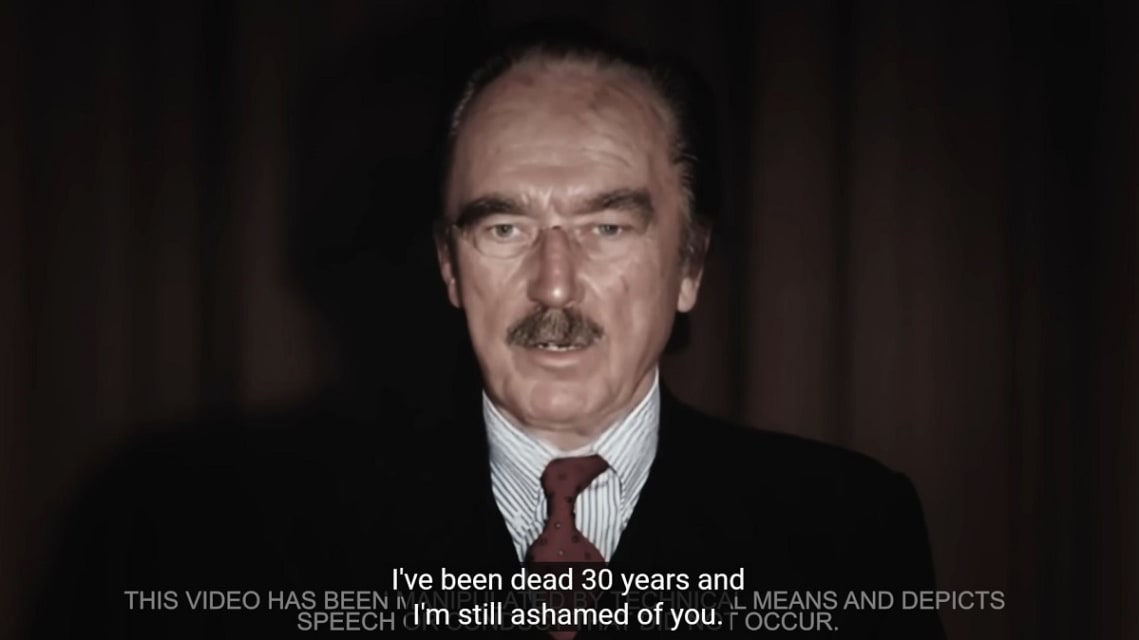

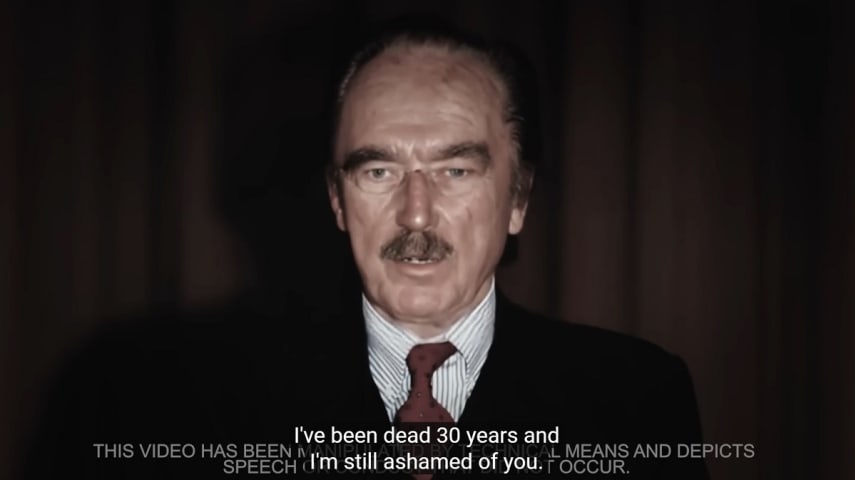

概要: リンカーン・プロジェクトは、AIを用いてドナルド・トランプ氏の亡き父親がトランプ氏を批判するディープフェイク動画を作成した。動画がディープフェイクであることは明言されていたものの、この攻撃の極めて個人的な性質は、選挙期間中に民主主義の規範を揺るがすために人工知能が悪用されたことを示すものだ。

推定: Lincoln Projectが開発し提供したAIシステムで、Public discourse integrity , Political integrity , General public と Donald Trumpに影響を与えた

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

Deepfakes were little more than a looming threat last election cycle, but this time around they seem almost certain to have a corrosive effect on the discourse.

That doesn't always mean that AI-generated fakes are mistaken for the real thin…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?