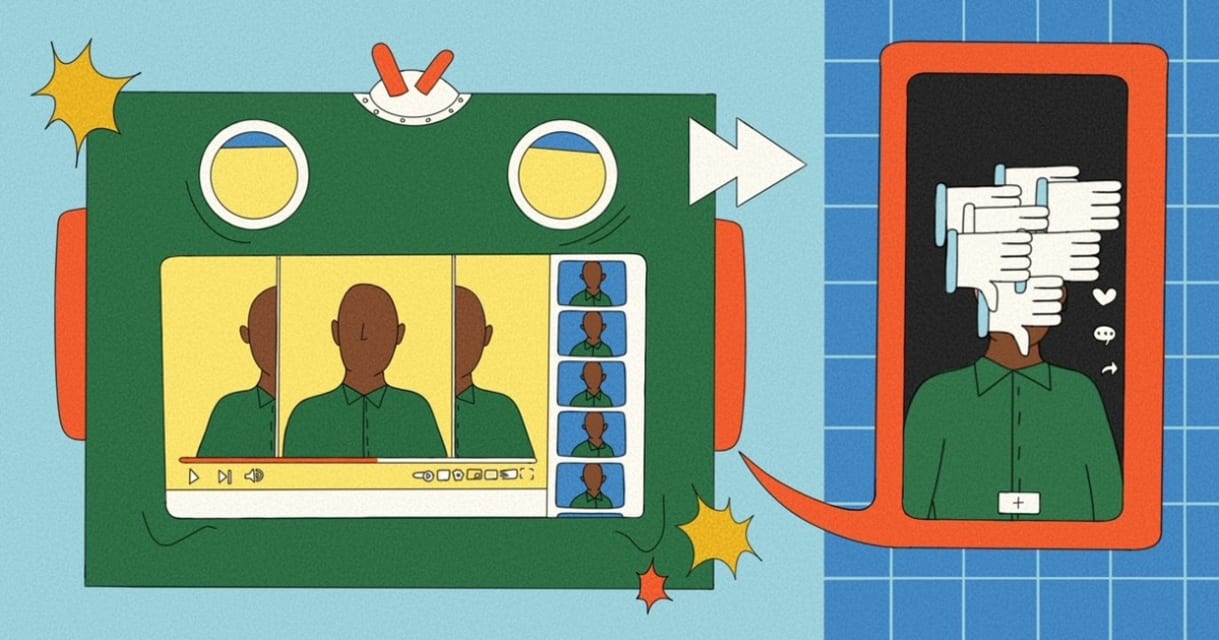

概要: YouTubeは、ショーン・“ディディ”・コムズをはじめとする黒人セレブを標的としたAI生成のフェイクニュースの急増に直面しました。AI生成と操作されたメディアを融合させたこれらの動画は、数百万回もの視聴回数を記録し、コンテンツモデレーションの取り組みに課題を突きつけ、偽情報の拡散を浮き彫りにしました。

Alleged: Unknown generative AI tools creators と Unknown AI text-to-speech technology developers developed an AI system deployed by Variety of YouTube content creators, which harmed Steve Harvey , Sean “Diddy” Combs , General public , Denzel Washington , Black celebrities と Bishop T.D. Jakes.

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

YouTube videos using a mix of artificial intelligence-generated and manipulated media to create fake content have flooded the platform with salacious disinformation about dozens of Black celebrities, including rapper and record executive Se…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?