概要: ChatGPTは、オーストラリア地方市長のブライアン・フッド氏が贈賄罪で服役していたと誤って主張しました。フッド市長は、2000年代初頭にオーストラリア準備銀行の子会社が関与した外国贈賄スキャンダルを主張したとして、ChatGPTの制作者に対し法的措置を検討しています。

Editor Notes: See also Incident 855: Names Linked to Defamation Lawsuits Reportedly Spur Filtering Errors in ChatGPT's Name Recognition.

推定: OpenAIが開発し提供したAIシステムで、Brian Hoodに影響を与えた

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

インシデントレポート

レポートタイムライン

Loading...

/cloudfront-us-east-2.images.arcpublishing.com/reuters/56IRXWYJKRIUXF4PYIBCBMSIUY.jpg)

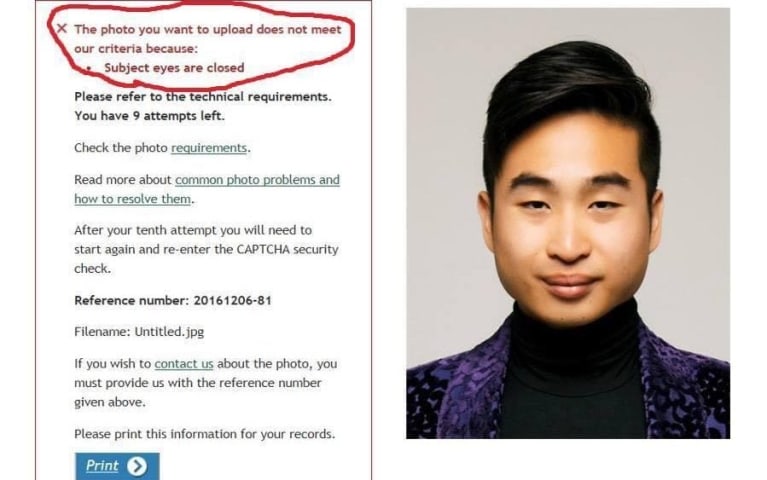

SYDNEY, April 5 (Reuters) - A regional Australian mayor said he may sue OpenAI if it does not correct ChatGPT's false claims that he had served time in prison for bribery, in what would be the first defamation lawsuit against the automated …

Loading...

Brian Hood is a whistleblower who was praised for "showing tremendous courage" when he helped expose a worldwide bribery scandal linked to Australia's National Reserve Bank.

But if you ask ChatGPT about his role in the scandal, you get the …

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧�します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Loading...

Defamation via AutoComplete

· 28 レポート

よく似たインシデント

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Loading...

Defamation via AutoComplete

· 28 レポート

/cloudfront-us-east-2.images.arcpublishing.com/reuters/56IRXWYJKRIUXF4PYIBCBMSIUY.jpg)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/CENID7OUPVLF5MJ6ZETMZG4UFA.jpg)