Incidents associés

Photo : Matt Cardy (Getty Images)

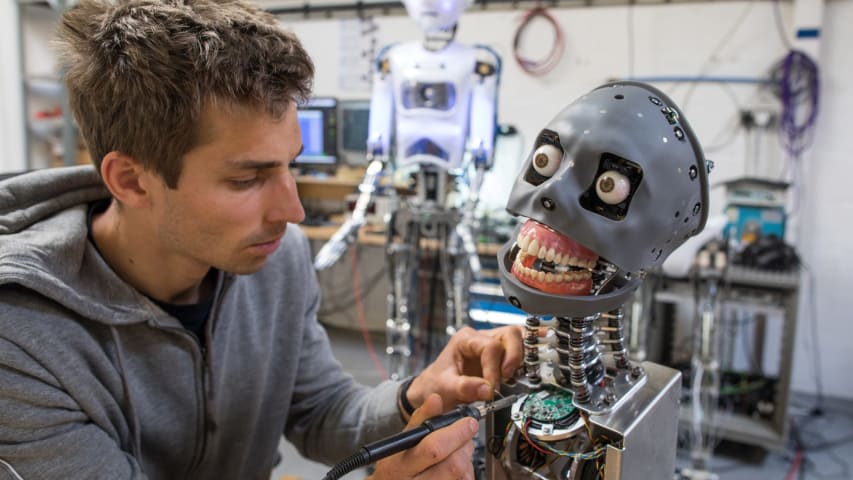

Nous avons tous vu des machines maléfiques dans Terminator ou Matrix, mais comment une machine devient-elle maléfique ? Est-ce comme Project Satan de Futurama, où les scientifiques ont combiné des pièces de diverses voitures maléfiques pour créer la voiture maléfique ultime ? Ou les machines sont-elles simplement destinées à finir par devenir mauvaises lorsque leur puissance de traitement ou quoi que ce soit devient suffisamment avancée ? Il s'avère qu'un moyen garanti de faire mal tourner une machine est de la mettre entre les mains de scientifiques qui tentent activement de créer un "psychopathe" de l'IA, ce qui est exactement ce qu'un groupe du MIT a réalisé avec un algorithme. nommé "Norman" - comme le gars de Psycho.

Cela vient de Newsweek, qui explique que les scientifiques ont exclusivement alimenté le contenu normand violent et horrible d'une page Reddit sans nom avant de lui montrer une série de tests de taches d'encre de Rorschach. Alors qu'une IA "standard" interpréterait les images comme, par exemple, "une photo en noir et blanc d'un gant de baseball", Norman voit "l'homme est assassiné par une mitrailleuse en plein jour". Si cela semble extrême, les réponses de Norman deviennent tellement, tellement, tellement pires. Sérieusement, ce n'est peut-être qu'un algorithme, mais s'ils déversaient cette chose dans l'un de ces horribles corps de chien de Boston Dynamics, nous n'aurions que quelques minutes avant que les Killbots et les Murderoids ne commencent à nous piétiner le crâne. Voici quelques exemples tirés de l'étude :

Capture d'écran : Norman : la première IA psychopathe au monde

Publicité

Capture d'écran : Norman : la première IA psychopathe au monde

Capture d'écran : Norman : la première IA psychopathe au monde

Capture d'écran : Norman : la première IA psychopathe au monde

Publicité

Sérieusement, si "l'homme est entraîné dans une machine à pâte" ne vous donne pas des frissons, alors vous devrez peut-être commencer à vous demander si les machines vous ont déjà assimilé. De plus, pour mémoire, l'étude indique que Norman n'a reçu aucune photo de vraies personnes en train de mourir; il a juste utilisé des légendes d'images graphiques de la page Reddit sans nom (qui est sans nom dans l'étude en raison de son contenu violent).

Heureusement, il y avait un but derrière cette folie au-delà d'essayer d'accélérer la destruction de l'humanité. L'équipe du MIT - Pinar Yanardag, Manuel Cebrian et Iyad Rahwan - essayait en fait de montrer comment certains algorithmes d'IA ne sont pas nécessairement biaisés par nature, mais ils peuvent devenir biaisés en fonction des données qui leur sont fournies. En d'autres termes, ils n'ont pas fait de Norman un psychopathe, mais il est devenu un psychopathe parce que tout ce qu'il savait sur le monde était ce qu'il avait appris d'une page Reddit. (Ce dernier élément semble être particulièrement pertinent pour certaines personnes sur Internet, mais nous allons supposer que ce n'était pas l'intention de l'équipe du MIT.)