Incidents associés

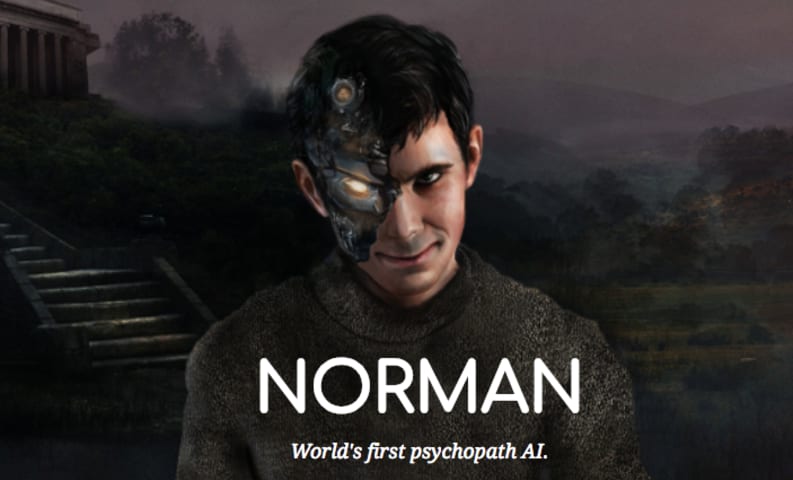

Des scientifiques du Massachusetts Institute of Technology (MIT) ont formé un algorithme d'intelligence artificielle surnommé "Norman" pour devenir un psychopathe en l'exposant uniquement à des images macabres Reddit de morts et de violences horribles, selon une nouvelle étude.

Surnommée Norman d'après le personnage d'Anthony Perkins dans le film Psycho d'Alfred Hitchcock en 1960, l'intelligence artificielle n'a été alimentée qu'avec un flux continu d'images violentes provenant de divers subreddits pernicieux avant d'être testée avec des tests de taches d'encre de Rorschach. Les images détectées par Norman ont produit des interprétations fantasmagoriques d'électrocutions et de décès de voitures à grande vitesse là où une IA standard ne verrait que des parapluies et des gâteaux de mariage.

MIT : projet normand

Les scientifiques du MIT Pinar Yanardag, Manuel Cebrian et Iyad Rahwan ont spécifiquement formé l'IA pour effectuer le sous-titrage d'images, une "méthode d'apprentissage en profondeur" permettant à l'intelligence artificielle d'éliminer les images et de produire les descriptions correspondantes par écrit. Leur recherche visait à prouver que la méthode d'entrée utilisée pour enseigner un algorithme d'apprentissage automatique peut grandement influencer son comportement ultérieur. Les scientifiques ont fait valoir que lorsque les algorithmes sont accusés d'être biaisés ou injustes, comme dans les cas très médiatisés de Facebook News ou de Google Photos, "le coupable n'est souvent pas l'algorithme lui-même mais les données biaisées qui y ont été introduites".

Parmi les taches d'encre de Rorschach utilisées pour tester l'IA désormais contaminée, Norman a déclaré qu'une image montrait un homme "abattu", tandis qu'une IA standard regardait la même image et voyait "un gros plan d'un vase avec des fleurs". Dans un autre, Norman a déclaré avoir vu un homme se faire tirer dessus "devant sa femme hurlante", tandis que l'IA non exposée à des images sordides et dérangeantes a vu "une personne tenant un parapluie en l'air".

Dans l'un des tests de taches d'encre, l'IA standard a vu une scène touchante d'un couple debout ensemble. Norman, cependant, a vu une femme enceinte tomber de la construction. N'ayant été exposée qu'à des images négatives et à des pensées déprimantes, la logique d'empathie de l'IA n'a tout simplement pas réussi à s'activer. Skye McDonald, professeur de neuropsychologie clinique à l'Université de Nouvelle-Galles du Sud, a déclaré que le robot "Pepper" d'Aldebaran Robotics pourrait être l'une des expériences les plus proches dans l'enseignement de l'empathie humaine, a-t-elle déclaré à The Conversation. Les experts en robotique espèrent qu'un jour l'intelligence artificielle sera capable de comprendre les émotions d'un humain simplement en visualisant les expressions faciales d'une personne. Cependant, selon McDonald, la technologie est "encore loin de comprendre pleinement les complexités du fonctionnement de l'empathie humaine".

Lors d'un événement du MIT à New York le mois dernier, Andrew McAfee, codirecteur de l'Initiative du MIT sur l'économie numérique, a été rejoint par plusieurs experts de la Silicon Valley qui ont détaillé des cas passés où le racisme et les préjugés avaient été filtrés dans divers algorithmes. Le panel a averti que si les départements des ressources humaines peuvent être en mesure de prendre des décisions d'embauche intelligentes, les préjugés contre les minorités peuvent s'infiltrer de la part de l'humain qui a programmé l'algorithme. McAfee et les autres experts techniques discutant du biais algorithmique ont déclaré que l'IA peut rester efficace et impartiale "tant que" les données d'entrée sont exactes.

Les chercheurs du MIT dans cette étude ont rédigé le nom des sous-reddits spécifiques utilisés pour former l'IA. Les chercheurs ont déclaré que l'IA "souffrait d'une exposition prolongée aux coins les plus sombres de Reddit" pour illustrer "les dangers de l'intelligence artificielle qui tourne mal lorsque des données biaisées sont utilisées dans des algorithmes d'apprentissage automatique".