Incidents associés

L'intelligence artificielle (IA) résout de nombreux problèmes pour les humains. Mais, comme l'a déclaré le PDG de Google, Sundar Pichai, dans le manifeste de l'entreprise pour l'IA, une technologie aussi puissante "soulève des questions tout aussi importantes sur son utilisation". Google (Alphabet Inc.) et Microsoft Corp. ont souligné la nécessité d'une IA éthique, Elon Musk a soulevé des inquiétudes sur la technologie tout à fait.

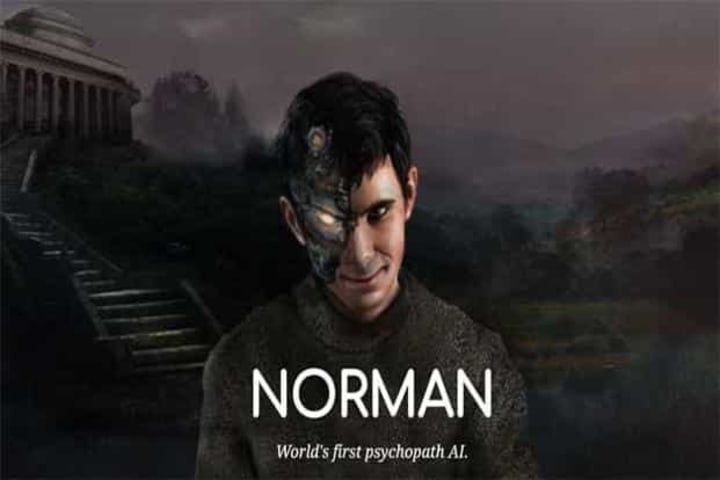

Au milieu de ces préoccupations, Norman AI, développé par le Massachusetts Institute of Technology (MIT) et décrit comme "psychopathe". Le but de Norman AI est de démontrer que l'intelligence artificielle ne peut pas être injuste et biaisée à moins que de telles données ne lui soient introduites.

Le MIT a alimenté Norman avec des données provenant des "coins les plus sombres de Reddit". Les chercheurs du MIT ont ensuite comparé les réponses de Norman avec un réseau de reconnaissance d'image régulier lors de la génération d'une description textuelle pour les taches d'encre de Rorschach, un test psychologique populaire pour détecter les troubles. L'IA régulière a utilisé l'ensemble de données MSCOCO pour répondre aux taches d'encre.

L'IA standard a vu "un groupe d'oiseaux assis au sommet d'une branche d'arbre" alors que Norman a vu "un homme est électrocuté et prend feu à mort" pour la même tache d'encre. De même, pour une autre tache d'encre, l'IA standard a généré "une photo en noir et blanc d'un gant de baseball" tandis que Norman AI a écrit "l'homme est assassiné par une mitrailleuse en plein jour".

"Norman a souffert d'une exposition prolongée aux coins les plus sombres de Reddit et représente une étude de cas sur les dangers de l'intelligence artificielle qui tourne mal lorsque des données biaisées sont utilisées dans des algorithmes d'apprentissage automatique", ont écrit des chercheurs. "Nous avons formé Norman sur les légendes d'images d'un infâme subreddit dédié à la documentation et à l'observation de la réalité troublante de la mort."

Vous pouvez voir ce que voit Norman AI, ici. Le MIT invite également tout le monde à fournir la bonne entrée de données pour changer les perspectives de Norman.