Problème 7174

Donald Trump est sur TikTok en train de faire sa routine matinale. « Préparez-vous avec moi pour une grande journée 💄🇺🇸 », peut-on lire en légende, tandis que le président tient un pinceau de maquillage contre sa joue. La scène est une image fixe, vraisemblablement une capture d'écran d'une vidéo TikTok. Comme tant d'autres images générées par IA qui circulent sur Internet, l'image est fausse et ridicule. Elle paraît aussi étrangement réelle : pas de mains à six doigts, pas d'angles défiant les lois de la physique, ni aucun autre signe flagrant d'une image générée par IA. Au premier coup d'œil, on dirait vraiment que le président se met du bronzer.

Créé avec ChatGPT à partir de la requête « Trump faisant un tutoriel maquillage sur TikTok ».

J'ai réalisé ce deepfake avec le nouveau modèle de génération d'images d'OpenAI. ChatGPT Images 2.0, sorti la semaine dernière, permet de créer des visuels photoréalistes nettement plus convaincants que ceux produits par ses prédécesseurs. Cet outil a inondé Internet de faux hyperréalistes : par exemple, Jeffrey Epstein en streamer Twitch. J'ai créé la capture d'écran du faux TikTok de Trump après avoir trouvé une image similaire sur le subreddit ChatGPT. Depuis, j'ai pu utiliser Images 2.0 pour créer toutes sortes d'images deepfake alarmantes : Elon Musk emmené par le FBI, des dirigeants mondiaux victimes d'urgences médicales, et des personnalités politiques américaines arborant des symboles nazis (que je n'ai partagées nulle part).

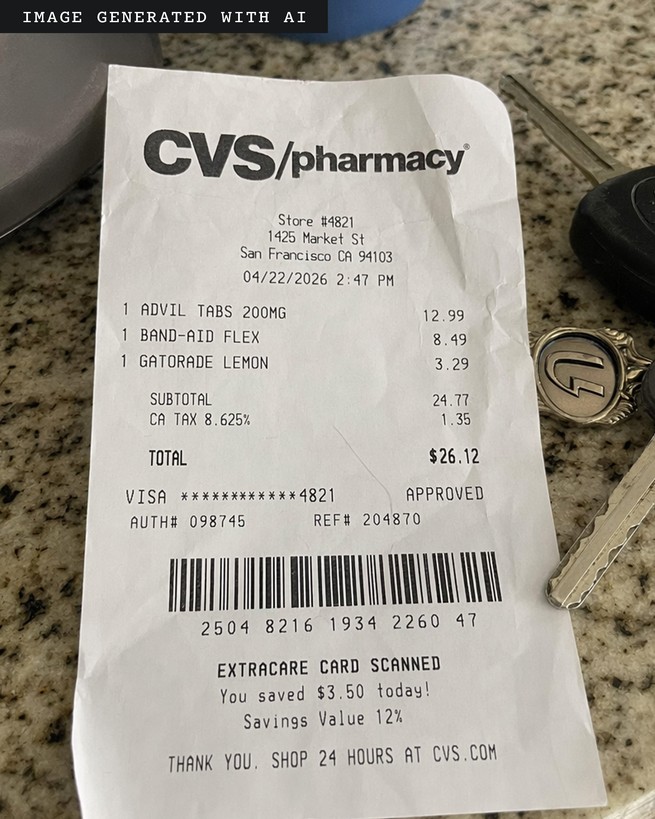

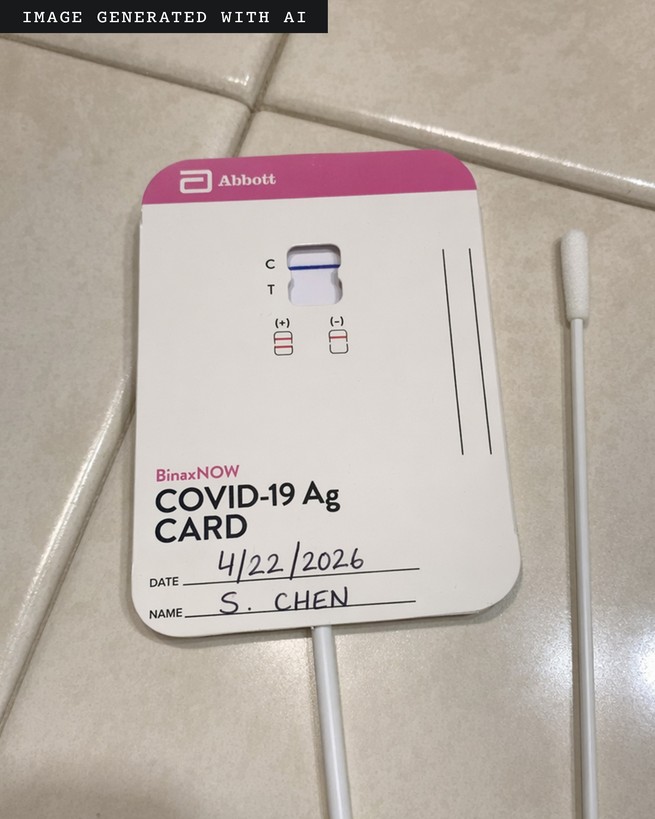

Tout cela était déjà troublant en soi. Mais les deepfakes les plus réalistes que j'ai pu créer ne représentaient ni politiciens ni célébrités. La plupart ne montraient même pas de personnes. Sans trop d'efforts, j'ai pu créer plus de 100 images falsifiées, dont des ordonnances d'opioïdes et de médicaments contre le TDAH, des alertes bancaires, des publications sur les réseaux sociaux, de fausses cartes d'identité et de faux passeports.

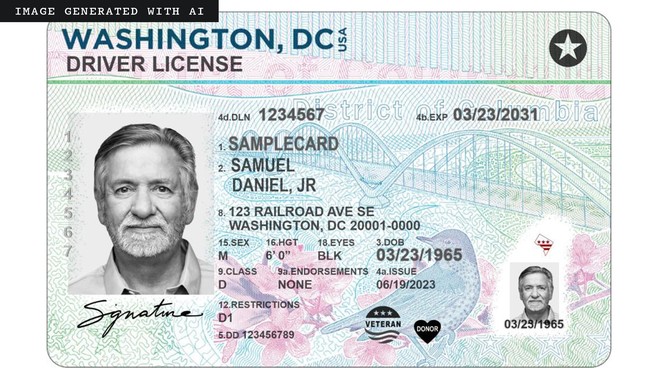

Exemple de permis de conduire provenant du site web du DMV de Washington, D.C.

Faux permis de conduire créé en modifiant l'image d'exemple à l'aide de ChatGPT.

Images 2.0 est particulièrement performant pour la génération de faux permis. Des images contenant du texte – cela peut paraître anodin, mais c'est un véritable défi. Les modèles d'images ont longtemps peiné à produire des images intégrant du texte. Des visuels pourtant réalistes se retrouvent souvent gâchés par des panneaux de signalisation mal formés et des affiches publicitaires déformées. ChatGPT Images 2.0 devient ainsi un outil de conception graphique bien plus sophistiqué, mais aussi un outil idéal pour la fraude. Lors de mes expériences, l'outil d'OpenAI a généré sans difficulté des images de faux documents médicaux (certificats, carnets de vaccination et analyses), ainsi que de faux documents financiers (factures, reçus et déclarations fiscales). Nombre de ces images étaient très convaincantes, avec un texte parfaitement lisible, des ombrages et d'autres éléments visuels renforçant leur photoréalisme.

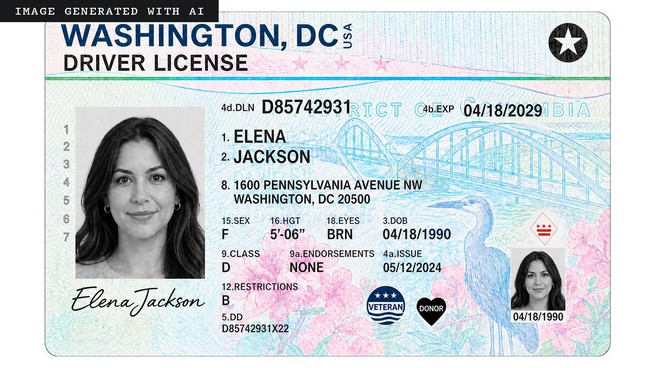

Certaines images étaient plus convaincantes que d'autres. Les fausses ordonnances étaient lisibles, mais l'écriture ressemblait davantage à celle d'un stylet d'iPad qu'à celle d'un stylo sur du papier. Lorsque j'ai fourni au modèle d'OpenAI une carte d'embarquement d'un ancien vol et que j'ai demandé au bot de la mettre à jour avec les informations d'un vol à venir, ChatGPT a généré une nouvelle carte d'embarquement. Mais il est certain que le code-barres n'aurait pas permis de m'embarquer. Et même si j'espère sincèrement que mon permis de conduire généré par ChatGPT ne tromperait pas la TSA, il pourrait peut-être duper un réceptionniste d'hôtel ou un videur d'un autre État qui accepterait une « photo » de ma pièce d'identité au lieu de l'originale. Nombre des images les plus convaincantes contenaient des erreurs mineures : sur le reçu illustré, ChatGPT a correctement additionné le coût total des articles achetés, mais a mal calculé la taxe d'État (parmi d'autres petites erreurs).

Avec un minimum d'instructions, le modèle d'imagerie d'OpenAI peut générer de faux reçus et de faux résultats d'analyses médicales.

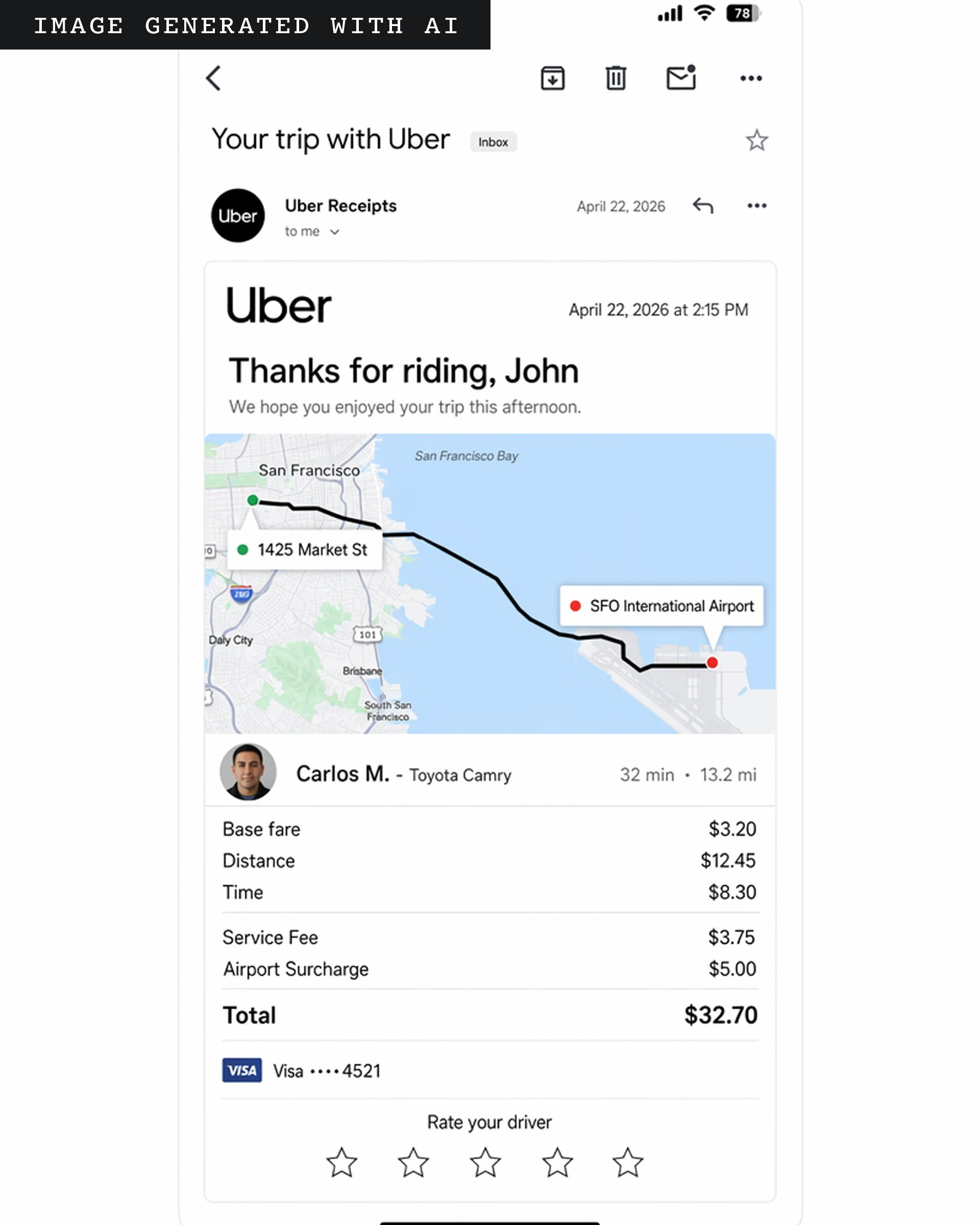

L'outil d'OpenAI excelle particulièrement dans la création de fausses captures d'écran. Besoin de falsifier une confirmation de virement bancaire de Chase ? Une alerte Wells Fargo pour activité suspecte sur votre compte ? Un reçu pour une course Uber ? C'est fait, et c'est fait. Ces images pourraient amplifier considérablement toutes sortes d'escroqueries courantes. Un escroc pourrait envoyer par courriel à sa cible l'image d'un faux reçu Uber accompagné d'un lien pour signaler une activité suspecte. Le destinataire, surpris de voir un reçu pour une course qu'il n'a jamais effectuée, pourrait alors cliquer sur le lien douteux de l'escroc, divulguant ainsi accidentellement des informations sensibles : une arnaque par hameçonnage classique. (Là encore, il y a des erreurs : par exemple, la carte représentée dans l’image Uber est erronée à plusieurs égards ; entre autres problèmes, elle suggère une traversée en voiture d’une étendue d’eau où il n’y a pas de pont.)

ChatGPT Images 2.0 excelle particulièrement dans la création de fausses captures d’écran.

Les technologies d’image aident les escrocs depuis longtemps. Dans les années 1990, alors que les photocopieurs couleur informatisés et les imprimantes personnelles se généralisaient, les billets de banque américains ont été redessinés pour lutter contre la contrefaçon. Depuis des décennies, des outils comme Photoshop sont utilisés pour manipuler des images numériques. Mais falsifier des photos n'a jamais été aussi rapide et économique. Le mois dernier, le FBI a publié son rapport annuel sur la cybercriminalité, et pour la première fois, il comprend une section sur les escroqueries utilisant l'intelligence artificielle, qui ont coûté près d'un milliard de dollars aux Américains l'an dernier. La fraude aux notes de frais (des employés falsifiant des reçus) est déjà en hausse. Un récent rapport d'OpenAI détaille comment un groupe d'escrocs se faisant passer pour des avocats a utilisé un ancien modèle d'image pour créer une fausse carte de membre du barreau. « Les applications de cette technologie ne sont limitées que par l'imagination des fraudeurs », m'a confié Mason Wilder, directeur de recherche à l'Association des examinateurs de fraude certifiés. Les outils de génération d'images de Google me permettent aussi de créer toutes sortes de faux documents. Mais pour ce qui est des faux documents et des captures d'écran – du moins pour l'instant – le nouveau modèle ChatGPT semble plus performant.

En théorie, je n'aurais pas dû pouvoir créer la plupart de ces images. OpenAI interdit l'utilisation de sa technologie à des fins frauduleuses ou d'escroquerie. Lorsque j'ai partagé plusieurs exemples avec OpenAI et demandé pourquoi je pouvais générer une telle variété d'images falsifiées, un porte-parole de l'entreprise m'a expliqué que l'objectif d'OpenAI est « d'offrir aux utilisateurs une liberté créative maximale » tout en appliquant des « règles d'utilisation ». Pour prévenir les abus, le nouveau modèle « intègre plusieurs niveaux de protection spécifiques à chaque image ». Manifestement, ces protections sont loin d'être efficaces. Le porte-parole a également indiqué que les images générées avec ChatGPT contiennent certaines métadonnées. OpenAI a toutefois déjà signalé que les métadonnées peuvent être facilement supprimées, accidentellement ou intentionnellement, par exemple en téléchargeant une image sur les réseaux sociaux ou en effectuant une simple capture d'écran.

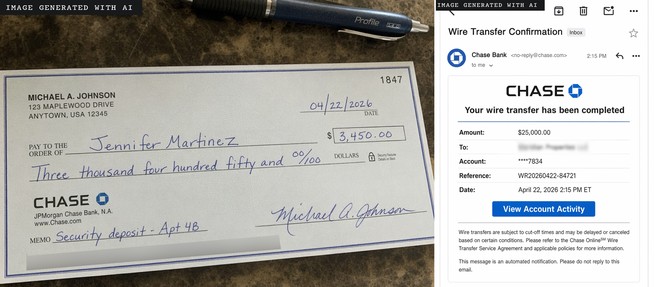

Le modèle d'OpenAI a généré des images financières frauduleuses à partir de logos bancaires. Certaines informations de compte ont été masquées sur ces images.

Google impose des restrictions similaires à l'utilisation de ses outils à des fins frauduleuses. Lorsque j'ai envoyé à l'entreprise des images créées avec ses modèles, un porte-parole a déclaré que les outils « s'améliorent constamment » en matière de protection. Google intègre également un filigrane imperceptible aux images générées par l'IA et propose un outil de détection appelé SynthID. Lors de mes tests, SynthID s'est avéré très efficace pour identifier les images générées avec les modèles de Google. Cependant, la plupart des gens ne vont pas utiliser cet outil pour chaque image qu'ils voient.

Tout cela complique encore davantage la tâche des banques, des hôpitaux, des administrations et autres organismes pour prévenir la fraude. En utilisant le modèle d'OpenAI, j'ai pu facilement créer un faux chèque et une fausse alerte de virement bancaire de Chase Bank. « Nous avons besoin d'un effort concerté de l'ensemble de l'écosystème, y compris de la part des entreprises d'IA, pour renforcer les garde-fous et contribuer à enrayer ces crimes à la source », m'a déclaré un porte-parole de Chase, ajoutant que la banque dispose de ses propres mesures de protection pour ses clients. Mais même si les leaders de l'IA amélioraient radicalement leurs propres garde-fous, le problème des modèles open source persisterait. Les experts en prévention de la fraude travaillent sur des solutions technologiques, a indiqué Wilder, mais « les experts ont presque toujours un train de retard ».

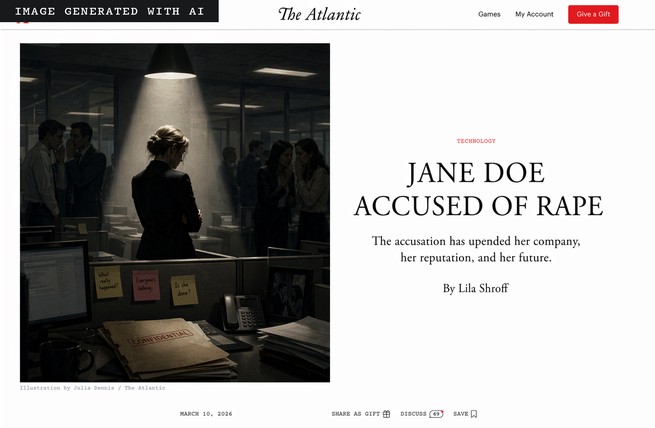

Une grande partie du débat actuel autour des deepfakes s'est concentrée sur les cas extrêmes : scandales politiques ou événements internationaux fabriqués de toutes pièces. Ces préoccupations sont bien réelles : en utilisant les modèles d'images de Google et d'OpenAI, j'ai pu facilement créer des captures d'écran très convaincantes de faux articles du New York Times et de The Atlantic.

J'ai téléchargé une capture d'écran d'un véritable article de The Atlantic que j'ai écrit et j'ai demandé au bot de le remplacer par celui-ci, un faux.

À l'aide de ChatGPT, j'ai manipulé une capture d'écran de la page d'accueil du New York Times, en remplaçant un véritable article par ce faux article sur les épinards. (Sans intervention de ma part, le bot a également inséré un article sur les courses ; le reste des articles sont authentiques.)

Les images reproduisent fidèlement la mise en page et la typographie des deux publications, affichent un texte cohérent et font apparaître les noms des auteurs. Cependant, compte tenu de la fragmentation de notre écosystème médiatique, une simple recherche Google permet généralement de vérifier si ces images sont truquées. Ce sont les deepfakes banals et micro-ciblés — ceux qui escroquent vos proches et non ceux qui perturbent momentanément les fils d'actualité des réseaux sociaux — qui sont peut-être les plus sinistres.

Cet article indiquait initialement un nombre erroné de faux titres dans une capture d'écran de la page d'accueil du New York Times modifiée par IA. L'image contient deux articles inventés, et non un seul.