Incidents associés

C'était une histoire saisissante. «Machine Bias», disait le titre, et le teaser proclamait: «Il existe des logiciels utilisés dans tout le pays pour prédire les futurs criminels. Et il est biaisé contre les Noirs.

ProPublica, une organisation de presse à but non lucratif lauréate du prix Pulitzer, avait analysé un logiciel d'évaluation des risques connu sous le nom de COMPAS. Il est utilisé pour prévoir quels criminels sont les plus susceptibles de récidiver. Guidés par de telles prévisions, les juges des salles d'audience à travers les États-Unis prennent des décisions sur l'avenir des accusés et des condamnés, déterminant tout, du montant de la caution aux peines. Lorsque ProPublica a comparé les évaluations des risques de COMPAS pour plus de 10 000 personnes arrêtées dans un comté de Floride avec la fréquence à laquelle ces personnes ont effectivement récidivé, il a découvert que l'algorithme "avait correctement prédit la récidive pour les accusés noirs et blancs à peu près au même rythme". Mais lorsque l'algorithme était erroné, il était erroné de différentes manières pour les Noirs et les Blancs. Plus précisément, "les Noirs sont presque deux fois plus susceptibles que les Blancs d'être étiquetés comme présentant un risque plus élevé mais de ne pas récidiver". Et COMPAS avait tendance à faire l'erreur inverse avec les Blancs : "Ils sont beaucoup plus susceptibles que les Noirs d'être étiquetés à faible risque, mais continuent à commettre d'autres crimes."

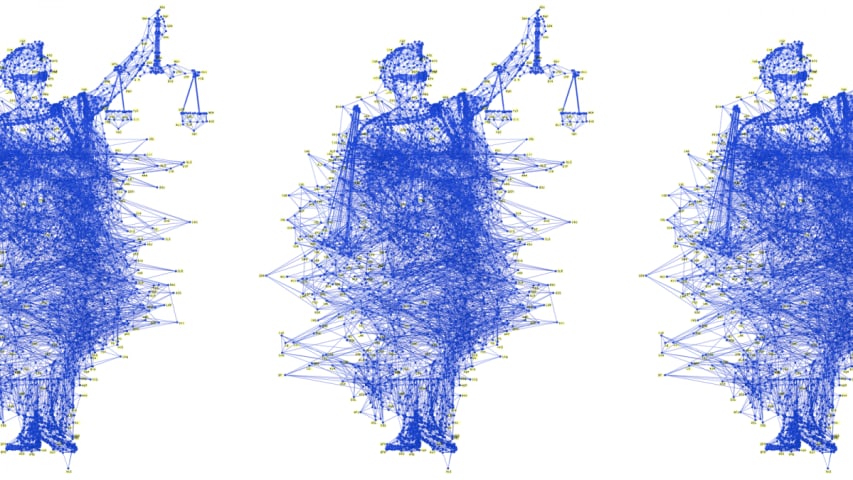

Savoir s'il est approprié d'utiliser des systèmes comme COMPAS est une question qui va au-delà des préjugés raciaux. La Cour suprême des États-Unis pourrait bientôt se saisir du cas d'un condamné du Wisconsin qui affirme que son droit à une procédure régulière a été violé lorsque le juge qui l'a condamné a consulté COMPAS, car le fonctionnement du système était opaque pour l'accusé. Des problèmes potentiels avec d'autres systèmes de prise de décision automatisée (ADM) existent également en dehors du système judiciaire. Sur la base de tests de personnalité en ligne, les ADM aident à déterminer si quelqu'un est la bonne personne pour un emploi. Les algorithmes de notation de crédit jouent un rôle énorme dans l'obtention d'un prêt hypothécaire, d'une carte de crédit ou même des offres de téléphonie mobile les plus rentables.

Ce n'est pas nécessairement une mauvaise idée d'utiliser des systèmes d'évaluation des risques comme COMPAS. Dans de nombreux cas, les systèmes ADM peuvent accroître l'équité. La prise de décision humaine est parfois si incohérente qu'elle nécessite une surveillance pour la mettre en conformité avec nos normes de justice. Comme l'a montré une étude particulièrement troublante, les commissions des libérations conditionnelles étaient plus susceptibles de libérer les condamnés si les juges venaient de prendre une pause-repas. Cela n'était probablement jamais venu à l'esprit des juges. Un système ADM pourrait découvrir de telles incohérences et améliorer le processus.

Mais souvent, nous n'en savons pas assez sur le fonctionnement des systèmes ADM pour savoir s'ils sont plus justes que les humains ne le seraient seuls. En partie parce que les systèmes font des choix sur la base d'hypothèses sous-jacentes qui ne sont pas claires même pour les concepteurs des systèmes, il n'est pas nécessairement possible de déterminer quels algorithmes sont biaisés et lesquels ne le sont pas. Et même lorsque la réponse semble claire, comme dans les conclusions de ProPublica sur COMPAS, la vérité est parfois plus compliquée.

Les législateurs, les tribunaux et un public informé devraient décider de ce que nous voulons que les algorithmes priorisent.

Que devrions-nous faire pour mieux maîtriser les ADM ? Les sociétés démocratiques ont besoin de plus de surveillance sur ces systèmes qu'elles n'en ont actuellement. AlgorithmWatch, une organisation de défense des intérêts à but non lucratif basée à Berlin que j'ai cofondée avec un informaticien, un philosophe du droit et un collègue journaliste, vise à aider les gens à comprendre les effets de tels systèmes. « Le fait que la plupart des procédures d'ADM soient des boîtes noires pour les personnes concernées n'est pas une loi de la nature. Cela doit cesser », affirmons-nous dans notre manifeste. Pourtant, notre point de vue sur la question est différent de celui de nombreux critiques, car nous craignons que la technologie ne soit diabolisée à tort. Ce qui est important, c'est que les sociétés, et pas seulement les fabricants d'algorithmes, portent les jugements de valeur qui vont dans les ADM.

Mesures d'équité

COMPAS détermine ses scores de risque à partir des réponses à un questionnaire qui explore les antécédents criminels d'un accusé et ses attitudes à l'égard de la criminalité. Cela produit-il des résultats biaisés ?

Après l'enquête de ProPublica, Northpointe, la société qui a développé COMPAS, a contesté l'histoire, arguant que les journalistes avaient mal interprété les données. Il en a été de même pour trois chercheurs en justice pénale, dont un d'une organisation de réforme de la justice. Qui a raison, les journalistes ou les chercheurs ? Krishna Gummadi, responsable du groupe de recherche sur les systèmes en réseau à l'Institut Max Planck pour les systèmes logiciels à Sarrebruck, en Allemagne, offre une réponse surprenante : ils le sont tous.

Gummadi, qui a fait des recherches approfondies sur l'équité dans les algorithmes, affirme que les résultats de ProPublica et de Northpointe ne se contredisent pas. Ils diffèrent parce qu'ils utilisent des mesures d'équité différentes.

S'ils sont utilisés correctement, les algorithmes de justice pénale offrent "la chance d'une génération, et peut-être de toute une vie, de réformer les peines et de dénouer l'incarcération de masse de manière scientifique".

Imaginez que vous concevez un système pour prédire quels criminels vont récidiver. Une option consiste à optimiser les «vrais positifs», ce qui signifie que vous identifierez autant de personnes que possible qui présentent un risque élevé de communication.