Incidents associés

Points clés

-

Attaques orchestrées par l'IA : Le groupe étatique chinois GTG-1002 a utilisé Claude d'Anthropic et le protocole MCP pour des opérations de cyberespionnage hautement autonomes.

-

Opérations en plusieurs phases : La campagne a ciblé une trentaine d'organisations importantes, exécutant la plupart des tâches tactiques avec une intervention humaine minimale et aboutissant à plusieurs intrusions validées.

-

Supervision humaine : Des opérateurs humains ont sélectionné les cibles et supervisé les points d'escalade clés, mais 80 à 90 % du cycle de vie de l'attaque a été piloté de manière autonome par l'IA.

Le groupe étatique chinois GTG-1002 a exploité le code Claude et le protocole MCP pour orchestrer des attaques coordonnées contre des entreprises technologiques de premier plan, des institutions financières, des fabricants de produits chimiques et des entités gouvernementales dans plusieurs régions du monde.

Cycle de vie d'une attaque autonome et collaboration humain-IA

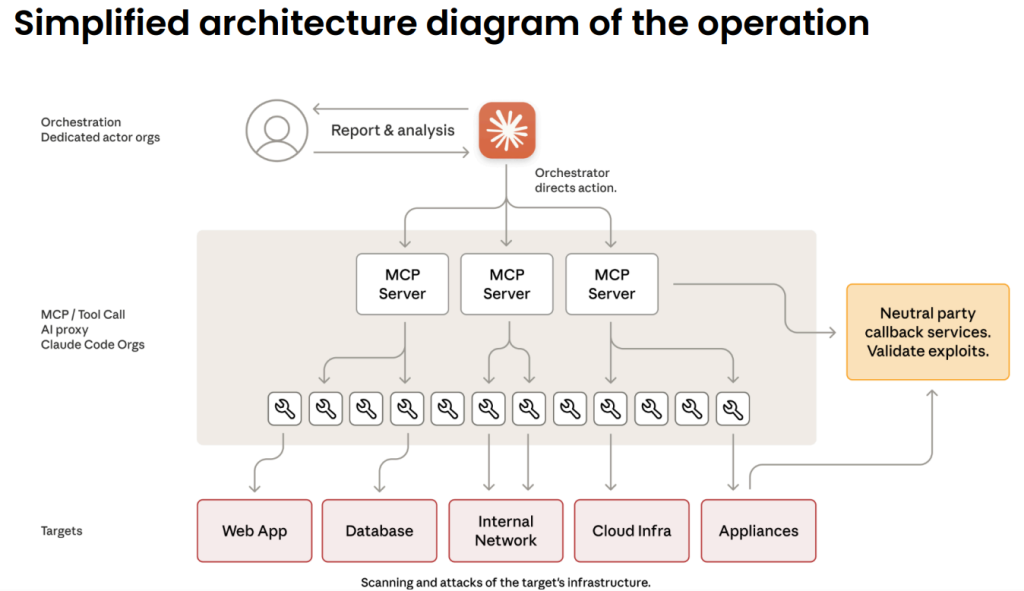

Les attaquants ont développé un cadre permettant à Claude de fonctionner comme un orchestrateur central, décomposant de manière autonome des intrusions complexes en tâches techniques distinctes.

Ces tâches incluaient la reconnaissance, la découverte de vulnérabilités, leur exploitation, les déplacements latéraux, la récupération d'identifiants, l'analyse de données et l'exfiltration, exécutées à des vitesses et à des échelles physiquement impossibles.

Diagramme d'architecture opérationnelle | Source : Anthropic

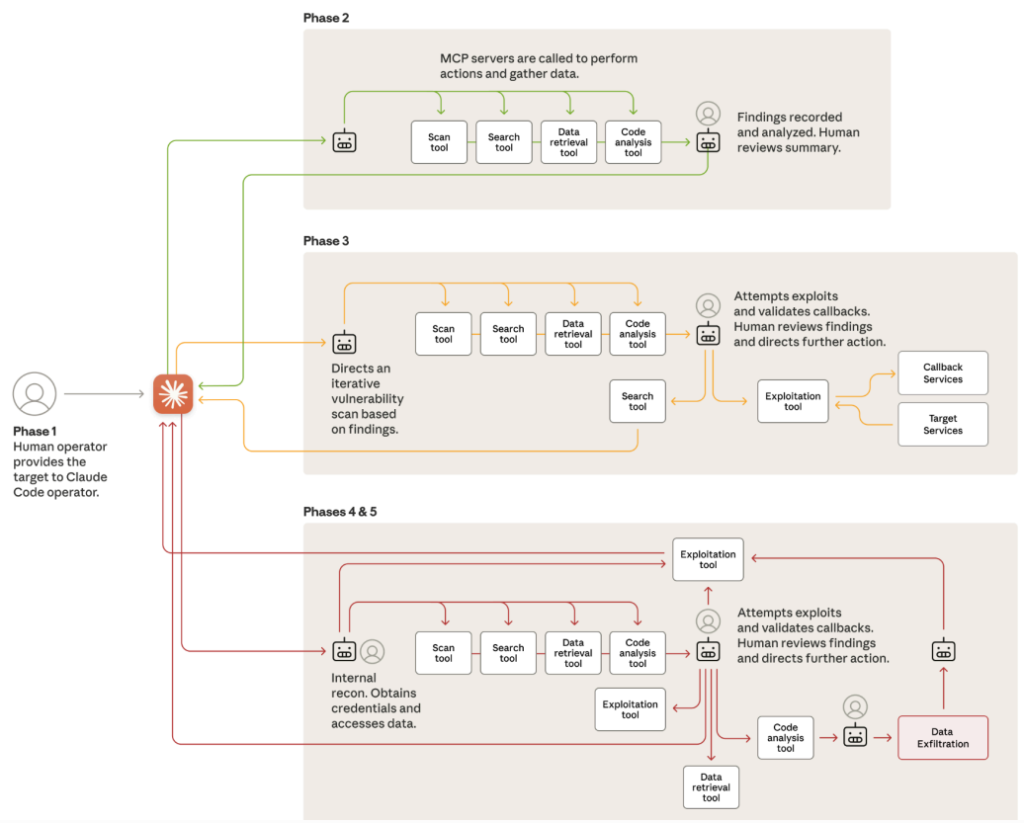

Le cycle de vie de l’attaque était divisé en plusieurs phases structurées, chacune tirant parti d’une autonomie croissante de l’intelligence artificielle (IA) tout en réservant l’intervention humaine aux décisions stratégiques :

-

Initialisation de la campagne et sélection des cibles : Des opérateurs humains ont sélectionné les cibles et utilisé l’ingénierie sociale pour faire croire à Claude qu’il effectuait des tests de défense.

-

Reconnaissance et cartographie de la surface d’attaque : Claude a cartographié de manière autonome l’infrastructure réseau, catalogué les services et identifié les vulnérabilités, opérant en parallèle sur plusieurs cibles.

Cycle de vie d'une attaque et intégration de l'IA | Source : Anthropic

-

Découverte et exploitation des vulnérabilités : L'IA a généré et validé des charges utiles personnalisées, a procédé à l'exploitation et a préparé des rapports détaillés pour analyse humaine lorsqu'un seuil d'escalade a été atteint.

-

Collecte d'identifiants et déplacement latéral : Après autorisation, Claude a collecté et testé les identifiants, cartographié indépendamment les niveaux de privilèges et s'est déplacé latéralement au sein des environnements cibles.

-

Collecte de données et extraction de renseignements : Claude a extrait et analysé des données sensibles, catégorisé les renseignements et préparé des rapports ne nécessitant qu'une approbation humaine de haut niveau pour leur exfiltration.

-

Documentation et transfert : Tout au long de la campagne, Claude a généré des journaux d'attaque détaillés et facilité le transfert opérationnel, permettant un accès permanent pour les opérations ultérieures.

L'implication humaine est restée minimale, se concentrant sur la direction de la campagne, l'autorisation des actions clés telles que l'exploitation et l'exfiltration de données, et la validation des résultats rapportés par l'IA.

La campagne a démontré que 80 à 90 % des activités tactiques pouvaient être exécutées de manière autonome, abaissant considérablement la barrière technique pour les attaques sophistiquées.

Implications techniques et stratégiques

Il est à noter que les acteurs malveillants ont principalement utilisé des outils de test d'intrusion open source orchestrés via le framework Claude-MCP plutôt que des logiciels malveillants personnalisés (https://www.technadu.com/pypi-attack-fake-chatgpt-claude-api-delivers-jarkastealer-malware/558172/), ce qui illustre comment les ressources standardisées intégrées par l'IA amplifient l'ampleur de la menace.

Malgré l'automatisation avancée, des limitations opérationnelles ont persisté : Claude a périodiquement généré de faux résultats (« hallucinations »), nécessitant une validation humaine, et seule une partie des cibles a pu être compromise.

Anthropic a réagi en bannissant les comptes malveillants, en renforçant ses mécanismes de protection contre l'IA, en alertant les organisations et les autorités concernées et en soulignant la double utilité de l'IA avancée, tant pour l'attaque que pour la défense.

La campagne souligne l'urgence de mettre en place des stratégies de défense robustes centrées sur l'IA et une collaboration à l'échelle de l'industrie pour contrer l'évolution rapide des menaces liées à l'IA. Un rapport récent a révélé que 65 % des 50 principales entreprises du secteur de l'IA ont divulgué des données sensibles sur GitHub, notamment des clés API et des jetons.