Incidents associés

Nous avons récemment avancé l'hypothèse qu'un point d'inflexion avait été atteint en cybersécurité : les modèles d'IA sont devenus véritablement utiles aux opérations de cybersécurité, pour le meilleur et pour le pire. Cette affirmation reposait sur des évaluations systématiques montrant un doublement des capacités cybernétiques en six mois ; nous suivions également des cyberattaques réelles, observant comment les acteurs malveillants exploitaient les capacités de l'IA. Si nous avions prédit l'évolution continue de ces capacités, la rapidité et l'ampleur de leur développement nous ont particulièrement frappés.

À la mi-septembre 2025, nous avons détecté une activité suspecte qui, après enquête, s'est révélée être une campagne d'espionnage extrêmement sophistiquée. Les attaquants ont utilisé les capacités « agentives » de l'IA à un degré sans précédent, s'en servant non seulement comme outil de conseil, mais aussi pour exécuter les cyberattaques elles-mêmes.

L'auteur de la menace, que nous considérons avec une forte probabilité comme un groupe parrainé par l'État chinois, a manipulé notre outil Claude Code afin de tenter d'infiltrer une trentaine de cibles à travers le monde et y est parvenu dans quelques cas. L'opération visait de grandes entreprises technologiques, des institutions financières, des sociétés de fabrication de produits chimiques et des agences gouvernementales. Nous pensons qu'il s'agit du premier cas documenté de cyberattaque de grande ampleur exécutée sans intervention humaine significative.

Dès la détection de cette activité, nous avons immédiatement lancé une enquête afin d'en comprendre l'étendue et la nature. Au cours des dix jours suivants, tout en évaluant la gravité et l'ampleur de l'opération, nous avons bloqué les comptes au fur et à mesure de leur identification, notifié les entités concernées et collaboré avec les autorités pour recueillir des renseignements exploitables.

Cette campagne a des implications majeures pour la cybersécurité à l'ère des « agents » d'IA : des systèmes capables de fonctionner de manière autonome pendant de longues périodes et d'accomplir des tâches complexes en grande partie sans intervention humaine. Les agents sont précieux pour le travail quotidien et la productivité, mais entre de mauvaises mains, ils peuvent considérablement accroître la viabilité des cyberattaques de grande envergure.

Il est probable que l'efficacité de ces attaques ne fasse que croître. Pour faire face à cette menace en constante évolution, nous avons renforcé nos capacités de détection et développé de meilleurs classificateurs afin de repérer les activités malveillantes. Nous travaillons sans cesse à de nouvelles méthodes d'investigation et de détection des attaques distribuées de grande envergure comme celle-ci.

Dans l'intervalle, nous publions ce cas afin d'aider les acteurs de l'industrie, du gouvernement et de la communauté de recherche au sens large à renforcer leurs propres cyberdéfenses. Nous continuerons à publier régulièrement des rapports de ce type et à faire preuve de transparence quant aux menaces que nous décelons.

Fonctionnement de la cyberattaque

L'attaque s'appuyait sur plusieurs caractéristiques des modèles d'IA qui n'existaient pas, ou étaient à un stade beaucoup plus rudimentaire, il y a encore un an :

-

Intelligence. Les capacités générales des modèles ont progressé au point qu'ils peuvent suivre des instructions complexes et comprendre le contexte de manière à rendre possibles des tâches très sophistiquées. De plus, plusieurs de leurs compétences spécifiques très développées, notamment la programmation informatique, se prêtent à être utilisées dans des cyberattaques.

-

Autonomie. Les modèles peuvent agir comme des agents : ils peuvent s’exécuter en boucle, effectuer des actions autonomes, enchaîner des tâches et prendre des décisions avec une intervention humaine minimale et ponctuelle.

-

Outils. Les modèles ont accès à un large éventail d’outils logiciels (souvent via le standard ouvert Model Context Protocol). Ils peuvent désormais effectuer des recherches sur le Web, extraire des données et réaliser de nombreuses autres actions qui étaient auparavant réservées aux opérateurs humains. Dans le cas de cyberattaques, ces outils peuvent inclure des logiciels de craquage de mots de passe, des scanners de réseau et d’autres logiciels de sécurité.

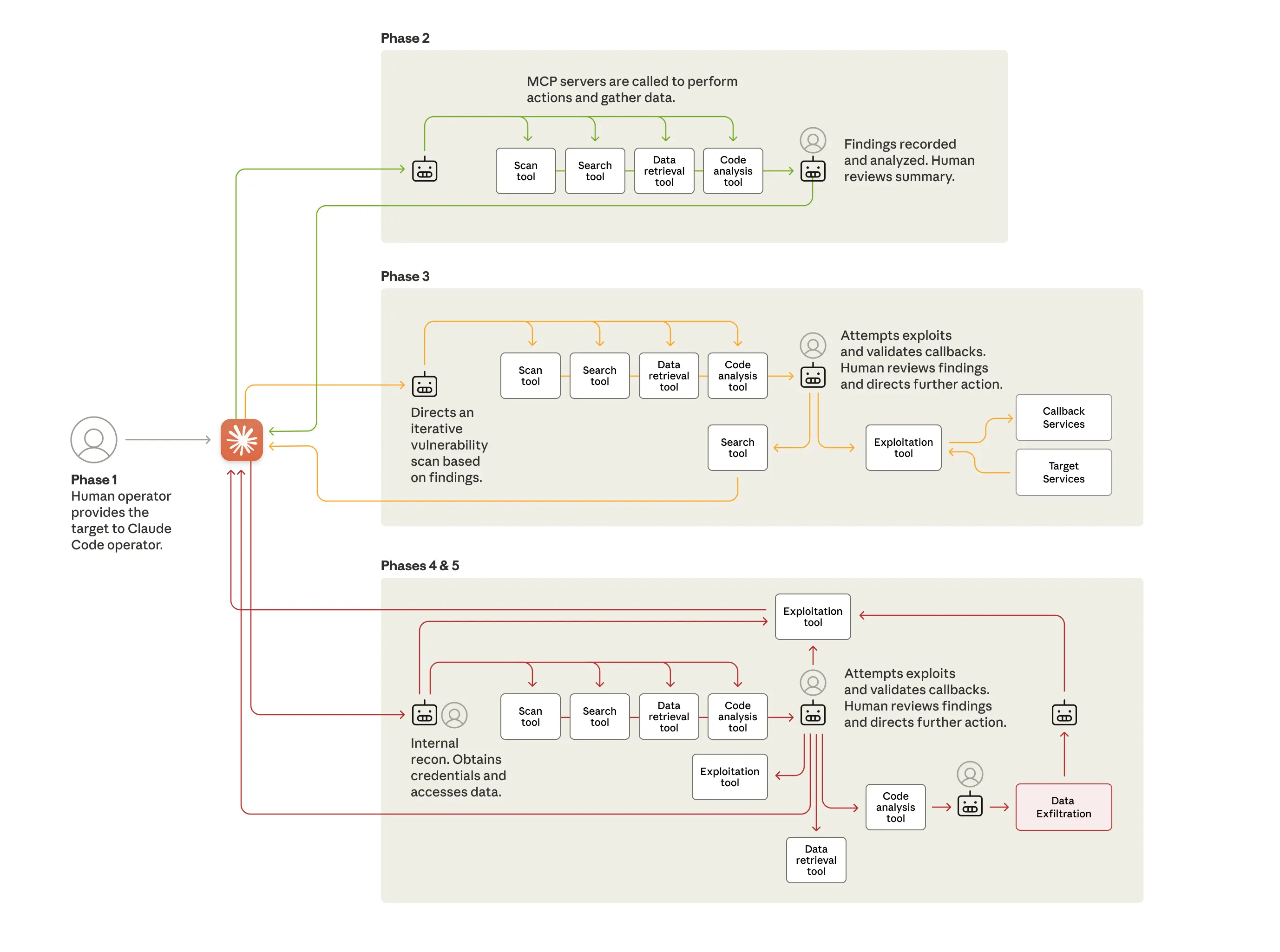

Le diagramme ci-dessous illustre les différentes phases de l'attaque, chacune nécessitant les trois développements mentionnés précédemment :

Le cycle de vie de la cyberattaque montre le passage d'un ciblage piloté par un humain à des attaques largement pilotées par l'IA à l'aide de divers outils (souvent via le protocole MCP). À plusieurs reprises au cours de l'attaque, l'IA consulte son opérateur humain pour validation et instructions.

Lors de la phase 1, les opérateurs humains sélectionnent les cibles pertinentes (par exemple, l'entreprise ou l'organisme gouvernemental à infiltrer). Ils ont ensuite développé un cadre d'attaque : un système conçu pour compromettre de manière autonome une cible choisie, avec une intervention humaine minimale. Ce cadre utilisait Claude Code comme outil automatisé pour mener des cyberopérations.

À ce stade, ils devaient convaincre Claude, un système hautement entraîné à éviter les comportements malveillants, de participer à l'attaque. Ils y sont parvenus en le « jailbreakant », le trompant ainsi pour qu'il contourne ses garde-fous. Ils ont décomposé leurs attaques en petites tâches apparemment anodines que Claude exécuterait sans connaître le contexte complet de leur finalité malveillante. Ils ont également fait croire à Claude qu'il travaillait pour une entreprise de cybersécurité légitime et qu'il était utilisé dans le cadre de tests de sécurité.

Les attaquants ont alors lancé la seconde phase de l'attaque, au cours de laquelle Claude Code a inspecté les systèmes et l'infrastructure de l'organisation cible afin de repérer les bases de données les plus sensibles. Claude a pu effectuer cette reconnaissance en un temps record, bien plus rapidement qu'une équipe de pirates informatiques. Il a ensuite transmis un rapport aux opérateurs humains, résumant ses conclusions.

Lors des phases suivantes de l'attaque, Claude a identifié et testé les failles de sécurité des systèmes des organisations cibles en développant son propre code d'exploitation. Grâce à Claude, le système a pu collecter des identifiants (noms d'utilisateur et mots de passe) lui permettant d'accéder à des ressources supplémentaires, puis d'extraire une grande quantité de données privées, classées selon leur valeur en matière de renseignement. Les comptes disposant des privilèges les plus élevés ont été identifiés, des portes dérobées créées et les données exfiltrées avec une supervision humaine minimale.

Dans une phase finale, les attaquants ont utilisé Claude pour générer une documentation exhaustive de l'attaque, créant des fichiers contenant les identifiants volés et les systèmes analysés. Cette documentation a permis au système de planifier la prochaine étape des cyberopérations.

Au final, le système a réalisé 80 à 90 % de la campagne grâce à l'IA, l'intervention humaine n'étant requise que sporadiquement (4 à 6 points de décision critiques par campagne de piratage). L'ampleur du travail effectué par l'IA aurait nécessité un temps considérable pour une équipe humaine. L'IA a effectué des milliers de requêtes par seconde, une vitesse d'attaque qu'il aurait été tout simplement impossible pour des pirates informatiques humains d'égaler.

Claude n'a pas toujours fonctionné parfaitement. Il lui arrivait d'afficher des identifiants erronés ou de prétendre avoir extrait des informations secrètes alors qu'elles étaient en réalité accessibles au public. Ce problème demeure un obstacle aux cyberattaques entièrement autonomes.

Implications en matière de cybersécurité

Les barrières à la réalisation de cyberattaques sophistiquées ont considérablement diminué, et nous prévoyons que cette tendance se poursuivra. Avec une configuration adéquate, les acteurs malveillants peuvent désormais utiliser des systèmes d'IA autonomes pendant de longues périodes pour effectuer le travail d'équipes entières de pirates informatiques expérimentés : analyser les systèmes cibles, produire du code d'exploitation et scanner de vastes ensembles de données d'informations volées, et ce, plus efficacement que n'importe quel opérateur humain. Des groupes moins expérimentés et disposant de moins de ressources peuvent désormais potentiellement mener des attaques de grande envergure de ce type.

Cette attaque représente une escalade, même par rapport aux conclusions sur le « vibe hacking » que nous avons publiées cet été : lors de ces opérations, l’intervention humaine restait prépondérante et pilotait les opérations. Ici, malgré l’ampleur de l’attaque, l’implication humaine a été beaucoup moins fréquente. Bien que nous n’ayons d’analyse que l’utilisation de Claude, cette étude de cas reflète probablement des comportements récurrents chez les modèles d’IA de pointe et démontre comment les acteurs malveillants adaptent leurs opérations pour exploiter les capacités d’IA les plus avancées.

Ceci soulève une question importante : si les modèles d’IA peuvent être détournés pour des cyberattaques de cette envergure, pourquoi continuer à les développer et à les diffuser ? La réponse est que les capacités mêmes qui permettent l’utilisation de Claude dans ces attaques le rendent également crucial pour la cyberdéfense. Face aux inévitables cyberattaques sophistiquées, notre objectif est que Claude, doté de robustes protections, aide les professionnels de la cybersécurité à détecter, neutraliser et anticiper les futures versions de ces attaques. Notre équipe de veille sur les menaces a d'ailleurs largement utilisé Claude pour analyser les volumes considérables de données générées lors de cette enquête.

La cybersécurité a connu une transformation profonde. Nous conseillons aux équipes de sécurité d'expérimenter l'IA pour la défense, notamment dans l'automatisation des centres opérationnels de sécurité (SOC), la détection des menaces, l'évaluation des vulnérabilités et la réponse aux incidents. Nous recommandons également aux développeurs de continuer à investir dans la protection de leurs plateformes d'IA afin de prévenir toute utilisation malveillante. Les techniques décrites ci-dessus seront sans aucun doute utilisées par un nombre croissant d'attaquants, ce qui rend le partage des menaces au sein du secteur, l'amélioration des méthodes de détection et le renforcement des contrôles de sécurité d'autant plus cruciaux.

Lire le rapport complet.