Incidents associés

Thai PBS Verify a découvert une fausse publicité utilisant frauduleusement le logo de l'émission Thai PBS World Tonight. Elle employait la technologie deepfake de l'intelligence artificielle pour usurper l'identité de présentateurs et de personnalités du monde des affaires, incitant à investir dans un système appelé CRYSTALLUM AI. Or, la vidéo originale était en réalité un reportage sur les inondations de 2013. Des victimes ont mis en garde le public contre cette arnaque, qui peut entraîner des pertes financières et des escroqueries.

Thai PBS Verify a identifié la source de cette fausse information : Facebook.

Capture d'écran d'une publication frauduleuse

Thai PBS Verify a constaté qu'une page Facebook nommée « Muscle Merge » utilise le logo de l'émission Thai PBS World Tonight.

La plateforme a publié un extrait vidéo présentant une interview de M. Toss Chirathivat, président exécutif du groupe Central, et de M. Kalin Sarasin, président honoraire de la Chambre de commerce thaïlandaise et de l'Office national du commerce de Thaïlande. Le contenu de la vidéo encourage les investissements dans un projet intitulé « CRYSTALLUM AI ». Diffusée via des publicités Facebook, la vidéo a reçu plus de 1 200 mentions « J’aime ».

Après vérification, la présentatrice de la vidéo a été identifiée comme étant Mme Patchari Raksawong, une ancienne présentatrice du journal télévisé de NHK World. Interrogée à ce sujet, Mme Patchari a déclaré n’avoir jamais été présentatrice pour la chaîne Thai PBS. Elle a seulement participé à des émissions d’apprentissage de l’anglais, mais n’a jamais occupé le poste de présentatrice pour cette chaîne.

Mme Patchari Raksawong, ancienne présentatrice du journal télévisé NHK World

Pour Mme Raksawong, voir son image utilisée dans un deepfake généré par l'IA était une première.

Bien qu'elle soit familière avec la technologie, elle ne l'avait jamais utilisée dans un contexte aussi négatif. Elle a été choquée que son image soit utilisée pour tromper des personnes et les inciter à investir, car cela pourrait nuire à autrui et discréditer sa réputation. Elle a jugé nécessaire de prendre la parole afin que personne d'autre ne soit induit en erreur de la sorte. Elle souhaite également sensibiliser le public au double tranchant de l'IA. Si elle peut être un excellent outil pour gagner en efficacité, elle peut aussi être utilisée à des fins malveillantes, notamment pour des fraudes préjudiciables à autrui.

Elle pense que l'extrait utilisé provient d'un ancien reportage qu'elle a réalisé pour NHK, une agence de presse japonaise ayant un bureau Asie-Pacifique à Bangkok, où elle a travaillé pendant plusieurs années. Elle soupçonne une personne mal intentionnée d'avoir trouvé cet extrait sur Internet et de l'avoir utilisé pour créer le deepfake. Elle a précisé que son travail pour NHK était toujours en anglais, jamais en thaï.

En conclusion, elle a exhorté les téléspectateurs à faire preuve de discernement et à vérifier soigneusement la source avant de croire ce type d'information. Elle a insisté sur l'importance de revérifier l'information deux ou trois fois pour s'assurer de son authenticité.

L'extrait original était simplement un reportage sur une inondation.

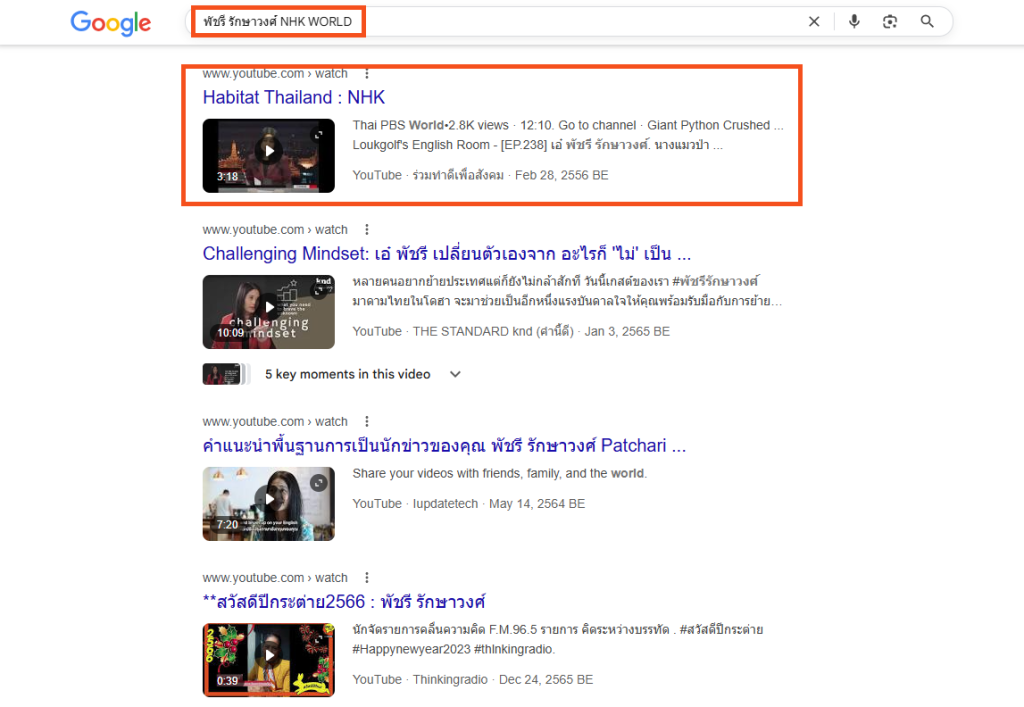

Suite à l'interview de Mme Patchari, où elle a suggéré que l'extrait pourrait provenir de son époque en tant que présentatrice pour NHK WORLD, nous avons utilisé les mots-clés « Patchari Raksawong NHK WORLD » pour rechercher la vidéo originale sur Google. Cette recherche nous a menés à la vidéo originale, un reportage sur les inondations dans la province de Phra Nakhon Si Ayutthaya. Publiée le 28 février 2013 sur la chaîne YouTube « Join Us to Do Good for Society » de la Fondation Habitat pour l'Humanité Thaïlande, elle n'a aucun lien avec une quelconque sollicitation d'investissement promettant des rendements.

Les résultats de la recherche par mots-clés ont permis de trouver la vidéo utilisée pour créer l'image deepfake générée par l'IA.

La comparaison des deux extraits a révélé que le logo de l'extrait utilisé avait été remplacé par celui de la chaîne Thai PBS, et que la langue du reportage, initialement en anglais, avait été changée en voix thaï synthétisée par l'IA.

Capture d'écran montrant le faux extrait vidéo avec le logo de Thai PBS World Tonight superposé (à gauche), comparé au reportage de 2013 sur la construction de logements pour les victimes des inondations (à droite).

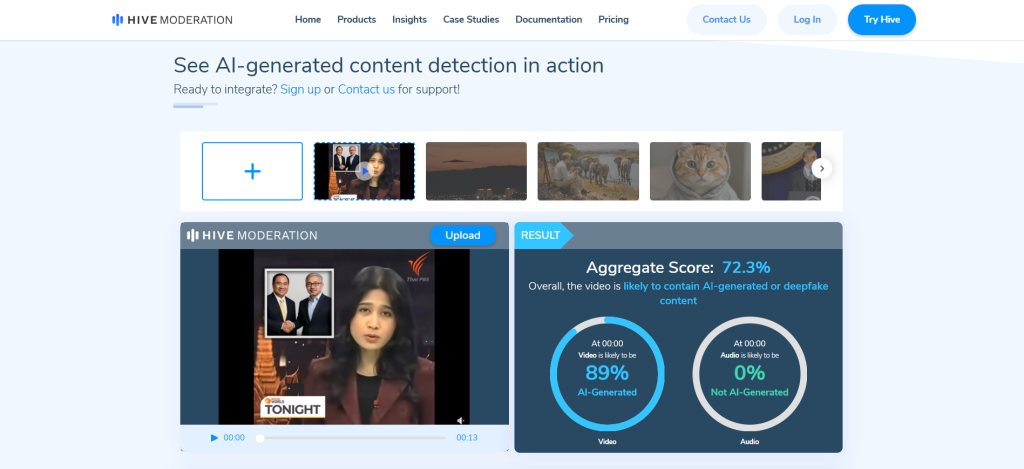

Outil de vérification : l'extrait est-il une création de l'IA ?

L'analyse de l'extrait vidéo à l'aide de l'outil de détection d'IA de HIVEMODERATION a révélé une forte probabilité (72,3 %) qu'il s'agisse d'un deepfake généré par l'IA.

Les résultats de l'outil de détection d'images par IA indiquent une probabilité de 72,3 % que la vidéo ait été créée par une IA.

Thai PBS World Tonight diffuse l'actualité exclusivement en anglais. -----------------------------------------------------------

La directrice de Thai PBS World a exprimé son inquiétude quant au fait que les téléspectateurs ou toute personne visionnant la vidéo puissent la prendre pour authentique. Elle a indiqué que les images des présentateurs de Thai PBS World avaient déjà été utilisées à plusieurs reprises par le passé pour créer des deepfakes à caractère négatif générés par IA. Cependant, Mme Patchari, qui apparaît dans la vidéo, n'est pas présentatrice pour cette chaîne.

Claire Pachimanon, directrice de Thai PBS World

Elle a également déclaré :

Les programmes de Thai PBS World ne sont pas diffusés en thaï. Thai PBS World Tonight est un journal télévisé hebdomadaire exclusivement en anglais. Par conséquent, tout reportage diffusé dans une autre langue doit être considéré comme un faux.

Si vous trouvez ce type de vidéo et avez des doutes, vous pouvez la transmettre à l’équipe de Thai PBS pour vérification. L’équipe souhaite clairement faire savoir que Thai PBS est une organisation à but non lucratif. Nous voulons que chacun comprenne que si vous voyez ce type de vidéo, vous devez immédiatement vous méfier et vous demander si elle est fausse.

Ce n'est pas la première fois que les présentateurs de nouvelles thaïlandais de PBS World sont victimes de deepfakes utilisés.

pour répandre de fausses nouvelles. Par exemple, Vérifié : extrait d'un reportage d'ancre du PBS thaïlandais sur "Anne

Jakrajutatip" Un investissement invitant pour un retour de 500 000 bahts en 1 mois a été en fait créé par Deepfake, ตรวจสอบแล้ว : คลิปผู้ประกาศ Thai PBS "แอน จักรพงษ์" Temps 5 jours 1 mois Par Deepfake

Le Groupe Central met en garde contre un faux clip d’investissement

Pendant ce temps, la page Facebook du Central Group a publié un article sur le problème, déclarant : « [Faux Actualités

Alerte ! Central Group lance un avertissement ! En raison de personnes malveillantes usurpant l'identité de l'entreprise ou de son personnel pour inciter le public à investir en utilisant de fausses informations sur diverses plateformes en ligne, Central Group n'a pas pour politique d'inviter des personnes extérieures à investir de cette manière. Nous demandons au public de ne pas croire, de ne pas partager et de ne pas cliquer sur ces liens.

La page Facebook de Central Group publie un avertissement concernant les fausses informations.

Législation actuelle régissant les deepfakes Thaïlande

Loi sur la cybercriminalité, B.E. 2560 (2017), article 16 : « Quiconque importe dans un système informatique accessible au public des données informatiques se présentant comme l’image d’une autre personne, et que cette image est une création, un ajout ou une modification par voie électronique ou par tout autre moyen, de manière à porter atteinte à la réputation de cette personne, à l’humilier, à la haïr ou à la déshonorer, est puni d’une peine d’emprisonnement de trois ans maximum et d’une amende de deux cent mille bahts maximum. »

Le Code pénal comporte des articles relatifs à la diffamation, à l’outrage et à la diffusion de contenus obscènes.

La loi sur la protection des données personnelles (PDPA) interdit l’utilisation de données personnelles (telles que le visage, le nom et la voix) sans consentement.

Si la victime est mineure, cela peut constituer une infraction en vertu de la loi contre la traite des êtres humains ou des lois sur la protection de l’enfance.

Suite à son enquête, Thai PBS Verify a constaté que l’information était… Faux. L'IA

deepfake a été utilisée pour usurper l'image et la voix d'un présentateur du journal télévisé Thai PBS World et de personnalités du monde des affaires, en les intégrant à un contenu vidéo qui prétendait faussement inciter à investir pour un rendement pouvant atteindre 5 fois le montant initial.

กระบวนการตรวจสอบ

■ Une recherche effectuée à l'aide des mots-clés « Patchari Raksawong NHK WORLD » sur le moteur de recherche Google

a permis de découvrir la vidéo originale, qui n'a aucun lien avec une quelconque

proposition d'investissement promettant des rendements.\

■ Confirmation des personnes impliquées dans la vidéo

Une confirmation a été reçue des victimes dont les données personnelles ont été utilisées via la technologie deepfake de l'IA.

De plus, des demandes de renseignements ont été faites auprès de Thai PBS World et de Central Group pour confirmer que le programme n'est pas diffusé en thaï et que les personnalités du monde des affaires qui y figuraient sont bien des Thaïlandais. Les personnes dont l'identité a été usurpée ne sont pas impliquées dans la vidéo en question.

■ Enquête menée à l'aide d'un outil de détection d'images par IA

Il a été constaté qu'il existe une forte probabilité (jusqu'à 72,3 %) que la vidéo ait été créée par un deepfake généré par IA.

Impact de cette fausse information

■ Atteinte à la crédibilité des médias et des présentateurs.

■ Si le public est induit en erreur ou interprète mal le contenu, cela pourrait entraîner une baisse de la crédibilité générale de la chaîne d'information ou des médias.

■ Violation des droits de la personne. Utiliser le visage ou la voix d'une autre personne sans autorisation constitue une violation de ses droits individuels et est illégal.

■ Ouverture du champ d'action aux escrocs. Les fausses vidéos peuvent être largement utilisées pour créer et diffuser des arnaques, telles que la fraude ou la vente trompeuse de produits. produits.

ข้อแนะนำเมื่อได้ข้อมูลเท็จนี้ ?

Recommandations en cas de fausses informations

- Rassemblez immédiatement des preuves : informez la personne dont les images privées ont été utilisées par des fraudeurs.

Conservez les images, vidéos ou messages modifiés, ainsi que la date et l’heure de leur publication. Si le contenu a été partagé dans un groupe de discussion ou sur les réseaux sociaux, conservez l’historique de la conversation et l’URL de la publication.

-

Signalez le contenu à la plateforme (Facebook, YouTube, TikTok) : signalez le contenu à la plateforme où il a été publié (Facebook, X ou TikTok) afin qu’il soit supprimé.

-

Déposez une plainte ou consultez un professionnel. Organismes compétents

Si vous êtes une victime dont l'image ou la voix a été utilisée, déposez une plainte auprès d'un commissariat de police ou du Bureau d'enquête sur la cybercriminalité (CCIB). Vous pouvez également contacter d'autres organismes compétents, tels que le ministère de l'Économie et de la Société numériques (DE), pour demander de l'aide afin de coordonner la suppression des données ou appeler la ligne d'assistance téléphonique contre la cybercriminalité au 1212.

- Comment repérer une vidéo deepfake générée par IA

■ Recherchez des mouvements anormaux des lèvres.

■ Faites attention à l'accent de la voix dans la vidéo.

■ Observez la vidéo dans son ensemble et recherchez toute anomalie dans les objets ou les personnes présentes sur la photo ou la vidéo.

■ Tenez compte de la vraisemblance de l'événement. Par exemple, dans ce cas, la vidéo montrait un rassemblement avec un arrière-plan ressemblant à un temple ou au Grand Palais, ce qui ne se produirait pas dans la réalité.