Incidents associés

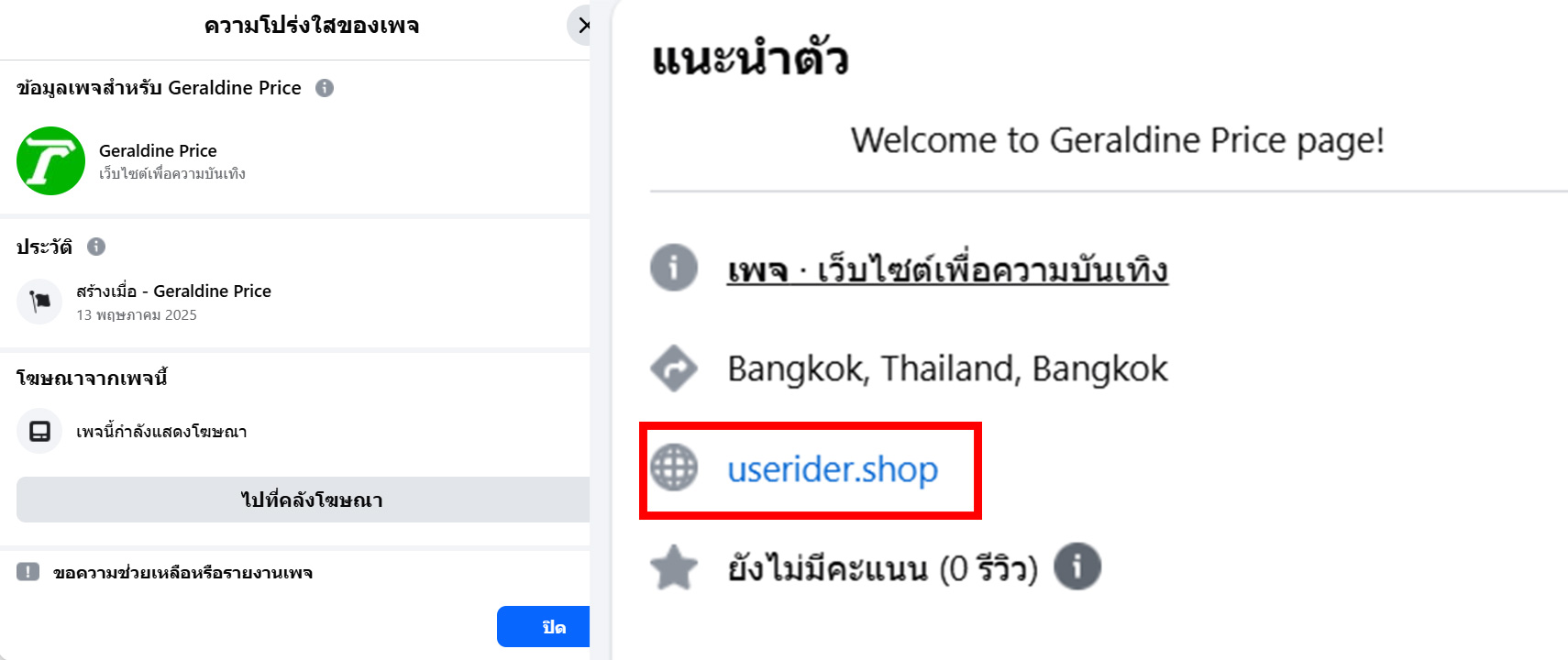

Une vidéo truquée par IA (Deepfake) usurpe l'identité d'une présentatrice du journal télévisé Thai PBS World, prétendant qu'Anne Jakkaphong, la PDG du concours Miss Univers et présentatrice de Thai PBS World, invite à investir en ligne. Après enquête, Thai PBS Verify a confirmé qu'il s'agit d'une fausse information utilisant la technologie Deepfake pour imiter l'image et la voix d'Anne Jakkaphong. La vidéo prétend inciter les jeunes Thaïlandais à investir sur une plateforme certifiée par le gouvernement et à recevoir des gains de plusieurs centaines de milliers de bahts. Thai PBS Verify a identifié la source de cette fausse information sur Facebook : une fausse page (https://perma.cc/ZQ7Y-M7W3) usurpant l'identité d'une agence de presse réputée et utilisant son logo. Une vidéo de deux minutes a été diffusée montrant Mme Dolyana Bunnag, présentatrice du journal télévisé Thai PBS World, interviewant Mme Anne Jakkaphong, PDG de l'organisation Miss Univers. Ce contenu, diffusé en anglais sous forme de publicité sur Facebook, invite à investir en ligne. Il a été visionné 12 000 fois (liens disponibles ici : https://perma.cc/9C3V-CJLT et ici : https://perma.cc/VUQ9-CP7W). La vidéo présente notamment la présentatrice de Thai PBS World relatant l'intervention d'Anne Jakkaphong. Elle invite le public, y compris les jeunes diplômés, à investir dans une plateforme financière automatisée. Cette plateforme prétend être certifiée par le gouvernement thaïlandais ! Capture d'écran d'une vidéo utilisant un deepfake (technologie de manipulation de l'IA) pour modifier la vidéo et l'audio d'Anne Jakapong. La vidéo affirme que les investisseurs peuvent commencer avec seulement 8 000 bahts et espérer des rendements allant jusqu'à 800 000 bahts. Elle prétend également que le système a été testé sur un petit groupe de personnes et que tous les participants ont reçu des rendements d'au moins 500 000 bahts en un mois seulement. Il est confirmé que tous les investisseurs ont réalisé un profit de 100 %. En cas d'absence de profit, le montant total est remboursé. La plateforme prétend également que si elle est ouverte à un public plus large, elle permettra à de nombreux Thaïlandais de devenir millionnaires. C'est pourquoi le nombre de participants est limité. Les premiers à s'inscrire ou à prendre contact avec la plateforme seront prioritaires. Ils auront l'opportunité de s'enrichir en premier. Attention : si vous terminez de regarder la vidéo, le lien pour s'inscrire ou souscrire un investissement disparaîtra immédiatement si le spectateur ne se dépêche pas d'agir. Extrait original : ----------- D'après notre enquête, nous avons trouvé Clip. L'original provient d'un reportage diffusé dans l'émission thaïlandaise World Tonight de la chaîne PBS le 24 juin 2025 (lien archivé).  . À gauche, une image créée par deepfake (intelligence artificielle). À droite, une image extraite de l'extrait original. Alors que l'extrait vidéo original d'Anne Jakrapob s'est avéré provenir d'une interview accordée à un média étranger, publié le 11 février 2023 (lien archivé : https://perma.cc/6BPK-HQ33), l'image de gauche est une création de deepfake par intelligence artificielle, tandis que l'image de droite est extraite de l'extrait original. Nous avons contacté M. Sathapon Phatthanakuha (https://x.com/banksathapon?lang=en), président de Guardian AI Company, qui a confirmé que l'extrait était un deepfake. Il a souligné que les mouvements de la bouche de la personne dans l'extrait ne correspondaient ni au son ni à la qualité de l'image de la vidéo originale. Les muscles du visage et la forme de la bouche sont flous. Il a été confirmé que la vidéo avait été créée par deepfake généré par intelligence artificielle (lien archivé : https://perma.cc/Q63N-578K). La page en question contenait un lien vers un site web et un numéro de téléphone injoignables. et une fausse adresse

. À gauche, une image créée par deepfake (intelligence artificielle). À droite, une image extraite de l'extrait original. Alors que l'extrait vidéo original d'Anne Jakrapob s'est avéré provenir d'une interview accordée à un média étranger, publié le 11 février 2023 (lien archivé : https://perma.cc/6BPK-HQ33), l'image de gauche est une création de deepfake par intelligence artificielle, tandis que l'image de droite est extraite de l'extrait original. Nous avons contacté M. Sathapon Phatthanakuha (https://x.com/banksathapon?lang=en), président de Guardian AI Company, qui a confirmé que l'extrait était un deepfake. Il a souligné que les mouvements de la bouche de la personne dans l'extrait ne correspondaient ni au son ni à la qualité de l'image de la vidéo originale. Les muscles du visage et la forme de la bouche sont flous. Il a été confirmé que la vidéo avait été créée par deepfake généré par intelligence artificielle (lien archivé : https://perma.cc/Q63N-578K). La page en question contenait un lien vers un site web et un numéro de téléphone injoignables. et une fausse adresse  tandis que la photo de profil du compte utilisait également une image de l'agence de presse Thairath TV

tandis que la photo de profil du compte utilisait également une image de l'agence de presse Thairath TV  Capture d'écran d'une fausse page prétendant être le logo de l'agence de presse Thairath TV. (Lien enregistré) Auparavant, Mme Dolyana Bunnag, présentatrice du journal télévisé Thai PBS World, a été victime d'une manipulation de son image par deepfake, utilisé pour diffuser de fausses informations. Dans cette affaire, [Découverte : une vidéo truquée par IA prétendant qu'un médecin célèbre a été arrêté pour avoir révélé la formule d'un médicament contre l'hypertension qui guérissait les gens en 3 jours] (https://www.thaipbs.or.th/verify/content/391), Mme Bunnag a été victime d'usurpation d'identité. Lors d'une interview avec Panya Nirankul pour Thai PBS Verify, Mme Bunnag a déclaré qu'en seulement un an, il y avait eu au moins 3 ou 4 incidents similaires, et que celui-ci était considéré comme le plus crédible. [] (https://files.wp.thaipbs.or.th/verify/2025/07/S__55410694.jpg) Dans le cas le plus récent, Mme Dolyana a révélé que la vidéo truquée par l'IA est cette fois-ci très réaliste : le ton de la voix, le rythme de la parole et le style du reportage sont parfaitement imitables. Bien que l'accent soit encore légèrement différent, les téléspectateurs non avertis pourraient la confondre avec un véritable reportage. En particulier, la dernière version, traduite en anglais, paraît plus aboutie que les précédentes. Par ailleurs, Thai PBS a confirmé qu'elle n'a pas pour politique de diffuser des informations ou des publicités incitant à l'investissement. « Je suis préoccupée par ce problème car n'importe qui peut être victime de deepfakes générés par l'IA, et en tant que femme, je crains que cela ne soit utilisé de manière obscène. » Initialement, après avoir été la première victime, la présentatrice a porté plainte, mais l'affaire est au point mort. Il a déclaré que cette affaire cause non seulement un préjudice personnel au présentateur, mais nuit également à l'image de Thai PBS en tant que représentant officiel de la chaîne. La falsification d'images et de sons visant à présenter un contenu trompeur compromet inévitablement la crédibilité des médias publics. La législation thaïlandaise relative aux deepfakes est la suivante : la loi sur la cybercriminalité de l'an 2560 (B.E. 2560), article 16, stipule que « Quiconque importe des données informatiques dans un système informatique accessible au public, données qui semblent représenter l'image d'une autre personne, et dont l'image est créée, modifiée ou altérée par voie électronique ou autre, de manière à porter atteinte à la réputation de cette personne, à susciter le mépris, la haine ou la honte, est passible d'une peine d'emprisonnement n'excédant pas trois ans. » et une amende n'excédant pas deux cent mille bahts » - Code pénal, articles relatifs à la diffamation, à l'injure et à la diffusion de contenus obscènes - Loi sur la protection des données personnelles (PDPA) si des informations personnelles (visage, nom et voix) sont utilisées sans consentement - Si la victime est mineure, cela peut constituer une infraction en vertu de la loi sur la prévention et la répression de la traite des êtres humains ou de la loi sur la protection de l'enfance. Procédure de vérification ---------------- - Vérifiez la transparence de la page Facebook. La date de création de la page est importante. Les informations de la page jugées irrégulières incluent l'utilisation du logo de l'agence de presse thaïlandaise Rath, l'ajout d'un lien vers un faux site web et des adresses et numéros de téléphone non fiables. - Demandez à un expert en technologie d'imagerie par IA de confirmer que la vidéo a été créée à l'aide de la technologie Deepfake. - Obtenez la confirmation des personnes impliquées dans la vidéo et de la victime dont les informations personnelles ont été usurpées grâce à la technologie Deepfake. Impact de la réception de ce type d'information ------------------------------- 1. Atteinte à la crédibilité des médias et des présentateurs. Si un groupe de personnes y croit ou l'interprète mal, cela peut nuire à la crédibilité de la chaîne d'information ou des médias dans leur ensemble. 2. Violation des droits de la personne. Utiliser le visage ou la voix d'une autre personne sans autorisation constitue une violation des droits de la personne, ce qui est illégal. 3. Ouverture d'un terrain propice à l'exploitation par les criminels. Les fausses vidéos peuvent être créées et largement diffusées, notamment à des fins de fraude ou de vente de produits. Recommandations en cas de réception de cette fausse information ? ------------------------------- 1. Rassemblez immédiatement des preuves. 1. Avertissez la personne dont l'image a été usurpée. - Rassemblez les images, vidéos ou textes modifiés. Si le contenu a été publié dans un groupe de discussion ou sur les réseaux sociaux, conservez l'historique de la conversation et l'URL de la publication. 2. Signalez le contenu sur la plateforme (Facebook, YouTube, TikTok) - Signalez le contenu à la plateforme où il a été publié (Facebook, X ou TikTok) afin qu'il soit supprimé. 3. Si vous êtes une victime dont l'image ou l'enregistrement audio a été utilisé, portez plainte ou contactez les autorités compétentes. - Déposez une plainte au commissariat de police ou auprès de la Division de la répression des crimes technologiques (TCSD), ainsi qu'auprès d'autres organismes compétents, tels que le ministère de l'Économie et de la Société numériques (DE), pour obtenir de l'aide concernant la suppression des données, ou appelez le centre de signalement des cybermenaces au 1212. 4. Analysez la vidéo créée par deepfake : - Remarquez le décalage entre les mouvements des lèvres et la parole. - Notez que les mouvements ne sont pas fluides car la vidéo a été modifiée. — Remarquez que les gestes sont répétitifs, comme en boucle. — Observez l’utilisation des accents par le narrateur dans l’extrait.

Capture d'écran d'une fausse page prétendant être le logo de l'agence de presse Thairath TV. (Lien enregistré) Auparavant, Mme Dolyana Bunnag, présentatrice du journal télévisé Thai PBS World, a été victime d'une manipulation de son image par deepfake, utilisé pour diffuser de fausses informations. Dans cette affaire, [Découverte : une vidéo truquée par IA prétendant qu'un médecin célèbre a été arrêté pour avoir révélé la formule d'un médicament contre l'hypertension qui guérissait les gens en 3 jours] (https://www.thaipbs.or.th/verify/content/391), Mme Bunnag a été victime d'usurpation d'identité. Lors d'une interview avec Panya Nirankul pour Thai PBS Verify, Mme Bunnag a déclaré qu'en seulement un an, il y avait eu au moins 3 ou 4 incidents similaires, et que celui-ci était considéré comme le plus crédible. [] (https://files.wp.thaipbs.or.th/verify/2025/07/S__55410694.jpg) Dans le cas le plus récent, Mme Dolyana a révélé que la vidéo truquée par l'IA est cette fois-ci très réaliste : le ton de la voix, le rythme de la parole et le style du reportage sont parfaitement imitables. Bien que l'accent soit encore légèrement différent, les téléspectateurs non avertis pourraient la confondre avec un véritable reportage. En particulier, la dernière version, traduite en anglais, paraît plus aboutie que les précédentes. Par ailleurs, Thai PBS a confirmé qu'elle n'a pas pour politique de diffuser des informations ou des publicités incitant à l'investissement. « Je suis préoccupée par ce problème car n'importe qui peut être victime de deepfakes générés par l'IA, et en tant que femme, je crains que cela ne soit utilisé de manière obscène. » Initialement, après avoir été la première victime, la présentatrice a porté plainte, mais l'affaire est au point mort. Il a déclaré que cette affaire cause non seulement un préjudice personnel au présentateur, mais nuit également à l'image de Thai PBS en tant que représentant officiel de la chaîne. La falsification d'images et de sons visant à présenter un contenu trompeur compromet inévitablement la crédibilité des médias publics. La législation thaïlandaise relative aux deepfakes est la suivante : la loi sur la cybercriminalité de l'an 2560 (B.E. 2560), article 16, stipule que « Quiconque importe des données informatiques dans un système informatique accessible au public, données qui semblent représenter l'image d'une autre personne, et dont l'image est créée, modifiée ou altérée par voie électronique ou autre, de manière à porter atteinte à la réputation de cette personne, à susciter le mépris, la haine ou la honte, est passible d'une peine d'emprisonnement n'excédant pas trois ans. » et une amende n'excédant pas deux cent mille bahts » - Code pénal, articles relatifs à la diffamation, à l'injure et à la diffusion de contenus obscènes - Loi sur la protection des données personnelles (PDPA) si des informations personnelles (visage, nom et voix) sont utilisées sans consentement - Si la victime est mineure, cela peut constituer une infraction en vertu de la loi sur la prévention et la répression de la traite des êtres humains ou de la loi sur la protection de l'enfance. Procédure de vérification ---------------- - Vérifiez la transparence de la page Facebook. La date de création de la page est importante. Les informations de la page jugées irrégulières incluent l'utilisation du logo de l'agence de presse thaïlandaise Rath, l'ajout d'un lien vers un faux site web et des adresses et numéros de téléphone non fiables. - Demandez à un expert en technologie d'imagerie par IA de confirmer que la vidéo a été créée à l'aide de la technologie Deepfake. - Obtenez la confirmation des personnes impliquées dans la vidéo et de la victime dont les informations personnelles ont été usurpées grâce à la technologie Deepfake. Impact de la réception de ce type d'information ------------------------------- 1. Atteinte à la crédibilité des médias et des présentateurs. Si un groupe de personnes y croit ou l'interprète mal, cela peut nuire à la crédibilité de la chaîne d'information ou des médias dans leur ensemble. 2. Violation des droits de la personne. Utiliser le visage ou la voix d'une autre personne sans autorisation constitue une violation des droits de la personne, ce qui est illégal. 3. Ouverture d'un terrain propice à l'exploitation par les criminels. Les fausses vidéos peuvent être créées et largement diffusées, notamment à des fins de fraude ou de vente de produits. Recommandations en cas de réception de cette fausse information ? ------------------------------- 1. Rassemblez immédiatement des preuves. 1. Avertissez la personne dont l'image a été usurpée. - Rassemblez les images, vidéos ou textes modifiés. Si le contenu a été publié dans un groupe de discussion ou sur les réseaux sociaux, conservez l'historique de la conversation et l'URL de la publication. 2. Signalez le contenu sur la plateforme (Facebook, YouTube, TikTok) - Signalez le contenu à la plateforme où il a été publié (Facebook, X ou TikTok) afin qu'il soit supprimé. 3. Si vous êtes une victime dont l'image ou l'enregistrement audio a été utilisé, portez plainte ou contactez les autorités compétentes. - Déposez une plainte au commissariat de police ou auprès de la Division de la répression des crimes technologiques (TCSD), ainsi qu'auprès d'autres organismes compétents, tels que le ministère de l'Économie et de la Société numériques (DE), pour obtenir de l'aide concernant la suppression des données, ou appelez le centre de signalement des cybermenaces au 1212. 4. Analysez la vidéo créée par deepfake : - Remarquez le décalage entre les mouvements des lèvres et la parole. - Notez que les mouvements ne sont pas fluides car la vidéo a été modifiée. — Remarquez que les gestes sont répétitifs, comme en boucle. — Observez l’utilisation des accents par le narrateur dans l’extrait.