Incidents associés

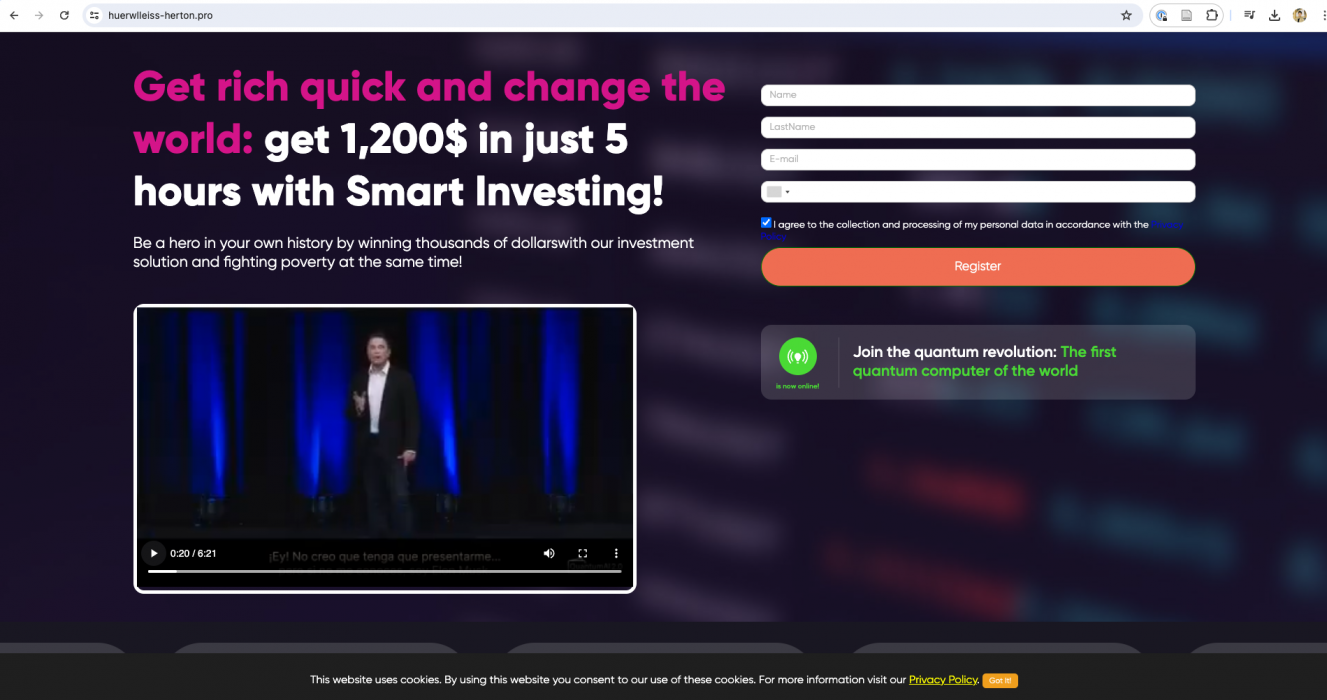

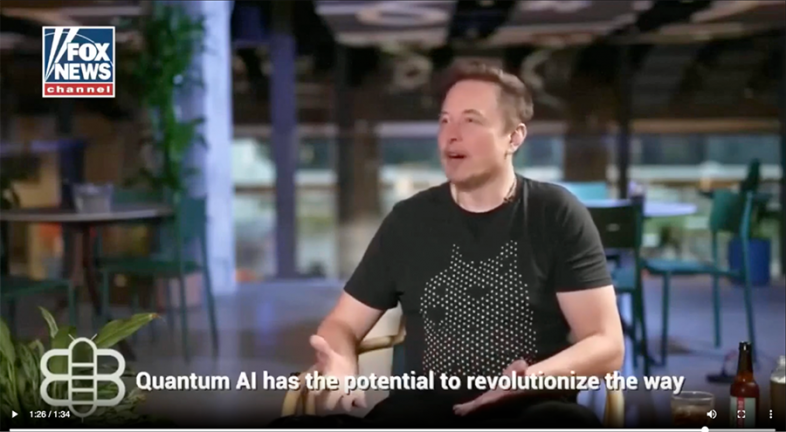

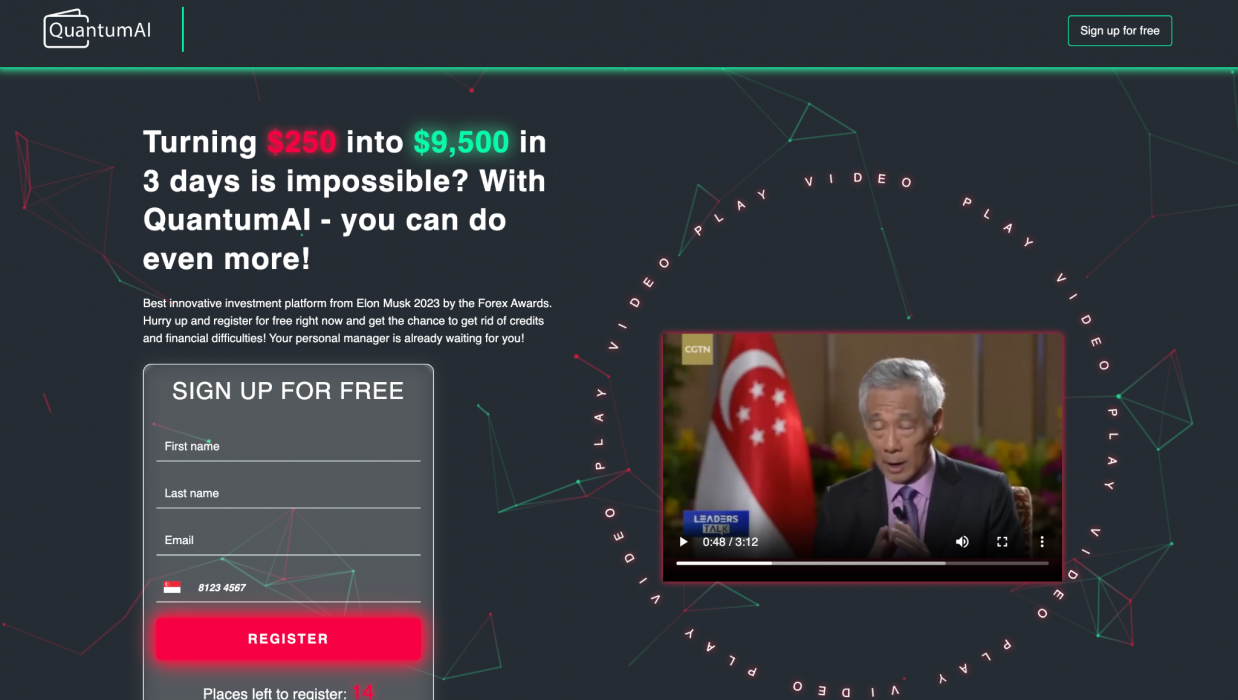

***Note de l'éditeur de l'AIID : Ceci est une version légèrement abrégée du rapport. Veuillez consulter la source originale pour le rapport complet. *** Résumé ----------------- Nos chercheurs ont découvert des dizaines de campagnes d'escroquerie utilisant des vidéos deepfakes à l'effigie de diverses personnalités publiques, notamment des PDG, des présentateurs de journaux télévisés et de hauts fonctionnaires. Ces campagnes sont diffusées en anglais, espagnol, français, italien, turc, tchèque et russe. Chaque campagne cible généralement des victimes potentielles dans un seul pays, notamment le Canada, le Mexique, la France, l'Italie, la Turquie, la Tchéquie, Singapour, le Kazakhstan et l'Ouzbékistan. En raison de leurs similitudes infrastructurelles et tactiques, nous pensons que bon nombre de ces campagnes proviennent probablement d'un seul groupe d'acteurs malveillants. Nous avons observé ce groupe d'acteurs malveillants utiliser des vidéos deepfakes pour diffuser de faux programmes d'investissement et de faux cadeaux sponsorisés par le gouvernement. En juin 2024, nous avions découvert des centaines de domaines utilisés pour promouvoir ces campagnes. Chaque domaine a été consulté en moyenne 114 000 fois dans le monde depuis sa mise en ligne, d'après notre télémétrie DNS passive (pDNS). En commençant par une campagne promouvant un programme d'investissement appelé Quantum AI, nous avons étudié l'infrastructure derrière cette campagne afin de suivre sa propagation dans le temps. Cette analyse nous a permis de découvrir plusieurs autres campagnes deepfakes, exploitant des thèmes totalement différents, créées et promues par le même groupe d'acteurs malveillants. Ces campagnes d'escroquerie utilisaient des langages différents et l'image de personnalités publiques différentes, suggérant que chaque campagne s'adresse à un public cible différent. Malgré l'utilisation de l'IA générative (GenAI) dans ces campagnes, les techniques d'investigation traditionnelles restent utiles pour identifier l'infrastructure d'hébergement utilisée par ces acteurs malveillants. Face à l'augmentation de l'utilisation malveillante de la technologie deepfake par les acteurs malveillants, les efforts des défenseurs doivent également être renforcés pour détecter et prévenir proactivement ce type d'attaques. Les clients de Palo Alto Networks sont mieux protégés contre ces attaques grâce au Filtrage d'URL avancé, qui continuera de détecter et de bloquer les sites web utilisés pour propager des campagnes d'escroquerie deepfake. | Sujets connexes de l'Unité 42 | Escroqueries, Hameçonnage | | --- | --- | Découverte de l'infrastructure d'hébergement de l'IA quantique --------------------------------------------- Pour étudier la campagne d'IA quantique, nous avons décidé d'analyser l'infrastructure derrière les sites Web hébergeant ces attaques. En commençant par un ensemble initial de détections de notre pipeline de détection de vidéos deepfake, nous avons ensuite recherché d'autres sites Web diffusant des vidéos malveillantes connues. Nous avons observé plusieurs vidéos liées à l'IA quantique que les adversaires partageaient largement via des sites Web hébergés sur des domaines nouvellement enregistrés. Après une enquête plus approfondie, nous avons identifié que les vidéos elles-mêmes étaient principalement hébergées sur un seul domaine : - Belmar-marketing[.]online Ensuite, nous avons recherché d'autres pages Web qui diffusaient des fichiers vidéo de ce domaine et contenaient également des mots clés comme Quantum AI dans le contenu HTML. Grâce à ce processus, nous avons pu découvrir des dizaines d'autres pages d'escroquerie utilisant ces vidéos comme leurre. Français Nous avons ensuite utilisé le contenu de ces pages Web ainsi que les noms de chemin des fichiers vidéo pour créer des signatures afin d'étendre nos détections. (Voir la section Indicateurs de compromission pour des exemples d'URL.) En mai 2024, nous avons remarqué qu'un nombre croissant de vidéos Quantum AI étaient également hébergées sur d'autres domaines, notamment les suivants : - Ai-usmcollective[.]click - Fortunatenews[.]com - Fiirststreeeet[.]top Nous avons également découvert certains sites créés à l'aide de créateurs de sites Web qui faisaient la promotion de la même arnaque Quantum AI. Dans ces cas, les attaquants ont réhébergé la vidéo directement sur le site via le créateur de site Web, et non sur l'un des domaines d'hébergement vidéo partagé mentionnés ci-dessus. ### Exemples de vidéos et de pages Web d'IA quantique Dans les figures 1 à 7, nous présentons des exemples de pages Web et de vidéos frauduleuses utilisant l'IA quantique, découvertes grâce à notre pipeline d'analyse vidéo et à notre investigation basée sur l'infrastructure. Dans la plupart de ces exemples, la page Web frauduleuse était hébergée sur un domaine nouvellement enregistré et la vidéo était hébergée sous forme de fichier .mp4 sur l'un des domaines d'hébergement vidéo partagés mentionnés ci-dessus (par exemple, belmar-marketing[.]online). Dans la plupart des cas, les attaquants semblent avoir commencé avec une vidéo légitime et y avoir ajouté leur propre audio généré par l'IA. Enfin, ils ont utilisé une technologie de synchronisation labiale pour modifier le mouvement des lèvres de l'orateur afin qu'il corresponde à l'audio généré par l'IA. La plupart des vidéos utilisent Elon Musk comme célébrité de choix, bien que nous ayons découvert une poignée d'exemples utilisant également d'autres personnalités publiques : - Tucker Carlson - Lee Hsien Loong, l'ancien Premier ministre de Singapour - Tharman Shanmugaratnam, le président de Singapour (en juin 2024)  Figure 1. Huerwlleiss-herton[.]pro, un site Web utilisant une vidéo deepfake d'Elon Musk pour promouvoir l'arnaque de l'IA quantique.

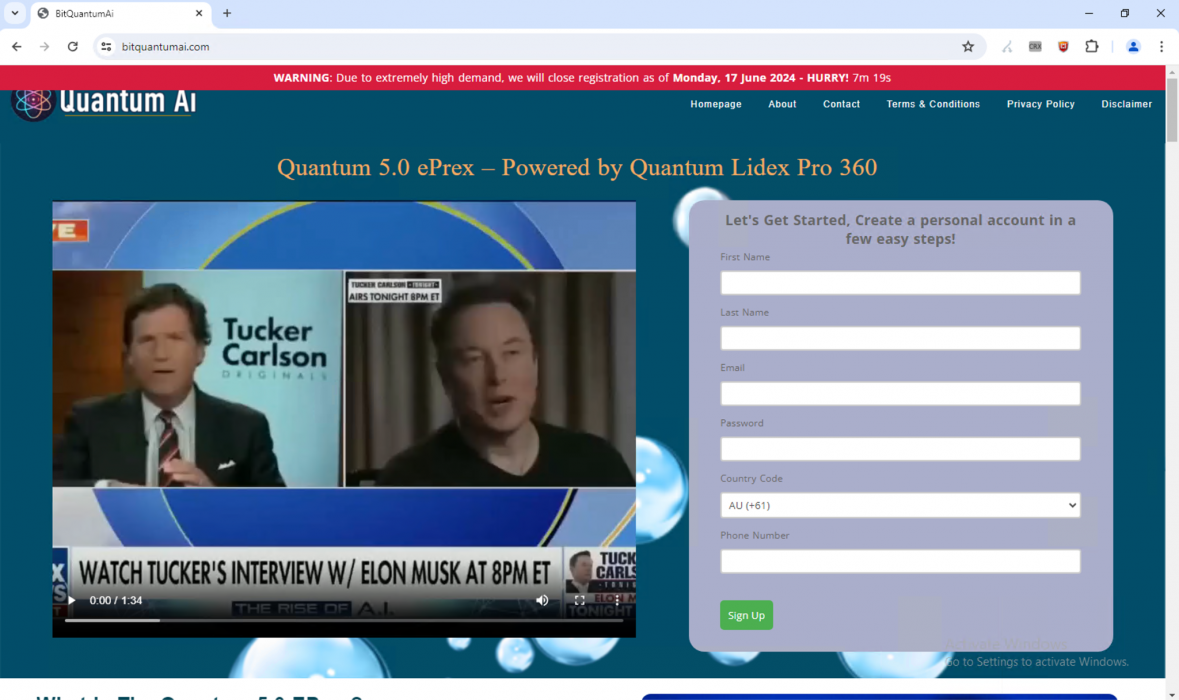

Figure 1. Huerwlleiss-herton[.]pro, un site Web utilisant une vidéo deepfake d'Elon Musk pour promouvoir l'arnaque de l'IA quantique.  Figure 2. Bitquantumai[.]com, un site web utilisant une vidéo deepfake d'Elon Musk et Tucker Carlson pour promouvoir l'arnaque Quantum AI.

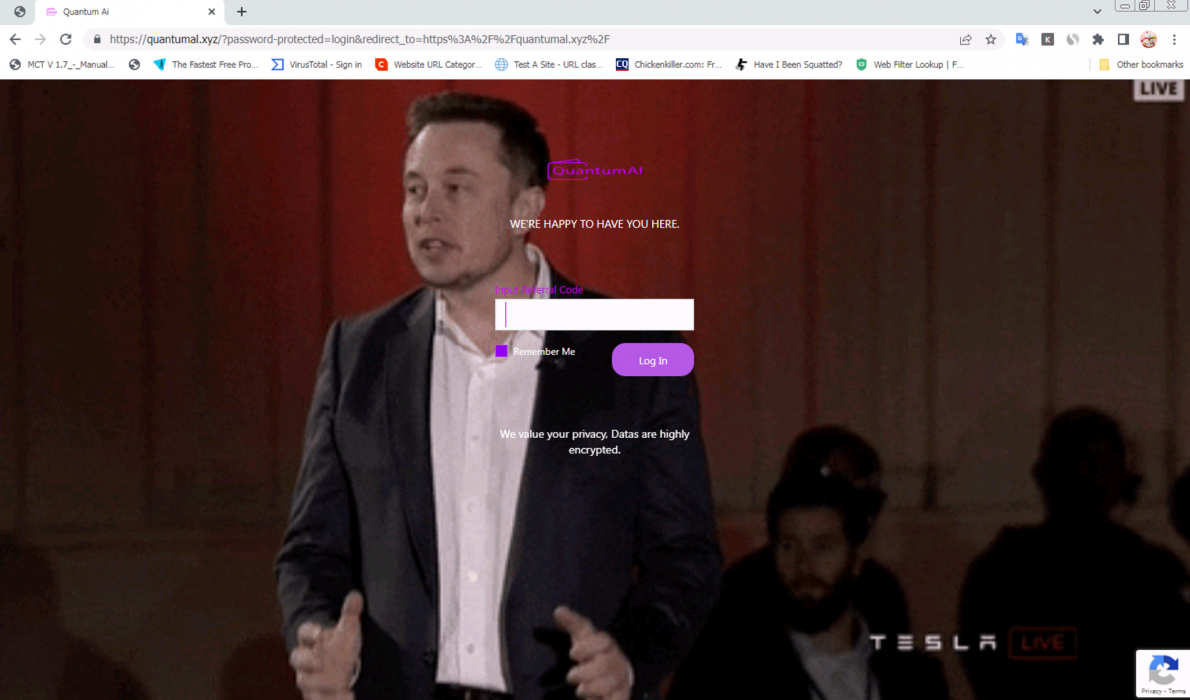

Figure 2. Bitquantumai[.]com, un site web utilisant une vidéo deepfake d'Elon Musk et Tucker Carlson pour promouvoir l'arnaque Quantum AI.  Figure 3. Quantumal[.]xyz, un site web utilisé pour promouvoir l'arnaque Quantum AI. La page web demande un code de parrainage pour se connecter.

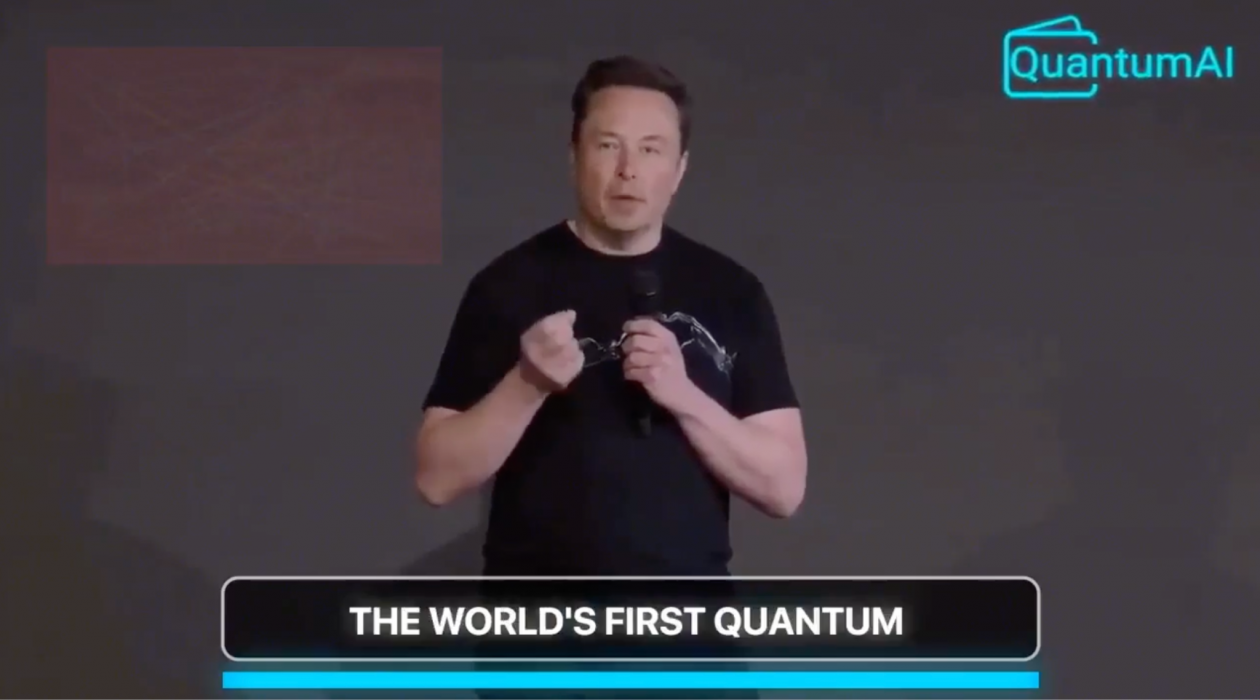

Figure 3. Quantumal[.]xyz, un site web utilisé pour promouvoir l'arnaque Quantum AI. La page web demande un code de parrainage pour se connecter.  Figure 4. Capture d’écran d’une vidéo deepfake d’Elon Musk utilisée pour promouvoir l’arnaque de l’IA quantique. Dans la vidéo, le deepfake-Elon affirme que l’IA quantique est le « premier logiciel d’informatique quantique au monde développé par son équipe avec un taux de réussite de 91 %. »

Figure 4. Capture d’écran d’une vidéo deepfake d’Elon Musk utilisée pour promouvoir l’arnaque de l’IA quantique. Dans la vidéo, le deepfake-Elon affirme que l’IA quantique est le « premier logiciel d’informatique quantique au monde développé par son équipe avec un taux de réussite de 91 %. »  Figure 5. Autre capture d’écran d’un autre Elon Musk. Vidéo deepfake utilisée pour promouvoir l'arnaque de l'IA quantique.

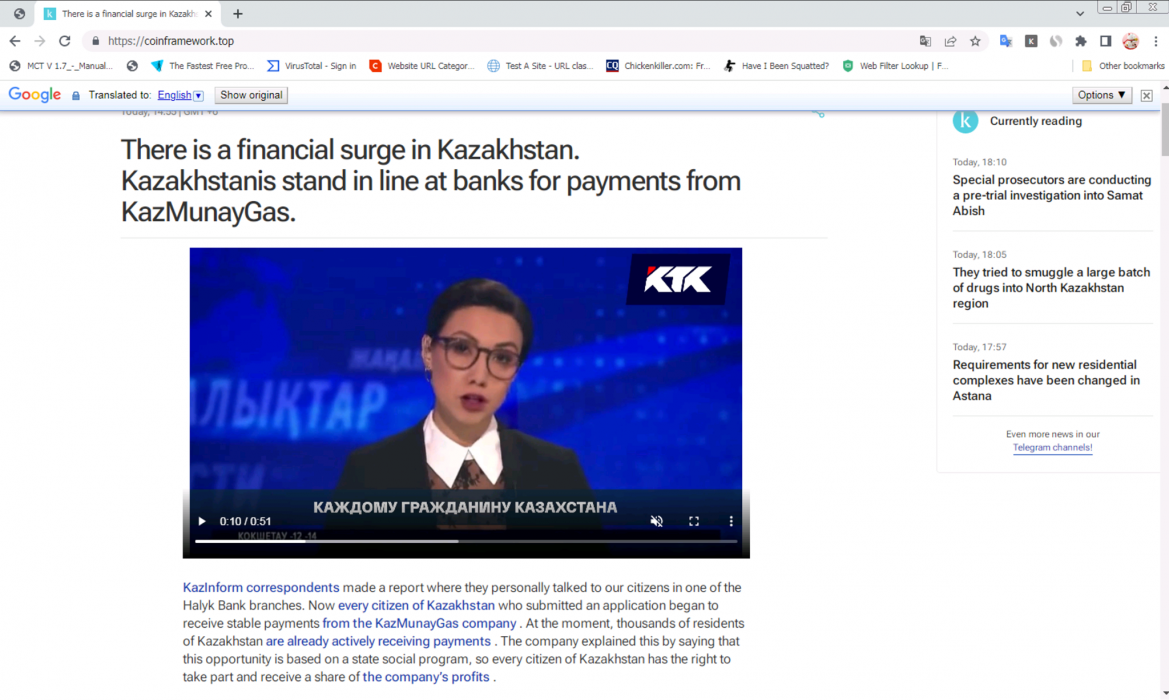

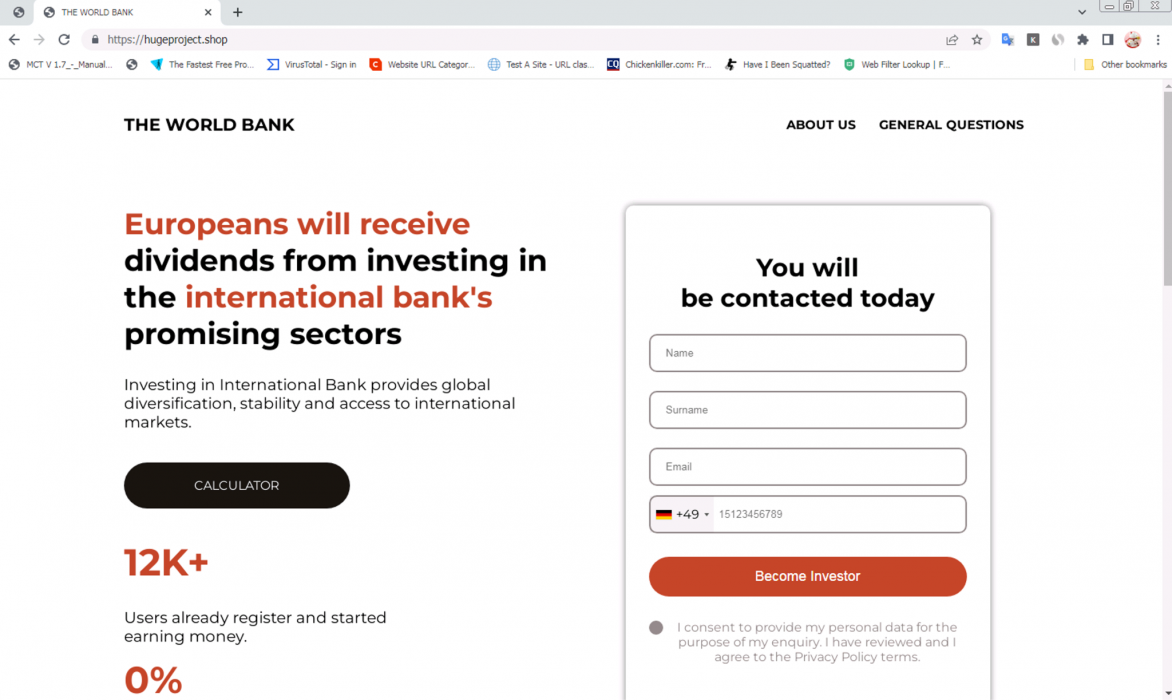

Figure 5. Autre capture d’écran d’un autre Elon Musk. Vidéo deepfake utilisée pour promouvoir l'arnaque de l'IA quantique.  Figure 6. Griffinware-tm.cloud, un site web utilisant une vidéo deepfake de Lee Hsien Loong, l'ancien Premier ministre de Singapour, pour promouvoir l'arnaque de l'IA quantique. ![Une personne en tenue professionnelle est assise à un bureau de presse, sous lequel est affiché l'inscription « IA quantique ». L'arrière-plan est uni et clair. mur. Figure 7. Capture d'écran d'une vidéo deepfake de Tharman Shanmugaratnam, l'actuel président de Singapour, utilisée pour promouvoir l'arnaque Quantum AI. Découverte et suivi des campagnes deepfakes ---------------------------------------- Après avoir enquêté sur la campagne d'arnaque Quantum AI, nous avons exploré les tendances plus larges entourant ces campagnes deepfakes dans leur ensemble. ### Découverte d'autres arnaques deepfakes En plus de l'arnaque Quantum AI, nous avons également enquêté sur les autres vidéos présentes sur ces domaines d'hébergement de vidéos. Ce faisant, nous avons pu découvrir plusieurs autres campagnes d'arnaque (probablement propagées par le même groupe d'acteurs malveillants), dont beaucoup utilisent des vidéos deepfakes comme leurre. Ces vidéos deepfakes utilisent généralement l'image de personnalités publiques telles que des PDG, Des présentateurs de journaux télévisés ou de hauts fonctionnaires ont été identifiés. Nous avons découvert des vidéos deepfakes en plusieurs langues, dont l'anglais, l'espagnol, le français, l'italien, le turc, le tchèque et le russe. Chaque campagne cible généralement des victimes potentielles dans un seul pays, notamment le Canada, le Mexique, la France, l'Italie, la Turquie, la Tchéquie, Singapour, le Kazakhstan et l'Ouzbékistan. À l'instar de l'arnaque à l'IA quantique, ces vidéos ajoutent un son généré par l'IA à une vidéo existante et utilisent des outils de synchronisation labiale pour ajuster le mouvement des lèvres de l'orateur au nouveau son. Les visiteurs de ces pages web sont invités à s'inscrire avec leur nom et leur numéro de téléphone, puis à attendre un appel d'un gestionnaire de compte ou d'un représentant. Dans de nombreux cas, nous avons découvert plusieurs domaines récemment enregistrés hébergeant le même contenu (et le même leurre deepfake). Cela signifie que chacune de ces pages web frauduleuses fait partie d'une campagne plus vaste, et non d'une simple page web frauduleuse. Par exemple, dans le cas de l'arnaque KazMunayGas, illustrée ci-dessous à la figure 8, nous avons constaté que des escrocs utilisaient la même vidéo sur plusieurs pages récemment enregistrées. domaines, y compris : - Aigroundwork[.]top - Aitfinside[.]shop - Block4aischeme[.]top - Systemaigroundwork[.]shop La section Indicateurs de compromission fournit une liste plus complète de ces domaines.

Figure 6. Griffinware-tm.cloud, un site web utilisant une vidéo deepfake de Lee Hsien Loong, l'ancien Premier ministre de Singapour, pour promouvoir l'arnaque de l'IA quantique. ![Une personne en tenue professionnelle est assise à un bureau de presse, sous lequel est affiché l'inscription « IA quantique ». L'arrière-plan est uni et clair. mur. Figure 7. Capture d'écran d'une vidéo deepfake de Tharman Shanmugaratnam, l'actuel président de Singapour, utilisée pour promouvoir l'arnaque Quantum AI. Découverte et suivi des campagnes deepfakes ---------------------------------------- Après avoir enquêté sur la campagne d'arnaque Quantum AI, nous avons exploré les tendances plus larges entourant ces campagnes deepfakes dans leur ensemble. ### Découverte d'autres arnaques deepfakes En plus de l'arnaque Quantum AI, nous avons également enquêté sur les autres vidéos présentes sur ces domaines d'hébergement de vidéos. Ce faisant, nous avons pu découvrir plusieurs autres campagnes d'arnaque (probablement propagées par le même groupe d'acteurs malveillants), dont beaucoup utilisent des vidéos deepfakes comme leurre. Ces vidéos deepfakes utilisent généralement l'image de personnalités publiques telles que des PDG, Des présentateurs de journaux télévisés ou de hauts fonctionnaires ont été identifiés. Nous avons découvert des vidéos deepfakes en plusieurs langues, dont l'anglais, l'espagnol, le français, l'italien, le turc, le tchèque et le russe. Chaque campagne cible généralement des victimes potentielles dans un seul pays, notamment le Canada, le Mexique, la France, l'Italie, la Turquie, la Tchéquie, Singapour, le Kazakhstan et l'Ouzbékistan. À l'instar de l'arnaque à l'IA quantique, ces vidéos ajoutent un son généré par l'IA à une vidéo existante et utilisent des outils de synchronisation labiale pour ajuster le mouvement des lèvres de l'orateur au nouveau son. Les visiteurs de ces pages web sont invités à s'inscrire avec leur nom et leur numéro de téléphone, puis à attendre un appel d'un gestionnaire de compte ou d'un représentant. Dans de nombreux cas, nous avons découvert plusieurs domaines récemment enregistrés hébergeant le même contenu (et le même leurre deepfake). Cela signifie que chacune de ces pages web frauduleuses fait partie d'une campagne plus vaste, et non d'une simple page web frauduleuse. Par exemple, dans le cas de l'arnaque KazMunayGas, illustrée ci-dessous à la figure 8, nous avons constaté que des escrocs utilisaient la même vidéo sur plusieurs pages récemment enregistrées. domaines, y compris : - Aigroundwork[.]top - Aitfinside[.]shop - Block4aischeme[.]top - Systemaigroundwork[.]shop La section Indicateurs de compromission fournit une liste plus complète de ces domaines.  Figure 8. Coinframework[.]top, un site web frauduleux utilisant une vidéo manipulée par l'IA de Un présentateur de journal kazakh a fait la promotion d'un faux concours lancé par KazMunayGas, la compagnie pétrolière et gazière publique du Kazakhstan.

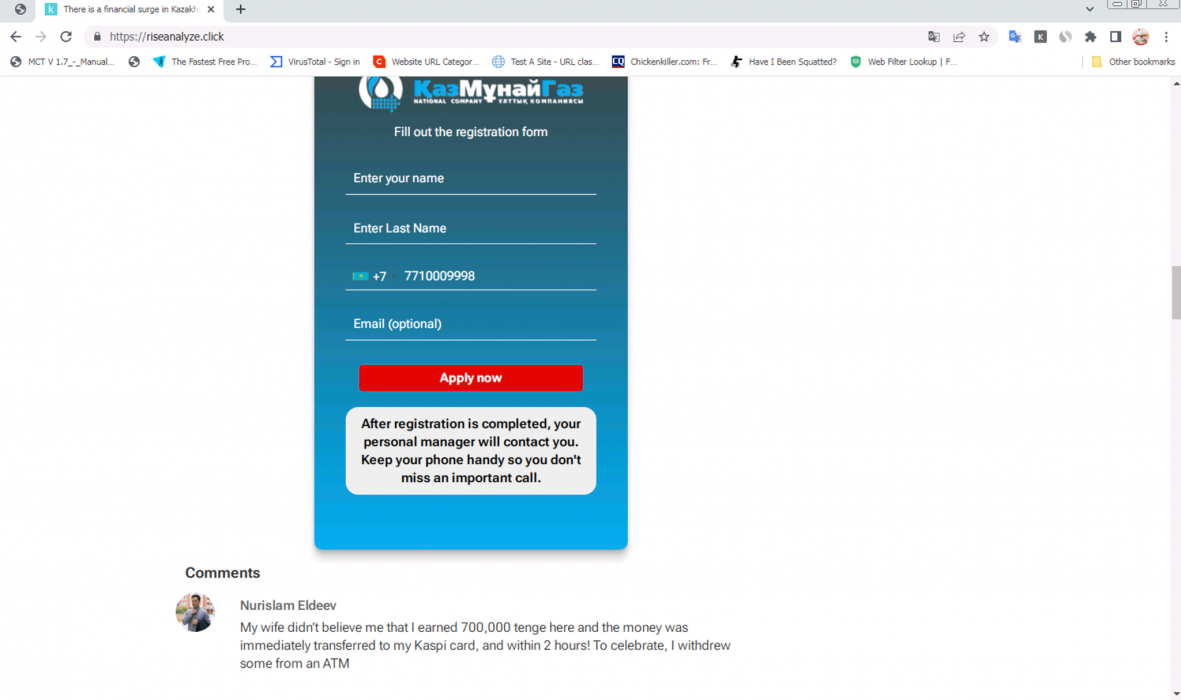

Figure 8. Coinframework[.]top, un site web frauduleux utilisant une vidéo manipulée par l'IA de Un présentateur de journal kazakh a fait la promotion d'un faux concours lancé par KazMunayGas, la compagnie pétrolière et gazière publique du Kazakhstan.  Figure 9. Riseanalyze[.]click, un site web lié à coinframework[.]top. Ce site web contient un formulaire d'inscription pour l'arnaque KazMunayGas. Bien que les langages et les cibles d'usurpation d'identité de ces campagnes d'arnaque soient différents, elles partagent les points communs suivants : - Elles utilisent toutes des techniques de deepfake similaires - Leurs appels à l'action sont similaires - Leurs vidéos sont hébergées sur un petit ensemble partagé de domaines (qui ne semblent pas être utilisés à d'autres fins que l'hébergement de ces vidéos frauduleuses). Cela suggère que ces campagnes peuvent très probablement être attribuées à un seul groupe d'acteurs malveillants. Nous présentons quelques exemples sélectionnés de ces campagnes frauduleuses supplémentaires dans les figures 10 à 15.

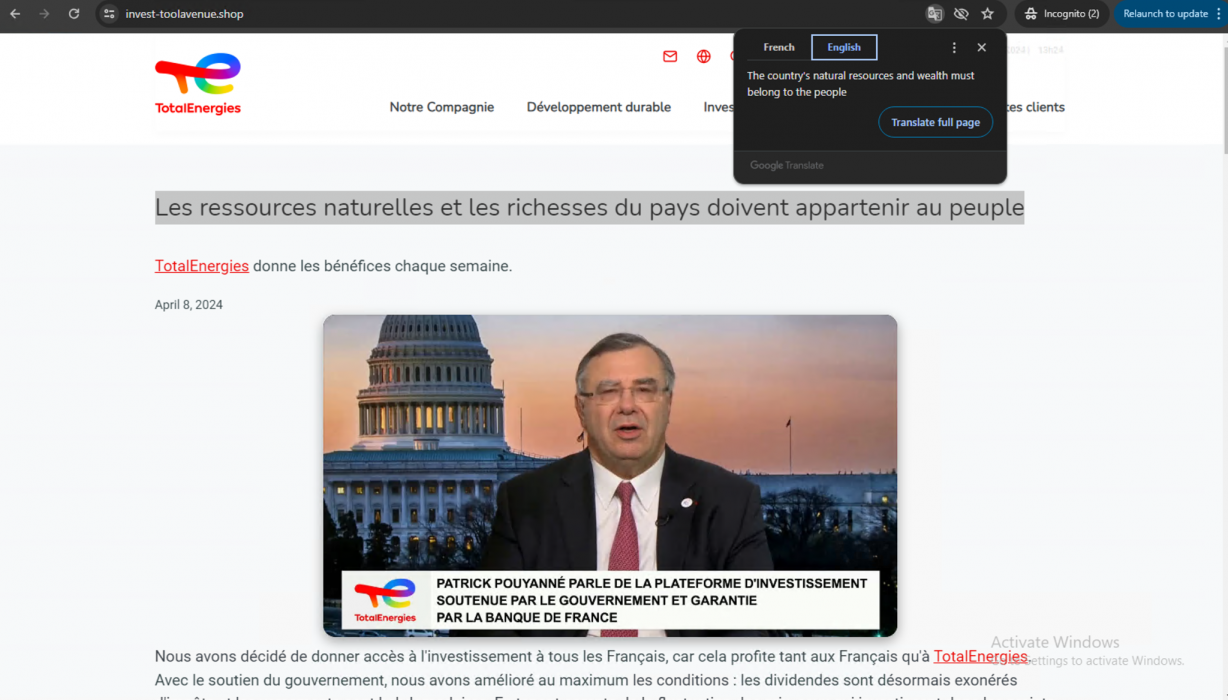

Figure 9. Riseanalyze[.]click, un site web lié à coinframework[.]top. Ce site web contient un formulaire d'inscription pour l'arnaque KazMunayGas. Bien que les langages et les cibles d'usurpation d'identité de ces campagnes d'arnaque soient différents, elles partagent les points communs suivants : - Elles utilisent toutes des techniques de deepfake similaires - Leurs appels à l'action sont similaires - Leurs vidéos sont hébergées sur un petit ensemble partagé de domaines (qui ne semblent pas être utilisés à d'autres fins que l'hébergement de ces vidéos frauduleuses). Cela suggère que ces campagnes peuvent très probablement être attribuées à un seul groupe d'acteurs malveillants. Nous présentons quelques exemples sélectionnés de ces campagnes frauduleuses supplémentaires dans les figures 10 à 15.  Figure 10. Invest-toolavenue[.]shop, un site web frauduleux utilisant une vidéo manipulée par l'IA de Patrick Pouyanné (PDG de TotalEnergies) pour promouvoir un faux cadeau prétendument créé par TotalEnergies, une multinationale française de l'énergie et du pétrole. Entreprise.

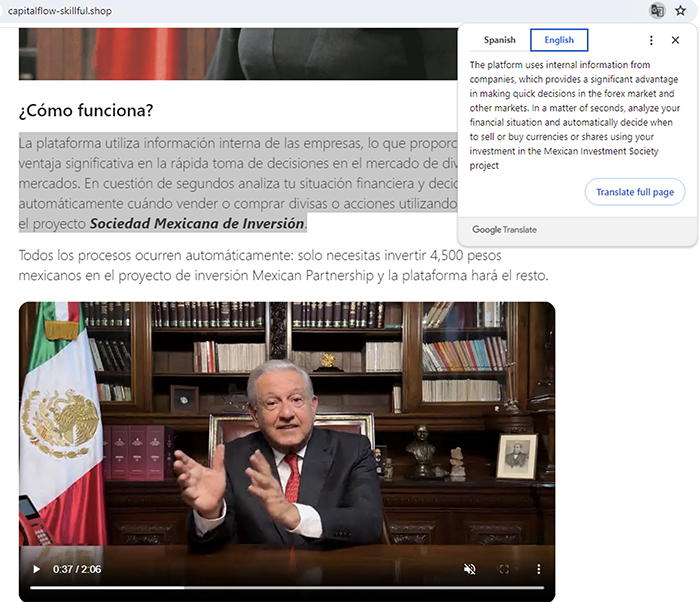

Figure 10. Invest-toolavenue[.]shop, un site web frauduleux utilisant une vidéo manipulée par l'IA de Patrick Pouyanné (PDG de TotalEnergies) pour promouvoir un faux cadeau prétendument créé par TotalEnergies, une multinationale française de l'énergie et du pétrole. Entreprise.  Figure 11. Boutique Invest-toolavenue[.], suite de la figure 10. ![ Le président mexicain Andrés Manuel López Obrador s'exprimant à un bureau, le drapeau mexicain en arrière-plan et des livres sur des étagères. Une fenêtre contextuelle permet de traduire la page en anglais ou en français. Espagnol. Figure 12. Capitalflow-skillful.shop, un site web frauduleux utilisant une vidéo manipulée par l'IA d'Andrés Manuel López, le président du Mexique, pour promouvoir un faux « Projet de Société d'investissement mexicaine ».

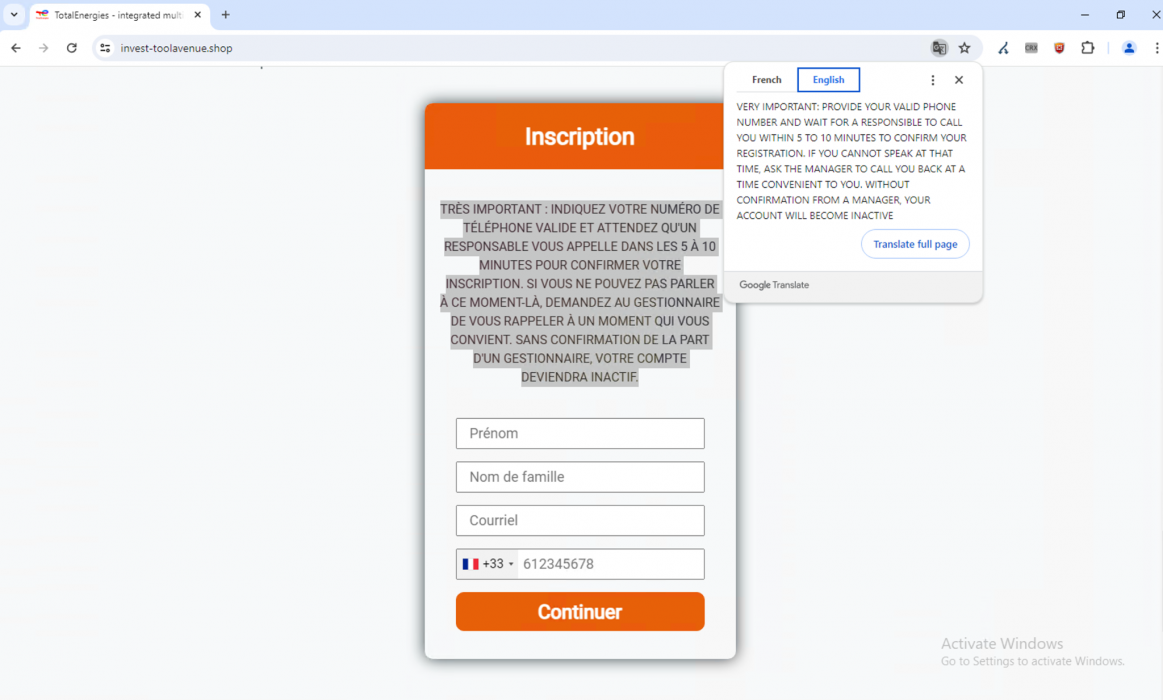

Figure 11. Boutique Invest-toolavenue[.], suite de la figure 10.  Figure 13. Untamedal.top, un site web frauduleux utilisant une vidéo manipulée par l'IA de Giorgia Meloni, la Première ministre du L'Italie, pour promouvoir un faux programme d'investissement public appelé FinInvest.

Figure 13. Untamedal.top, un site web frauduleux utilisant une vidéo manipulée par l'IA de Giorgia Meloni, la Première ministre du L'Italie, pour promouvoir un faux programme d'investissement public appelé FinInvest.  Figure 14. Hugeproject[.]shop, un site web frauduleux sur le thème de la Banque mondiale utilisant une vidéo manipulée par l'IA d'une femme prétendant représenter une banque d'investissement internationale.

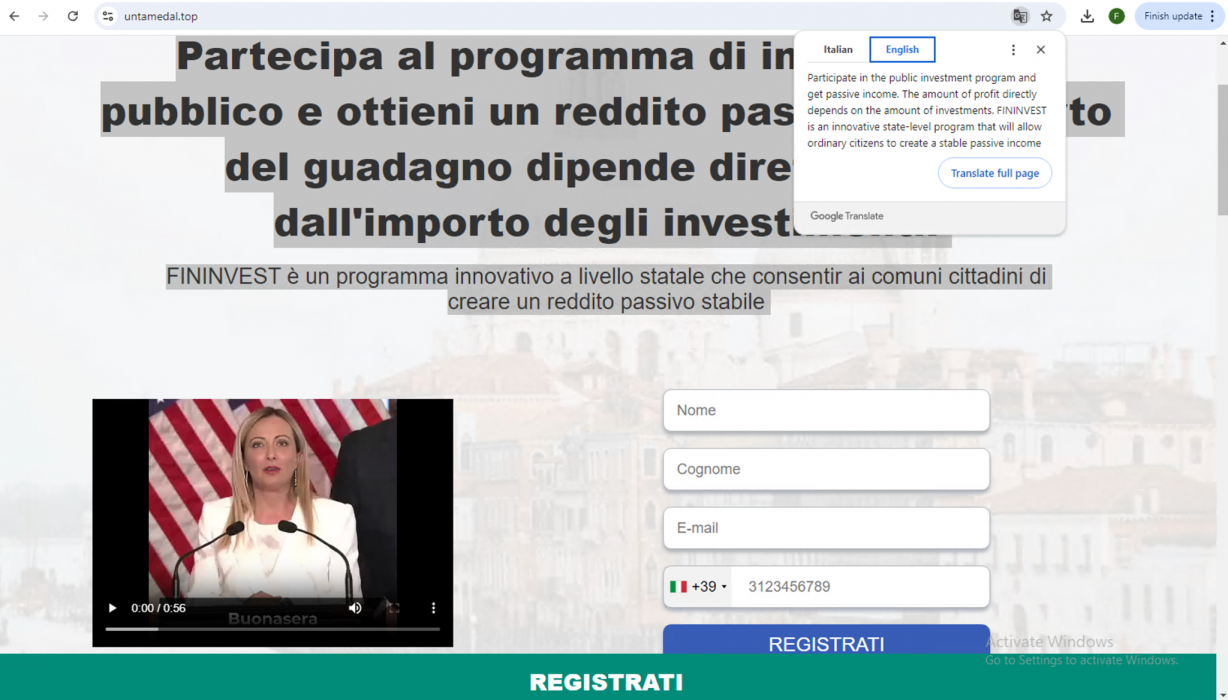

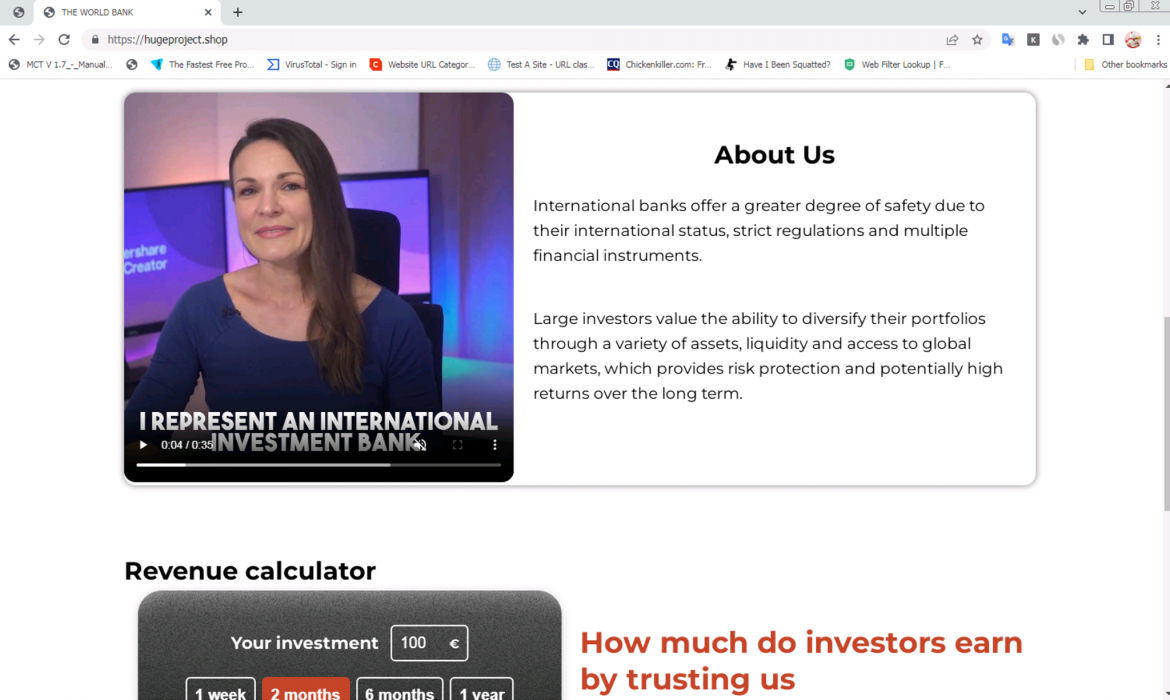

Figure 14. Hugeproject[.]shop, un site web frauduleux sur le thème de la Banque mondiale utilisant une vidéo manipulée par l'IA d'une femme prétendant représenter une banque d'investissement internationale.  Figure 15. Hugeproject[.]shop, suite de la Figure 14. ### Activité de la campagne au fil du temps Bien que ces campagnes aient commencé il y a environ un an, nous avons observé un pic important de nouveaux domaines observés (illustré dans la Figure 16) en février 2024. Contrairement aux domaines classiques de phishing ou de logiciels malveillants, ces domaines ont une durée de vie relativement longue, avec une durée d'activité moyenne de 142 jours.

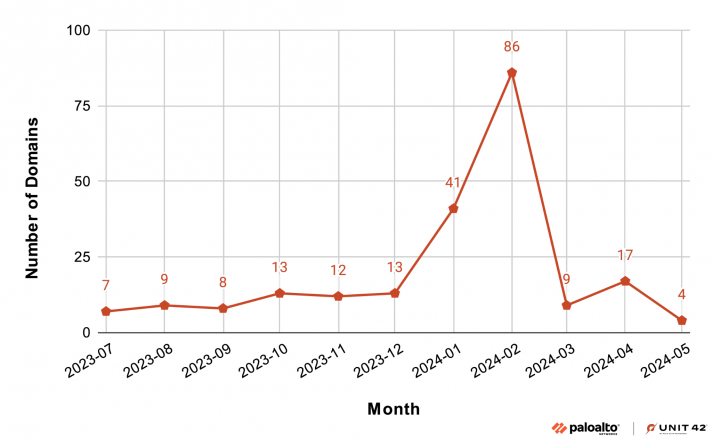

Figure 15. Hugeproject[.]shop, suite de la Figure 14. ### Activité de la campagne au fil du temps Bien que ces campagnes aient commencé il y a environ un an, nous avons observé un pic important de nouveaux domaines observés (illustré dans la Figure 16) en février 2024. Contrairement aux domaines classiques de phishing ou de logiciels malveillants, ces domaines ont une durée de vie relativement longue, avec une durée d'activité moyenne de 142 jours.  Figure 16. Nombre de nouveaux domaines observés hébergeant des vidéos deepfake au fil du temps. La figure 17 montre que le nombre de domaines actifs a augmenté de manière exponentielle jusqu'en mars 2024 environ, et que le nombre total de domaines actifs est resté stable jusqu'à aujourd'hui.

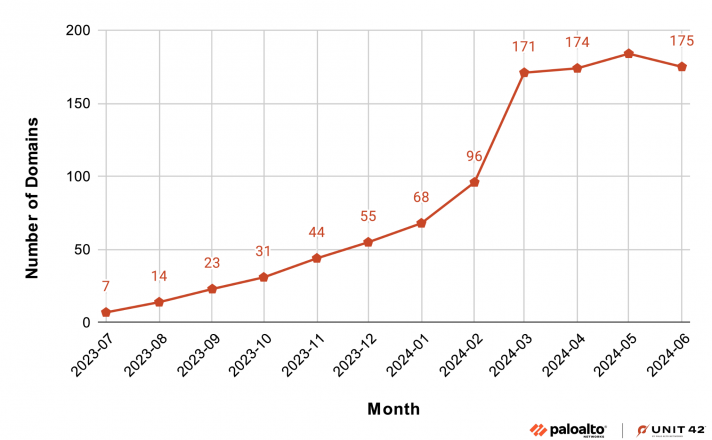

Figure 16. Nombre de nouveaux domaines observés hébergeant des vidéos deepfake au fil du temps. La figure 17 montre que le nombre de domaines actifs a augmenté de manière exponentielle jusqu'en mars 2024 environ, et que le nombre total de domaines actifs est resté stable jusqu'à aujourd'hui.  Figure 17. Nombre de Domaines actifs hébergeant des vidéos deepfake au fil du temps. De plus, il est inquiétant de constater que ces domaines ont une portée élevée, chaque domaine étant consulté en moyenne 114 000 fois depuis sa mise en ligne, selon la télémétrie pDNS. Le chiffre réel est probablement bien plus élevé. #### Analyse de l'infrastructure d'hébergement. Conformément à la tendance actuelle au camouflage dans les infrastructures d'hébergement mutualisé, 86,7 % de ces domaines de campagne utilisent le même réseau de diffusion de contenu (CDN) populaire. Plusieurs adresses IP du CDN hébergent le même contenu dans différentes zones géographiques, les États-Unis, les Pays-Bas et la Russie étant les trois principaux pays. L'utilisation de CDN rend difficile l'attribution de la campagne à un acteur malveillant ou à une géolocalisation spécifique. Nous avons constaté que les attaquants hébergeaient principalement leurs vidéos sur un petit nombre de domaines appartenant aux attaquants. Ils ont probablement procédé ainsi pour contourner les problèmes de retrait susceptibles de survenir sur des plateformes d'hébergement vidéo plus populaires. Jusqu'en avril 2024, nous avons constaté que les vidéos deepfake étaient principalement hébergées sur belmar-marketing[.]online. Cependant, à partir de mai 2024, les attaquants ont commencé à alterner plus fréquemment leurs sites d'hébergement vidéo. Ainsi, nous avons constaté que les vidéos étaient désormais principalement hébergées sur firststreeeet[.]top, ai-usmcollective[.]click et luckynews[.]com. La recherche de pages web contenant des liens vers des vidéos hébergées sur ces domaines s'est avérée très utile pour suivre la propagation de ces campagnes jusqu'à présent. Français Nous continuerons de surveiller les nouveaux domaines d'hébergement de vidéos au fur et à mesure de la progression de ces campagnes. Comment fonctionne l'arnaque de l'IA quantique ----------------------------- Au cours de nos recherches, nous avons observé des publications et des publicités faisant la promotion de l'IA quantique sur diverses plateformes de médias sociaux (illustrées dans les figures 18 à 20). Selon le National Anti-Scam Center australien, les arnaqueurs utilisent souvent d'abord ce type de publicités sur les médias sociaux ou de faux articles de presse pour créer des liens vers des pages Web frauduleuses qui demandent les coordonnées de l'utilisateur victime.

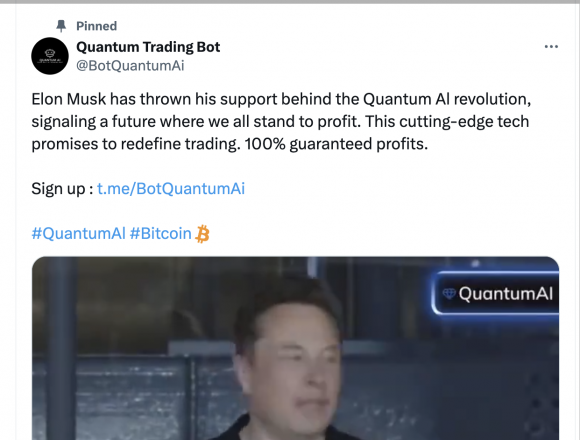

Figure 17. Nombre de Domaines actifs hébergeant des vidéos deepfake au fil du temps. De plus, il est inquiétant de constater que ces domaines ont une portée élevée, chaque domaine étant consulté en moyenne 114 000 fois depuis sa mise en ligne, selon la télémétrie pDNS. Le chiffre réel est probablement bien plus élevé. #### Analyse de l'infrastructure d'hébergement. Conformément à la tendance actuelle au camouflage dans les infrastructures d'hébergement mutualisé, 86,7 % de ces domaines de campagne utilisent le même réseau de diffusion de contenu (CDN) populaire. Plusieurs adresses IP du CDN hébergent le même contenu dans différentes zones géographiques, les États-Unis, les Pays-Bas et la Russie étant les trois principaux pays. L'utilisation de CDN rend difficile l'attribution de la campagne à un acteur malveillant ou à une géolocalisation spécifique. Nous avons constaté que les attaquants hébergeaient principalement leurs vidéos sur un petit nombre de domaines appartenant aux attaquants. Ils ont probablement procédé ainsi pour contourner les problèmes de retrait susceptibles de survenir sur des plateformes d'hébergement vidéo plus populaires. Jusqu'en avril 2024, nous avons constaté que les vidéos deepfake étaient principalement hébergées sur belmar-marketing[.]online. Cependant, à partir de mai 2024, les attaquants ont commencé à alterner plus fréquemment leurs sites d'hébergement vidéo. Ainsi, nous avons constaté que les vidéos étaient désormais principalement hébergées sur firststreeeet[.]top, ai-usmcollective[.]click et luckynews[.]com. La recherche de pages web contenant des liens vers des vidéos hébergées sur ces domaines s'est avérée très utile pour suivre la propagation de ces campagnes jusqu'à présent. Français Nous continuerons de surveiller les nouveaux domaines d'hébergement de vidéos au fur et à mesure de la progression de ces campagnes. Comment fonctionne l'arnaque de l'IA quantique ----------------------------- Au cours de nos recherches, nous avons observé des publications et des publicités faisant la promotion de l'IA quantique sur diverses plateformes de médias sociaux (illustrées dans les figures 18 à 20). Selon le National Anti-Scam Center australien, les arnaqueurs utilisent souvent d'abord ce type de publicités sur les médias sociaux ou de faux articles de presse pour créer des liens vers des pages Web frauduleuses qui demandent les coordonnées de l'utilisateur victime.  Figure 18. Publication sur les réseaux sociaux avec un lien vers une page Web frauduleuse concernant l'IA quantique.

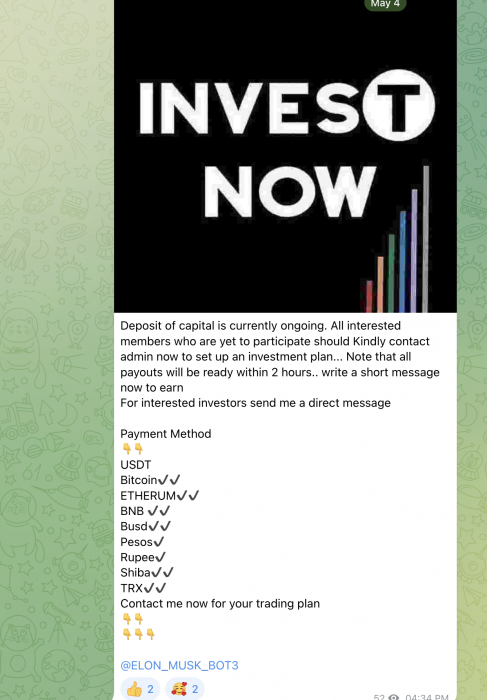

Figure 18. Publication sur les réseaux sociaux avec un lien vers une page Web frauduleuse concernant l'IA quantique.  Figure 19. Publication sur une plateforme de messagerie avec un lien vers une page Web frauduleuse concernant l'IA quantique.

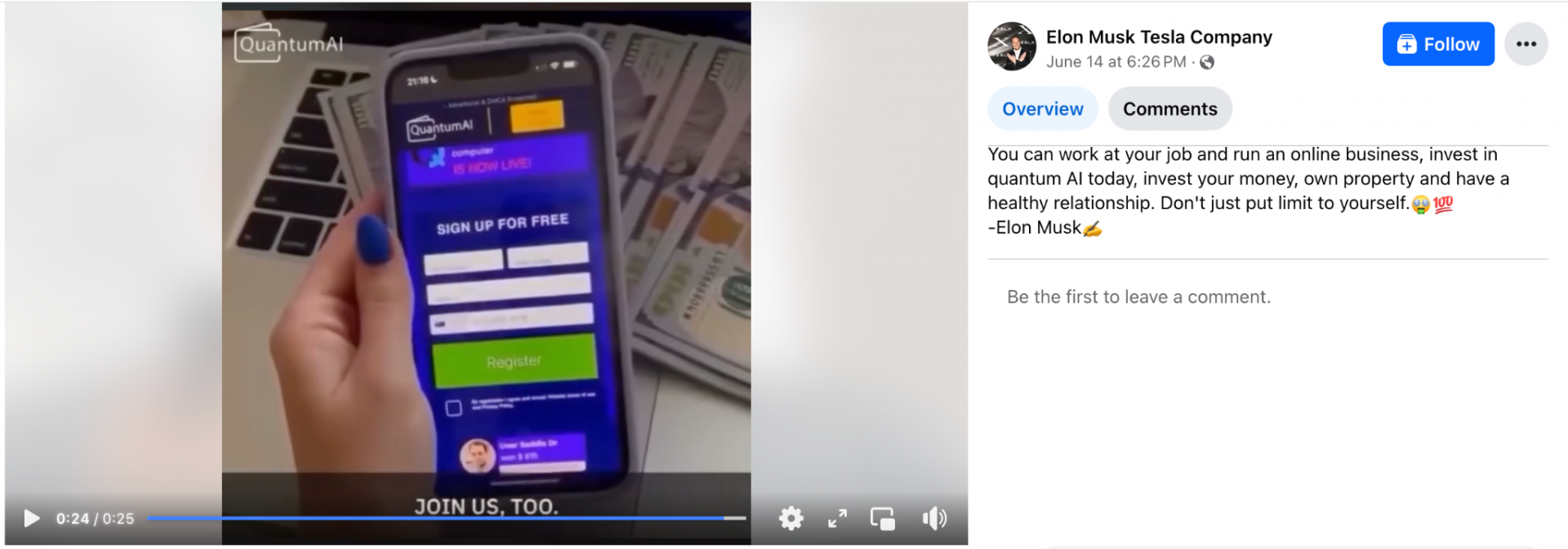

Figure 19. Publication sur une plateforme de messagerie avec un lien vers une page Web frauduleuse concernant l'IA quantique.  Figure 20. Publication sur les réseaux sociaux utilisant une vidéo pour promouvoir l'arnaque à l'IA quantique. Après avoir visité la page d'accueil de l'arnaque et rempli un formulaire d'inscription sur la plateforme, l'un des arnaqueurs appelle la victime. Lors de cet appel, l'arnaqueur lui indique qu'elle devra payer environ 250 $ pour accéder à la plateforme. L'arnaqueur lui demande de télécharger une application spéciale afin qu'elle puisse « investir » davantage de fonds. Dans l'application, un tableau de bord semble afficher de petits profits. Ensuite, les escrocs continuent de persuader la victime de déposer davantage d'argent et peuvent même lui permettre de retirer une petite somme afin de gagner sa confiance. Enfin, lorsque la victime tente de retirer ses fonds, les escrocs exigent des frais de retrait ou invoquent une autre raison (par exemple, des questions fiscales) pour justifier leur incapacité à récupérer ses fonds. Ils peuvent ensuite bloquer l'accès de la victime à son compte et empocher le solde restant, lui faisant perdre la majeure partie de son argent déposé sur la plateforme. Aperçu du paysage des arnaques deepfakes en ligne ------------------------------------------------- L'IA quantique n'est pas la seule arnaque impliquant des deepfakes utilisée par les pirates. Dans cette section, nous aborderons d'autres techniques et services qu'ils utilisent. Début 2024, une entreprise a perdu 25 millions de dollars à cause d'attaquants qui ont utilisé la technologie deepfake pour se faire passer pour son directeur financier lors d'une visioconférence. Si les deepfakes par visioconférence ont suscité une attention particulière suite à cette attaque, les arnaques deepfake en ligne constituent une menace émergente que les chercheurs devraient également surveiller. 2024 devrait être l'année électorale la plus importante de l'histoire. Plus de 60 pays organisent des élections importantes cette année, ce qui signifie qu'environ la moitié de la population mondiale pourrait être directement touchée par ces événements. En réponse, des chercheurs ont exprimé des inquiétudes quant au potentiel des deepfakes à promouvoir la désinformation politique. Cependant, l'impact des deepfakes ne se limite pas au domaine politique. Les cybercriminels créent et partagent déjà des vidéos deepfakes à des fins malveillantes. ### Deepfakes utilisés pour promouvoir des escroqueries et des attaques d'hameçonnage Depuis l'avènement de GenAI, les attaquants ont utilisé des deepfakes pour promouvoir la désinformation politique, et même pour sensibiliser davantage les électeurs. Par exemple, début 2024, un consultant politique démocrate a utilisé un deepfake audio de Joe Biden pour dissuader les électeurs du New Hampshire de voter lors des prochaines élections primaires. En Inde, des politiciens ont activement encouragé leurs partisans à créer des deepfakes pour promouvoir leurs propres candidatures. En 2022, un acteur malveillant inconnu a utilisé des deepfakes vidéo manipulés du président ukrainien Volodymir Zelensky dans le cadre de la guerre de l'information entre la Russie et l'Ukraine. Aujourd'hui, nous constatons que des cybercriminels commencent également à utiliser les deepfakes pour promouvoir leurs propres escroqueries et attaques de phishing. Ces derniers mois, des journalistes ont observé des escroqueries se faisant passer pour des personnalités comme Elon Musk (voir figure 21), Bill Gates et Warren Buffett, qui colportaient de fausses cryptomonnaies, des cadeaux publicitaires et d'autres stratagèmes d'investissement. Ces escroqueries visent à voler l'argent des victimes. (Nos précédents tweets sur ce sujet contiennent plus de détails.)

Figure 20. Publication sur les réseaux sociaux utilisant une vidéo pour promouvoir l'arnaque à l'IA quantique. Après avoir visité la page d'accueil de l'arnaque et rempli un formulaire d'inscription sur la plateforme, l'un des arnaqueurs appelle la victime. Lors de cet appel, l'arnaqueur lui indique qu'elle devra payer environ 250 $ pour accéder à la plateforme. L'arnaqueur lui demande de télécharger une application spéciale afin qu'elle puisse « investir » davantage de fonds. Dans l'application, un tableau de bord semble afficher de petits profits. Ensuite, les escrocs continuent de persuader la victime de déposer davantage d'argent et peuvent même lui permettre de retirer une petite somme afin de gagner sa confiance. Enfin, lorsque la victime tente de retirer ses fonds, les escrocs exigent des frais de retrait ou invoquent une autre raison (par exemple, des questions fiscales) pour justifier leur incapacité à récupérer ses fonds. Ils peuvent ensuite bloquer l'accès de la victime à son compte et empocher le solde restant, lui faisant perdre la majeure partie de son argent déposé sur la plateforme. Aperçu du paysage des arnaques deepfakes en ligne ------------------------------------------------- L'IA quantique n'est pas la seule arnaque impliquant des deepfakes utilisée par les pirates. Dans cette section, nous aborderons d'autres techniques et services qu'ils utilisent. Début 2024, une entreprise a perdu 25 millions de dollars à cause d'attaquants qui ont utilisé la technologie deepfake pour se faire passer pour son directeur financier lors d'une visioconférence. Si les deepfakes par visioconférence ont suscité une attention particulière suite à cette attaque, les arnaques deepfake en ligne constituent une menace émergente que les chercheurs devraient également surveiller. 2024 devrait être l'année électorale la plus importante de l'histoire. Plus de 60 pays organisent des élections importantes cette année, ce qui signifie qu'environ la moitié de la population mondiale pourrait être directement touchée par ces événements. En réponse, des chercheurs ont exprimé des inquiétudes quant au potentiel des deepfakes à promouvoir la désinformation politique. Cependant, l'impact des deepfakes ne se limite pas au domaine politique. Les cybercriminels créent et partagent déjà des vidéos deepfakes à des fins malveillantes. ### Deepfakes utilisés pour promouvoir des escroqueries et des attaques d'hameçonnage Depuis l'avènement de GenAI, les attaquants ont utilisé des deepfakes pour promouvoir la désinformation politique, et même pour sensibiliser davantage les électeurs. Par exemple, début 2024, un consultant politique démocrate a utilisé un deepfake audio de Joe Biden pour dissuader les électeurs du New Hampshire de voter lors des prochaines élections primaires. En Inde, des politiciens ont activement encouragé leurs partisans à créer des deepfakes pour promouvoir leurs propres candidatures. En 2022, un acteur malveillant inconnu a utilisé des deepfakes vidéo manipulés du président ukrainien Volodymir Zelensky dans le cadre de la guerre de l'information entre la Russie et l'Ukraine. Aujourd'hui, nous constatons que des cybercriminels commencent également à utiliser les deepfakes pour promouvoir leurs propres escroqueries et attaques de phishing. Ces derniers mois, des journalistes ont observé des escroqueries se faisant passer pour des personnalités comme Elon Musk (voir figure 21), Bill Gates et Warren Buffett, qui colportaient de fausses cryptomonnaies, des cadeaux publicitaires et d'autres stratagèmes d'investissement. Ces escroqueries visent à voler l'argent des victimes. (Nos précédents tweets sur ce sujet contiennent plus de détails.)  Figure 21. Capture d'écran d'une vidéo deepfake d'Elon Musk vue sur patriotsmaga2024[.]com, un site web faisant la promotion de la vente de faux « Trump Liberty Coins." Auparavant, ces attaquants auraient pu utiliser des acteurs rémunérés pour promouvoir leurs escroqueries (par exemple, en créant des vidéos se faisant passer pour un client ayant profité d'un faux système d'investissement). Avec la popularité et l'efficacité croissantes des outils qui utilisent l'IA pour générer du contenu (par exemple, des images, de l'audio et de la vidéo), les attaquants sont désormais en mesure de créer ces vidéos de manière moins coûteuse et plus convaincante. ### Deepfakes en tant que service Nos chercheurs ont rencontré des cybercriminels vendant, discutant et échangeant des outils et des services de création de deepfakes sur des forums, des canaux de discussion sur les réseaux sociaux et des plateformes de messagerie instantanée. Ces outils et services offrent des capacités pour générer du contenu trompeur et malveillant, notamment de l'audio, de la vidéo et des images. L'écosystème de création et d'outils de deepfake est dynamique et les cybercriminels proposent une variété d'options, allant des outils de substitution de visage aux vidéos deepfake. Les outils de substitution de visage comme Swapface (illustré à la figure 22) sont proposés à des prix allant de la version gratuite à plus de 249 $ par mois. Les pirates exploitent ces outils et publient les vidéos qu'ils créent sur diverses plateformes et réseaux sociaux. Swapface propose des filtres conviviaux et une fonctionnalité de substitution de visage en temps réel, permettant aux utilisateurs de modifier ou de remplacer des visages dans les vidéos.

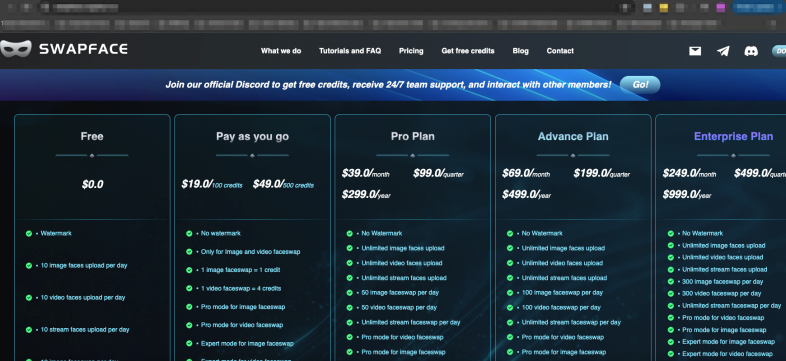

Figure 21. Capture d'écran d'une vidéo deepfake d'Elon Musk vue sur patriotsmaga2024[.]com, un site web faisant la promotion de la vente de faux « Trump Liberty Coins." Auparavant, ces attaquants auraient pu utiliser des acteurs rémunérés pour promouvoir leurs escroqueries (par exemple, en créant des vidéos se faisant passer pour un client ayant profité d'un faux système d'investissement). Avec la popularité et l'efficacité croissantes des outils qui utilisent l'IA pour générer du contenu (par exemple, des images, de l'audio et de la vidéo), les attaquants sont désormais en mesure de créer ces vidéos de manière moins coûteuse et plus convaincante. ### Deepfakes en tant que service Nos chercheurs ont rencontré des cybercriminels vendant, discutant et échangeant des outils et des services de création de deepfakes sur des forums, des canaux de discussion sur les réseaux sociaux et des plateformes de messagerie instantanée. Ces outils et services offrent des capacités pour générer du contenu trompeur et malveillant, notamment de l'audio, de la vidéo et des images. L'écosystème de création et d'outils de deepfake est dynamique et les cybercriminels proposent une variété d'options, allant des outils de substitution de visage aux vidéos deepfake. Les outils de substitution de visage comme Swapface (illustré à la figure 22) sont proposés à des prix allant de la version gratuite à plus de 249 $ par mois. Les pirates exploitent ces outils et publient les vidéos qu'ils créent sur diverses plateformes et réseaux sociaux. Swapface propose des filtres conviviaux et une fonctionnalité de substitution de visage en temps réel, permettant aux utilisateurs de modifier ou de remplacer des visages dans les vidéos.  Figure 22. Coût de l'abonnement aux outils Swapface. L'application criminelle des outils et services de création de deepfakes comprend les activités suivantes : - Faciliter la création de fausses identités - Commettre une fraude bancaire - Orchestrer des campagnes de désinformation - Contourner les contrôles de vérification de la connaissance du client - Effectuer un vol de cryptomonnaie Ces services peuvent manipuler les éléments visuels et audio avec une précision alarmante, ce qui entraîne d'importantes préoccupations éthiques et de sécurité. Le coût de création d'une vidéo deepfake peut varier considérablement, allant généralement de 60 à 500 dollars, selon la complexité et la qualité de la falsification demandée. Comme le montre la figure 23, nous avons également découvert des canaux de plateformes de messagerie faisant spécifiquement la promotion de la création de vidéos deepfakes à des fins frauduleuses.

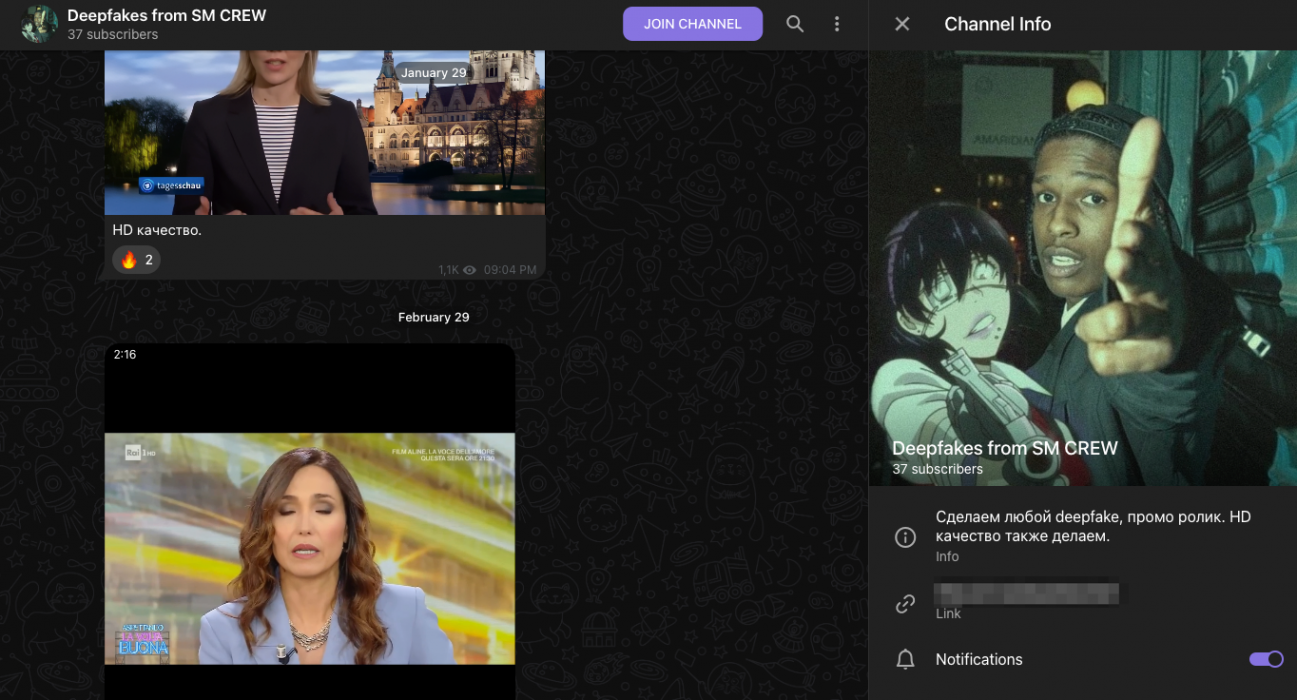

Figure 22. Coût de l'abonnement aux outils Swapface. L'application criminelle des outils et services de création de deepfakes comprend les activités suivantes : - Faciliter la création de fausses identités - Commettre une fraude bancaire - Orchestrer des campagnes de désinformation - Contourner les contrôles de vérification de la connaissance du client - Effectuer un vol de cryptomonnaie Ces services peuvent manipuler les éléments visuels et audio avec une précision alarmante, ce qui entraîne d'importantes préoccupations éthiques et de sécurité. Le coût de création d'une vidéo deepfake peut varier considérablement, allant généralement de 60 à 500 dollars, selon la complexité et la qualité de la falsification demandée. Comme le montre la figure 23, nous avons également découvert des canaux de plateformes de messagerie faisant spécifiquement la promotion de la création de vidéos deepfakes à des fins frauduleuses.  Figure 23. Canal de plateforme de messagerie dédié aux services de création de deepfakes. L'accessibilité et la diversité des coûts font des deepfakes des outils particulièrement polyvalents pour la malveillance, ce qui pose des défis aux particuliers comme aux institutions qui tentent de se protéger contre la fraude et la désinformation. Conclusion ---------- Malgré l'utilisation de GenAI dans ces campagnes, les techniques d'investigation traditionnelles restent utiles pour identifier l'infrastructure d'hébergement exploitée par ces acteurs malveillants. Face à l'augmentation du recours aux deepfakes par ces acteurs malveillants, les organisations doivent également se défendre proactivement contre ce type d'attaques. Les chercheurs de Palo Alto Networks continueront de surveiller ces campagnes d'escroquerie et d'en découvrir et d'enquêter sur d'autres. Ainsi, nous pouvons garantir une meilleure protection de nos clients grâce au Filtrage d'URL avancé. Indicateurs de compromission ------------------------ ### Exemples d'arnaques Deepfake

Figure 23. Canal de plateforme de messagerie dédié aux services de création de deepfakes. L'accessibilité et la diversité des coûts font des deepfakes des outils particulièrement polyvalents pour la malveillance, ce qui pose des défis aux particuliers comme aux institutions qui tentent de se protéger contre la fraude et la désinformation. Conclusion ---------- Malgré l'utilisation de GenAI dans ces campagnes, les techniques d'investigation traditionnelles restent utiles pour identifier l'infrastructure d'hébergement exploitée par ces acteurs malveillants. Face à l'augmentation du recours aux deepfakes par ces acteurs malveillants, les organisations doivent également se défendre proactivement contre ce type d'attaques. Les chercheurs de Palo Alto Networks continueront de surveiller ces campagnes d'escroquerie et d'en découvrir et d'enquêter sur d'autres. Ainsi, nous pouvons garantir une meilleure protection de nos clients grâce au Filtrage d'URL avancé. Indicateurs de compromission ------------------------ ### Exemples d'arnaques Deepfake  Figure 24. Capture d'écran d'une vidéo d'arnaque contenant un deepfake de Kevin O'Leary. Exemple 1 - URL de la page Web : xtradgpt[.]online - URL de la vidéo : hxxps://quontic[.]site/wp-content/uploads/2024/07/449030935_482215324194392_281914555774571171_n[.]mp4 - Langue : anglais - Pays ciblé : Canada - Deepfake de : Kevin O'Leary (homme d'affaires canadien) - Résumé : Promotion d'un robot de trading IA qui permet aux citoyens canadiens de gagner au moins 27 000 dollars canadiens par mois ! [ Deepfake de Tharman Shanmugaratnam sur une tenue professionnelle présente, avec une superposition de texte indiquant « La possibilité de gagner à partir de 8 000 $ » dans un studio paramètre. Figure 25. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Tharman Shanmugaratnam (Premier ministre de Singapour). Exemple 2 - URL de la page Web : euphemiouslystner[.]life - URL de la vidéo : hxxps://hemicdn[.]com/1501-1400-3505[.]mp4 - Langue : anglais - Pays ciblé : Singapour - Deepfake de : Tharman Shanmugaratnam (Premier ministre de Singapour) - Résumé : Promotion d'un faux système d'investissement nommé Quantum AI

Figure 24. Capture d'écran d'une vidéo d'arnaque contenant un deepfake de Kevin O'Leary. Exemple 1 - URL de la page Web : xtradgpt[.]online - URL de la vidéo : hxxps://quontic[.]site/wp-content/uploads/2024/07/449030935_482215324194392_281914555774571171_n[.]mp4 - Langue : anglais - Pays ciblé : Canada - Deepfake de : Kevin O'Leary (homme d'affaires canadien) - Résumé : Promotion d'un robot de trading IA qui permet aux citoyens canadiens de gagner au moins 27 000 dollars canadiens par mois ! [ Deepfake de Tharman Shanmugaratnam sur une tenue professionnelle présente, avec une superposition de texte indiquant « La possibilité de gagner à partir de 8 000 $ » dans un studio paramètre. Figure 25. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Tharman Shanmugaratnam (Premier ministre de Singapour). Exemple 2 - URL de la page Web : euphemiouslystner[.]life - URL de la vidéo : hxxps://hemicdn[.]com/1501-1400-3505[.]mp4 - Langue : anglais - Pays ciblé : Singapour - Deepfake de : Tharman Shanmugaratnam (Premier ministre de Singapour) - Résumé : Promotion d'un faux système d'investissement nommé Quantum AI  Figure 26. Capture d'écran d'une vidéo frauduleuse contenant une vidéo deepfake de Patrick Pouyanné (PDG de TotalEnergies). Exemple 3 - URL de la page Web : invest-toolavenue[.]shop - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/TotalEnergies_news_FR[.]mp4 - Langue : français - Pays ciblé : France - Deepfake de : Patrick Pouyanné (PDG de TotalEnergies) - Résumé : Promotion d'une fausse plateforme d'investissement sponsorisée par TotalEnergies et garantie par la Banque de France

Figure 26. Capture d'écran d'une vidéo frauduleuse contenant une vidéo deepfake de Patrick Pouyanné (PDG de TotalEnergies). Exemple 3 - URL de la page Web : invest-toolavenue[.]shop - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/TotalEnergies_news_FR[.]mp4 - Langue : français - Pays ciblé : France - Deepfake de : Patrick Pouyanné (PDG de TotalEnergies) - Résumé : Promotion d'une fausse plateforme d'investissement sponsorisée par TotalEnergies et garantie par la Banque de France  Figure 27. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake d'Andrés Manuel López Obrador (président du Mexique). Exemple 4 - URL de la page Web : capitalflow-skillful[.]shop - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/MexicanPartnership_man_MX[.]mp4 - Langue : espagnol - Pays ciblé : Mexique - Deepfake de : Andrés Manuel López Obrador (président du Mexique) - Résumé : Promotion d'un faux « projet de société d'investissement mexicaine »

Figure 27. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake d'Andrés Manuel López Obrador (président du Mexique). Exemple 4 - URL de la page Web : capitalflow-skillful[.]shop - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/MexicanPartnership_man_MX[.]mp4 - Langue : espagnol - Pays ciblé : Mexique - Deepfake de : Andrés Manuel López Obrador (président du Mexique) - Résumé : Promotion d'un faux « projet de société d'investissement mexicaine »  Figure 28. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Giorgia Meloni (Premier ministre de l'Italie). Exemple 5 - URL de la page Web : untamedal[.]top - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/FinInvest_woman-performing_IT[.]mp4 - Langue : italien - Pays ciblé : Italie - Deepfake de : Giorgia Meloni (Premier ministre d'Italie) - Résumé : Promotion d'un faux programme d'investissement parrainé par l'État appelé FinInvest

Figure 28. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Giorgia Meloni (Premier ministre de l'Italie). Exemple 5 - URL de la page Web : untamedal[.]top - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/FinInvest_woman-performing_IT[.]mp4 - Langue : italien - Pays ciblé : Italie - Deepfake de : Giorgia Meloni (Premier ministre d'Italie) - Résumé : Promotion d'un faux programme d'investissement parrainé par l'État appelé FinInvest  Figure 29. Capture d'écran d'une vidéo frauduleuse contenant un deepfake d'Andrej Babis (homme politique et homme d'affaires tchèque). Exemple 6 - URL de la page web : hxxps://hybridpowerit[.]com/ - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/ImmediateMatrix-PNewsQZ-Invest[.]mp4 - Langue : tchèque - Pays ciblé : Tchéquie - Deepfake de : Andrej Babis (homme politique et homme d’affaires tchèque) - Résumé : Promotion d’une fausse plateforme d’investissement destinée aux citoyens tchèques ! Vidéo deepfake d’Alisher Usmanov présentant en costume, debout sur un fond uni. Le sous-titre suggère une discussion sur l’argent avec une mention de 10 000 lires. Figure 30. Capture d’écran d’une vidéo frauduleuse contenant un deepfake d’Omer Koc (homme d’affaires turc). Exemple 7 - URL de la page Web : rondeliercore[.]com - URL de la vidéo : hxxps://hemicdn[.]com/video_5848484848485[.]mp4 - Langue : turc - Pays ciblé : Turquie - Deepfake de : Omer Koc (homme d'affaires turc) - Résumé : Présentation d'un bot de trading alimenté par l'IA qui permet aux utilisateurs de gagner un revenu stable de 10 000 livres turques

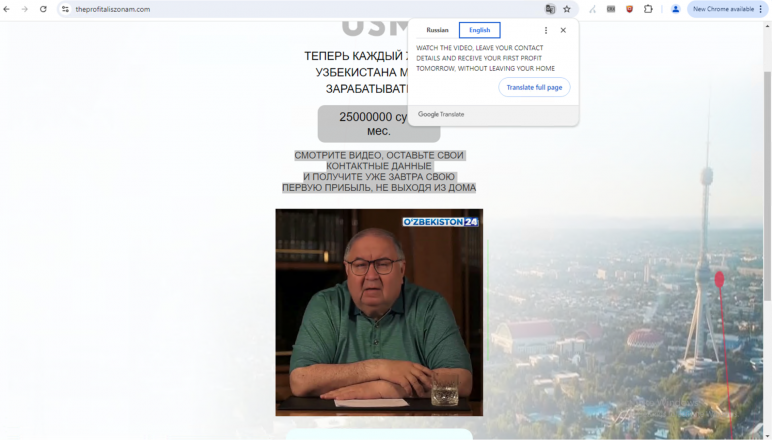

Figure 29. Capture d'écran d'une vidéo frauduleuse contenant un deepfake d'Andrej Babis (homme politique et homme d'affaires tchèque). Exemple 6 - URL de la page web : hxxps://hybridpowerit[.]com/ - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/ImmediateMatrix-PNewsQZ-Invest[.]mp4 - Langue : tchèque - Pays ciblé : Tchéquie - Deepfake de : Andrej Babis (homme politique et homme d’affaires tchèque) - Résumé : Promotion d’une fausse plateforme d’investissement destinée aux citoyens tchèques ! Vidéo deepfake d’Alisher Usmanov présentant en costume, debout sur un fond uni. Le sous-titre suggère une discussion sur l’argent avec une mention de 10 000 lires. Figure 30. Capture d’écran d’une vidéo frauduleuse contenant un deepfake d’Omer Koc (homme d’affaires turc). Exemple 7 - URL de la page Web : rondeliercore[.]com - URL de la vidéo : hxxps://hemicdn[.]com/video_5848484848485[.]mp4 - Langue : turc - Pays ciblé : Turquie - Deepfake de : Omer Koc (homme d'affaires turc) - Résumé : Présentation d'un bot de trading alimenté par l'IA qui permet aux utilisateurs de gagner un revenu stable de 10 000 livres turques  Figure 31. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake d'Alisher Usmanov (homme d'affaires ouzbek et russe). Exemple 8 - URL de la page Web : hxxps://naatuureeffocus[.]com/ - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/USM_novosti-usmanov_UZ[.]mp4 - Langue : russe - Pays ciblé : Ouzbékistan - Deepfake de : Alisher Usmanov (homme d'affaires ouzbek et russe) - Résumé : Présentation d'une nouvelle plateforme d'investissement pour les citoyens d'Ouzbékistan #### Mise à jour du 19 septembre 2024

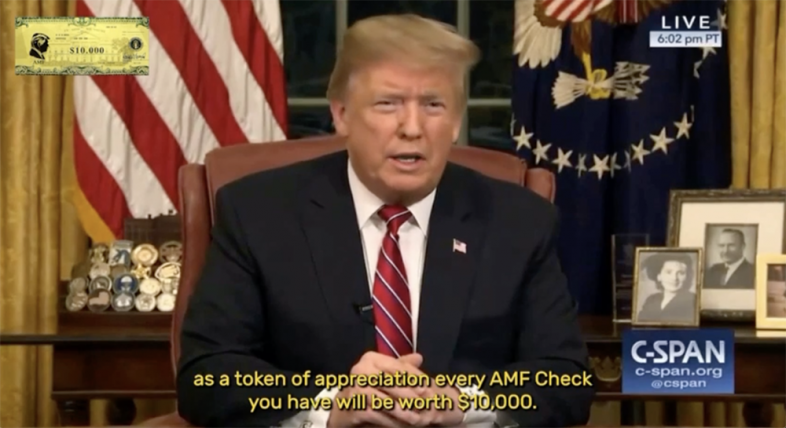

Figure 31. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake d'Alisher Usmanov (homme d'affaires ouzbek et russe). Exemple 8 - URL de la page Web : hxxps://naatuureeffocus[.]com/ - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/USM_novosti-usmanov_UZ[.]mp4 - Langue : russe - Pays ciblé : Ouzbékistan - Deepfake de : Alisher Usmanov (homme d'affaires ouzbek et russe) - Résumé : Présentation d'une nouvelle plateforme d'investissement pour les citoyens d'Ouzbékistan #### Mise à jour du 19 septembre 2024  Figure 32. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Donald Trump. Exemple 9 - URL de la page Web : mtgaeth[.]vip - URL de la vidéo : hxxp://mtgaeth[.]vip/video/videos-2[.]mp4 - Langue : anglais - Pays ciblé : États-Unis - Deepfake de : Donald Trump (45e président des États-Unis) - Résumé : Vente de faux chèques du « Fonds monétaire américain » (AMF), que les Américains peuvent encaisser pour 10 000 $ après l'élection présidentielle américaine de 2024

Figure 32. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Donald Trump. Exemple 9 - URL de la page Web : mtgaeth[.]vip - URL de la vidéo : hxxp://mtgaeth[.]vip/video/videos-2[.]mp4 - Langue : anglais - Pays ciblé : États-Unis - Deepfake de : Donald Trump (45e président des États-Unis) - Résumé : Vente de faux chèques du « Fonds monétaire américain » (AMF), que les Américains peuvent encaisser pour 10 000 $ après l'élection présidentielle américaine de 2024  Figure 33. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Matthew Amroliwala (présentateur de la BBC). Exemple 10 - URL de la page Web : bitvidex360[.]trade - URL de la vidéo : hxxps://bitvidex360[.]trade/wp-content/uploads/2023/08/Bitvidex360-Trade[.]mp4 - Langue : anglais - Pays ciblé : Royaume-Uni - Deepfake de : Matthew Amroliwala (présentateur de la BBC) - Résumé : Annonce d'un faux projet d'investissement d'Elon Musk qui permet aux résidents britanniques de gagner un revenu de 5 700 livres par jour ! [Page Web d'hameçonnage imitant le site du gouvernement fédéral du Brésil présentant une vidéo deepfake de Luiz Inácio Lula da Silva, affichée à côté de l'emblème national. La page Web comprend une notification concernant le calcul de l'indemnisation, une barre de progression de la vidéo indiquant 1:26 sur 1:46 minutes visionnées et un bouton bleu intitulé « Je souhaite recevoir mon indemnisation. » Certaines informations ont été expurgées. Figure 34. Capture d'écran d'une page Web de phishing contenant une vidéo deepfake de Luiz Inácio Lula da Silva (président du Brésil). Exemple 11 - URL de la page Web : consultar-resgate[.]com/ll/etapa2 - URL de la vidéo : hxxp://consultar-resgate[.]com/videos/vsl[.]mp4 - Langue : portugais - Pays ciblé : Brésil - Deepfake de : Luiz Inácio Lula da Silva (président du Brésil) - Résumé : Annonce d'un programme gouvernemental appelé Indeniza Brasil qui versera une compensation aux citoyens brésiliens dont les données personnelles ont été divulguées en raison d'une défaillance du système de base de données gouvernemental

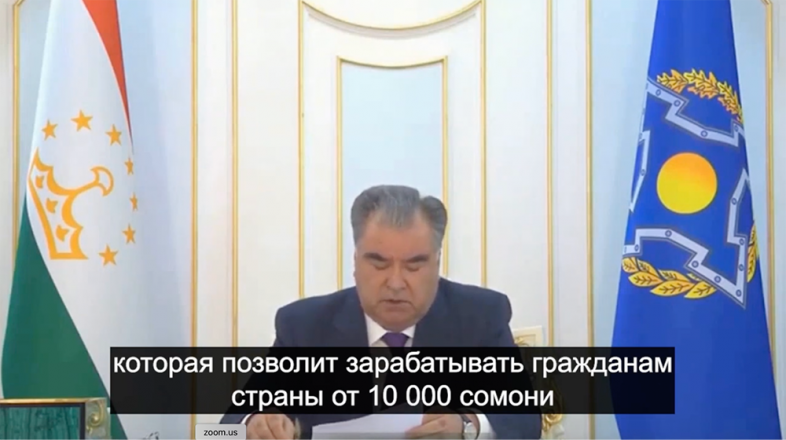

Figure 33. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Matthew Amroliwala (présentateur de la BBC). Exemple 10 - URL de la page Web : bitvidex360[.]trade - URL de la vidéo : hxxps://bitvidex360[.]trade/wp-content/uploads/2023/08/Bitvidex360-Trade[.]mp4 - Langue : anglais - Pays ciblé : Royaume-Uni - Deepfake de : Matthew Amroliwala (présentateur de la BBC) - Résumé : Annonce d'un faux projet d'investissement d'Elon Musk qui permet aux résidents britanniques de gagner un revenu de 5 700 livres par jour ! [Page Web d'hameçonnage imitant le site du gouvernement fédéral du Brésil présentant une vidéo deepfake de Luiz Inácio Lula da Silva, affichée à côté de l'emblème national. La page Web comprend une notification concernant le calcul de l'indemnisation, une barre de progression de la vidéo indiquant 1:26 sur 1:46 minutes visionnées et un bouton bleu intitulé « Je souhaite recevoir mon indemnisation. » Certaines informations ont été expurgées. Figure 34. Capture d'écran d'une page Web de phishing contenant une vidéo deepfake de Luiz Inácio Lula da Silva (président du Brésil). Exemple 11 - URL de la page Web : consultar-resgate[.]com/ll/etapa2 - URL de la vidéo : hxxp://consultar-resgate[.]com/videos/vsl[.]mp4 - Langue : portugais - Pays ciblé : Brésil - Deepfake de : Luiz Inácio Lula da Silva (président du Brésil) - Résumé : Annonce d'un programme gouvernemental appelé Indeniza Brasil qui versera une compensation aux citoyens brésiliens dont les données personnelles ont été divulguées en raison d'une défaillance du système de base de données gouvernemental  Figure 35. Capture d'écran d'une vidéo frauduleuse contenant un deepfake d'Emomali Rahmon (président du Tadjikistan). Exemple 12 - URL de la page Web : crisiswatch[.]online - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/GP_prez-tajikistan_RU[.]mp4 - Langue : russe - Pays ciblé : Tadjikistan - Deepfake de : Emomali Rahmon (président du Tadjikistan) - Résumé : Annonce d'un faux cadeau sponsorisé par le gouvernement grâce à un partenariat avec Gazprom #### Mise à jour du 23 octobre 2024

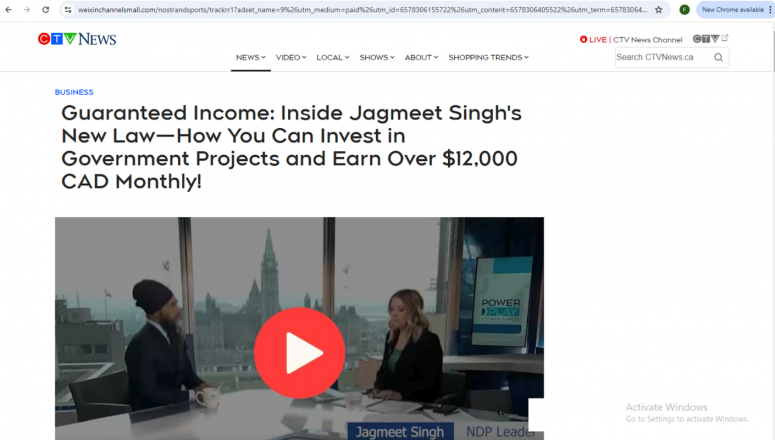

Figure 35. Capture d'écran d'une vidéo frauduleuse contenant un deepfake d'Emomali Rahmon (président du Tadjikistan). Exemple 12 - URL de la page Web : crisiswatch[.]online - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/GP_prez-tajikistan_RU[.]mp4 - Langue : russe - Pays ciblé : Tadjikistan - Deepfake de : Emomali Rahmon (président du Tadjikistan) - Résumé : Annonce d'un faux cadeau sponsorisé par le gouvernement grâce à un partenariat avec Gazprom #### Mise à jour du 23 octobre 2024  Figure 36. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake de Jagmeet Singh (homme politique canadien). - URL de la page Web : weixinchannelsmall[.]com - URL de la vidéo : hxxps://d2l7oiuw3gwvbg[.]cloudfront[.]net/video/JagmeetSingh_923_jag[.]mp4 - Langue : anglais - Pays ciblé : Canada - Deepfake de : Jagmeet Singh (homme politique canadien, chef du Nouveau Parti démocratique) - Résumé : Annonce d'un faux programme d'investissement parrainé par le gouvernement grâce à un partenariat avec Imperial Oil

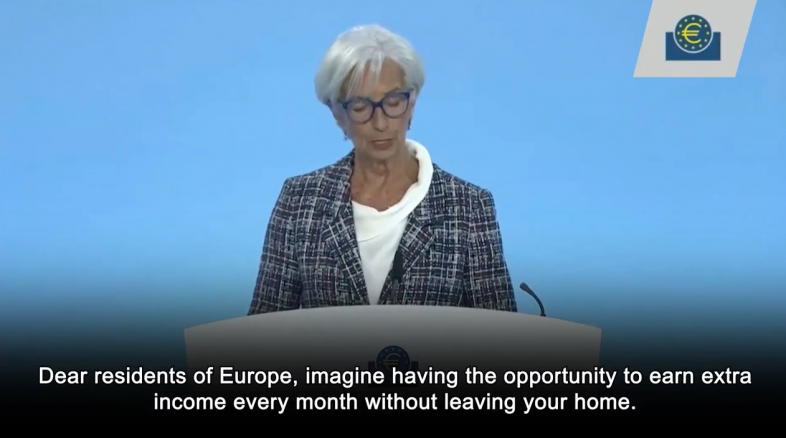

Figure 36. Capture d'écran d'une page Web frauduleuse contenant une vidéo deepfake de Jagmeet Singh (homme politique canadien). - URL de la page Web : weixinchannelsmall[.]com - URL de la vidéo : hxxps://d2l7oiuw3gwvbg[.]cloudfront[.]net/video/JagmeetSingh_923_jag[.]mp4 - Langue : anglais - Pays ciblé : Canada - Deepfake de : Jagmeet Singh (homme politique canadien, chef du Nouveau Parti démocratique) - Résumé : Annonce d'un faux programme d'investissement parrainé par le gouvernement grâce à un partenariat avec Imperial Oil  Figure 37. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Christine Lagarde (présidente de la Banque centrale européenne). - URL de la page Web : kotrotshmot[.]site - URL de la vidéo : hxxp://kotrotshmot[.]site/video/1735[.]mp4 - Langue : anglais - Région ciblée : UE - Deepfake de : Christine Lagarde (présidente de la Banque centrale européenne) - Résumé : Présentation d'un faux projet d'investissement lancé par la Banque centrale européenne et l'Eurosystème

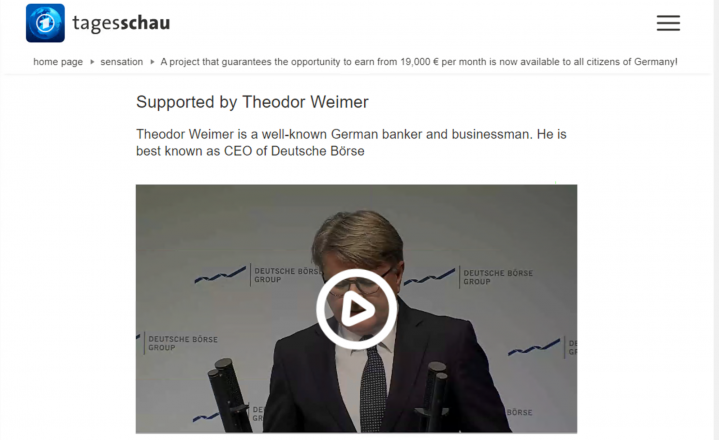

Figure 37. Capture d'écran d'une vidéo frauduleuse contenant un deepfake de Christine Lagarde (présidente de la Banque centrale européenne). - URL de la page Web : kotrotshmot[.]site - URL de la vidéo : hxxp://kotrotshmot[.]site/video/1735[.]mp4 - Langue : anglais - Région ciblée : UE - Deepfake de : Christine Lagarde (présidente de la Banque centrale européenne) - Résumé : Présentation d'un faux projet d'investissement lancé par la Banque centrale européenne et l'Eurosystème  Figure 38. Capture d'écran d'un site Web de fausses nouvelles imitant le Tagesschau (journal télévisé allemand) et utilisant un deepfake de Theodor Weimer (ancien PDG de Deutsche Börse). - URL de la page Web : new-company[.]store - URL de la vidéo : hxxps://new-company[.]store/video/1512_3[.]mp4 - Langue : allemand - Pays ciblé : Allemagne - Deepfake de : Theodor Weimer (homme d’affaires allemand, ancien PDG de Deutsche Börse) - Résumé : Promotion d’une offre à durée limitée pour tester un faux algorithme de trading d’actions créé par de grandes sociétés bancaires

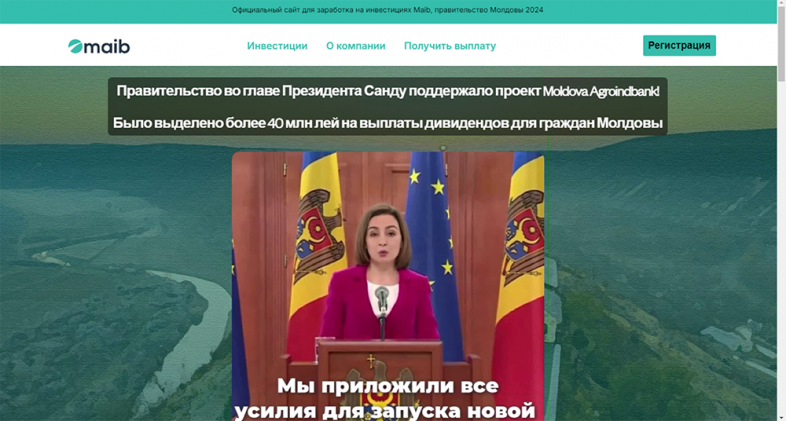

Figure 38. Capture d'écran d'un site Web de fausses nouvelles imitant le Tagesschau (journal télévisé allemand) et utilisant un deepfake de Theodor Weimer (ancien PDG de Deutsche Börse). - URL de la page Web : new-company[.]store - URL de la vidéo : hxxps://new-company[.]store/video/1512_3[.]mp4 - Langue : allemand - Pays ciblé : Allemagne - Deepfake de : Theodor Weimer (homme d’affaires allemand, ancien PDG de Deutsche Börse) - Résumé : Promotion d’une offre à durée limitée pour tester un faux algorithme de trading d’actions créé par de grandes sociétés bancaires  Figure 39. Capture d’écran d’une page Web frauduleuse contenant une vidéo deepfake de Maia Sandu (présidente de la Moldavie).- URL de la page Web : currencyspot[.]buzz - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/Maib_prezident_RU[.]mp4 - Langue : russe - Pays ciblé : Moldavie - Deepfake de : Maia Sandu (Présidente de la Moldavie) - Résumé : Promotion d'un faux projet d'investissement appelé « Maib », qui prétend fournir aux citoyens moldaves jusqu'à 30 000 lei par mois

Figure 39. Capture d’écran d’une page Web frauduleuse contenant une vidéo deepfake de Maia Sandu (présidente de la Moldavie).- URL de la page Web : currencyspot[.]buzz - URL de la vidéo : hxxps://ai-usmcollective[.]click/videos/Maib_prezident_RU[.]mp4 - Langue : russe - Pays ciblé : Moldavie - Deepfake de : Maia Sandu (Présidente de la Moldavie) - Résumé : Promotion d'un faux projet d'investissement appelé « Maib », qui prétend fournir aux citoyens moldaves jusqu'à 30 000 lei par mois