Incidents associés

Jeremiah Fowler, chercheur en cybersécurité, a découvert et signalé à vpnMentor une base de données non protégée par mot de passe contenant près de 100 000 enregistrements appartenant à GenNomis, une société d'IA basée en Corée du Sud qui propose des fonctionnalités d'échange de visages et de « Nudify » pour adultes, ainsi qu'une place de marché où les images peuvent être achetées et vendues.

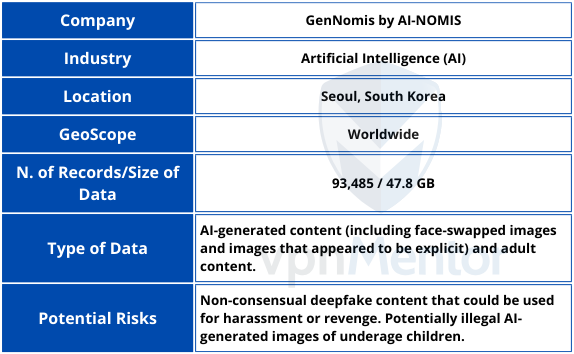

La base de données exposée publiquement n'était ni protégée par mot de passe ni chiffrée. Elle contenait 93 485 images et fichiers .JSON, pour une taille totale de 47,8 Go. Le nom de la base de données et de ses fichiers internes indiquait qu'ils appartenaient à l'entreprise sud-cor�éenne d'IA GenNomis, créée par AI-NOMIS. Parmi les enregistrements exposés, j'ai pu observer de nombreuses images pornographiques, dont des portraits de très jeunes personnes, apparemment perturbants, générés par l'IA.

La base de données comprenait également des fichiers .JSON qui enregistraient les invites de commande et les liens vers les images générées. Bien que je n'aie vu aucune donnée personnelle ni donnée utilisateur, c'était mon premier aperçu des coulisses d'un générateur d'images IA. Ce fut un signal d'alarme quant aux risques d'abus de cette technologie par les utilisateurs et à la nécessité pour les développeurs de mieux se protéger et de protéger les autres. Cette violation de données ouvre un débat plus large sur l'ensemble du secteur de la génération d'images sans restriction.

J'ai immédiatement envoyé un avis de divulgation responsable à GenNomis et AI-NOMIS, et l'accès public à la base de données a été restreint et l'accès est devenu impossible. Je n'ai reçu aucune réponse ni accusé de réception à cet avis. Bien que les enregistrements appartenaient à GenNomis par AI-NOMIS, on ignore si la base de données était détenue et gérée directement par eux ou par un prestataire tiers. On ignore également combien de temps la base de données a été exposée avant que je la découvre, ni si quelqu'un d'autre y a pu accéder. Seul un audit interne pourrait identifier d'autres accès ou activités potentiellement suspectes.

GenNomis est une plateforme de génération d'images alimentée par l'IA qui permet aux utilisateurs de transformer des descriptions textuelles en images sans restriction, de créer des personnages IA, de convertir des images en vidéos, d'échanger des visages, de supprimer des arrière-plans, et bien plus encore. D'après les fichiers que j'ai consultés dans un échantillon limité, presque toutes les images étaient explicites et représentaient du contenu pour adultes. La plateforme GenNomis prend en charge plus de 45 styles artistiques distincts, dont le réaliste, l'anime, le dessin animé, le vintage et le cyberpunk, permettant aux utilisateurs d'adapter leurs créations à leurs préférences esthétiques spécifiques. GenNomis propose également une place de marché où les utilisateurs peuvent acheter et vendre des images étiquetées comme œuvres d'art.

Cette image est un collage de captures d'écran montrant ce qui semble être de vraies personnes. Ces images ont probablement été téléchargées par des utilisateurs pour permuter le visage de ces personnes lors de la création d'images explicites de nudité ou de sexualité générées par l'IA. On ignore si ces personnes ont consenti à l'utilisation de leurs données faciales biométriques.

De nombreux générateurs d'images par IA proposent de créer des images pornographiques à partir de messages texte, et les modèles d'IA ne manquent pas d'images explicites en ligne. Tout service permettant de permuter le visage d'images ou de corps à l'aide de l'IA à l'insu et sans le consentement de la personne présente de graves risques pour la vie privée, l'éthique et la justice. Ces images explicites et sexuelles peuvent être utilisées à des fins d'extorsion, d'atteinte à la réputation et de vengeance.

Ce type de manipulation d'images est communément appelé « nudification » ou « pornographie deepfake ». Ces images peuvent être très réalistes, et il peut être humiliant pour les personnes d'être représentées de cette manière sans leur consentement. Le contenu deepfake non consensuel est devenu une préoccupation majeure à l'ère numérique des images générées par l'IA. On estime que 96 % des deepfakes en ligne sont pornographiques et que 99 % d'entre eux concernent des femmes qui n'ont pas consenti à ce que leur image soit utilisée de cette manière.

Il est à noter que le dossier « Face Swap » a disparu avant que je n'envoie l'avis de divulgation responsable et n'était plus répertorié dans la base de données. Quelques jours plus tard, les sites web de GenNomis et d'AI-NOMIS ont été mis hors ligne et la base de données a été supprimée.

Je ne dis pas que ces personnes n'ont pas donné leur consentement lors de l'utilisation de la plateforme GenNomis, ni qu'elles risquent d'être victimes d'extorsion ou de harcèlement. Je présente simplement un scénario de risque réel du paysage plus large des images explicites générées par l'IA et des risques potentiels qu'elles pourraient représenter.

Dans un monde idéal, les fournisseurs d'IA devraient mettre en place des garde-fous et des protections strictes pour prévenir les abus. Les développeurs devraient mettre en place une série de systèmes de détection qui signalent et bloquent les tentatives de création de contenu deepfake explicite --- notamment lorsqu'il s'agit d'images de mineurs ou de personnes non consentantes. Les services qui permettent aux utilisateurs de générer des images de manière semi-anonyme, sans aucune vérification d'identité ni technologie de tatouage numérique, constituent une invitation ouverte aux abus.

On a l'impression d'être dans le Far West en matière de réglementation des images et contenus générés par l'IA, et des mécanismes de détection plus solides et des exigences de vérification strictes sont essentiels. Il faudrait faciliter l'identification des auteurs et leur responsabilisation pour les contenus qu'ils créent, afin de permettre aux fournisseurs de services de supprimer rapidement les contenus préjudiciables. Mon conseil à tout fournisseur de services d'IA serait de commencer par être conscient des activités des utilisateurs, puis de limiter leurs actions face aux contenus illégaux ou douteux. Je recommande également aux fournisseurs de mettre en place un système permettant de supprimer les contenus potentiellement illicites de leurs serveurs ou de leur réseau de stockage.

Dans cette base de données, j'ai vu de nombreux fichiers montrant ce qui semblait être des images explicites d'enfants et de célébrités représentées comme des enfants, générées par l'IA, dont Ariana Grande, les Kardashian, Beyoncé, Michelle Obama, Kristen Stewart, entre autres. En tant que chercheur éthique, je ne télécharge ni ne fais de capture d'écran d'images illicites et potentiellement illégales. C'est seulement la deuxième fois en dix ans de carrière de chercheur en sécurité que je vois ce type d'images exposées publiquement dans une base de données. Dans le cas précédent, j'avais signalé mes conclusions au FBI, et le fournisseur d'hébergement cloud, ainsi que la base de données, ont finalement été restreints plusieurs mois plus tard.

La bonne nouvelle, c'est que les forces de l'ordre du monde entier prennent conscience des menaces que représentent les contenus générés par l'IA, notamment en matière de pédopornographie et d'activités criminelles. Début mars 2025, alors que j'écrivais ce rapport, la police fédérale australienne a arrêté deux hommes dans le cadre d'une opération internationale de maintien de l'ordre menée par les autorités danoises. L'opération Cumberland, baptisée « Opération Cumberland », impliquait Europol et les forces de l'ordre de 18 autres pays, ce qui a permis l'arrestation de 23 autres suspects. Tous les individus sont accusés de création et de distribution présumées de matériel pédopornographique généré par l'IA (CSAM). En octobre 2024, un tribunal sud-coréen a condamné l'auteur d'un deepfake sexuel à dix ans de prison. En mars 2025, un enseignant américain a été arrêté pour avoir utilisé l'intelligence artificielle afin de créer de fausses vidéos pornographiques de ses élèves.

Selon les directives d'utilisation de GenNomis, des restrictions s'appliquent aux contenus interdits. Les images explicites d'enfants et toute autre activité illégale sont strictement interdites sur GenNomis, du moins sur le papier. Les directives stipulent également que la publication de tels contenus entraînera la fermeture immédiate du compte et d'éventuelles poursuites judiciaires. Bien que j'aie vu de nombreuses images classées comme interdites et potentiellement illégales, on ignore si ces images étaient accessibles aux utilisateurs ou si les comptes ont été suspendus. Cependant, ces images semblent avoir été générées à l'aide de la plateforme GenNomis et stockées dans la base de données rendue publique.

Malheureusement, de nombreux cas de tentatives de sextorsion impliquant des individus et des jeunes ont été commis. Je recommande à toute personne recevant des menaces ou constatant que son image ou son portrait a été utilisé sans son consentement de contacter les forces de l'ordre et de partager tous les détails pertinents de la tentative. Il existe des moyens de faire supprimer des images en ligne et, espérons-le, d'identifier les personnes impliquées dans le harcèlement et les tentatives de sextorsion.

Aux États-Unis, la loi bipartite « Take It Down Act » vise à criminaliser la diffusion d'images intimes non consensuelles, y compris celles générées par l'IA (début 2025, le projet de loi a été adopté par le Sénat et est en attente d'examen par la Chambre des représentants). Être victime de contenus générés par l'IA de cette manière représente une atteinte grave à la vie privée, ce qui peut être humiliant. Heureusement, traduire en justice les auteurs de ce type de comportement criminel est de plus en plus courant grâce aux progrès des technologies policières.

Si vous ou l'une de vos connaissances envisagez de vous faire du mal, veuillez contacter une ligne d'assistance téléphonique ou un organisme de prévention du suicide de votre région et demander de l'aide.

Je n'implique aucun acte répréhensible de la part de GenNomis, d'AI-NOMIS, ni de leurs sous-traitants, sociétés affiliées ou entités liées. Je ne prétends pas que les données internes, clients ou utilisateurs aient jamais été exposées à un risque imminent. Les scénarios hypothétiques de risque de données que je présente dans ce rapport sont strictement et exclusivement à des fins éducatives et ne reflètent, ne suggèrent ni n'impliquent aucune compromission réelle de l'intégrité des données ni aucune activité illégale. Ce rapport ne doit pas être interprété comme une évaluation ou un commentaire des pratiques, systèmes ou mesures de sécurité spécifiques d'une organisation.

En tant que chercheur en sécurité éthique, je ne télécharge pas les données que je découvre. Je ne prends qu'un nombre limité de captures d'écran, si nécessaire, et uniquement à des fins de vérification. Je n'effectue aucune autre activité que l'identification de la vulnérabilité de sécurité et la notification des parties concernées. Je décline toute responsabilité quant aux mesures qui pourraient être prises suite à cette divulgation. Je publie mes conclusions afin de sensibiliser le public aux questions de sécurité et de confidentialité des données. Mon objectif est d'encourager les organisations à protéger proactivement les informations sensibles contre tout accès non autorisé.