Incidents associés

Microsoft dénonce Storm-2139, un réseau cybercriminel exploitant Azure AI via le LLMjacking. Découvrez comment des clés API volées ont permis la génération de contenu nuisible et l'action en justice intentée par Microsoft.

Microsoft a engagé des poursuites judiciaires contre un réseau cybercriminel, connu sous le nom de Storm-2139, responsable de l'exploitation de vulnérabilités au sein de ses services Azure AI (https://hackread.com/azure-ai-vulnerabilities-bypass-moderation-safeguards/). L'entreprise a publiquement identifié et condamné quatre individus impliqués dans cette opération illicite. Voici leurs noms :

- Arian Yadegarnia, alias « Fiz », d’Iran

- Phát Phùng Tấn, alias « Asakuri », du Vietnam

- Ricky Yuen, alias « cg-dot », de Hong Kong, Chine

- Alan Krysiak, alias « Drago », du Royaume-Uni

Selon le rapport officiel de Microsoft, partagé en exclusivité avec Hackread.com, ces individus ont utilisé divers pseudonymes en ligne pour mettre en �œuvre un stratagème appelé LLMjacking. Il s’agit d’un acte de détournement de modèles de langage volumineux (LLM) par le vol de clés d’API (interface de programmation d’applications), qui servent d’identifiants numériques pour accéder aux services d’IA. Une fois obtenues, ces clés d’API peuvent permettre aux cybercriminels de manipuler les LLM afin de générer du contenu préjudiciable.

L'activité principale de Storm-2139 consistait à exploiter les identifiants clients volés, obtenus auprès de sources publiques, pour accéder sans autorisation à des plateformes d'IA, modifier les fonctionnalités de ces services, contourner les mesures de sécurité intégrées, puis revendre l'accès à d'autres acteurs malveillants. Ils fournissaient des instructions détaillées sur la manière de générer du contenu illicite, notamment des images intimes non consensuelles et du contenu sexuellement explicite, ciblant souvent des célébrités.

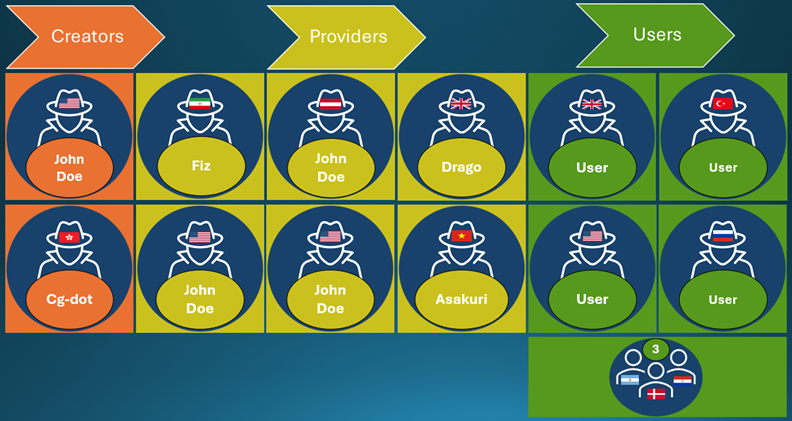

L'unité de lutte contre la criminalité numérique (DCU) de Microsoft a engagé des poursuites judiciaires en décembre 2024, ciblant initialement dix individus non identifiés. Des enquêtes ultérieures ont permis d'identifier les principaux membres de Storm-2139. Le réseau fonctionnait selon un modèle structuré : les créateurs développaient les outils malveillants, les fournisseurs les modifiaient et les distribuaient, et les utilisateurs généraient le contenu abusif.

« Storm-2139 est organisé en trois catégories principales : créateurs, fournisseurs et utilisateurs. Les créateurs ont développé des outils illicites permettant l’utilisation abusive de services générés par l’IA. Les fournisseurs ont ensuite modifié ces outils et les ont fournis aux utilisateurs finaux, souvent avec différents niveaux de service et de paiement. Enfin, les utilisateurs ont utilisé ces outils pour générer du contenu synthétique illicite », a révélé le billet de blog de Microsoft (https://blogs.microsoft.com/on-the-issues/2025/02/27/disrupting-cybercrime-abusing-gen-ai/).

Représentation visuelle de la tempête 2139 (Source : Microsoft)

Les actions en justice engagées par Microsoft, notamment la saisie d'un site web clé, ont entraîné une perturbation importante du réseau. Les membres du groupe ont réagi avec inquiétude, se livrant à des échanges en ligne, tentant d'identifier d'autres membres et allant même jusqu'à divulguer l'identité du conseiller juridique de Microsoft, soulignant ainsi l'efficacité de la stratégie de Microsoft pour démanteler l'opération criminelle.

Microsoft a adopté une stratégie juridique multidimensionnelle, engageant des poursuites civiles pour perturber le fonctionnement du réseau et poursuivant les signalements aux forces de l'ordre. Cette approche visait à la fois à stopper la menace immédiate et à dissuader toute future utilisation abusive de l'IA.

L'entreprise s'attaque également au problème de l'utilisation abusive de l'IA pour générer des contenus préjudiciables, en mettant en place des garde-fous stricts et en développant de nouvelles méthodes de protection des utilisateurs. Elle plaide également pour une modernisation du droit pénal afin de doter les forces de l'ordre des outils nécessaires pour lutter contre l'utilisation abusive de l'IA.

Les experts en sécurité ont souligné l'importance d'une protection renforcée des identifiants et d'une surveillance continue pour prévenir de telles attaques. Rom Carmel, cofondateur et PDG d'Apono, a déclaré à Hackread que les entreprises qui utilisent l'IA et les outils cloud pour leur croissance doivent limiter l'accès aux données sensibles afin de réduire les risques de sécurité.

"Lorsque les organisations adoptent des outils d'IA pour stimuler leur croissance, elles élargissent également leur surface d'attaque avec des applications contenant des données sensibles. Pour exploiter l'IA et le cloud en toute sécurité, l'accès aux systèmes sensibles doit être restreint en fonction des besoins, afin de minimiser les risques pour les acteurs malveillants."