Incidents associés

Anna McAdams a toujours gardé un œil attentif sur la vie en ligne de sa fille de 15 ans, Elliston Berry. Il était donc difficile de se faire à l'idée de ce qui s'est passé il y a 15 mois, le lundi matin après le bal de fin d'année à Aledo, au Texas.

Une camarade de classe a pris une photo de l'Instagram d'Elliston, l'a passée dans un programme d'intelligence artificielle qui semblait retirer sa robe, puis a envoyé l'image modifiée numériquement sur Snapchat.

"Elle est entrée dans notre chambre en pleurant, en disant : 'Maman, tu ne croiras pas ce qui vient de se passer'", a déclaré McAdams.

L'année dernière, il y avait plus de 21 000 vidéos pornographiques deepfake en ligne, soit une augmentation de plus de 460 % par rapport à l'année précédente. Les contenus manipulés prolifèrent sur Internet, les sites Web faisant des discours dérangeants, comme un service qui demande : « Quelqu'un peut-il se déshabiller ? »

« J'ai eu des tests PSAT et des matchs de volley-ball », a déclaré Elliston. « Et la dernière chose dont j'ai besoin, c'est de me concentrer et de m'inquiéter, ce sont de fausses photos de moi nues qui circulent dans l'école. Ces images ont circulé sur Snapchat pendant neuf mois. »

À San Francisco, la procureure adjointe en chef de la ville, Yvonne Mere, a commencé à entendre des histoires similaires à celle d'Elliston, ce qui l'a touchée.

« Cela aurait facilement pu être ma fille », a déclaré Mere.

Le bureau du procureur de la ville de San Francisco poursuit maintenant les propriétaires de 16 sites Web qui créent des « deepfake nudes », où l'intelligence artificielle est utilisée pour transformer des photos non explicites d'adultes et d'enfants en pornographie.

« Cette affaire n'a rien à voir avec la technologie. Ce n'est pas une affaire d'IA. C'est un abus sexuel », a déclaré Mere.

Ces 16 sites ont enregistré 200 millions de visites au cours des six premiers mois de l'année seulement, selon la plainte.

Le procureur de la ville David Chiu affirme que les 16 sites concernés par la plainte ne sont qu'un début.

« Nous avons connaissance d'au moins 90 de ces sites Web. Il s'agit donc d'un vaste univers et il doit être arrêté », a déclaré Chiu.

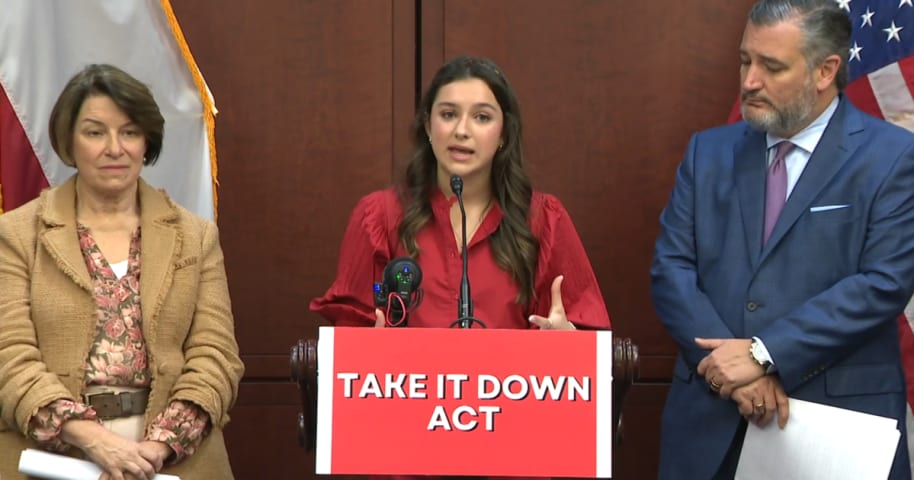

Le sénateur républicain du Texas Ted Cruz co-parraine un autre angle d'attaque avec la sénatrice démocrate du Minnesota Amy Klochubar. Le Take It Down Act obligerait les entreprises de réseaux sociaux et les sites Web à supprimer les images pornographiques non consensuelles créées avec l'IA.

"Il impose une obligation légale à toute plateforme technologique : vous devez la supprimer et la supprimer immédiatement", a déclaré Cruz.

Le projet de loi a été adopté par le Sénat ce mois-ci et est désormais rattaché à un projet de loi de financement gouvernemental plus vaste en attente d'un vote de la Chambre.

Dans un communiqué, un porte-parole de Snap a déclaré à CBS News : « Nous nous soucions profondément de la sécurité et du bien-être de notre communauté. Le partage d'images dénudées, y compris de mineurs, qu'elles soient réelles ou générées par l'IA, constitue une violation flagrante de nos directives communautaires. Nous disposons de mécanismes efficaces pour signaler ce type de contenu, c'est pourquoi nous sommes si découragés d'entendre des histoires de familles qui ont estimé que leurs préoccupations n'avaient pas été prises en compte. Nous avons une politique de tolérance zéro pour ce type de contenu et, comme indiqué dans notre dernier rapport de transparence, nous agissons rapidement pour y remédier une fois signalé. »

Elliston dit qu'elle se concentre désormais sur le présent et exhorte le Congrès à adopter le projet de loi.

« Je ne peux pas revenir en arrière et refaire ce qu'il a fait, mais au lieu de cela, je peux empêcher que cela arrive à d'autres personnes », a déclaré Elliston.