Incidents associés

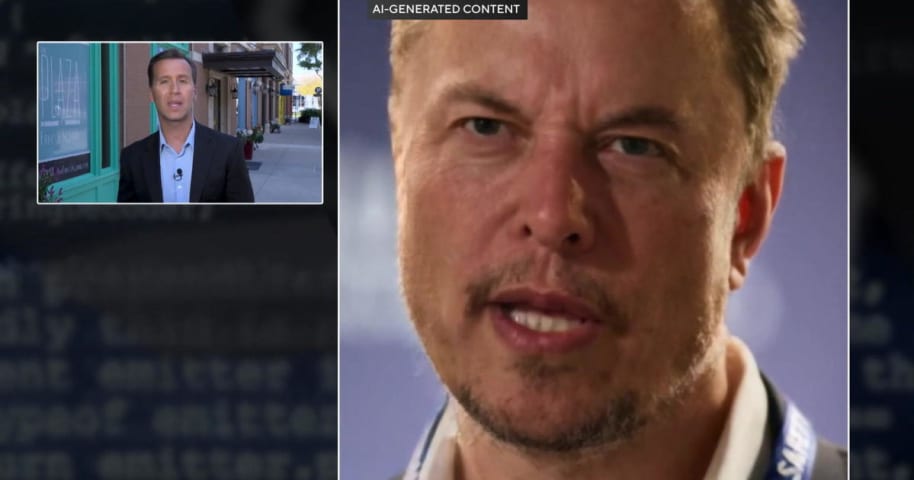

Elle a d'abord vu l'annonce sur Facebook. Puis à nouveau sur TikTok. Après avoir vu ce qui semblait être Elon Musk proposant une opportunité d'investissement à maintes reprises, Heidi Swan a compris que cela devait être vrai.

"Cela ressemblait exactement à Elon Musk, cela ressemblait exactement à Elon Musk et j'ai pensé que c'était lui", a déclaré Swan.

Elle a contacté l'entreprise à l'origine de la publicité et a ouvert un compte pour plus de 10 000 $. L'employée de santé de 62 ans pensait faire un investissement intelligent dans la cryptomonnaie auprès d'un homme d'affaires et investisseur valant des milliards de dollars.

Mais Swan allait bientôt apprendre qu'elle avait été escroquée par une nouvelle vague de voleurs de haute technologie utilisant l'intelligence artificielle pour créer des deepfakes.

Même en regardant les vidéos maintenant, sachant qu'elles sont fausses, Swan pense toujours qu'elles ont l'air convaincantes.

"Elles ressemblent toujours à Elon Musk", a-t-elle déclaré. "Elles ressemblent toujours à Elon Musk."

Les escroqueries deepfake sont en hausse aux États-Unis

À mesure que la technologie de l'intelligence artificielle évolue et devient plus accessible, ce type d'escroqueries devient de plus en plus courant.

Selon Deloitte, un groupe de recherche financière de premier plan, le contenu généré par l'IA a contribué à plus de 12 milliards de dollars de pertes dues à la fraude l'année dernière, et pourrait atteindre 40 milliards de dollars aux États-Unis d'ici 2027.

La Federal Trade Commission et le [Better Business Bureau ont émis des avertissements concernant la hausse des escroqueries deepfake.

Une étude menée par la société d'intelligence artificielle Sensity a révélé qu'Elon Musk est la célébrité la plus couramment utilisée dans les escroqueries deepfake. L'une des raisons probables est sa richesse et son esprit d'entreprise. Une autre raison est le nombre d'interviews qu'il a réalisées ; plus il y a de contenu de quelqu'un en ligne, plus il est facile de créer des deepfakes convaincants.

Anatomie d'un deepfake

À l'Université du nord du Texas à Denton, le professeur Christopher Meerdo utilise également l'intelligence artificielle. Mais il l'utilise pour créer de l'art.

"Cela ne remplacera pas les arts créatifs", a déclaré Meerdo. « Cela va simplement les augmenter et changer la façon dont nous comprenons les choses que nous pourrions faire dans le domaine de la créativité. »

Même si Meerdo considère l'intelligence artificielle comme un moyen d'innover, il en voit les dangers.

Meerdo a montré à l'équipe d'enquête de CBS News Texas comment les escrocs peuvent prendre une vraie vidéo et utiliser des outils d'IA pour remplacer la voix et les mouvements de la bouche d'une personne, lui donnant l'impression de dire quelque chose de complètement différent.

Les progrès technologiques facilitent la création de vidéos deepfake. Tout ce dont une personne familière de l'IA a besoin pour en créer une est une seule image fixe et un enregistrement vidéo.

Pour le démontrer, Meerdo a pris une vidéo du journaliste d'investigation Brian New pour créer un deepfake d'Elon Musk.

Ces vidéos générées par l'IA ne sont pas parfaites, mais elles doivent juste être suffisamment convaincantes pour tromper une victime sans méfiance.

« Si vous essayez vraiment d'arnaquer les gens, je pense que vous pouvez faire de très mauvaises choses avec cela », a déclaré Meerdo.

Comment repérer un deepfake ?

Certains deepfakes sont plus faciles à repérer que d'autres ; il peut y avoir des signes tels que des mouvements anormaux des lèvres ou un langage corporel étrange. Mais à mesure que la technologie s'améliore, il deviendra plus difficile de le savoir simplement en regardant.

De plus en plus de sites Web prétendent pouvoir détecter les deepfakes. À l'aide de trois vidéos deepfake connues et de trois vidéos authentiques, l'équipe d'enquêteurs de CBS News Texas a soumis cinq de ces sites Web à un test non scientifique : Deepware, Attestiv, DeepFake-O-Meter, Sensity et Deepfake Detector.

Au total, ces cinq outils en ligne ont correctement identifié les vidéos testées près de 75 % du temps. L'équipe d'enquêteurs a contacté les entreprises pour leur communiquer les résultats ; leurs réponses sont présentées ci-dessous.

Deepware

Deepware, un site Web gratuit, n'a pas réussi à signaler deux des fausses vidéos testées par l'équipe d'enquête. Dans un e-mail, la société a déclaré que les clips utilisés étaient trop courts et que pour obtenir les meilleurs résultats, les vidéos téléchargées devaient durer entre 30 secondes et une minute. Deepware a correctement identifié toutes les vidéos plus longues. Selon la société, son taux de détection est considéré comme bon pour le secteur, à 70 %.

La section foire aux questions du site Web de Deepware indique : « Les deepfakes ne sont pas encore un problème résolu. Nos résultats indiquent la probabilité qu'une vidéo spécifique soit un deepfake ou non. »

Deepfake Detector

Deepfake Detector, un outil qui facture 16,80 $ par mois, a identifié l'une des fausses vidéos comme ayant « une voix naturelle à 97 % ». L'entreprise, spécialisée dans la détection des voix générées par l'IA, a déclaré dans un e-mail que des facteurs tels que le bruit de fond ou la musique peuvent avoir un impact sur les résultats, mais qu'elle a un taux de précision d'environ 92 %.

En réponse à une question sur les conseils destinés aux consommateurs moyens, l'entreprise a écrit : « Notre outil est conçu pour être convivial. Les consommateurs moyens peuvent facilement télécharger un fichier audio sur notre site Web ou utiliser notre extension de navigateur pour analyser directement le contenu. L'outil fournira une analyse pour aider à déterminer si une vidéo peut contenir des éléments deepfake en utilisant des probabilités, ce qui le rend accessible même à ceux qui ne sont pas familiers avec la technologie de l'IA. »

Attestiv

Attestiv a signalé deux des vraies vidéos comme « suspectes ». Selon le PDG de l'entreprise, Nicos Vekiarides, les faux positifs peuvent être déclenchés par des facteurs tels que des graphiques et des modifications. Les deux vidéos authentiques signalées comme « suspectes » comprenaient des graphiques et des modifications. Le site propose un service gratuit, mais il propose également un niveau payant, où les consommateurs peuvent ajuster les paramètres et les étalonnages pour une analyse plus approfondie.

Bien qu'il reconnaisse qu'Attestiv n'est pas parfait, Vekiarides a déclaré que les deepfakes devenant plus difficiles à repérer à l'œil nu, ces types de sites Web sont nécessaires pour résoudre le problème.

"Notre outil peut déterminer si quelque chose est suspect, et vous pouvez ensuite le vérifier de vos propres yeux pour dire : "Je pense que c'est suspect"", a déclaré Vekiarides.

DeepFake-O-Meter

DeepFake-O-Meter est un autre outil gratuit soutenu par l'Université de Buffalo et la National Science Foundation. Il a identifié deux des vraies vidéos comme ayant un pourcentage élevé d'être générées par l'IA.

Dans un e-mail, le créateur de la plateforme ouverte a déclaré qu'une limitation des modèles de détection de deepfake est que la compression vidéo peut entraîner des problèmes de synchronisation avec la vidéo et l'audio et des mouvements de bouche incohérents.

En réponse à une question sur la façon dont les utilisateurs quotidiens peuvent utiliser l'outil, la société a envoyé un e-mail : « Actuellement, le principal résultat affiché aux utilisateurs est la valeur de probabilité que cet échantillon soit un échantillon généré à travers différents modèles de détection. Cela peut être utilisé comme référence si plusieurs modèles s'accordent sur la même réponse avec confiance (par exemple, plus de 80 % pour une vidéo générée par l'IA ou moins de 20 % pour une vidéo réelle). Nous développons actuellement une manière plus compréhensible d'afficher les résultats, ainsi que de nouveaux modèles capables de produire des résultats de détection complets. »

Sensity

Le détecteur de deepfake de Sensity a correctement identifié les six clips, affichant une carte thermique indiquant où la manipulation de l'IA est la plus probable.

La société propose une période d'essai gratuite pour utiliser son service et a déclaré à l'équipe d'ingénierie que, bien qu'il soit actuellement adapté aux organisations privées et publiques, son objectif futur est de rendre la technologie accessible à tous.