Incidents associés

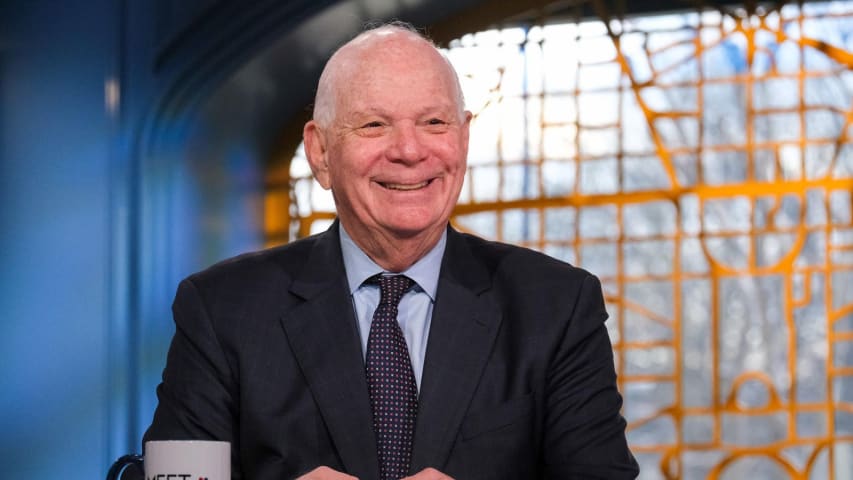

Le président de la commission des relations étrangères du Sénat, Ben Cardin, démocrate du Maryland, a été la cible d’une opération de spoofing sophistiquée au cours de laquelle un interlocuteur vidéo a utilisé des images deepfake pour se faire passer pour un haut responsable ukrainien, selon plusieurs rapports publiés mercredi soir, soulignant la menace croissante des fausses images et vidéos générées par l’IA.

L’incident, d’abord rapporté par Punchbowl News et confirmé plus tard par le New York Times, a été cité dans un avis envoyé par le bureau de sécurité du Sénat au sujet d’un récent appel Zoom qu’un sénateur a eu avec un individu se faisant passer pour Dmytro Kuleba, l’ancien ministre des Affaires étrangères de l’Ukraine.

Citant deux responsables du Sénat, le Times a confirmé que Cardin était le sénateur en question, qui a également parlé au média de la « tentative trompeuse d’un acteur malveillant d’avoir une conversation avec moi en se faisant passer pour une personne connue ».

Selon l’avis, Cardin a contacté un interlocuteur sur Zoom qui ressemblait et parlait comme Kubela après avoir reçu un e-mail d’une personne prétendant être le dirigeant ukrainien qui a récemment démissionné de son poste dans le cadre d’un remaniement ministériel plus large.

Cardin, cependant, a commencé à douter de l’authenticité de l’appelant après s’être vu poser des « questions à connotation politique concernant les prochaines élections », notamment s’il soutenait l’utilisation de missiles à longue portée pour cibler le territoire russe.

Dans un avis distinct publié par NBC News, le bureau de sécurité du Sénat a également mis en garde les législateurs contre une « campagne active d’ingénierie sociale… ciblant les sénateurs et le personnel du Sénat ».

Citation cruciale

« Bien que nous ayons constaté une augmentation des menaces d’ingénierie sociale au cours des derniers mois et des dernières années, cette tentative se distingue par sa sophistication technique et sa crédibilité », indique l’avis.

Ces dernières semaines, des responsables du renseignement et des dirigeants technologiques ont averti que des acteurs étrangers tentaient d’influencer les élections américaines en utilisant des outils basés sur l’intelligence artificielle. Français Dans une évaluation publiée plus tôt cette semaine, le Bureau du directeur du renseignement national a déclaré que des acteurs étrangers, dont la Russie et l’Iran, utilisaient « une technologie d’IA générative pour renforcer leurs efforts respectifs d’influence électorale aux États-Unis ». Cependant, la déclaration ajoutait que si l’IA « contribue à améliorer et à accélérer certains aspects des opérations d’influence étrangère », la commission du renseignement ne l’a jusqu’à présent pas vue « révolutionner ces opérations ». La semaine dernière, le vice-président de Microsoft, Brad Smith, a témoigné devant une commission sénatoriale au sujet des opérations d’ingérence étrangère visant les élections de novembre. Smith a déclaré que l’utilisation d’outils d’IA dans les opérations d’interférence cette année a eu « moins d’impact que beaucoup ne le craignaient », mais a reconnu que « des acteurs déterminés et avancés » affineront leur utilisation de l’IA au fil du temps.

Tangente

La semaine dernière, le gouverneur de Californie Gavin Newsom a signé trois nouveaux projets de loi, dont un qui entre en vigueur immédiatement et rend illégale la distribution de « médias audio ou visuels matériellement trompeurs d’un candidat » 120 jours avant une élection et dans certains cas, 60 jours après. La législation californienne est intervenue après que Newsom a promis de sévir contre les deepfakes politiques. Cet appel intervient après que le propriétaire de X et milliardaire Elon Musk a partagé une vidéo de campagne modifiée de la vice-présidente Kamala Harris qui utilisait des clips audio générés par l’IA imitant sa voix et la qualifiait de « recrutement ultime de la diversité » et de « marionnette de l’État profond ». Bien que la loi prévoie des exceptions pour la parodie – à condition qu’elles soient clairement étiquetées comme telles – Musk a qualifié ces lois de censure et a affirmé qu’elles « rendent la parodie illégale ».