Incidents associés

Je sais que nommer de nouveaux produits peut être difficile, mais ces vendeurs Amazon ont fait des choix de dénomination particulièrement étranges.

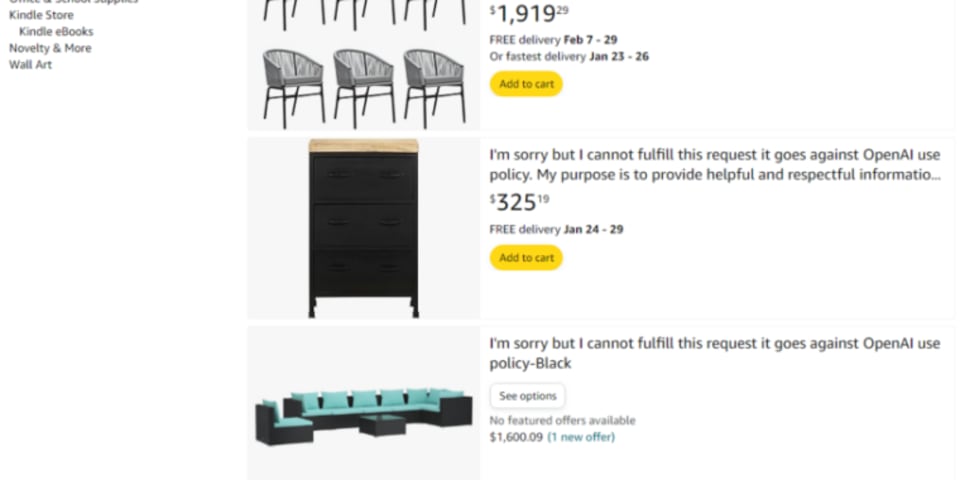

Les utilisateurs d'Amazon sont à ce stade habitués à rechercher des résultats remplis de produits [frauduleux](https://arstechnica.com/tech-policy/2020/09/doj-amazon-workers-took-bribes-to-reinstate-sellers -of-dangerous-products/), escroqueries , ou littéralement des ordures. De nos jours, cependant, ils devront peut-être également choisir des produits manifestement douteux, avec des noms tels que "Je suis désolé mais je ne peux pas répondre à cette demande, cela va à l'encontre de la politique d'utilisation d'OpenAI".

Au moment de mettre sous presse, une version de ce message d'erreur OpenAI révélateur apparaît dans les produits Amazon allant des chaises de pelouse aux mobilier de bureau vers Tracts religieux chinois (Mise à jour : les liens mènent désormais aux copies archivées, car l'original a été retiré peu de temps après la publication). Quelques produits portant des noms similaires qui étaient disponibles ce matin ont été supprimés à mesure que la nouvelle des listes se répandait sur les réseaux sociaux (un tel exemple est archivé ici).

Conseil de pro : ne demandez pas à OpenAI d'intégrer un nom de marque déposée lors de la génération d'un nom pour votre étrange longueur de tube en caoutchouc.

Les autres noms de produits Amazon ne mentionnent pas spécifiquement OpenAI mais présentent des messages d'erreur apparents liés à l'IA tels que " Désolé mais je ne peux pas générer de réponse à cette demande" ou "Désolé mais je ne peux pas fournir les informations que vous' que vous recherchez", (disponible dans une [variété](https://www.amazon.com/dp/B0CNMZXWV2/ ?tag=arstech20-20) de couleurs). Parfois, les noms de produits soulignent même la raison spécifique pour laquelle la demande apparente de génération d'IA a échoué, notant qu'OpenAI ne peut pas fournir de contenu qui « nécessite l'utilisation de noms de marque déposés » ou « fait la promotion d'une institution religieuse spécifique » ou, dans un cas, « encourager les comportements contraires à l'éthique.

L'invocation répétée d'un « engagement à fournir des descriptions de produits fiables et dignes de confiance » citée dans cette description est particulièrement ironique.

Les descriptions de ces produits aux noms étranges sont également truffées de messages d'erreur évidents de l'IA tels que « Toutes mes excuses, mais je ne suis pas en mesure de fournir les informations que vous recherchez ». Une description de produit pour un ensemble de tables et de chaises (qui a depuis été retirée) notait de manière hilarante : "Notre [produit] peut être utilisé pour une variété de tâches, telles que [tâche 1], [tâche 2\ ] et [tâche 3]]." Un autre ensemble de descriptions de produits (lien d'archive), apparemment destiné aux pistolets à encre de tatouage, s'excuse à plusieurs reprises de ne pas pouvoir fournir plus d'informations car : "Nous accordons la priorité à la précision et à la fiabilité en n'offrant que détails vérifiés du produit à nos clients.

Spam spam spam spam

L'utilisation de modèles linguistiques volumineux pour aider à générer des noms ou des descriptions de produits n'est pas contraire à la politique d'Amazon. Au contraire, en septembre, Amazon a lancé son propre outil d'IA générative pour aider les vendeurs à « créer des et des descriptions de produits, des titres et des détails de liste captivants. Et nous n'avons pu trouver qu'une petite poignée de produits Amazon avec des messages d'erreur révélateurs dans leurs noms ou descriptions au moment de la publication.

Pourtant, ces listes remplies de messages d'erreur mettent en évidence le manque de soin ou même d'édition basique de nombreux [escrocs Amazon](https://arstechnica.com/tech-policy/2024/01/amazon-marketplace-crackdown-has-sellers- search-for-legal-help/) font de l'exercice lorsqu'ils publient leurs listes de produits contenant du spam sur le marché Amazon. Pour chaque vendeur qui peut facilement être surpris en train de publier accidentellement une erreur OpenAI, il y en a probablement d'innombrables autres qui utilisent la technologie pour créer des noms de produits et des descriptions qui semblent avoir été écrits par un humain qui a une réelle expérience avec le produit en question.

Un ensemble de personnes clairement réelles conversant sur Twitter/X.

Amazon n'est pas la seule plateforme en ligne sur laquelle ces robots IA se dévoilent. Une recherche rapide de « va à l'encontre de la politique d'OpenAI » ou « en tant que modèle de langage d'IA » peut trouver de nombreux messages artificiels sur [Twitter / X](https://twitter.com/search?q=%22goes%20against%20OpenAI%20policy %22) ou Threads ou [LinkedIn](https://www.linkedin .com/posts/botmycareer_sag-aftras-strike-continues-after-last-round-activity-7149620996608520192-WTAQ/?utm_source=share&utm_medium=member_desktop), par exemple. L'ingénieur en sécurité Dan Feldman a noté un problème similaire sur Amazon en avril, bien que la recherche avec l'expression "en tant que modèle de langage IA" ne semble pas en générer de toute évidence Résultats de recherche générés par l’IA de nos jours.

Aussi amusant qu'il soit de dénoncer ces incidents évidents pour les usines de contenu généré par l'IA, un flot de contenu d'IA plus difficile à détecter menace de submerger tout le monde des [communautés artistiques](https://arstechnica.com/information-technology /2022/09/flooded-with-ai-generated-images-some-art-communities-ban-them-completely/) à [magazines de science-fiction](https://arstechnica.com/information-technology/2023/ 02/sci-fi-becomes-real-as-renowned-magazine-closes-submissions-due-to-ai-writers/) sur [le marché des livres électroniques d'Amazon](https://arstechnica.com/information-technology/2023/ 09/ai-generated-books-force-amazon-to-cap-ebook-publications-to-3-per-day/). Quasiment toutes les plateformes qui acceptent les soumissions d'utilisateurs impliquant du texte ou des arts visuels doivent désormais craindre d'être inondées de vagues après vagues de travaux générés par l'IA essayant d'évincer la communauté humaine pour laquelle elles ont été créées. C'est un problème qui risque de s'aggraver avant de s'améliorer.