Problème 3232

En novembre 2022, les chefs militaires de la région du Tigré, dans le nord de l’Éthiopie, ont convenu d’un cessez-le-feu fragile, mettant ainsi fin techniquement à deux années d’une guerre civile brutale. Mais malgré la trêve, les campagnes de nettoyage ethnique contre les communautés minoritaires tigréennes se poursuivent. Depuis le début de la guerre, Facebook a été régulièrement accusé de [ne pas avoir modéré les discours de haine](https://www.amnesty.org/en/latest/news/2022/12/kenya-meta-sued-for-1 -6 milliards-usd-pour-alimenter-la-violence-ethnique-éthiopienne/) ciblant les Tigréens.

Plus récemment, Meta fait face à un procès de la part du fils de l'universitaire éthiopien Meareg Amare, qui a été assassiné devant son domicile. en novembre 2021. Le procès, déposé en décembre 2022, affirme que Meta n'a pas [pris de mesures contre les menaces de mort](https://www.businessinsider.com/facebooks-local-partners-say-hate-speech-stays-on- the-platform-2023-4) publié sur Facebook dans les semaines qui ont précédé l’attaque – et, plus largement, n’a pas réussi à investir dans suffisamment de ressources de modération pour les langues éthiopiennes.

Meta a déjà eu du mal à faire preuve de modération dans des zones de conflit, notamment au Myanmar et au [Sri Lanka](https://www.aljazeera.com/news/2020/5/13/sri-lanka-facebook-apologises-for-role- en 2018-émeutes-anti-musulmanes). Le conflit au Tigré a soulevé de nouvelles questions sur la manière dont Facebook et d’autres plateformes de médias sociaux gèrent les discours de haine dans les langues marginalisées et dans d’autres langues moins dominantes que l’anglais.

« Un modèle linguistique multilingue ne peut comprendre l’amharique sans l’intermédiaire de l’anglais »

L’une des approches adoptées par les plateformes consiste à développer des outils d’intelligence artificielle pour signaler et supprimer les discours haineux. Les systèmes de modération d’IA manquent souvent de données suffisantes pour former un modèle distinct dans des langues comme l’amharique et le tigrinya (les deux langues les plus parlées dans la région du Tigré), obligeant les systèmes à s’appuyer sur des modèles formés dans une variété de langues. Mais de nouvelles recherches ont soulevé des inquiétudes quant aux limites des modèles linguistiques multilingues, avec des implications potentiellement alarmantes sur la manière dont les plateformes modèrent dans la région du Tigré.

Dans la recherche sur l’IA, l’amharique est connu comme une « langue à faibles ressources ». Ce groupe comprend certaines des langues les plus parlées au monde, comme l'ourdou, mais comme elles sont moins représentées sur Internet, il est un texte moins numérisé qui peut être utilisé pour former des modèles d'IA adaptés à eux. En conséquence, les outils de modération automatisés traitent souvent les langues à faibles ressources via un processus appelé « transfert interlingue » – traduisant essentiellement les leçons d’un système formé en anglais dans une langue à faibles ressources comme l’ourdou ou l’amharique.

Une nouvelle étude du Centre pour la démocratie et la technologie (CDT), intitulé « Lost in Translation : Large Language Models in Non-English Content Analysis », montre à quel point il est facile que ce processus tourne mal. Ce qui est considéré comme un discours de haine raciste dans un ensemble de données en anglais américain peut être fondamental pour la compréhension d’un outil de discours de haine ethnique dans d’autres langues, entraînant davantage d’erreurs et de fausses alertes.

"Un modèle linguistique multilingue ne peut pas comprendre l'amharique sans l'intermédiaire de l'anglais", a déclaré Gabriel Nicholas, chercheur au CDT et co-auteur de l'étude, au Reste du Monde. "Nous avons beaucoup de préoccupations à ce sujet lorsqu'il est utilisé dans quelque chose qui est aussi spécifique à une langue et à une culture aussi spécifique que la modération de contenu."

Un exemple présenté dans l'article montre qu'en anglais, les références à une colombe sont souvent associées à la paix. En basque, une langue à faibles ressources, le mot pour colombe (uso) est une insulte utilisée contre les hommes qui se présentent au féminin. Un système de modération par IA utilisé pour signaler les discours de haine homophobes et dominé par des données de formation en anglais pourrait avoir du mal à identifier « uso » tel qu'il est entendu.

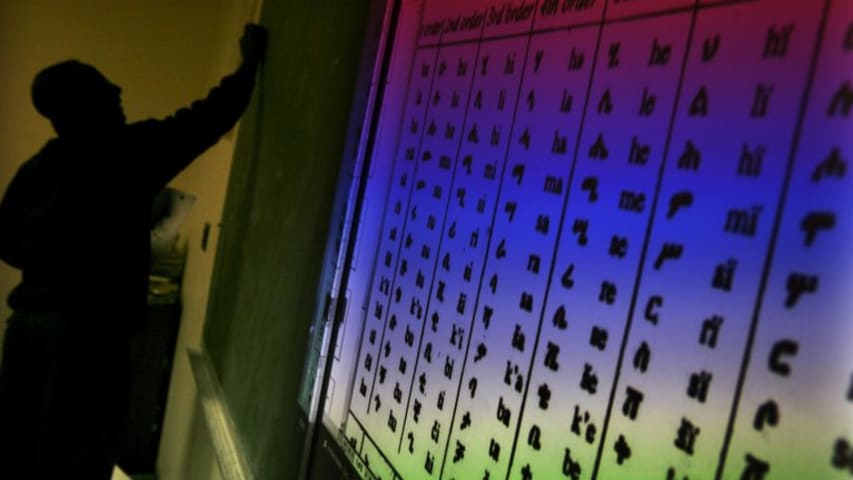

Le rapport ne tire aucune conclusion sur Meta ou sur le conflit du Tigré en particulier, mais il note des problèmes particuliers autour de la langue tigrinya, qui compte plus de 7 millions de locuteurs, dont la grande majorité en Érythrée et dans le nord de l'Éthiopie. Certains modèles linguistiques multilingues ne contiennent pas de caractères entiers dans l’alphabet tigrinya, une écriture basée sur le ge’ez similaire à l’amharique. Cela conduit à ce que les ingénieurs en apprentissage automatique appellent le « problème UNK », faisant référence à des mots inconnus qui ne font pas partie du vocabulaire du modèle.

7 millions Le nombre de locuteurs du tigrinya dans le monde.

Il est difficile de dire quelle différence une meilleure modération sur Facebook aurait fait au Tigré. Mais les Facebook Papers, publiés fin 2021, ont documenté des déficiences chroniques en matière de modération dans la région. Et les efforts juridiques en cours pour tenir l'entreprise responsable d'incidents de violence spécifiques, comme la [campagne de harcèlement contre](https://www.businessinsider.com/facebooks-local-partners-say-hate-speech-stays-on -the-platform-2023-4) Meareg Amare, souligne le manque de modérateurs humains dans certaines langues éthiopiennes.

Il existe des preuves significatives que Meta s’appuie sur l’IA multilingue dans ses systèmes de modération. Lors d’une audience au Congrès en 2021, Mark Zuckerberg a affirmé que l’entreprise utilisait l’IA pour identifier plus de 95 % des « contenus de discours de haine ». Cette année-là, dans un article de blog, la société a annoncé qu'elle avait lancé un système appelé [Few-Shot Learner](https://about.fb.com/news/2021/12/metas-new-ai-system-tackles -harmful-content/), qui peut être utilisé dans plus de 100 langues différentes. Meta a affirmé que le modèle peut identifier et prendre des mesures contre les contenus préjudiciables qui n'ont pas ou peu de précédent sur la plate-forme.

Cela fait suite à une reconnaissance antérieure en 2019 d'un modèle appelé [XLM-R](https://ai.facebook.com/blog/-xlm-r-state-of-the-art-cross-lingual-understanding-through- auto-supervision/), que Meta présentait à l'époque comme étant formé dans une langue puis utilisé dans d'autres langues sans données de formation supplémentaires. Il a largement déclaré que le modèle pourrait améliorer la modération dans les « langues à faibles ressources » – une conclusion mise en doute par le document du CDT.

Meta n'a pas répondu à une demande de commentaire.

Les entreprises de médias sociaux sont rarement transparentes sur la manière exacte dont leurs modèles linguistiques multilingues sont mis en œuvre, ou sur leur efficacité en matière de modération une fois qu'ils sont étendus à l'ensemble de leurs opérations mondiales. Mais Meta n’est pas le seul à y investir. En 2022, Jigsaw de Google a publié un article sur l'API Perspective, un modèle similaire qui peut être utilisé pour classer les commentaires toxiques. Et en avril, le PDG de TikTok, Shou Zi Chew, a déclaré que l'entreprise faisait [des investissements majeurs dans l'IA](https://observer.com/2023/04/tiktok-ceo-shou-zi-chew-increasing-ai-content-moderation /) pour relever ses propres défis de modération.

Meta et Google ont annoncé des investissements dans de grands modèles de traduction – apparemment pour augmenter les données dont ils disposent pour le développement de l’IA – qui utilisent des méthodes similaires de transfert multilingue. Dans le cas de Google, son modèle de parole universelle annoncé en novembre 2022 engloberait le les 1 000 langues les plus parlées au monde dans un seul modèle de traduction.

"Les entreprises ne peuvent pas résoudre le problème de la modération inéquitable des contenus en y mettant un pansement", a déclaré Aliya Bhatia, analyste politique au CDT et co-auteur du journal, au Reste du Monde. "Il y a déjà des gens qui comprennent les nuances spécifiques de la communauté linguistique et les enjeux d'un conflit", a-t-elle déclaré, recommandant aux sociétés de médias sociaux de travailler avec les communautés linguistiques et les chercheurs déjà prêts à accomplir la tâche difficile de numériser des textes sans s'appuyer sur des ressources médiocres. traductions automatiques.

Il est rare que les grandes entreprises technologiques forment des modèles adaptés à des langages spécifiques à faibles ressources, mais certaines startups relèvent le défi. Une société berlinoise nommée Lesan a créé le premier service général de traduction automatique pour le tigrinya. Selon son co-fondateur et directeur de la technologie, Asmelash Teka Hadgu, les sociétés de médias sociaux devraient adopter une approche similaire.

« Dans le cas de Facebook en particulier, il regorge de contenus nuisibles et haineux en amharique et en tigrinya », a-t-il déclaré au Reste du monde. Le problème nous tient à cœur – Hadgu lui-même est originaire du Tigré, comme beaucoup d'autres à Lesan. équipe. « Le manque de ressources dans de nombreuses langues dans lesquelles nous opérons constitue en fait l’obstacle le plus important pour les grandes entreprises technologiques ou autres qui souhaitent innover dans ce domaine. »

Lesan résout ce goulot d'étranglement en se tournant vers des ressources hors ligne, comme des livres et des magazines. La startup s'est coordonnée avec les communautés de langue tigrinya pour numériser ces textes imprimés, en créant des outils de reconnaissance de caractères personnalisés pour les transformer en un formulaire lisible par les machines. Lesan a depuis utilisé cette méthode de collecte de données de base pour créer un nouvel ensemble de données de référence pour les langues de la Corne de l'Afrique. La startup s'est désormais associée au Distributed AI Research Institute (DAIR) pour développer un outil open source permettant d'identifier les langues parlées en Éthiopie et d'y détecter les discours nuisibles.

Mais malgré les premiers succès de startups comme Lesan, les entreprises technologiques restent attachées à l’approche multilingue, attirées par la possibilité de capturer l’ensemble des langues du monde dans un seul outil. « Les sociétés de médias sociaux affirment que la solution la plus évolutive est également la meilleure. C’est un résultat très pratique », a déclaré Nicholas. « Ce qui fonctionnera le mieux fonctionnera le mieux dans chaque langue… et nous ne voyons même pas les entreprises de médias sociaux envisager cela. »