Incidents associés

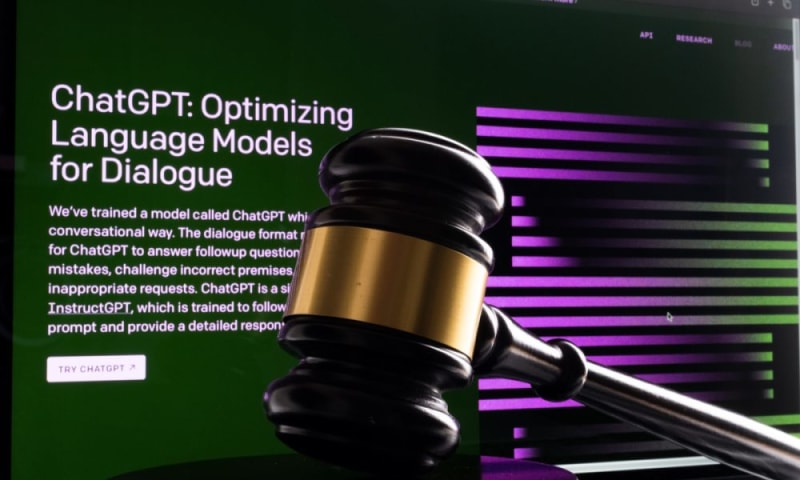

Deux avocats peuvent faire face à des sanctions judiciaires après avoir cité des cas qui ont été inventés par ChatGPT.

Les avocats pourraient même être radiés du barreau après avoir utilisé des informations "hallucinées" par l'outil d'intelligence artificielle générative (IA) à deux reprises, CNBC [rapporté](https://www.cnbc.com/2023/05/30/chatgpt-cited -bogus-cases-for-a-new-york-federal-court-filing.html) mardi (30 mai).

En première instance, les avocats ont déposé des requêtes devant un tribunal fédéral de New York qui ont cité neuf affaires juridiques que l'avocat adverse a ensuite déclaré au juge qu'ils n'avaient pas pu trouver, selon le rapport.

Le juge a ordonné aux avocats de fournir des copies des cas qu'ils avaient cités sans leur dire que lui et l'avocat adverse avaient déterminé que les cas n'existaient pas, selon le rapport.

Les avocats ont déposé le texte intégral de huit des neuf cas, selon le rapport.

Il a été déterminé plus tard que les citations initiales et le texte intégral des cas avaient été inventés par ChatGPT, selon le rapport.

Le juge a fixé une audience au cours de laquelle les avocats doivent s'expliquer, indique le rapport.

"La Cour est confrontée à une circonstance sans précédent", a déclaré le juge, selon le rapport.

Comme l'a rapporté PYMNTS en mars, "[hallucination](https://www.pymnts.com/artificial-intelligence-2/2023/chatgpt-4-looks-to-push-ai-innovation-beyond-shiny-object-category /)" - qui est le terme des chercheurs en IA pour la génération de texte complètement faux ou trompeur - est un problème qui affecte tous les chatbots.

Il n'est pas natif de ChatGPT mais de toute IA plus largement en tant que solution technique entraînée sur des données historiques.

Ces solutions sont intrinsèquement limitées par une base d'informations qui ne sera jamais vraiment à jour.

Les grands modèles de langage (LLM) comme ChatGPT sont également sujets aux [hallucinations](https://www.pymnts.com/artificial-intelligence-2/2023/artificial-intelligence-is-eating-the-world-how-to- éviter-indigestion/) et renvoyer des informations inexactes ou trompeuses, car si de mauvaises données deviennent la source d'une réponse, elles peuvent ensuite être propagées en servant de base d'information pour les réponses futures dont une IA est chargée.

Ce rapport arrive à un moment où des leaders de l'industrie technologique comme Amazon, Microsoft, Alphabet et Meta redoublent d'efforts pour développer des innovations d'avenir dans l'[IA générative](https://www.pymnts.com/big-tech/2023/big- tech-lean-on-ai-to-stabili-after-brutal-year/) et l'apprentissage automatique (ML).

Lors des récents appels aux résultats de ces entreprises, "l'IA" a été [mentionnée](https://www.bloomberg.com/news/newsletters/2023-04-27/meta-alphabet-and-microsoft-are-ready-to- dépensez-gros-en-IA-malgré-les-réductions-de-coûts) par les dirigeants plus de 200 fois.

Ces entreprises utilisent déjà l'IA dans les coulisses et l'étendent désormais à des applications plus orientées vers les consommateurs.