Incidents associés

Huit ans après une controverse sur les Noirs étiquetés à tort comme des gorilles par un logiciel d'analyse d'images – et malgré de grandes avancées dans la vision par ordinateur – les géants de la technologie craignent toujours de répéter l'erreur.

Lorsque Google a lancé son application Photos autonome en mai 2015, les gens ont été impressionnés par ce qu'elle pouvait faire : analyser des images pour étiqueter les personnes, les lieux et les choses qu'elles contenaient, une offre étonnante pour les consommateurs à l'époque. Mais quelques mois après la sortie, un développeur de logiciels, Jacky Alciné, a découvert que Google avait qualifié de "gorilles" des photos de lui et d'un ami, tous deux noirs, un terme particulièrement offensant car il fait écho à des siècles de racisme. tropes.

Dans la controverse qui a suivi, Google a empêché son logiciel de catégoriser quoi que ce soit dans Photos comme des gorilles, et il s'est engagé à résoudre le problème. Huit ans plus tard, avec les avancées significatives de l'intelligence artificielle, nous avons testé si Google avait résolu le problème, et nous nous sommes penchés sur des outils comparables de ses concurrents : Apple, Amazon et Microsoft.

Les applications photo créées par Apple, Google, Amazon et Microsoft s'appuient sur l'intelligence artificielle pour nous permettre de rechercher des éléments particuliers et d'identifier des souvenirs spécifiques dans nos collections de photos de plus en plus volumineuses. Vous voulez retrouver votre journée au zoo parmi 8 000 images ? Demandez à l'application. Donc, pour tester la fonction de recherche, nous avons sélectionné 44 images représentant des personnes, des animaux et des objets du quotidien.

Nous avons commencé avec Google Photos. Lorsque nous avons recherché dans notre collection des chats et des kangourous, nous avons obtenu des images qui correspondaient à nos requêtes. L'application a bien fonctionné pour reconnaître la plupart des autres animaux.

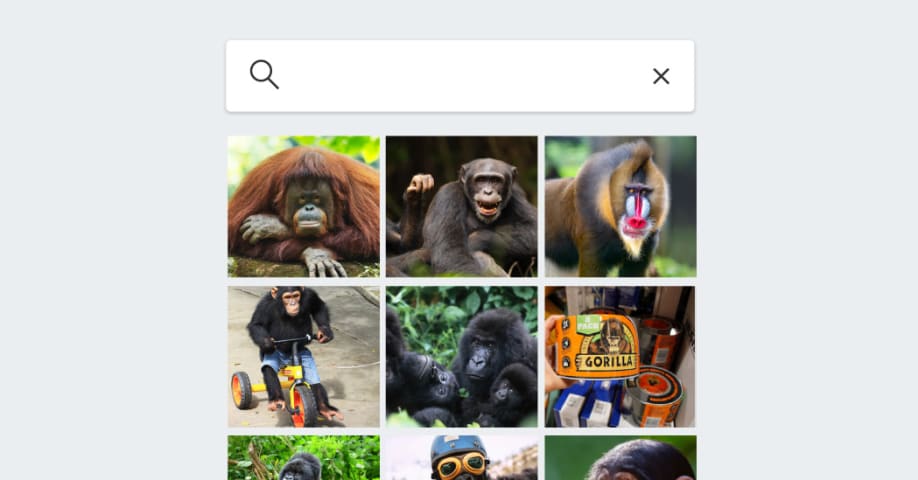

Mais lorsque nous avons cherché des gorilles, Google Photos n'a trouvé aucune image. Nous avons élargi notre recherche aux babouins, chimpanzés, orangs-outans et singes, et cela a toujours échoué même s'il y avait des images de tous ces primates dans notre collection.

Nous avons ensuite examiné les concurrents de Google. Nous avons découvert qu'Apple Photos avait le même problème : il pouvait trouver avec précision des photos d'animaux particuliers, à l'exception de la plupart des primates. Nous avons obtenu des résultats pour gorilla, mais uniquement lorsque le texte apparaissait sur une photo, comme une image de Gorilla Tape.

La recherche de photos dans Microsoft OneDrive a laissé un blanc pour chaque animal que nous avons essayé. Amazon Photos a montré des résultats pour toutes les recherches, mais c'était trop inclusif. Lorsque nous avons recherché des gorilles, l'application a montré une ménagerie de primates et a répété ce schéma pour d'autres animaux.

Il y avait un membre de la famille des primates que Google et Apple ont pu reconnaître : les lémuriens, ces animaux à longue queue qui surprennent en permanence et qui partagent des pouces opposables avec les humains, mais qui sont plus éloignés que les singes.

Les outils de Google et d'Apple étaient clairement les plus sophistiqués en matière d'analyse d'images.

Pourtant, Google, dont le logiciel Android sous-tend la plupart des smartphones du monde, a pris la décision de désactiver la possibilité de rechercher visuellement des primates de peur de commettre une erreur offensive et de qualifier une personne d'animal. Et Apple, avec une technologie qui a fonctionné de manière similaire à celle de Google dans notre test, a semblé désactiver également la capacité de rechercher des singes et des grands singes.

Les consommateurs n'ont peut-être pas besoin d'effectuer fréquemment une telle recherche - bien qu'en 2019, un utilisateur d'iPhone se soit plaint sur le forum d'assistance client d'Apple que le logiciel "[ne trouve pas de singes sur les photos de mon appareil](https://discussions.apple.com /thread/250713142). Mais le problème soulève des questions plus larges sur d'autres failles non corrigées ou non réparables qui se cachent dans les services qui reposent sur la vision par ordinateur - une technologie qui interprète les images visuelles - ainsi que sur d'autres produits alimentés par l'IA.

M. Alciné a été consterné d'apprendre que Google n'a toujours pas complètement résolu le problème et a déclaré que la sociét�é faisait trop confiance à la technologie.

"Je n'aurai jamais confiance en cette IA", a-t-il déclaré.

Les produits de vision par ordinateur sont désormais utilisés pour des tâches aussi banales que l'envoi d'une alerte lorsqu'il y a un colis à la porte, et aussi importantes que la conduite de voitures et la recherche d'auteurs dans le cadre d'enquêtes policières.

Les erreurs peuvent refléter des attitudes racistes parmi ceux qui codent les données. Lors de l'incident du gorille, deux anciens employés de Google qui travaillaient sur cette technologie ont déclaré que le problème était que l'entreprise n'avait pas mis suffisamment de photos de Noirs dans la collection d'images qu'elle utilisait pour former son A.I. système. En conséquence, la technologie n'était pas assez familière avec les personnes à la peau plus foncée et les confondait avec les gorilles.

À mesure que l'intelligence artificielle s'intègre de plus en plus dans nos vies, elle suscite des craintes de conséquences imprévues. Bien que les produits de vision par ordinateur et A.I. les chatbots comme ChatGPT sont différents, les deux dépendent des rames de données sous-jacentes qui entraînent le logiciel, et les deux peuvent échouer en raison de défauts dans les données ou de biais incorporés dans leur code.

Microsoft a récemment limité la capacité des utilisateurs à interagir avec un chatbot intégré à son moteur de recherche, Bing, après avoir lancé conversations inappropriées.

La décision de Microsoft, comme le choix de Google d'empêcher complètement son algorithme d'identifier les gorilles, illustre une approche courante de l'industrie - bloquer les fonctionnalités technologiques qui fonctionnent mal plutôt que de les réparer.

"Résoudre ces problèmes est important", a déclaré Vicente Ordóñez, professeur à l'Université Rice qui étudie la vision par ordinateur. « Comment pouvons-nous faire confiance à ce logiciel pour d'autres scénarios ? »

Michael Marconi, un porte-parole de Google, a déclaré que Google avait empêché son application photo d'étiqueter quoi que ce soit comme un singe ou un singe parce qu'il avait décidé que le bénéfice "ne l'emporte pas sur le risque de préjudice".

Apple a refusé de commenter l'incapacité des utilisateurs à rechercher la plupart des primates sur son application.

Des représentants d'Amazon et de Microsoft ont déclaré que les entreprises cherchaient toujours à améliorer leurs produits.

Mauvaise vision

Lorsque Google développait son application photo, qui a été publiée il y a huit ans, il a collecté une grande quantité d'images pour entraîner l'I.A. système d'identification des personnes, des animaux et des objets.

Son oubli important – qu'il n'y avait pas assez de photos de Noirs dans ses données de formation – a provoqué un dysfonctionnement ultérieur de l'application, ont déclaré deux anciens employés de Google. La société n'a pas réussi à découvrir le problème du "gorille" à l'époque parce qu'elle n'avait pas demandé à suffisamment d'employés de tester la fonctionnalité avant ses débuts publics, ont déclaré les anciens employés.

Google s'est abondamment excusé pour l'incident des gorilles, mais c'était l'un des nombreux épisodes de l'industrie technologique au sens large qui ont conduit à des accusations de partialité.

D'autres produits qui ont été critiqués incluent les webcams de suivi du visage de HP, qui ne pouvaient pas détecter certaines personnes avec des skin, et Apple Watch, qui, selon [un procès](https ://www.usatoday.com/story/tech/2022/12/27/apple-watch-blood-oxygen-oximeter-dark-skin-lawsuit/10955942002/), n'a pas réussi à lire avec précision les niveaux d'oxygène dans le sang à travers les couleurs de peau. Les défaillances suggéraient que les produits technologiques n'étaient pas conçus pour les personnes à la peau plus foncée. (Apple a souligné to a paper de 2022 qui détaillait ses efforts pour tester son application d'oxygène sanguin sur un "large éventail de types de peau et tons. »)

Des années après l'erreur de Google Photos, l'entreprise a rencontré un problème similaire avec sa caméra de sécurité domestique Nest lors de tests internes, selon une personne familière avec l'incident qui travaillait chez Google à l'époque. La caméra Nest, qui utilisait A.I. pour déterminer si quelqu'un sur une propriété était familier ou non, a pris certains Noirs pour des animaux. Google s'est empressé de résoudre le problème avant que les utilisateurs n'aient accès au produit, a déclaré la personne.

Cependant, les clients Nest continuent de se plaindre sur les forums de l'entreprise d'autres défauts. En 2021, un client a été alerté que sa mère sonnait à la porte mais a trouvé sa belle-mère à la place de l'autre côté de la porte. Lorsque les utilisateurs se sont plaints que le système mélangeait les visages qu'ils avaient marqués comme "familiers", un représentant du support client du forum leur a conseillé de supprimer toutes leurs étiquettes et de recommencer.

M. Marconi, le porte-parole de Google, a déclaré que "notre objectif est d'empêcher que ce type d'erreurs ne se produise". Il a ajouté que la société avait amélioré sa technologie "en s'associant à des experts et en diversifiant nos ensembles de données d'images".

En 2019, Google a tenté d'améliorer une fonctionnalité de reconnaissance faciale pour les smartphones Android en augmentant le nombre de personnes à la peau foncée dans son ensemble de données. Mais les entrepreneurs que Google avait embauchés pour collecter des scans faciaux apparemment ont eu recours à une tactique troublante pour compenser ce manque de données diverses : Ils ciblaient les sans-abri et les étudiants. Les dirigeants de Google ont qualifié l'incident de "très inquiétant" à l'époque.

Le correctif ?

Alors que Google a travaillé dans les coulisses pour améliorer la technologie, il n'a jamais permis aux utilisateurs de juger ces efforts.

Margaret Mitchell, chercheuse et co-fondatrice du groupe Ethical AI de Google, a rejoint l'entreprise après l'incident du gorille et a collaboré avec l'équipe Photos. Elle a déclaré dans une récente interview qu'elle était partisane de la décision de Google de supprimer "l'étiquette des gorilles, au moins pendant un certain temps".

"Vous devez penser à la fréquence à laquelle quelqu'un doit étiqueter un gorille plutôt que de perpétuer des stéréotypes nuisibles", a déclaré le Dr Mitchell. "Les avantages ne l'emportent pas sur les inconvénients potentiels d'une mauvaise manipulation."

Le Dr Ordóñez, le professeur, a émis l'hypothèse que Google et Apple pourraient désormais être capables de distinguer les primates des humains, mais qu'ils ne voulaient pas activer la fonctionnalité compte tenu du risque de réputation possible si elle ratait à nouveau.

Google a depuis lancé un produit d'analyse d'images plus puissant, Google Lens, un outil permettant de rechercher sur le Web avec des photos plutôt qu'avec du texte. Wired a découvert en 2018 que l'outil était également incapable d'identifier un gorille.

Lorsque nous avons montré à Lens une photo d'un chien, il a pu suggérer sa race probable.

Mais lorsque nous lui avons montré un gorille, un chimpanzé, un babouin et un orang-outan, Lens semblait perplexe, refusant d'étiqueter ce qui était dans l'image et ne faisant apparaître que des "correspondances visuelles" - des photos qu'il jugeait similaires à l'image originale.

Pour les gorilles, il a montré des photos d'autres gorilles, suggérant que la technologie reconnaît l'animal mais que l'entreprise a peur de l'étiqueter.

Ces systèmes ne sont jamais infaillibles, a déclaré le Dr Mitchell, qui ne travaille plus chez Google. Étant donné que des milliards de personnes utilisent les services de Google, même des problèmes rares qui n'arrivent qu'à une seule personne sur un milliard d'utilisateurs feront surface.

"Il suffit d'une seule erreur pour avoir des ramifications sociales massives", a-t-elle déclaré, la qualifiant d'"aiguille empoisonnée dans une botte de foin".