Incidents associés

Un propriétaire de Tesla Model 3 a rencontré un problème inhabituel lors de l'utilisation du système de conduite assistée par pilote automatique sur l'autoroute : la voiture semblait détecter une traînée interminable de feux de circulation tout au long de la route alors qu'elle parcourait plus de 80 mph.

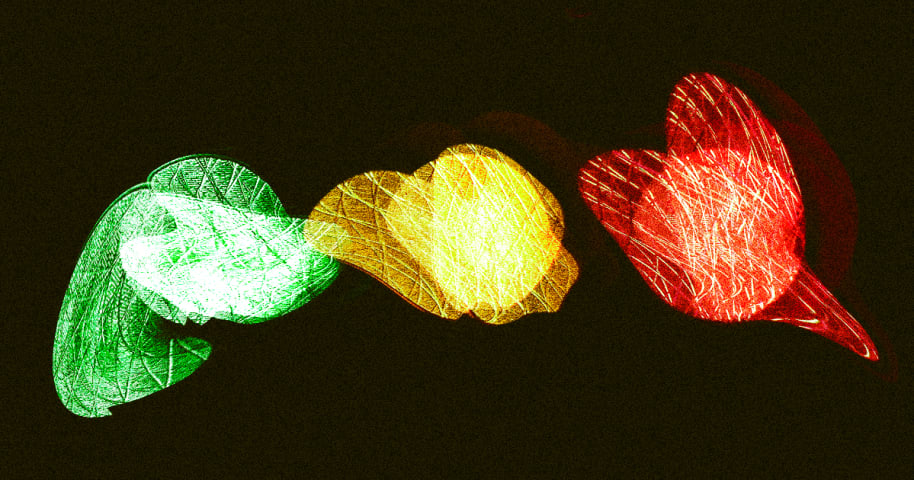

Dans une séquence vidéo de l'écran de la voiture que le conducteur télécharge sur Reddit, on dirait que les feux de circulation sont soufflés hors du camion devant eux, faisant ressembler le lecteur à un jeu vidéo de style "bullet hell" sur le thème de la voiture.

Après de nombreuses spéculations parmi d'autres rédacteurs, l'auteur a publié une vidéo de suivi révélant qu'ils conduisaient derrière un camion transportant des feux de circulation désactivés. C'est un problème amusant, bien sûr, mais l'incapacité du système à comprendre ce qui se passe montre à quel point il est incroyablement difficile de préparer des systèmes de conduite autonomes pour l'incroyable gamme de cas extrêmes qu'ils pourraient rencontrer dans le monde réel.

La sécurité d'abord

D'une part, il est bon que le système de conduite assistée ait pu reconnaître à plusieurs reprises qu'il regardait en fait les feux de circulation. Et la voiture n'a jamais semblé essayer de s'arrêter comme si elle avait rencontré un feu rouge, car une telle manœuvre aurait pu s'avérer désastreuse.

Cependant, un peu comme un problème similaire où une Tesla a confondu un panneau d'arrêt imprimé sur un panneau d'affichage [pour la vraie chose] (https://futurism.com/the-byte/tesla-slamming-brakes-sees-stop-sign-billboard ), le fait que le système n'a pas pu reconstituer le contexte de la situation est toujours un problème. L'incapacité de Tesla à se rendre compte que les lumières étaient une cargaison plutôt que des signaux installés au milieu de l'autoroute est un signe clair que Tesla n'est pas prêt pour une autonomie complète, peu importe le nombre de fois [le PDG Elon Musk le dit](https:/ /futurism.com/the-byte/tesla-admits-elon-musk-exaggerated-autopilot).

"Je suppose que ce scénario ne faisait probablement pas partie des données de formation du système", a déclaré Max Little, mathématicien de l'Université de Birmingham et du MIT, sur Twitter (https://twitter.com/MaxALittle/status/1400468962572341254). "Une bonne illustration de la façon dont il sera probablement impossible d'atteindre une autonomie de conduite complète simplement en enregistrant" plus de données "."