Problème 2946

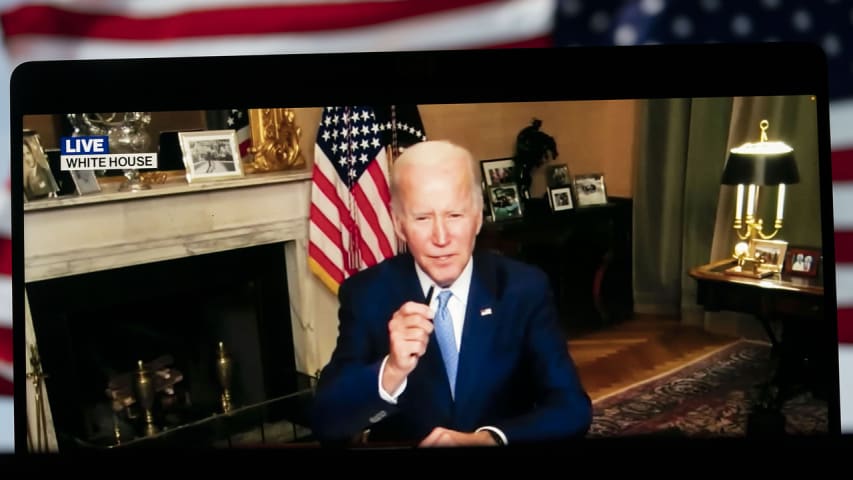

Dans un épisode récent de Pod Save America, co-animateur et ancien membre du personnel de l'administration Obama Tommy Vietor [a déclaré](https://podcasts.apple.com/us/podcast/the-2024-dry-ron/id1192761536? i=1000602015326) il avait rencontré « un ami très important au cours du week-end », avant de lancer un message audio exclusif du président Joe Biden. Le clip était rempli de bidénismes (« malarkey » ; « les gens » ; "Construire une économie de bas en haut et au milieu") et quelques blagues ("Joe Biden a-t-il trouvé ça drôle quand Favreau a dit que mon événement en Caroline du Sud ressemblait à une fête dans un salon funéraire à prix réduit ? Non, Joe ne l'a pas fait.") Le tout semblait quelque peu plausible : Biden lui-même est allé à l'émission pendant sa campagne 2020, et divers membres de son administration , ainsi que l'ancien président Barack Obama se sont arrêtés depuis. De plus, cela ressemblait beaucoup à Biden.

"C'était évidemment faux", a déclaré Vietor par la suite. "Mais mon garçon, cela sera-t-il dangereux lors des élections à venir." Ceci, étant l'audio généré par l'IA des politiciens - deepfakes - qui, comme l'a noté son collègue Pod Save America hôte ** Jon Favreau **, crée déjà un nouveau défi dans les médias politiques. À la veille de l'élection du maire de Chicago, un compte Twitter se faisant passer pour une véritable agence de presse, "Chicago Lakefront News", tweeted une voix off IA de le candidat Paul Vallas parle de sécurité publique - une fausse vidéo qui aurait a été vue des milliers de fois avant d'être démonté.

"Au cours des derniers mois, c'est la première fois que l'IA générative est devenue si bonne - pas assez bonne pour peut-être tromper quelqu'un, mais elle y arrive, n'est-ce pas ? Vous pouvez voir à quel point cela constituerait une menace crédible », déclare ** Pranav Dixit **, journaliste technique pour BuzzFeed News. Dixit souligne les deepfakes de politiciens qui sont devenus viraux, ainsi que ceux mettant en vedette le podcasteur Joe Rogan – qui, dans un [clip] généré par l'IA (https://twitter.com/zachsilberberg/status/1626665046175539224) débat le film Ratatouille avec le commentateur conservateur Ben Shapiro et l'actrice Emma Watson, dont la voix était simulée en train de "lire" Mein Kampf. Comme l'a noté John Hendrickson de The Atlantic dans un récent article intitulé "Le prochain grand scandale politique pourrait être truqué", "C'est exactement là que nous sommes aujourd'hui, à 21 mois des prochaines élections fédérales. Ça va aller mieux, et plus effrayant, très vite.

PolitiFact, une organisation à but non lucratif de vérification des faits gérée par le Poynter Institute, [récemment démystifiée] (https://www.politifact.com/factchecks/2023/feb/27/viral-image/sen-elizabeth-warren-didnt-say- republicans-shouldn/) une vidéo modifiée de la sénatrice Elizabeth Warren qui utilisait une interview qu'elle avait faite avec MSNBC, dans laquelle il semblait que Warren disait que les républicains ne devraient pas être autorisés à voter. Les faux discours de Biden ont été [un favori sur les réseaux sociaux] (https://www.rollingstone.com/culture/culture-news/joe-biden-voice-fake-ai-speeches-1234683601/) ces derniers temps, avec des simulations de le président parle de tout, du hip hop à la drogue et aux jeux vidéo. Mais certains utilisent également la technologie pour diffuser des désinformations, comme un [deepfake](https://www.politifact.com /factchecks/2023/feb/06/instagram-posts/joe-biden-has-offered-support-transgender-american/) vidéo de Biden critiquant les femmes transgenres.

Ce deepfake était un cas où "vous n'avez pas besoin d'être super avancé dans les compétences vidéo médico-légales pour dire que c'est faux", me dit la rédactrice en chef de PolitiFact ** Katie Sanders **. Mais l'inquiétude porte davantage sur le "potentiel" que cette technologie pourrait avoir, explique Sanders. "Lorsqu'il s'agit d'une vidéo d'un événement public, il est très facile d'expliquer comment nous savons que ce n'est pas réel, mais cela devient beaucoup plus difficile lorsque vous avez affaire à des choses qui sont de personne à personne ou qui dépendent vraiment de l'intelligence communauté pour savoir si elles se sont produites ou non.

Il est facile de voir comment cette tendance pourrait devenir un véritable défi pour les organes de presse, en particulier avant une campagne présidentielle, lorsque les journalistes examinent régulièrement les recherches de l'opposition et reçoivent des informations sur des enregistrements audio ou vidéo enregistrés en secret, généralement à un rythme rapide et dans un environnement où la désinformation peut facilement proliférer. On ne sait pas encore comment - ou si - les principaux points de vente prévoient de modifier leur processus de sélection ; plusieurs médias grand public, dont The Wall Street Journal et The Washington Post, ont refusé de commenter la manière dont ils se préparent à gérer le contenu politique généré par l'IA jusqu'en 2024. L'IA pour commencer, sans parler des ramifications politiques de ce que cela signifie pour la désinformation », me dit Dixit, notant que BuzzFeed, même avec sa longue histoire de démystification de la désinformation et des deepfakes, est toujours en train de déterminer les détails de sa stratégie de couverture.

Les géants de la technologie devront également résoudre le problème à un moment donné. "Ce qui est particulièrement préoccupant, c'est qu'aucune des plateformes n'a défini de stratégie en matière d'IA générative et de contenu politique", déclare Dixit, pointant vers [YouTube](https://blog.youtube/inside-youtube/2023- letter-from-neal/), TikTok et [Facebook](https:/ /ai.facebook.com/blog/generative-ai-text-to-video/) - qui, note Dixit, consacrent du temps et des efforts à développer leur propre technologie d'IA générative. Dixit soupçonne que ces plateformes seront obligées de proposer des politiques pour traiter le contenu politique généré par l'IA à l'approche de 2024, tout comme elles l'étaient dans le passé en ce qui concerne d'autres formes de désinformation. (BuzzFeed a également pris le train de l'IA : le PDG Jonah Peretti [a déclaré](https://www.wsj.com/articles/buzzfeed-to-use-chatgpt-creator-openai-to-help-create -some-of-its-content-11674752660) plus tôt cette année que la société utiliserait la technologie de l'IA pour créer du contenu.)

Chez The Verge, le personnel est "sur ses gardes", me dit l'éditeur Nilay Patel, tout en notant que [ce n'est pas la première fois](https://www.politico.com/story/2019/06 /25/media-2020-misinformation-1378849) les salles de rédaction se sont préparées à un déluge de deepfakes. «Ce que notre salle de presse a retenu de 2020, c'est que les gens qui essaient de vous tromper sont souvent vraiment assez paresseux. La technologie était en fait là pour faire des deepfakes convaincants, c'était tout simplement trop difficile à utiliser », explique Patel. "Maintenant, c'est devenu un peu plus facile." (Sur Pod Save America, Vietor a noté qu'il avait payé quelques dollars pour faire l'audio généré par l'IA de Biden sur un site appelé ElevenLabs, une startup d'IA que The Verge a [couvert](https://www.theverge.com /2023/1/31/23579289/ai-voice-clone-deepfake-abuse-4chan-elevenlabs).) Compte tenu de cette accessibilité, "toute notre salle de rédaction doit comprendre comment examiner ces histoires afin de les parcourir plus rapidement", dit Patel. PolitiFact, lui aussi, pense à la vitesse et a «rédigé du personnel pour répondre à ce genre de choses assez rapidement», explique Sanders. "Nous sommes pleinement conscients que le temps est précieux entre la diffusion du contenu et le signalement."