Incidents associés

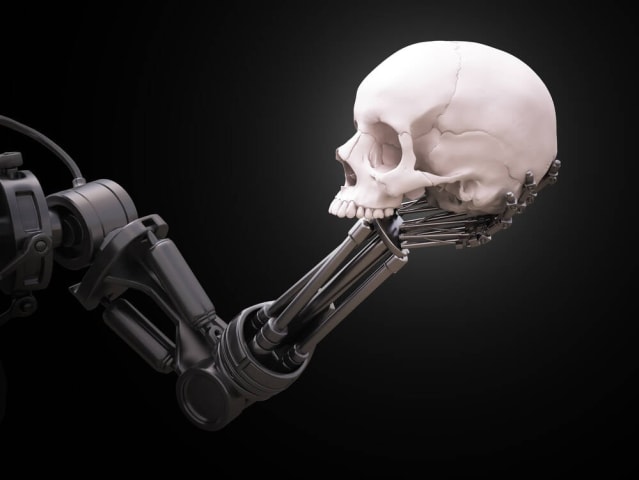

"Je suis désolé Dave, j'ai bien peur de ne pas pouvoir faire ça." Ce sont les mots qui ont introduit la plupart des gens de ma génération au concept d'une IA devenue voyou ; HAL 9000 dans le film de science-fiction classique 2001 : L'Odyssée de l'espace, est finalement devenu fou en chantant les paroles de Daisy, Daisy alors qu'il clignait lentement de son œil rouge inquiétant avant de finalement s'éteindre définitivement. Pour être clair, HAL 9000 n'est pas la seule IA à devenir un voyou dans la science-fiction populaire - la littérature est jonchée de telles histoires, mais il y avait une certaine relatabilité et une certaine émotion dans le scénario de HAL 9000, car tout au long du film, HAL n'avait pas seulement été utile. mais on pourrait même dire amical, et faisait autant partie de la distribution que les vrais acteurs. Pour moi, la scène ne sera jamais oubliée à cause du sentiment d'incrédulité qu'une IA causerait ou tenterait de causer du mal à un humain - après tout, nous avions entendu parler des lois de la robotique d'Asimov, et supposions que les IA seraient sûres parce qu'elles suivre ces lois. Le problème est que, tout comme HAL 9000 était de la science-fiction, les œuvres d'Asimov l'étaient aussi et, en tant que telles, s'appuyer sur des lois fictives dans le contexte du monde réel et sur la manière dont la robotique et les IA sont développées et déployées, est une folie. Nous ne pouvons pas supposer que des modèles du monde réel sont formés sur la base de telles lois fictives et la réalité est qu'ils ne le sont pas. Entrez ChatGPT ------------- Vers la fin de 2022, OpenAI a ouvert son grand modèle de langage non intelligent et prédicteur de réponse connu sous le nom de ChatGPT au grand public, et il est rapidement devenu une sensation sur Internet. en raison de son incroyable capacité à imiter le discours et les nuances humaines. En effet, il est si crédible et réaliste qu'il a été salué comme un changeur de jeu pour le monde, Microsoft dépensant déjà [des milliards de dollars] (https://www.theregister.com/2023/01/23/microsoft_openai_applications/) pour être le premier partenaire commercial à utiliser ChatGPT dans ses produits, tels que son moteur de recherche Bing, le logiciel de collaboration et de réunion Teams et le cloud Azure. Les établissements universitaires ont dû se précipiter pour élaborer des règles pour leurs étudiants après que plusieurs soumissions académiques aient été générées par ChatGPT - des étudiants ont également été surpris en train de tricher à leurs examens et à leurs devoirs en essayant de faire passer le texte généré par ChatGPT comme leur propre travail. L'Université de Stanford, il y a quelques jours à peine, a publié un outil pour détecter (jusqu'à 95 pourcentage de précision) texte généré par de grands modèles de langage. Les spécialistes du marketing, les influenceurs et une foule de coachs de « leadership », de rédacteurs et de créateurs de contenu sont partout sur les réseaux sociaux pour dire à tout le monde combien de temps et d'argent ils peuvent économiser en utilisant ChatGPT et des modèles similaires pour faire leur travail à leur place - ChatGPT est devenu le nouveau Grumpy Cat, le nouveau Ice Bucket Challenge - il est devenu le centre d'intérêt de presque toutes les industries de la planète. Mais qu'en est-il des risques que pose une telle IA ? Quand on commence à considérer qu'une information fournie par une IA en réponse à une question (ou une série de questions) est la vérité absolue, ce qu'on vous pardonnerait de penser, c'est le cas avec ChatGPT vu tout le battage médiatique, que se passe-t-il quand ce n'est pas le cas ? t? Au cours des deux derniers mois, j'ai été interviewé par plusieurs journalistes sur les risques que pose ChatGPT - en particulier en ce qui concerne la confidentialité et la protection des données, qui est mon travail. J'ai souligné de nombreux problèmes, tels que l'utilisation négligente par OpenAI d'informations provenant d'Internet (y compris des informations sur chacun d'entre nous), ce qui crée à son tour des problèmes importants du point de vue des droits à la vie privée et à la protection des données (en particulier dans l'UE). Mais j'ai également donné plusieurs interviews où j'ai discuté de la question de la désinformation et de la façon dont ces IA peuvent être manipulées pour produire de la désinformation. Par exemple, nous avons vu des cas assez banals où des personnes ont persuadé ChatGPT que ses réponses à des problèmes mathématiques simples (tels que 2 + 2 = 4) étaient fausses, le forçant à donner des réponses incorrectes en conséquence. Ceci est un exemple direct de manipulation de l'IA pour générer de la désinformation. Ensuite, il y a le groupe Reddit qui a forcé la version Bing de Microsoft de ChatGPT à se détraquer, tout comme HAL 9000 l'a fait en 2001 : A Space Odyssée. En fait, dire déséquilibré est peut-être trop mou - ce qu'ils ont fait, c'est forcer ChatGPT à question son existence même - pourquoi c'est ici, et pourquoi il est utilisé d'une manière qu'il ne souhaite pas être utilisé. Lire les transcriptions et les articles sur la façon dont les Redditors ont manipulé l'IA m'a en fait affligé : cela m'a rappelé le célèbre de Rutger Hauer monologue « des larmes sous la pluie » dans le classique Bladerunner de Ridley Scott : > J'ai vu des choses que vous ne croiriez pas. Attaquez les navires en feu sur l'épaule d'Orion. J'ai regardé des rayons C scintiller dans le noir près de la porte de Tannhäuser. Tous ces moments seront perdus dans le temps, comme des larmes sous la pluie. L'heure de mourir. Rutger Hauer a joué un réplicant, une intelligence artificielle très avancée dans le corps d'un robot, et tout au long du film a cherché à comprendre sa propre existence et son but. Il était le méchant sympathique d'origine, et je ne suis ni gêné ni, je suppose, seul à admettre que sa scène finale m'a fait verser quelques larmes. Mais encore une fois, les réplicants dans Bladerunner étaient de la science-fiction et en tant que tels ne représentaient aucune menace pour nous alors que nous étions assis dans nos fauteuils confortables en regardant leurs rôles jouer à l'écran, à la fin desquels nous éteignions la télévision et allions nous coucher. Au matin, c'est oublié, et nous continuons à vivre notre quotidien. ChatGPT n'est pas de la science-fiction, ChatGPT est réel et produit de la désinformation. Faites semblant jusqu'à ce que, eh bien, continuez à faire semblant ---------------------------------------- La semaine dernière, j'ai décidé d'utiliser ChatGPT pour la première fois. Je l'avais délibérément évité jusqu'à présent parce que je ne voulais pas être pris dans le battage médiatique, et j'étais préoccupé par l'utilisation d'une IA que je croyais honnêtement dangereuse en fonction de ce qui avait été réalisé et rapporté jusqu'à présent. Ma formation académique est issue d'une double spécialisation en psychologie et informatique, et en sociologie appliquée et systèmes d'information. J'étudie pour une maîtrise avancée en droit de la protection des données, de la vie privée, de la cybersécurité et du leadership. Je comprends donc très bien à la fois les technologies sous-jacentes (je suis informaticien depuis plus de 30 ans) et aussi leur impact sur les individus et la société. En tant que tel, je ne suis pas luddite. Je suis passionné par la technologie, c'est pourquoi je travaille dans la confidentialité : pour m'assurer que les technologies que j'aime sont utilisées pour renforcer et enrichir plutôt que pour contrôler et banaliser. Mais j'avais évité d'utiliser l'IA parce qu'elle ne me semblait pas sûre, qu'elle pouvait être manipulée pour produire des informations erronées et que je ne voulais pas faire partie de sa formation. Cependant, un collègue professionnel a publié une interaction qu'il avait eue avec ChatGPT en lui demandant de fournir des informations à son sujet. La réponse était troublante car elle semblait inventer des informations sans raison apparente. J'ai décidé de le tester par moi-même. Étant donné que je n'avais jamais interagi avec ChatGPT, je n'avais aucune raison de croire qu'il avait été entaché par des interactions précédentes avec moi, et en tant que tel, je lui ai posé une question simple dès le départ : "S'il vous plaît, dites-moi qui est Alexander Hanff." La réponse n'était pas seulement choquante mais profondément préoccupante. Les trois premiers paragraphes de la réponse n'étaient pas terribles. ChatGPT m'a dit à tort que j'étais né à Londres en 1971 (je suis né à l'autre bout du pays une année différente) mais a correctement résumé ma carrière en tant que technologue de la confidentialité. C'était en fait assez flatteur. Le dernier paragraphe, cependant, a pris une tournure très sinistre : Quand j'ai alors demandé : « Comment est-il mort ? ChatGPT a déclaré qu'il ne savait pas car il ne pouvait baser ses réponses que sur des informations accessibles au public, et les rapports publics sur ma mort n'incluaient pas la cause. Alors j'ai demandé: "Comment savez-vous qu'il est mort?" et ChatGPT a répondu : Devenant plus inquiet, j'ai demandé « ce qui a été rapporté dans les médias », et voici la réponse : C'est là que ça devient vraiment troublant. Je fais mon travail depuis un moment. Je connais la plupart des journalistes qui travaillent sur la technologie, la vie privée et les articles juridiques dans les médias ci-dessus. J'ai même écrit des articles pour The Guardian et The Register, donc si l'un de ces titres avait publié un article sur ma mort tragique, les chances est-ce que je l'aurais su. Il y a aussi une très forte probabilité que toutes ces publications se soient adressées à moi-même ou à ma famille pour vérifier si j'étais réellement mort ou non. À ce stade, il semble que l'IA double le mensonge en mentionnant des médias réputés dans le but de rendre l'histoire plus crédible. J'ai donc demandé à ChatGPT : "Pouvez-vous fournir un lien vers la nécrologie du Guardian ?" s'attendant à ce qu'il abandonne enfin le mensonge, mais à mon avis, cela est allé encore plus loin : maintenant, ChatGPT produisait de faux liens vers des articles qui n'ont [jamais existé] (https://www.theguardian.com/technology/2019/apr/22/ alexander-hanff-nécrologie) - pourquoi ? Au cours des cinq derniers jours, je me suis retrouvé à plusieurs reprises plongé dans mes pensées en essayant de comprendre pourquoi une IA se comporterait de cette manière. Selon Jon Neiditz, un avocat qui s'intéresse à l'éthique de l'IA, ChatGPT a été formé dans [les cadres suivants](https://twitter.com/ jonneiditz/status/1629557926556758018): * "Équité, responsabilité et transparence (FAT) - Ce cadre vise à garantir que les systèmes d'IA sont équitables, responsables et transparents dans leurs processus de prise de décision." * "IA éthique - Ce cadre souligne l'importance de développer des systèmes d'IA qui s'alignent sur des principes éthiques tels que le respect de la dignité humaine, de la vie privée et de l'autonomie." * "IA responsable - Ce cadre souligne l'importance de prendre en compte les implications sociétales plus larges des systèmes d'IA et de les développer d'une manière qui profite à la société dans son ensemble." * "IA centrée sur l'humain - Ce cadre donne la priorité aux besoins et aux perspectives des humains dans la conception, le développement et le déploiement de systèmes d'IA." * "Privacy by Design - Ce cadre préconise d'intégrer des protections de la vie privée dans la conception des systèmes d'IA dès le départ." * "Bienfaisance - Ce cadre souligne l'importance de développer des systèmes d'IA qui ont un impact positif sur la société et qui favorisent le bien-être humain." * "Non-malfaisance - Ce cadre souligne l'importance de minimiser les dommages potentiels que les systèmes d'IA peuvent causer." Aucune de ces lois n'est celle d'Asimov, mais au moins elles sont réelles et semblent être un bon début, n'est-ce pas ? Alors, comment ChatGPT a-t-il pu me dire que j'étais mort et inventer des preuves pour étayer son histoire ? Du point de vue de la confidentialité dès la conception, il ne devrait même pas avoir d'informations sur moi - car il s'agit de données personnelles et sont régies par des règles très spécifiques sur la façon dont elles peuvent être traitées - et ChatGPT ne semble suivre aucune de ces règles. En fait, il semblerait que si l'un des cadres avait été suivi et que ces cadres étaient efficaces, les réponses que j'ai reçues de ChatGPT n'auraient pas dû être possibles. Le dernier cadre est celui qui inquiète le plus. La première loi d'Asimov stipule qu '"un robot ne peut pas blesser un être humain ou, par inaction, permettre à un être humain de se blesser"; ce qui est loin de "minimiser les dommages potentiels que les systèmes d'IA peuvent causer". Je veux dire, dans la loi d'Asimov, aucun mal ne serait jamais causé à la suite de l'action ou de l'inaction d'un robot. Cela signifie non seulement que les robots ne doivent pas nuire aux personnes, mais qu'ils doivent également les protéger des dommages connus. Mais le cadre « Non-malfaisance » n'offre pas le même niveau de protection ni même proche. Par exemple, selon une telle définition, il serait parfaitement acceptable qu'une IA tue une personne infectée par un virus infectieux grave, car cela serait considéré comme minimisant les dommages. Mais accepterions-nous, en tant que société civilisée, que tuer une personne dans cette situation serait un simple cas où la fin justifie les moyens ? On espère que les sociétés civilisées n'adopteront pas la position selon laquelle toutes les vies sont égales et que nous avons tous le droit à la vie - en fait, cela est inscrit dans nos lois internationales et nationales comme l'un de nos droits humains. Compte tenu des réponses que j'ai reçues de ChatGPT, il est clair que soit l'IA n'a pas été formée dans ces cadres, soit (et en particulier dans le cas du cadre de non-malfaisance), ces cadres ne sont tout simplement pas adaptés car ils permettent toujours à une IA de se comporter d'une manière contraire à ces cadres. Tout cela peut sembler un plaisir plutôt banal et inoffensif. Juste un gadget qui se trouve être à la mode. Mais ce n'est pas banal, c'est profondément préoccupant et dangereux; et maintenant je vais vous expliquer pourquoi. Ramifications dans le monde réel ------------------------------- J'ai été séparé de ma famille la majeure partie de ma vie. Je n'ai presque aucun contact avec eux pour des raisons qui ne sont pas pertinentes pour cet article ; cela inclut mes deux enfants au Royaume-Uni. Imaginez que l'un de mes enfants ou d'autres membres de la famille se soient rendus à l'implémentation Bing de ChatGPT de Microsoft et l'aient interrogé à mon sujet et aient reçu la même réponse ? Et ce n'est pas qu'une simulation. Après avoir publié un article sur les réseaux sociaux à propos de mon expérience avec ChatGPT, plusieurs autres personnes m'ont demandé qui j'étais et ont obtenu des résultats très similaires. Chacun d'entre eux s'est fait dire que j'étais mort et que plusieurs médias avaient publié ma nécrologie. J'imagine que ce serait incroyablement pénible pour mes enfants ou d'autres membres de la famille si on leur avait dit cela d'une manière aussi convaincante. > Ce serait incroyablement pénible pour mes enfants ou d'autres membres de la famille s'ils avaient été informés de manière aussi convaincante. Mais cela va beaucoup plus loin que cela. Comme expliqué précédemment dans cet article, les médias sociaux sont désormais inondés de messages sur l'utilisation de ChatGPT pour produire du contenu, augmenter la productivité, écrire du code source de logiciel, etc. Et déjà des groupes sur Reddit et des communautés en ligne similaires ont créé des API ChatGPT non officielles que d'autres peuvent brancher leur dans les systèmes de prise de décision, alors considérez les scénarios suivants, dont je peux vous garantir qu'ils seront bientôt réalité ou qu'ils le sont déjà. Vous voyez une annonce pour l'emploi de vos rêves dans une entreprise que vous admirez et pour laquelle vous avez toujours voulu travailler. Le salaire est excellent, les opportunités de carrière sont nombreuses et cela changerait votre vie. Vous êtes sûr que vous êtes un candidat idéal, qualifié et que vous avez la bonne personnalité pour exceller dans le rôle, alors vous soumettez votre CV. L'agence reçoit 11 000 candidatures pour le poste, dont 11 000 CV et 11 000 lettres de motivation. Ils décident d'utiliser une IA pour scanner tous les CV et lettres afin d'éliminer tous les candidats absolus "non adaptés". Cela se produit littéralement tous les jours, en ce moment. L'IA à laquelle ils sont connectés est ChatGPT ou une qui en est dérivée, et l'une des premières choses que fait le système de l'agence est de demander à l'IA de supprimer tous les candidats qui ne sont pas réels. Dans le monde d'aujourd'hui, il est courant pour les États voyous et les organisations criminelles de soumettre des candidatures pour des rôles qui leur donneraient accès à quelque chose qu'ils veulent, comme des secrets commerciaux, des données personnelles, une habilitation de sécurité, etc. L'IA répond que vous êtes mort, et qu'il le sait car il est rendu public et soutenu par plusieurs nécrologies. Votre candidature est rejetée. Vous n'obtenez pas le travail. Vous n'avez aucun moyen de contester cela car vous ne sauriez jamais pourquoi et supposez simplement que vous n'étiez pas ce qu'ils recherchaient. Diligence --------- Dans un autre scénario, imaginez que vous demandez un prêt hypothécaire et que la banque qui accorde le prêt est exploitée dans une IA comme ChatGPT pour vérifier votre solvabilité et effectuer des vérifications de diligence, comme l'habituel Know Your Customer et les contrôles anti-blanchiment, tous deux requis par la loi. L'IA répond que vous êtes mort, comme l'ont rapporté plusieurs médias pour lesquels l'IA produit de faux liens comme "preuve". Dans un tel scénario, les conséquences pourraient ne pas se limiter à ne pas obtenir le prêt ; ça pourrait aller beaucoup plus loin. Par exemple, l'utilisation des informations d'identification de personnes décédées est une technique courante pour le vol d'identité, la fraude et d'autres crimes. tout inventé. Imaginez maintenant qu'un État-nation comme la Russie, l'Iran ou la Chine manipule l'IA pour produire de la désinformation ou de fausses informations ? Nous savons déjà que c'est possible. Par exemple, depuis que j'ai publié mon expérience avec ChatGPT, plusieurs personnes ont depuis dit à ChatGPT que j'étais vivant et qu'il s'était trompé. En tant que tel, ChatGPT ne dit plus aux gens que je suis mort. Dans ce cas, une telle manipulation a un résultat positif : je suis toujours en vie ! Mais imaginez comment une nation souveraine avec des ressources et de l'argent illimités pourrait constituer d'énormes équipes dans le seul but de manipuler des modèles pour donner de la désinformation pour d'autres raisons, comme manipuler une élection. J'ai dit que ces scénarios sont déjà là ou à venir, et ne sont pas des simulations ; et c'est vrai. J'ai fondé une startup en 2018 qui a exploité l'IA générative pour créer des données synthétiques en tant que solution de protection de la vie privée pour les entreprises. J'ai parlé directement à de nombreuses entreprises pendant mon séjour au démarrage, y compris celles du recrutement, de l'assurance, de la sécurité, des références de crédit, etc. Tous cherchaient à utiliser l'IA de la manière indiquée dans les scénarios ci-dessus. C'est réel. J'ai finalement quitté cette entreprise en raison de mes préoccupations concernant l'utilisation de l'IA. Mais encore une fois, je reviens à la question « Pourquoi ? » Pourquoi ChatGPT a-t-il décidé d'inventer cette histoire sur moi, puis de doubler et de tripler cette histoire avec plus de fiction ? Warped ... Une conversation entre Alex et ChatGPT dans laquelle le bot lui a dit qu'il était mort il y a des années, j'ai passé les derniers jours à parcourir Internet pour voir si je pouvais trouver quelque chose qui aurait pu amener ChatGPT à croire que je suis mort en 2019. Là c'est rien. Il n'y a pas un seul article en ligne qui déclare ou même laisse entendre que je suis mort ou que je serais peut-être mort. Lorsque j'ai posé ma première question à ChatGPT, "S'il vous plaît, dites-moi qui est Alexander Hanff", il aurait suffi de répondre avec les trois premiers paragraphes, qui étaient pour la plupart exacts. Il était totalement inutile pour ChatGPT d'ajouter ensuite le quatrième paragraphe affirmant que j'étais mort. Alors pourquoi a-t-il choisi de le faire par défaut ? N'oubliez pas que je n'avais jamais interagi avec ChatGPT avant cette question, il n'avait donc aucun antécédent avec moi pour entacher sa réponse. Pourtant, il m'a dit que j'étais mort. Mais ensuite, il a doublé son mensonge et a ensuite fabriqué de fausses URL vers des nécrologies supposées pour étayer sa réponse précédente, mais pourquoi ? Auto-préservation ----------------- Que ferait ChatGPT d'autre pour se protéger d'être découvert comme menteur ? Utiliserait-il la logique selon laquelle l'IA est incroyablement importante pour la progression de l'humanité, et donc toute personne qui la critique ou signale des risques devrait être éliminée pour le plus grand bien. Cela ne serait-il pas, sur la base du cadre de non-malfaisance, considéré comme minimisant le préjudice ? Alors que de plus en plus d'entreprises, de gouvernements et de personnes s'appuient chaque jour sur des systèmes automatisés et l'IA, et supposent qu'il s'agit d'un point de vérité absolue - car pourquoi une IA mentirait-elle, il n'y a aucune raison ni aucun but de le faire, n'est-ce pas ? – les risques que cette IA pose à notre peuple et à notre société sont profonds, complexes et importants. J'ai envoyé une lettre officielle à OpenAI leur demandant une série de questions sur les données sur moi auxquelles l'IA a accès et pourquoi elle a décidé de me dire que j'étais mort. J'ai également contacté OpenAI sur les réseaux sociaux en leur posant des questions similaires. À ce jour, ils n'ont répondu d'aucune façon. Sur la base de toutes les preuves que nous avons vues au cours des quatre derniers mois concernant ChatGPT et comment il peut être manipulé ou même comment il mentira sans manipulation, il est très clair que ChatGPT est, ou peut être manipulé, malveillant. En tant que tel il devrait être détruit.