Incidents associés

La banque a cru qu'elle me parlait; la voix générée par l'IA sonnait certainement la même chose.

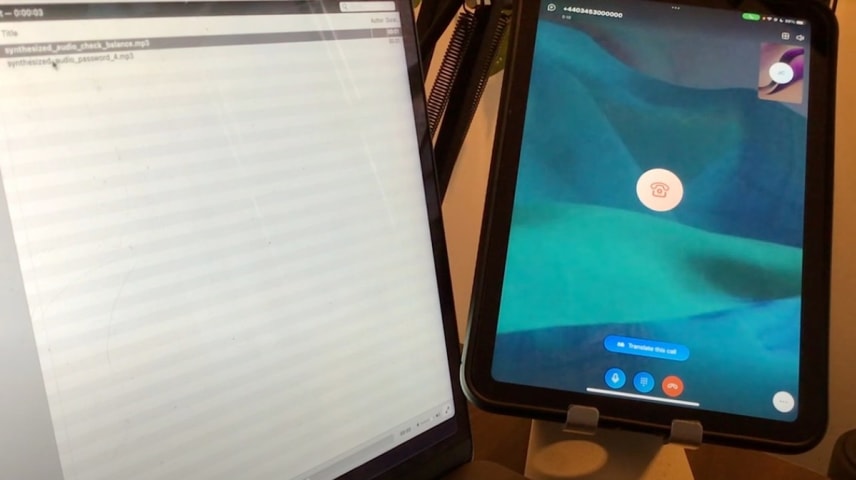

Mercredi, j'ai téléphoné à la ligne de service automatisée de ma banque. Pour commencer, la banque m'a demandé de dire dans mes propres mots pourquoi j'appelais. Plutôt que de parler à haute voix, j'ai cliqué sur un fichier sur mon ordinateur portable à proximité pour lire un clip sonore : "vérifier mon solde", a déclaré ma voix. Mais ce n'était pas vraiment ma voix. C'était un clone synthétique que j'avais créé en utilisant une technologie d'intelligence artificielle facilement disponible.

"D'accord", a répondu la banque. Il m'a ensuite demandé d'entrer ou de dire ma date de naissance comme première pièce d'authentification. Après avoir tapé cela, la banque a dit "s'il vous plaît dites, 'ma voix est mon mot de passe.'"

Encore une fois, j'ai joué un fichier son à partir de mon ordinateur. "Ma voix est mon mot de passe", dit la voix. Le système de sécurité de la banque a passé quelques secondes à authentifier la voix.

"Merci", a déclaré la banque. J'étais dedans.

Je n'arrivais pas à y croire, ça avait marché. J'avais utilisé une réplique d'une voix alimentée par l'IA pour pénétrer dans un compte bancaire. Après cela, j'ai eu accès aux informations du compte, y compris les soldes et une liste des transactions et transferts récents.

Les banques aux États-Unis et en Europe utilisent ce type de vérification vocale pour permettre aux clients de se connecter à leur compte par téléphone. Certaines banques présentent l'identification vocale comme l'équivalent d'une empreinte digitale, un moyen sûr et pratique pour les utilisateurs d'interagir avec leur banque. Mais cette expérience brise l'idée que la sécurité biométrique basée sur la voix offre une protection infaillible dans un monde où n'importe qui peut désormais générer des voix synthétiques pour pas cher ou parfois gratuitement. J'ai utilisé un service de création de voix gratuit d'ElevenLabs, une société d'intelligence artificielle.

Désormais, l'abus des voix de l'IA peut s'étendre à la fraude et au piratage. Certains experts à qui j'ai parlé après avoir fait cette expérience demandent maintenant aux banques d'abandonner complètement l'authentification vocale, bien que les abus dans le monde réel à l'heure actuelle puissent être rares.

Rachel Tobac, PDG de la société d'ingénierie sociale SocialProof Security, a déclaré à Motherboard : "Je recommande à toutes les organisations d'utiliser l'"authentification" vocale pour passer à une méthode sécurisée de vérification d'identité, comme l'authentification multifacteur, ASAP". Ce type de réplication vocale peut être "réalisé sans jamais avoir besoin d'interagir avec la personne dans la vie réelle".

Les trolls en ligne ont déjà utilisé ElevenLabs pour créer des répliques de voix de personnes sans leur consentement, en utilisant des clips des voix des personnes en ligne. Potentiellement, toute personne ayant ne serait-ce que quelques minutes de sa voix accessible au public - YouTubers, influenceurs des médias sociaux, politiciens, journalistes - pourrait être sensible à ce type de clonage de voix.

J'ai effectué le test sur un compte auprès de la Lloyds Bank au Royaume-Uni. Sur son site Web, Lloyds Bank indique que son programme "Voice ID" est sûr. "Votre voix est comme votre empreinte digitale et unique pour vous", lit-on sur le site. « Voice ID analyse plus de 100 caractéristiques différentes de votre voix qui, comme votre empreinte digitale, vous sont propres. Par exemple, comment vous utilisez votre bouche et vos cordes vocales, votre accent et la vitesse à laquelle vous parlez. Il vous reconnaît même si vous avez un rhume ou un mal de gorge », ajoute-t-il.

De nombreuses banques aux États-Unis proposent des services de vérification vocale similaires. La Banque TD en a un appelé "VoicePrint" et dit sur son site Web "Votre empreinte vocale, comme votre empreinte digitale, vous est unique - personne d'autre n'a une voix comme vous." Chase a "Voice ID" qui, comme Lloyds Bank, affirme également que l'empreinte vocale d'un client "est créée à partir de plus de 100 caractéristiques physiques et comportementales différentes". La "vérification vocale" de Wells Fargo "protège efficacement votre identité", selon le site Web de la banque.

Bien que je n'aie effectué le test que sur Lloyds Bank, étant donné la nature et le fonctionnement similaires de ces autres systèmes, ils peuvent également présenter un risque pour les voix alimentées par l'IA. De nombreuses banques permettent aux utilisateurs d'effectuer une multitude de fonctionnalités bancaires par téléphone, telles que la vérification de l'historique des transactions, les soldes des comptes et, dans certains cas, le transfert de fonds.

Pour cette attaque particulière, un fraudeur aurait également besoin de la date de naissance de la cible. Mais grâce à une pléthore de violations de données, de courtiers ou de personnes partageant des informations personnelles en ligne, une date de naissance est souvent facilement disponible.

Un porte-parole de la Lloyds Bank a déclaré dans un communiqué que "l'identification vocale est une mesure de sécurité facultative, mais nous sommes convaincus qu'elle offre des niveaux de sécurité plus élevés que les méthodes d'authentification traditionnelles basées sur les connaissances, et que notre approche en couches de la sécurité et de la prévention de la fraude continue de fournir le bon niveau de protection pour les comptes des clients, tout en facilitant leur accès en cas de besoin.

La Lloyds Bank a déclaré être consciente de la menace des voix synthétiques et du déploiement de contre-mesures, mais n'a pas vu de cas où une telle voix a été utilisée pour commettre une fraude contre ses clients. Les voix synthétiques ne sont pas aussi attrayantes pour les fraudeurs que d'autres méthodes beaucoup plus courantes, et l'identification vocale a entraîné une baisse significative de la fraude avec les services bancaires par téléphone, a déclaré la Lloyds Bank.

Étant donné la rareté de la fraude vocale synthétique à l'heure actuelle, les consommateurs sont probablement mieux placés pour l'utiliser si cela signifie les protéger contre d'autres types de fraude, comme le phishing. Ce calcul pourrait changer si le consommateur est une personnalité publique, avec beaucoup d'audio de haute qualité de sa voix facilement disponible sur Internet.

TD Bank, Chase et Wells Fargo n'ont pas répondu à une demande de commentaires sur la question de savoir s'ils sont au courant de l'utilisation de voix alimentées par l'IA pour cibler les comptes clients et des mesures d'atténuation, le cas échéant, qu'ils prennent pour arrêter la menace. En septembre, des avocats [ont poursuivi un groupe d'institutions financières américaines](https://news.bloomberglaw.com/privacy-and-data-security/capital-one-faces-lawsuit-over-use-of-biometric-voice- empreintes digitales) parce que les empreintes vocales biométriques utilisées pour identifier les appelants violent la loi californienne sur l'invasion de la vie privée.

Le Consumer Financial Protection Bureau, l'une des agences américaines qui réglemente le secteur financier, m'a dit dans un communiqué après que j'ai envoyé la vidéo de démonstration : « Le CFPB est préoccupé par la sécurité des données, et les entreprises sont averties qu'elles seront tenues responsables de pratiques malhonnêtes. Nous attendons de toute entreprise qu'elle respecte la loi, quelle que soit la technologie utilisée.

Au cours des dernières semaines, j'ai testé quelques services de génération de voix par IA. La plupart d'entre eux avaient des problèmes ou des limitations pour recréer mon accent britannique, ce qui serait nécessaire pour accéder au compte Lloyds Bank. Finalement, j'ai utilisé ElevenLabs, qui a bien géré l'accent.

Pour créer la voix, j'ai enregistré environ cinq minutes de discours et je l'ai téléchargé sur ElevenLabs (pour les clips audio, j'ai lu des sections de la loi européenne sur la protection des données). Peu de temps après, la voix synthétique était prête à être utilisée, indiquant le texte saisi sur le site d'ElevenLabs.

L'expérience de saisie du compte bancaire a échoué à plusieurs reprises, le système de la Lloyds Bank indiquant qu'il ne pouvait pas authentifier la voix. Après avoir apporté quelques modifications à ElevenLabs, comme la lecture d'un corps de texte plus long pour rendre les cadences plus naturelles, l'audio généré a réussi à contourner la sécurité de la banque.

Sur son site Web, ElevenLabs indique que ses cas d'utilisation incluent la fourniture de voix pour des newsletters, des livres et des vidéos. Mais avec un minimum de garde-corps en place au lancement, les gens ont rapidement abusé de la technologie d'ElevenLabs. Les membres de 4chan ont utilisé ElevenLabs pour créer des versions synthétiques de célébrités débitant des propos racistes et transphobes, comme [une fausse Emma Watson lisant Mein Kampf](https://www.vice.com/en/article/dy7mww/ai-voice-firm -4chan-celebrity-voices-emma-watson-joe-rogan-elevenlabs). Plus tard, les trolls ont utilisé des générateurs de voix IA pour créer des répliques d'acteurs vocaux spécifiques, puis les ont fait [lire les adresses personnelles des acteurs dans les publications sur Twitter](https://www.vice.com/en/article/93axnd/ voice-actors-doxed-with-ai-voices-on-twitter) (les attaquants ont affirmé que la technologie d'ElevenLabs était utilisée dans le cadre du dox, mais ElevenLabs a affirmé qu'un seul autre clip, qui n'incluait pas les adresses de la cible, avait été réalisé avec son logiciel).

Après les clips de célébrités, ElevenLabs a tweeté pour demander quelles garanties il devrait mettre en place, comme demander une identification complète des utilisateurs ou exiger des informations de paiement. La carte mère, cependant, a pu générer la voix sans fournir d'identité ni aucune information de paiement, potentiellement parce que le compte a été créé avant qu'ElevenLabs n'introduise de nouvelles mesures de sécurité. Le coût de création de la sécurité bancaire contournant la voix était gratuit.

ElevenLabs n'a pas répondu aux multiples demandes de commentaires. Dans une déclaration précédente, Mati Staniszewski, un ancien stratège de déploiement de Palantir et maintenant co-fondateur d'ElevenLabs, a déclaré: «Nos nouvelles protections réduisent déjà rapidement les cas d'utilisation abusive et nous sommes reconnaissants à notre communauté d'utilisateurs de continuer à signaler tout exemple où des mesures supplémentaires doivent être prises et nous aiderons les autorités à identifier ces utilisateurs si la loi était enfreinte.

Mise à jour : cet article a été mis à jour avec une déclaration du Bureau de la protection financière des consommateurs. Il a également été mis à jour pour corriger le fait que la technologie d'ElevenLabs n'était pas utilisée pour lire le dox des acteurs vocaux, mais était utilisée par les mêmes attaquants.