Incidents associés

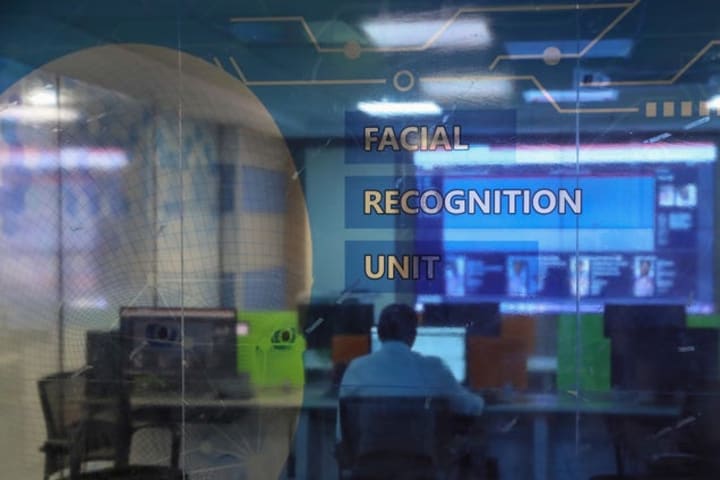

Un homme géorgien a été faussement arrêté en novembre après que des agents de la Louisiane ont utilisé un outil de reconnaissance faciale pour l'identifier comme un fugitif, selon [The Associated Press](https://apnews.com/article/technology-louisiana-baton-rouge-new -orleans-crime-50e1ea591aed6cf14d248096958dccc4). Des différences significatives dans les traits du visage et le poids ont conduit à la libération de l'homme. Cependant, cet incident indique une autre manière dont les officiers identifient à tort les suspects noirs.

Parfois, lorsque le lavabo automatique refuse de fonctionner ou que la reconnaissance faciale de l'iPhone ne se déverrouille pas, cela nous rappelle que la technologie a été conçue pour reconnaître la peau blanche. Maintenant, imaginez la même faille dans un outil utilisé pour arrêter des personnes pour un crime. Randall Reid, 28 ans, a été victime de ce bug. AP rapporte que Reid a été envoyé en prison dans le comté de Dekalb sur un mandat de fugitif pour un vol de sac à main qui s'est produit dans la paroisse de Jefferson en Louisiane.

"Qu'est-ce que la paroisse de Jefferson ?", a déclaré Reid via [Nola.com](https://www.nola.com/news/crime_police/jpso-used-facial-recognition-to-arrest-a-man-it-was -faux/article_0818361a-8886-11ed-8119-93b98ecccc8d.html). "Je n'ai jamais été en Louisiane un seul jour de ma vie. Puis ils m'ont dit que c'était pour vol. Donc non seulement je ne suis pas allé en Louisiane, mais je ne vole pas non plus.

La taupe de Reid sur son visage et la différence de 40 livres entre lui et le vrai voleur pris sur la caméra de surveillance ont poussé le shérif de la paroisse de Jefferson à annuler le mandat, selon l'avocat de Reid, Tommy Calogero.

Ce scénario n'est pas étranger. Il était une fois un homme noir qui a été arrêté sur mandat d'un homme blanc parce que ils avaient le même nom. Cependant, les disparités raciales dans la technologie doivent être abordées avant d'être lancées dans les communautés de couleur. En 2020, IBM, Amazon et Microsoft ont suspendu la vente de leurs appareils de reconnaissance faciale à la police en reconnaissant que leur technologie appliquait les abus de la police dans les communautés noires, selon l'[ACLU](https://www.aclu.org/news/privacy -technologie/comment-est-la-reconnaissance-visage-surveillance-technologie-raciste). San Francisco et plusieurs villes du Massachusetts ont interdit l'utilisation de la technologie de reconnaissance faciale par les services de police pour la même raison, selon [WBUR](https://www.wbur.org/news/2020/06/23/boston-facial- reconnaissance-interdiction).

De plus, ce problème remonte très loin à l'esclavage (n'est-ce pas tout ? ). Dans un rapport de Harvard University, Alex Najibi écrit que les lois lanternes obligeant les esclaves à porter des lumières la nuit étaient en fait une version de la reconnaissance faciale. Il se souvient ensuite de la surveillance par le FBI de nos leaders noirs des droits civiques ou de la surveillance par l'ICE des immigrants sans papiers et des citoyens musulmans.

En savoir plus sur la technologie anti-noire de Science in the News de l'Université de Harvard :

Des pratiques discriminatoires en matière d'application de la loi ont été mises en évidence à la suite du meurtre de George Floyd par le PD de Minneapolis. Les Noirs américains sont plus susceptibles d'être arrêtés et incarcérés pour des délits mineurs que les Blancs américains. Par conséquent, les Noirs sont surreprésentés dans les données de mugshot, que la reconnaissance faciale utilise pour faire des prédictions. La présence de Noirs dans de tels systèmes crée une boucle en aval dans laquelle les stratégies policières racistes conduisent à des arrestations disproportionnées de Noirs, qui sont ensuite soumis à une surveillance future. Par exemple, le NYPD maintient une base de données de 42 000 "affiliés à des gangs" - 99% Noirs et Latinx - sans obligation de prouver l'affiliation présumée à un gang. En fait, certains services de police utilisent l'identification des membres de gangs comme mesure de productivité, encourageant les faux rapports. Pour les participants, l'inclusion dans ces bases de données de surveillance peut entraîner des peines plus sévères et des cautions plus élevées, voire le refus total de la caution.

La technologie de pointe peut sembler être un moyen pratique ou efficace de faire un travail. Mais cela ne sert à rien s'il est entaché de préjugés raciaux. Non seulement les Blancs mélangent les Noirs entre eux. Maintenant, les ordinateurs aussi.