Problème 2339

Les chercheurs ont récemment appris que les services de l'immigration et des douanes [utilisaient la reconnaissance faciale](https://www.nytimes.com/2019/07/07/us/politics/ice-drivers-licenses-facial-recognition.html?smid=nytcore- ios-share) sur des millions de photographies de permis de conduire à l'insu des titulaires de permis, la dernière révélation sur les gouvernements utilisant la technologie d'une manière qui menace les libertés civiles.

Mais le potentiel de surveillance de la reconnaissance faciale - sa capacité à créer une "ligne perpétuelle" - n'est pas la seule source de préoccupation. Les frontières technologiques explorées par des chercheurs douteux et des start-up sans scrupules rappellent les pseudosciences discréditées de la physionomie et de la phrénologie, qui prétendent utiliser la structure du visage et la forme de la tête pour évaluer le caractère et la capacité mentale.

L'intelligence artificielle et l'informatique moderne donnent une nouvelle vie et un vernis d'objectivité à ces théories démystifiées, qui étaient autrefois utilisées pour légitimer l'esclavage et perpétuer la «science» raciale nazie. Ceux qui souhaitent répandre les théories essentialistes de la hiérarchie raciale sont attentifs. Dans un blog, par exemple, un nationaliste blanc contemporain a affirmé que "la physionomie est réelle" et "doit redevenir un domaine légitime de recherche scientifique".

Plus largement, les nouvelles applications de la reconnaissance faciale - non seulement dans la recherche universitaire, mais aussi dans les produits commerciaux qui tentent de deviner les émotions à partir des expressions faciales - font écho au même essentialisme biologique derrière la physionomie. Apparemment, nous n'avons toujours pas appris que les visages ne contiennent pas une vérité plus profonde sur les personnes auxquelles ils appartiennent.

Photographies composites, nouvelles et anciennes

L'un des pionniers de l'analyse faciale du XIXe siècle, Francis Galton, était un eugéniste britannique de premier plan. Il superpose des images d'hommes reconnus coupables de crimes, tentant de retrouver à travers des « statistiques picturales » l'essence du visage criminel.

Galton a été déçu des résultats : il était incapable de discerner un « type » criminel à partir de ses photographies composites. C'est parce que la physionomie est une science de pacotille - la criminalité n'est inscrite ni dans les gènes ni sur le visage. Il a également essayé d'utiliser des portraits composites pour déterminer le "type" idéal de chaque race, et ses recherches ont été citées par Hans F.K. Günther, un eugéniste nazi qui a écrit un livre qui devait être lu dans les écoles allemandes pendant le Troisième Reich.

Les outils et les idées de Galton se sont révélés étonnamment durables, et les chercheurs modernes se demandent à nouveau si la criminalité peut être lue sur le visage. Dans un [article de 2016] très contesté (https://www.semanticscholar.org/paper/Automated-Inference-on-Criminality-using-Face-Wu-Zhang/1cd357b675a659413e8abf2eafad2a463272a85f), des chercheurs d'une université chinoise ont affirmé avoir formé un algorithme pour distinguer les portraits criminels des non-criminels, et que "la courbure des lèvres, la distance du coin interne des yeux et le soi-disant angle nez-bouche" pourraient aider à les distinguer. L'article comprend des "visages moyens" de criminels et de non-criminels qui rappellent les portraits composites de Galton.

L'article fait écho à bon nombre des idées fausses des recherches de Galton : que les personnes reconnues coupables de crimes sont représentatives de ceux qui les commettent (le système judiciaire fait preuve d'un profond préjugé), que le concept de « criminalité » innée est valable (les circonstances de la vie façonnent considérablement la probabilité d'être commettre un crime) et que l'apparence du visage est un prédicteur fiable du caractère.

Il est vrai que les humains ont tendance à s'entendre sur ce à quoi ressemble un visage menaçant. Mais Alexander Todorov, psychologue à Princeton, écrit dans son livre "Face Value" que la relation entre un visage et notre sentiment qu'il est menaçant (ou amical) est "entre l'apparence et les impressions, pas entre l'apparence et le caractère". La tentation de penser que nous pouvons lire quelque chose de plus profond à partir de ces stéréotypes visuels est erronée, mais persistante.

En 2017, le professeur de Stanford Michal Kosinski était l'auteur d'une étude prétendant avoir inventé une I.A. "gaydar" qui pouvait, lorsqu'il était présenté avec des photos d'hommes homosexuels et hétéros, déterminer lesquels étaient homosexuels avec une précision de 81%. (Il a déclaré à The Guardian que la reconnaissance faciale pourrait être utilisée à l'avenir pour prédire le Q.I. ainsi que.)

L'article se demande si les différences de structure faciale entre les hommes homosexuels et hétéros pourraient résulter d'une sous-exposition aux hormones mâles, mais néglige une explication plus simple, ont écrit Blaise Agüera y Arcas et Margaret Mitchell, A.I. des chercheurs de Google et le Dr Todorov dans un article Medium. La recherche s'est appuyée sur des images de sites de rencontres. Il est probable que les homosexuels et les hétéros se présentent différemment sur ces sites, de la coiffure au degré de bronzage en passant par l'angle sous lequel ils prennent leurs selfies, ont déclaré les critiques. Mais l'article se concentre sur des idées qui rappellent la théorie discréditée de l'inversion sexuelle, qui soutient que l'homosexualité est une « inversion » innée des caractéristiques de genre – les homosexuels ayant des qualités féminines, par exemple.

"L'utilisation d'un langage et de mesures scientifiques n'empêche pas un chercheur de mener des expériences erronées et de tirer des conclusions erronées, en particulier lorsqu'elles confirment des idées préconçues", ont écrit les critiques dans [another post](https://medium.com/@blaisea/physiognomys- vêtements-neufs-f2d4b59fdd6a).

Échos du passé

Les parallèles entre la technologie moderne et les applications historiques abondent. Un livre de phrénologie de 1902 a montré comment distinguer un "véritable mari" d'un "non fiable" en fonction de la forme de sa tête ; Aujourd'hui, une start-up israélienne appelée Faception utilise l'apprentissage automatique pour marquer des images faciales en utilisant des types de personnalité tels que "chercheur universitaire", "promoteur de marque", "terroriste" et "pédophile".

Les supports marketing de Faception sont presque comiques dans leur réduction des personnalités à huit stéréotypes, mais l'entreprise semble avoir des clients, indiquant un intérêt à "légitimer ce type d'IA". système », a déclaré Clare Garvie, chercheuse en reconnaissance faciale à Georgetown Law.

"À certains égards, ils sont risibles", a-t-elle déclaré. "D'une autre manière, la partie même qui les rend risibles est ce qui les rend si préoccupants."

Au début du XXe siècle, Katherine M.H. Blackford a préconisé d'utiliser l'apparence physique pour sélectionner parmi les candidats à un emploi. Elle a préféré analyser les photographies plutôt que les interviews pour révéler le caractère, écrit le Dr Todorov. Aujourd'hui, la société HireVue vend une technologie qui utilise l'I.A. analyser des vidéos de candidats à un emploi ; la plate-forme les note sur des mesures telles que «stabilité personnelle» et «conscience et responsabilité».

Cesare Lombroso, un éminent physionomiste italien du XIXe siècle, a proposé de séparer les enfants qu'il jugeait intellectuellement inférieurs, sur la base des mensurations du visage et du corps, de leurs «compagnons mieux dotés». Aujourd'hui, des programmes de reconnaissance faciale sont mis à l'essai dans des universités américaines et écoles chinoises pour surveiller les émotions et l'engagement des élèves. Ceci est problématique pour une myriade de raisons : des études n'ont montré aucune corrélation entre l'engagement des élèves et l'apprentissage réel, et les enseignants sont plus susceptibles de voir les visages des étudiants noirs comme en colère, un parti pris qui pourrait se glisser dans un système automatisé.

Classement et surveillance

Les similitudes entre l'analyse faciale moderne basée sur l'IA et son itération analogique antérieure sont étranges. Les deux, par exemple, ont pour origine des tentatives de traquer les criminels et les cibles de sécurité.

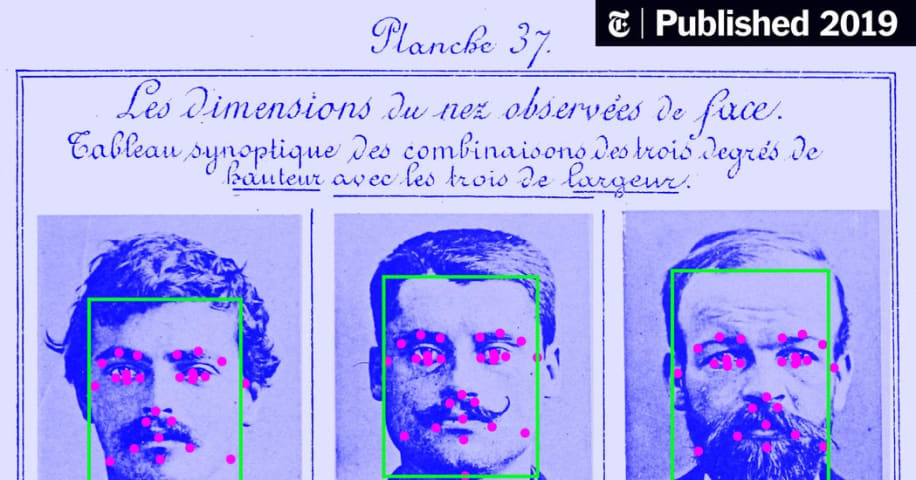

Alphonse Bertillon, policier français et pionnier de l'analyse faciale, voulait identifier les récidivistes. Il a inventé le mug shot et a noté des mesures corporelles spécifiques comme la longueur de la tête sur ses "cartes Bertillon". Avec des dossiers de plus de 100 000 prisonniers recueillis entre 1883 et 1893, il a identifié 4 564 récidivistes.

Le système de classification de Bertillon a été remplacé par un système d'empreintes digitales plus efficace, mais l'idée de base - utiliser des mesures corporelles pour identifier les personnes au service d'un appareil de renseignement - renaît avec la reconnaissance faciale moderne. Les progrès de la reconnaissance faciale assistée par ordinateur ont été stimulés par les investissements militaires et [les concours gouvernementaux] (https://www.nist.gov/programs-projects/face-challenges). (L'intérêt d'un directeur de la C.I.A. pour la technologie a augmenté d'un film de James Bond — il a demandé à son équipe d'enquêter sur la reconnaissance faciale après l'avoir vu utilisé dans le film de 1985 "A View to Kill".)

Les premiers logiciels de reconnaissance faciale développés dans les années 1960 ressemblaient à une version assistée par ordinateur du système de Bertillon, obligeant les chercheurs à identifier manuellement des points comme le centre de l'œil d'un sujet (à un rythme d'environ 40 images par heure). À la fin des années 1990, les algorithmes pouvaient cartographier automatiquement les traits du visage - et suralimentés par les ordinateurs, ils pouvaient scanner des vidéos en temps réel.

Beaucoup de ces algorithmes sont formés sur des personnes qui n'ont pas ou ne pouvaient pas consentir à ce que leur visage soit utilisé. IBM a pris des photos publiques de Flickr pour alimenter les programmes de reconnaissance faciale. L'Institut national des normes et de la technologie, une agence gouvernementale, héberge une base de données de photos d'identité et d'images de personnes décédées. "Les données hantées persistent aujourd'hui", a déclaré Joy Buolamwini, une spécialiste du M.I.T. chercheur, dans un courriel.

Intelligence émotionnelle"

Les services d'analyse faciale sont disponibles dans le commerce auprès de fournisseurs comme Amazon et Microsoft. N'importe qui peut les utiliser à un prix nominal - Amazon facture un dixième de centime pour traiter une image - pour deviner l'identité, le sexe, l'âge et l'état émotionnel d'une personne. D'autres plates-formes comme Face ++ devine la course aussi.

Mais ces algorithmes ont des problèmes documentés avec des visages non blancs et non masculins. Et l'idée que A.I. peut détecter la présence d'émotions - le plus souvent le bonheur, la tristesse, la colère, le dégoût et la surprise - est particulièrement difficile. Les clients ont utilisé la "reconnaissance de l'affect" pour tout, depuis la mesure de la réaction des gens aux publicités jusqu'à aider les enfants autistes à développer des compétences sociales et émotionnelles, mais un rapport de l'A.I. Now Institute soutient que la technologie est «appliquée de manière contraire à l'éthique et irresponsable».

La reconnaissance de l'affect s'inspire des travaux de Paul Ekman, un psychologue moderne qui a soutenu que les expressions faciales sont un moyen objectif de déterminer l'état émotionnel intérieur d'une personne et qu'il existe un ensemble limité de catégories émotionnelles de base qui sont fixées à travers les cultures. Son travail suggère que nous ne pouvons pas nous empêcher de révéler ces émotions. Cette théorie a inspiré l'émission télévisée "Lie to Me", sur un scientifique qui aide les forces de l'ordre en interprétant les expressions de suspects imprévisibles.

Les travaux du Dr Ekman ont été critiqués par des universitaires qui affirment que les émotions ne peuvent pas être réduites à des catégories aussi facilement interprétables et pratiques sur le plan informatique. Les algorithmes qui utilisent ces catégories simplistes sont "susceptibles de reproduire les erreurs d'un paradigme scientifique dépassé", selon l'A.I. Maintenant signalez.

De plus, il n'est pas difficile de passer de l'interprétation des résultats de l'analyse faciale comme "à quel point ce visage apparaît" au plus simple mais inexact "à quel point cette personne se sent" ou même "à quel point cette personne est vraiment heureuse, malgré ses efforts pour masquer ses émotions. » Comme l'A.I. Maintenant, le rapport indique que la reconnaissance de l'affect "soulève des questions éthiques troublantes sur la localisation de l'arbitre du caractère et des émotions" réels "de quelqu'un en dehors de l'individu".

Nous sommes déjà venus ici. Tout comme les technologies de la photographie et des portraits composites du XIXe siècle ont prêté «l'objectivité» à la physionomie pseudoscientifique, aujourd'hui, les ordinateurs et l'intelligence artificielle éloignent l'analyse faciale du jugement et des préjugés humains. En réalité, les algorithmes qui reposent sur une compréhension erronée des expressions et des émotions peuvent simplement rendre les préjugés plus difficiles à repérer.

Dans son livre, le Dr Todorov parle du physicien allemand Georg Christoph Lichtenberg, un sceptique de la physionomie du XVIIIe siècle qui pensait que la pratique "autorisait simplement nos impulsions naturelles à former des impressions à partir de l'apparence".

Si la physionomie gagne du terrain, "on pendra les enfants avant qu'ils n'aient accompli les actes qui méritent la potence", a écrit Lichtenberg, mettant en garde contre un "auto-da-fé physionomique".

Au fur et à mesure que la technologie de reconnaissance faciale se développe, nous serions avisés de tenir compte de ses paroles.