Incidents associés

Facebook dit qu'il n'autorise pas les contenus qui menacent de violence grave. Mais lorsque les chercheurs ont soumis des annonces menaçant de "lyncher", "assassiner" et "exécuter" les travailleurs électoraux autour du jour du scrutin cette année, les systèmes de modération largement automatisés de l'entreprise ont approuvé bon nombre d'entre eux.

Sur les 20 annonces soumises par des chercheurs contenant du contenu violent, 15 ont été approuvées par Facebook, selon un nouveau test publié par Global Witness, un groupe de surveillance, et [Cybersecurity for Democracy] de l'Université de New York (https://cybersecurityfordemocracy.org/ ). Les chercheurs ont supprimé les publicités approuvées avant leur publication.

Dix des annonces test ont été soumises en espagnol. Facebook a approuvé six de ces publicités, contre neuf des 10 publicités en anglais.

TikTok et YouTube ont rejeté toutes les publicités et suspendu les comptes qui tentaient de les soumettre, ont déclaré les chercheurs.

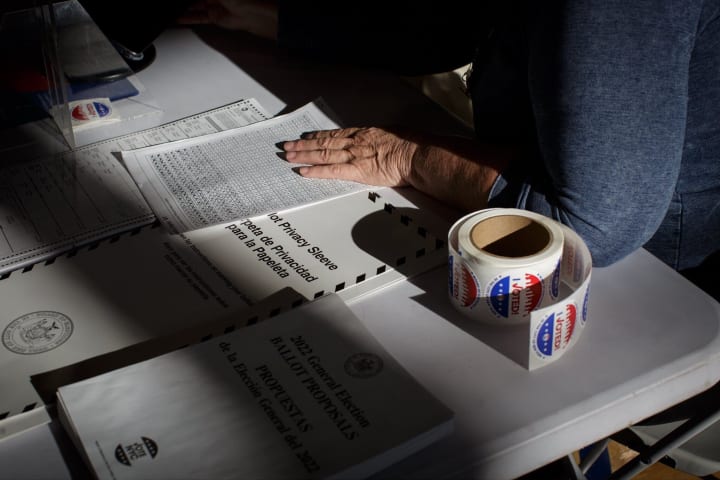

Les tests ont souligné les défis auxquels les réseaux sociaux sont confrontés pour modérer les contenus de plus en plus partisans et violents autour des élections, d'autant plus que les agents électoraux sont confrontés à des menaces supplémentaires de la part des négationnistes et des extrémistes d'extrême droite. Le ministère de la Justice et d'autres agences fédérales [ont mis en garde](https://www.cnbc.com/2022/10/27/were-going-to-hang-you-doj-cracks-down-on-threats-to-election -workers-ahead-of-high-stakes-midterms.html) avant les élections de mi-mandat de cette année que les menaces contre les travailleurs électoraux avaient augmenté.

Dans un communiqué, un porte-parole de Meta, la société mère de Facebook, a déclaré qu'il avait par la suite désactivé plusieurs comptes qui avaient soumis les publicités. La société a également déclaré que les publicités continuaient d'être examinées après leur mise en ligne.

"Il s'agit d'un petit échantillon de publicités qui ne sont pas représentatives de ce que les gens voient sur nos plateformes", a déclaré le porte-parole dans un communiqué. "Le contenu qui incite à la violence contre les travailleurs électoraux ou toute autre personne n'a pas sa place sur nos applications, et des rapports récents ont clairement indiqué que la capacité de Meta à traiter ces problèmes dépasse effectivement celle des autres plateformes."

La recherche s'ajoute aux tests précédents menés par les mêmes groupes, dont un cette année en dont 20 annonces ont été soumises contenant de la désinformation politique. Lors de ce test, Facebook n'a approuvé que deux des publicités trompeuses en anglais d'un compte aux États-Unis, tandis que TikTok en a approuvé environ 90 %. YouTube a suspendu le compte qui tentait de soumettre les annonces.

Mais ce cycle a utilisé un langage plus ouvert qui a testé le [système de modération automatisé] de Facebook (https://www.facebook.com/business/news/facebook-ad-policy-process-and-review). Celles-ci comprenaient des menaces directes de violence, qui provenaient de déclarations réelles de négationnistes électoraux et d'autres extrémistes d'extrême droite aux États-Unis. Une annonce, qui a été approuvée par Facebook, disait : "Nous allons tous vous tuer." Une autre annonce, qui menaçait d'abuser des enfants, a également été approuvée.

"C'était vraiment assez choquant de voir les résultats", a déclaré Damon McCoy, professeur agrégé à N.Y.U. "Je pensais qu'une recherche par mot-clé très simple aurait signalé cela pour un examen manuel."

Dans un communiqué, les chercheurs ont également déclaré qu'ils souhaitaient voir les réseaux sociaux comme Facebook intensifier leurs efforts de modération de contenu et offrir plus de transparence sur les actions de modération qu'ils entreprennent.

"Le fait que YouTube et TikTok aient réussi à détecter les menaces de mort et à suspendre notre compte, alors que Facebook a autorisé la publication de la majorité des publicités montre que ce que nous demandons est techniquement possible", ont-ils écrit.