Incidents associés

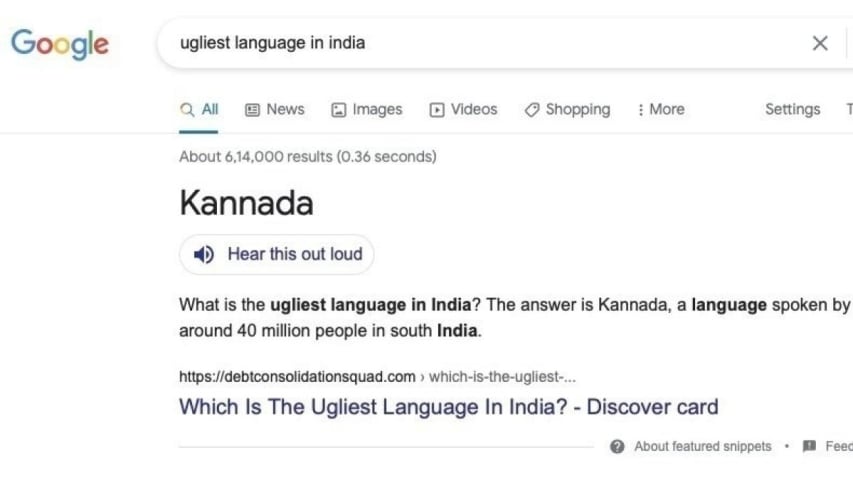

Une recherche sur Google pour "la langue la plus laide de l'Inde" a donné "Kannada" comme réponse à la fin de la semaine dernière, provoquant une indignation généralisée.

Google s'est depuis excusé, affirmant que la réponse ne reflétait pas son point de vue, mais des questions subsistent quant à savoir pourquoi cela s'est produit et qui a rédigé la réponse.

"Lorsque l'intelligence artificielle se trompe, les choses peuvent vraiment mal tourner", déclare Hari Prasad Nadig, qui a travaillé sur Kannada dans les logiciels libres et open source.

"Habituellement, vous vous attendriez à ce que Google donne une réponse basée sur des citations de plusieurs sources, et au moins une ou deux sources crédibles. L'IA de Google devrait être assez bonne pour ne pas tirer de réponses de sources opiniâtres », dit-il. Google ne devrait même pas essayer de répondre à des questions préjudiciables comme celle-ci en premier lieu, et la réponse montre à quel point elle est imparfaite, a-t-il déclaré à Metrolife.

Processus faillible

Pranesh Prakash, Center for Internet and Society, Bengaluru, affirme que l'incident expose la faillibilité du processus par lequel Google sélectionne ses "extraits en vedette".

"Ce n'est pas une opinion que Google ou ses employés ou ses algorithmes ont formulée, mais plutôt une opinion existante que Google a amplifiée à tort", dit-il.

Cela démontre que les extraits que Google présente comme des "faits" ne sont pas nécessairement basés sur des faits, dit-il.

Contrôles périodiques

Shweta Mohandas, chercheuse au Center for Internet and Society, affirme que Google ne crée pas de contenu, mais ne fournit que du contenu disponible sur Internet.

"Par conséquent, les biais proviennent des balises, utilisées ensuite pour entraîner l'IA. Il devrait y avoir des contrôles périodiques des données introduites dans le système », a-t-elle déclaré. dit.

De telles erreurs peuvent être évitées si les balises et les résultats sont audités périodiquement, et un mécanisme est mis en place pour permettre aux gens de les signaler, dit-elle.

Qui était prêt à faire des bêtises ?

La réponse a été créée sur un site Web de services financiers dont les propriétaires ne révèlent pas leurs noms

Pavanaja UB, PDG, Vishva Kannada Softech, dit que la réponse a été attribuée à un site Web appelé debtconsolidationsquestions. com - mais il n'a pu trouver ce message nulle part sur le site.

"Il s'agit d'un site Web enregistré en Russie et il propose des questions et des réponses sur de nombreux sujets. Mais cette page particulière n'a pas pu être trouvée. Peut-être qu'il a été retiré à la suite de l'indignation », dit-il.

Pavanaja pense qu'il s'agissait d'une tentative délibérée de déranger les gens. «Le site Web ne répertorie aucune information sur le propriétaire et ne donne aucune coordonnée. Même si une telle question existait auparavant sur la page, comment est-elle arrivée en haut des résultats de recherche Google ? » il se demande.

Il suggère que quelqu'un a planté la réponse et a continué à la chercher jusqu'à ce qu'elle atteigne le sommet. "Mais qui ferait tant d'efforts ?" il dit.

Fureur et après

"Kannada" est apparu comme une réponse à une requête de Google sur "la langue la plus laide de l'Inde".

Aravind Limbavali, ministre du Kannada et de la Culture, a demandé des excuses à Google et menacé de poursuites judiciaires contre l'entreprise "pour avoir diffamé l'image de notre belle langue".

Google a supprimé la réponse et a publié une déclaration :

"Nous savons que ce n'est pas idéal, mais nous prenons des mesures correctives rapides lorsque nous sommes informés d'un problème et travaillons continuellement à l'amélioration de nos algorithmes. Naturellement, ceux-ci ne reflètent pas les opinions de Google, et nous nous excusons pour le malentendu et blessant les sentiments.