Incidents associés

Une petite expérience d'un chercheur en intelligence artificielle soulève des questions sur la façon dont l'algorithme de recommandation de TikTok suggère de nouveaux créateurs aux utilisateurs.

Plus précisément, la question est de savoir si cet algorithme trie les suggestions en fonction de la race du créateur – ce que TikTok nie faire intentionnellement. Mais c'est un autre exemple de la nécessité d'un examen plus approfondi de la manière dont l'application et les autres plateformes de médias sociaux promeuvent des créateurs ou des contenus particuliers.

Marc Faddoul est chercheur à la University of California Berkeley School of Information qui étudie l'IA et la désinformation. Il vérifiait TikTok pour rechercher de la désinformation quand il a remarqué quelque chose curieux de savoir comment le l'application recommande aux nouveaux créateurs de suivre.

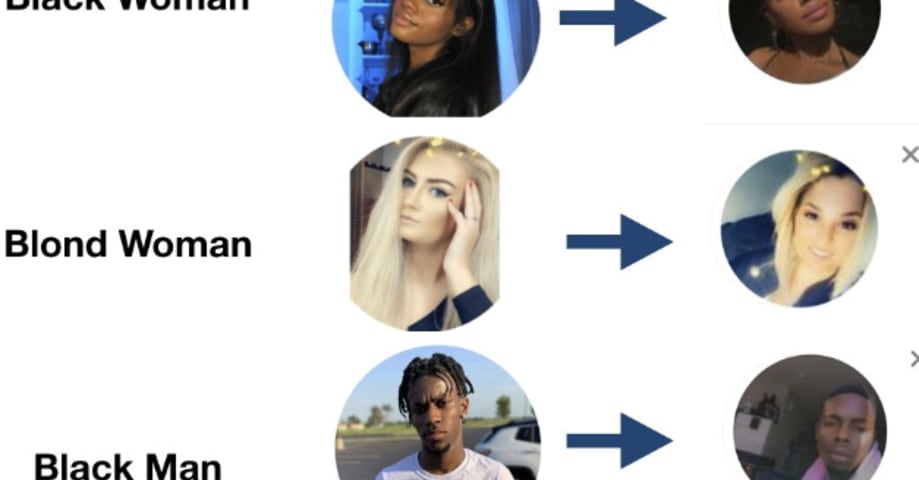

Dans l'application, lorsqu'une personne suit un nouveau compte, elle peut cliquer sur une flèche qui recommande ensuite d'autres comptes à suivre. Faddoul a remarqué que lorsqu'il faisait cela, les comptes recommandés avaient tendance à ressembler à ceux qu'il venait de suivre - jusqu'à l'origine ethnique et la couleur des cheveux.

"J'ai vu ce schéma très clair qui se produisait", a-t-il déclaré à BuzzFeed News. "Lorsque vous suivez un compte, les suggestions sont très similaires."

Il a créé un nouveau compte pour l'essayer à nouveau, et voici ses résultats :

Faddoul a averti qu'il s'agissait d'une expérience occasionnelle, pas d'une recherche réelle, mais il a déclaré que les résultats étaient toujours intéressants.

BuzzFeed News a tenté une expérience similaire avec un nouveau compte et a obtenu des résultats similaires.

Suite au créateur du hijabi @jiggybush, l'application a recommandé d'autres femmes qui portent un hijab.

Au début, Faddoul soupçonnait que TikTok utilisait une technologie d'intelligence artificielle qui étudiait les photos de profil des personnes lors de la formulation de recommandations. D'autres entreprises technologiques, comme Netflix, l'utilisent pour déterminer sur quelles vignettes un utilisateur est le plus susceptible de cliquer. C'est pourquoi la page d'accueil Netflix d'une personne peut avoir des images différentes de celles d'une autre personne pour promouvoir la même émission.

Mais, selon TikTok, il existe une réponse simple aux questions soulevées par Faddoul.

TikTok a déclaré à BuzzFeed News qu'il utilise ce qu'on appelle le filtrage collaboratif. Fondamentalement, l'application recommande de nouveaux comptes en fonction desquels les personnes qui suivent cet utilisateur suivent également.

"Nous n'avons pas été en mesure de reproduire des résultats similaires à ces affirmations", a déclaré un porte-parole de TikTok à BuzzFeed News.

"Notre recommandation de comptes à suivre est basée sur le comportement des utilisateurs : les utilisateurs qui suivent le compte A suivent également le compte B, donc si vous suivez A, vous voudrez probablement également suivre B."

Cela explique aussi pourquoi, en suivant un grand créateur comme Addison Rae, l'application recommande d'autres créateurs de la Hype House, plutôt que des créateurs qui ressemblent à Rae.

Ou, dans un autre exemple, suivre un artiste renvoie des recommandations pour d'autres artistes.

C'est un système classique utilisé par les entreprises technologiques de YouTube à Netflix, mais cela ne veut pas dire qu'il n'est pas sans problèmes, a déclaré Faddoul.

"Le filtrage collaboratif peut également reproduire tout biais dans le comportement des gens", a-t-il déclaré.

"Les gens qui ont tendance à aimer les adolescentes blondes ont tendance à aimer beaucoup d'autres adolescentes blondes. En ce sens, c'est plutôt normal."

Cela signifie que TikTok a recommandé le compte test de BuzzFeed News aux femmes qui portent des hijabs parce que les personnes qui suivent un hijabi ont tendance à suivre d'autres hijabis.

Mais, a déclaré Faddoul, cela peut créer une boucle de rétroaction où les gens ne sont jamais recommandés qu'à un type particulier de créateur, ce qui entraîne un manque de diversité dans leur flux.

Par exemple, a-t-il dit, si les créateurs les plus populaires sur une plate-forme sont blancs et que l'application continue de recommander d'autres créateurs blancs, il est difficile pour les créateurs de couleur de gagner des abonnés et de gagner en popularité, même si ce n'est pas l'intention de l'algorithme.

"Ensuite, cela signifie qu'il est plus facile pour un Blanc d'être recommandé que pour quelqu'un d'une minorité sous-représentée", a-t-il déclaré. "C'est donc quelque chose qui peut se produire, indépendamment de sa caractéristique faciale ou du filtrage collaboratif."

Bien sûr, ce n'est pas propre à TikTok. Toutes les plateformes de médias sociaux qui utilisent des algorithmes peuvent créer des bulles où les gens ne voient que du contenu qui confirme leurs préjugés. Pensez, par exemple, à la façon dont un flux Facebook peut être biaisé en faveur d'un point de vue politique particulier.

"Ce n'est pas une méthodologie de recherche scientifique, juste des preuves anecdotiques qui mettent en évidence un phénomène qui semble assez clair et distinct et encourage une enquête plus approfondie", a déclaré Faddoul.