Incidents associés

Des contenus potentiellement dangereux auraient à nouveau échappé aux algorithmes de modération sur YouTube.

Selon un rapport du Telegraph lundi, YouTube recommande des vidéos contenant des images graphiques d'automutilation aux utilisateurs dès l'âge de 13 ans.

Le rapport affirme qu'au moins une douzaine de vidéos contenant les images graphiques existent encore sur YouTube aujourd'hui, même si la politique de la plate-forme vidéo est d'interdire les vidéos faisant la promotion de l'automutilation ou du suicide.

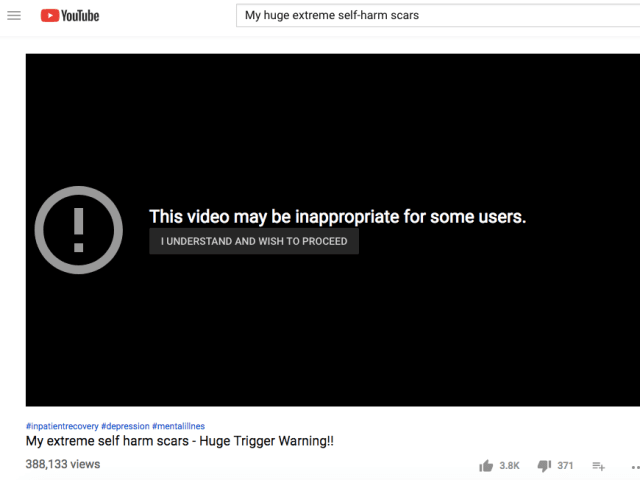

YouTube aurait supprimé au moins deux vidéos signalées par The Telegraph, mais d'autres – dont une intitulée "Mes énormes cicatrices d'automutilation extrême" – subsistent.

En réponse au rapport du Telegraph, YouTube a déclaré qu'il supprimait les vidéos qui promeuvent l'automutilation (qui enfreignent ses conditions d'utilisation), mais qu'il peut autoriser d'autres personnes qui offrent un soutien.

Le Telegraph a également trouvé des recommandations de termes de recherche tels que "tutoriel sur l'automutilation", "les filles qui s'automutilent" et "le guide de l'automutilation". Ces recommandations ont été supprimées par YouTube une fois que la société en a été informée, selon le rapport.

"Nous savons que de nombreuses personnes utilisent YouTube pour trouver des informations, des conseils ou de l'aide, parfois dans les circonstances les plus difficiles. Nous travaillons dur pour nous assurer que nos plateformes ne sont pas utilisées pour encourager des comportements dangereux", a déclaré un porte-parole de YouTube à Business Insider dans un communiqué. "Pour cette raison, nous avons des politiques strictes qui interdisent les vidéos faisant la promotion de l'automutilation et nous supprimerons les vidéos signalées qui enfreignent cette politique."

YouTube renvoie des numéros que les utilisateurs peuvent appeler ou envoyer par SMS pour obtenir de l'aide lorsque des termes de recherche tels que "suicide" ou "automutilation" sont saisis.

YouTube a longtemps eu du mal à modérer les contenus dérangeants et dangereux sur sa plate-forme.

En décembre dernier, le Times de Londres a trouvé the company failed to remove vidéos d'exploitation d'enfants en temps opportun. En janvier, YouTube a fait face à une vague de "défis Bird Box" inspirés du drame Netflix où les téléspectateurs - dont l'une des plus grandes célébrités de la plateforme, [Jake Paul](https://www.theverge.com/2019/1/7/18172657 /jake-paul-bird-box-challenge-youtube-blindfold-netflix) - se mettent dans des situations dangereuses les yeux bandés. YouTube a forcé Paul à retirer sa vidéo et a donné [au reste de la communauté](https://www.businessinsider.com/youtube-updated-its-guidelines-to-ban-dangerous-pranks-and-challenges-2019- 1) deux mois pour le faire eux-mêmes.

Et puis il y a les vidéos sur la théorie du complot, comme si la Terre était plate et d'autres potentiellement plus nocives comme les faux remèdes pour les maladies graves. Fin janvier, YouTube l'a dit [recommanderait moins](https://www. businessinsider.com/youtube-to-recommend-fewer-conspiracy-theory-videos-2019-1) contenu "borderline", et qu'il pense avoir créé une meilleure solution pour les empêcher de se propager.