Incidents associés

À l'été 2017, Eric Horvitz a activé la fonction Autopilot de sa berline Tesla. Ne pas avoir à se soucier de diriger la voiture le long d'une route sinueuse à Redmond, Washington, a permis à Horvitz de mieux se concentrer sur l'appel qu'il prenait avec une organisation à but non lucratif qu'il avait cofondée. Le sujet de l'appel ? L'éthique et la gouvernance de l'IA.

C'est alors que l'IA de Tesla l'a laissé tomber.

Les deux pneus du côté conducteur ont heurté un trottoir jaune surélevé au milieu de la route, déchiquetant les pneus instantanément et forçant Horvitz à reprendre rapidement le contrôle du véhicule. Parce que la voiture ne s'était pas correctement centrée, Horvitz s'est retrouvé debout sur le trottoir, regardant un camion remorquer sa Tesla.

Mais ce qui lui préoccupait surtout, c'était le fait que les entreprises utilisant l'IA devaient envisager de nouveaux défis en matière d'éthique et de sécurité. Et Horvitz n'est pas seul. De nouveaux groupes de réflexion, groupes industriels, instituts de recherche et organisations philanthropiques ont vu le jour, tous soucieux de fixer des limites éthiques autour de l'IA.

Le secteur automobile est en proie à des énigmes éthiques. Considérez-les (et réalisez qu'ils ne sont que la pointe de l'iceberg):

Lors de la programmation de la manière dont une voiture doit réagir à un accident imminent, quels sont les intérêts les plus importants à prendre en compte — le conducteur de la voiture, le conducteur de la voiture qui approche ou les compagnies d'assurance de l'un ou de l'autre ? L'IA d'une automobile devrait-elle être programmée pour minimiser les pertes de vie, même si cela signifie sacrifier son propre conducteur pour sauver plusieurs vies dans un autre véhicule ? Comment la préservation de la propriété privée ou publique entre-t-elle en jeu lors de la programmation d'une voiture pour éviter un accident ?

Comme vous pouvez le constater, les situations éthiques posées par l'IA ne cessent d'exister. Et cela ne prend même pas en compte l'utilisation de l'IA dans les algorithmes publicitaires en ligne, le marquage des photos en ligne et le domaine relativement nouveau des drones privés.

Horvitz s'est rendu compte assez rapidement après avoir appelé Tesla pour signaler l'accident que l'entreprise était beaucoup plus préoccupée par les problèmes de responsabilité que par la résolution de problèmes éthiques profonds concernant son utilisation de l'IA.

"Je comprends", dit Horvitz, dont l'amour pour sa Tesla n'a pas diminué. "Si j'avais une vilaine éruption cutanée ou des problèmes respiratoires après avoir pris des médicaments, il y aurait un rapport à la FDA… Je pensais que ce genre de chose aurait dû ou aurait pu être en place."

Voilà le genre de questions auxquelles nous devrons tous répondre — quels seront les paramètres éthiques dans l'utilisation de l'intelligence artificielle par les entreprises, et qui établira les normes à mesure que nous entrons dans ce nouveau monde ?

Bien sûr, ce ne sont que des exemples de questions sur l'IA dans les cas où elle est utilisée légalement — les grandes menaces à venir pour la cybersécurité seront l'utilisation d'algorithmes d'intelligence artificielle à des fins illégales. De la même manière que l'IA peut être utilisée à de bonnes fins, elle peut également être utilisée pour la cybercriminalité pour analyser le comportement de certaines personnes, anticiper leur prochain mouvement et les attaquer au moment où elles soupçonnent le moins l'attaque.

Les générations actuelles et futures voient la cybersécurité d'une manière complètement nouvelle, comprenant qu'elles sont nées dans un monde complexe et ont tendance à avoir des instincts plus développés que les générations précédentes.

Ils présentent moins de risques d'être compromis par les méthodes traditionnelles. Pourtant, même les Millennials se sont montrés et leurs données personnelles trop exposées, comme l'ont démontré les derniers événements d'entreprises de médias sociaux abusant de leurs données.

Il y a vingt ans, la question avec laquelle nous nous débattions était de savoir si une interconnexion complète dans un monde où tout est en ligne valait la perte de confidentialité qui en résultait.

Depuis lors, nous avons répondu à cette question par un oui retentissant, en connectant tout et n'importe quoi à Internet, y compris nous-mêmes via nos téléphones et autres appareils intelligents, en introduisant une toute nouvelle question globale :

Dans un monde où tout est connecté, comment pouvons-nous aider l'individu à préserver sa vie privée, sa sécurité et son autonomie ?

Comme l'ont montré les pratiques récentes des médias sociaux, les individus et les organisations vendront des données, même des données privées, lorsque de gros profits sont en jeu. Nous devons revenir à une préoccupation plus forte pour la vie privée, en utilisant l'identification des personnes comme un moyen de les protéger contre les abus potentiels ou la perte de données personnelles. Nous devons mettre en place une couverture éthique qui empêchera l'IA d'exploiter illégalement ceux qui s'y livrent.

Cette démarche pose les grandes questions auxquelles nous devons répondre :

- Comment une couverture de sécurité éthique sera-t-elle créée pour empêcher l'IA de nous exploiter ?

- Qui devrait être responsable de cette entreprise ?

- Est-ce un mandat du gouvernement ?

- Ou l'effort est-il laissé au secteur privé ?

Les réponses sont probablement quelque part entre les deux. Ou mieux dit, ils se trouvent dans une collaboration entre les secteurs public, privé et gouvernemental. Sommes-nous prêts à commencer cette collaboration maintenant et à la poursuivre jusqu'à ce que nous trouvions une solution satisfaisante?

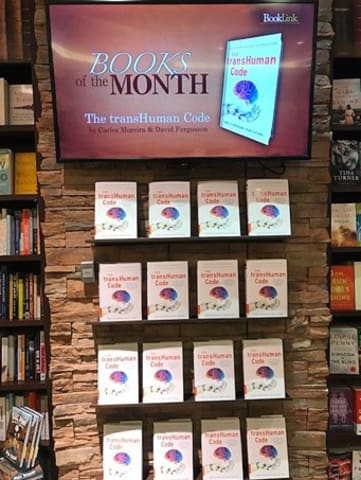

Ce sont les questions auxquelles il faut répondre si la cybersécurité d'aujourd'hui va nous procurer un sentiment légitime de sécurité et de confort, nous permettant de prospérer dans notre monde en ligne et hyperconnecté, et de protéger ces valeurs et droits humains fondamentaux sans lesquels nous ne pouvons pas vivre # extrait de transhumancode