Le plus grand assureur chinois, Ping An, a apparemment commencé à utiliser l'intelligence artificielle pour identifier les clients non fiables et non rentables. Il offre un exemple effrayant de ce à quoi, si nous ne faisons pas attention, l'avenir pourrait ressembler ici aux États-Unis.

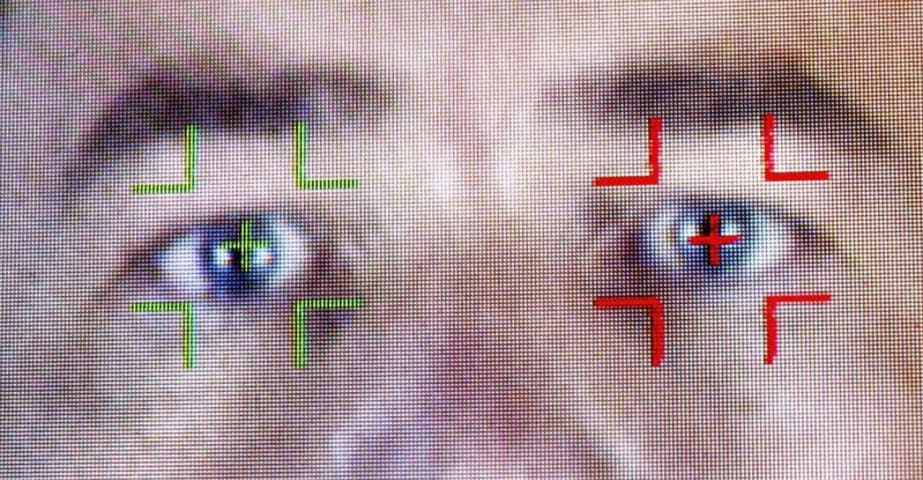

Le Wall Street Journal a rapporté que Ping An utilise un logiciel de reconnaissance faciale pour rechercher des « micro-expressions » sur les visages des gens afin de décider s'ils disent la vérité, s'il faut les assurer et probablement quelles devraient être les conditions de service. Secondairement, le logiciel évaluera l'indice de masse corporelle et le bien-être des personnes pour déterminer les primes d'assurance maladie (spoiler : cela coûte plus cher si vous êtes gros !).

Si cela ne vous dérange pas, considérez mes "questions sceptiques que tout le monde devrait poser sur un nouveau modèle commercial d'IA", qui ressemble à ceci :

-

Ce que l'IA prétend faire est-il même possible, compte tenu des limites des données et de la technologie ?

-

Si c'est possible, atteindra-t-il son objectif déclaré ? Ou va-t-il simplement perpétuer les préjugés humains sous le couvert de la « science », comme une version moderne de la phrénologie ?

-

En supposant que cela soit adapté à l'objectif - une hypothèse importante, honnêtement, compte tenu des performances réelles de la plupart des IA - cet objectif est-il souhaitable en soi ?

-

Va-t-il saper l'industrie pour laquelle il a été conçu?

Évaluons point par point la reconnaissance faciale de Ping An. Comment entraîneriez-vous un algorithme pour déterminer qui ment ? Une option consiste à lui montrer un groupe de personnes mentant et disant la vérité dans un environnement de laboratoire. Le problème est que les micro-expressions des gens peuvent être différentes lorsqu'ils sont allongés dans un laboratoire, ou qu'ils sont payés pour mentir, ou qu'ils mentent pour la première fois. Ainsi, un algorithme formé sur eux ferait beaucoup d'erreurs dans la vraie vie.

Que diriez-vous de trouver des séquences vidéo de personnes qui mentent réellement et de les montrer à l'algorithme ? Le problème ici est que la plupart des mensonges ne sont jamais découverts. Sans oublier que les bons menteurs peuvent mieux contrôler leurs expressions ou que différents types de mensonges peuvent sembler différents. Je ne pense donc pas qu'il y ait un moyen d'entraîner efficacement l'algorithme.

Mais peut-être que trouver des menteurs n'est pas le véritable objectif de Ping An. Très probablement, ils recherchent vraiment les caractéristiques des personnes qui finissent par faire des réclamations, ce qu'ils veulent éviter plus que la fraude. Ce qui nous amène au deuxième point : le rejet de tels clients aura-t-il également un effet démesuré sur des races ou des catégories de personnes spécifiques ?

Le plus probable. Les pauvres et les opprimés - les personnes vivant des vies précaires et surmenées - ont tendance à rencontrer plus de problèmes et ont donc plus de réclamations d'assurance. Et en Chine, la discrimination humaine rend certains groupes ethniques - comme les Ouïghours, la minorité musulmane - plus susceptibles d'être pauvres et opprimés (tout comme c'est le cas avec les Noirs aux États-Unis). Ainsi, un algorithme formé pour identifier les demandeurs potentiels serait également discriminatoire à l'encontre de ces personnes.

Dans un sens, cependant, l'algorithme pourrait toujours être adapté à son objectif - en supposant que son objectif est de maximiser les profits en évitant les clients coûteux, sans contraintes d'équité ou de santé communautaire à long terme. Donc, passant au troisième point, est-ce que ce but est souhaitable ? Pour les créateurs de cet algorithme, peut-être. Ils semblent être d'accord pour discriminer les gros dans la poursuite du profit, alors pourquoi pas les pauvres et les marginalisés aussi ?

Ce n'est pas le genre de monde dans lequel je voudrais habiter, c'est pourquoi je pense que cela sert de récit édifiant. Ici aux États-Unis, une seule chose empêche les compagnies d'assurance de discriminer certains groupes de clients : l'exigence, contenue dans l'Obamacare, qu'elles assurent tous les arrivants, malades et en bonne santé, pour le même prix. Cela a été rendu tenable par le soi-disant mandat individuel, qui a maintenu le bassin d'assurés aussi large que possible en obligeant tout le monde, y compris les personnes en bonne santé, à souscrire une assurance.

Maintenant, cependant, le Congrès a effectivement abrogé le mandat individuel, et les procureurs généraux des États – ainsi que l'administration Trump – contestent l'exigence de tous les arrivants devant les tribunaux. Cela signifie que dans un avenir très proche, les assureurs pourraient être en mesure de rejeter les personnes malades (ou les personnes qu'ils s'attendent à tomber malades) et d'accepter uniquement les clients dont ils ne s'attendent pas à utiliser l'assurance. À cette fin, ils ont travaillé d'arrache-pied sur les mégadonnées et l'IA pour différencier les malades coûteux des personnes en bonne santé et bon marché.

Une assurance qui exclut les personnes qui pourraient en avoir besoin n'est plus une assurance. Ce qui répond à la quatrième question. Donc, le pire de la terrible IA de Ping An n'est pas qu'elle ne fonctionnera pas pour son objectif déclaré. Le vrai danger est que cela fonctionne trop bien.