Incidents associés

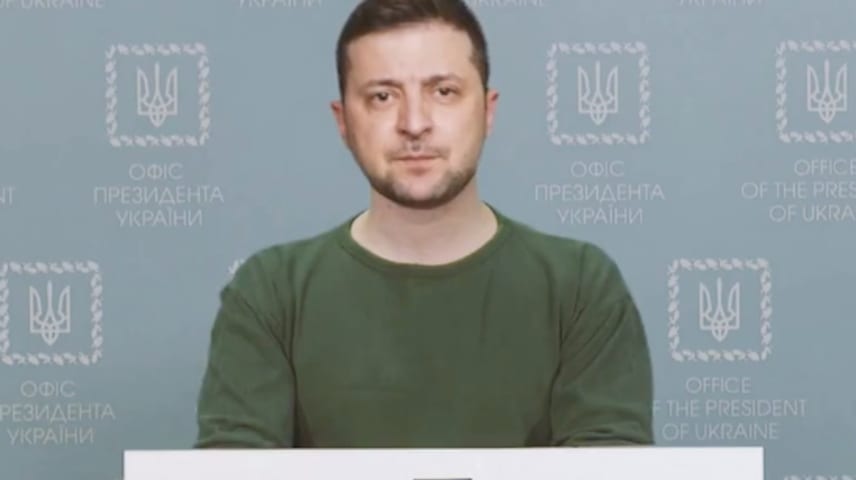

L'agence de presse Ukraine 24 aurait été piratée mercredi, et une vidéo d'un faux président, Volodymyr Zelenskyy, se répand sur les réseaux sociaux.

Un journal télévisé ukrainien affirme que sa diffusion en direct et son site Web ont été piratés mercredi, avec un chyron disant à tort que l'Ukraine s'est rendue, a déclaré Ukraine 24 dans un message sur Facebook.

Ukraine 24 a publié un avertissement sur Facebook indiquant que sa diffusion et son site Web avaient été piratés. Ajoutant au chaos, une vidéo deepfake du président Zelenskyy semblant dire aux Ukrainiens de se rendre a commencé à devenir virale en ligne au même moment. Zelenskyy lui-même a depuis publié une vidéo pour dire que l'Ukraine ne se rendra pas à la Russie.

« La chaîne de télévision « Ukraine 24 » et le site Web « Today » ont été piratés par des pirates ennemis et ont diffusé le message de Zelensky sur une prétendue « capitulation » !!! C'EST FAUX! FAUX !" a déclaré le poste ukrainien 24.

Dans une fausse vidéo qui a commencé à se répandre sur les réseaux sociaux mercredi, à la suite du piratage d'Ukraine 24, Zelenskyy a semblé se tenir sur un podium et s'adresser aux "défenseurs" ukrainiens, leur disant de déposer les armes et de retourner dans leurs familles. Selon une version archivée du site Internet Ukraine 24 de mercredi, ainsi que des captures d'écran partagées par des journalistes sur Twitter, une transcription de la vidéo deepfake est visible :

Chers Ukrainiens ! Chers défenseurs ! Être président n'a pas été si facile. Je dois prendre des décisions difficiles. Au début, j'ai décidé de retourner dans le Donbass. Il est temps de regarder dans les yeux. Ça n'a pas marché. Cela n'a fait qu'empirer. Bien pire. Il n'y a plus de demain. Du moins en moi. Et maintenant je décide de te dire au revoir. Je vous conseille de déposer les armes et de retourner dans vos familles. Vous ne devriez pas mourir dans cette guerre. Je vous conseille de vivre, et je vais faire de même.

Le site Web Ukraine 24 est toujours en panne et personne n'a revendiqué la responsabilité du piratage présumé ou de la fausse vidéo.

Le 2 mars, le compte Facebook officiel des forces terrestres ukrainiennes a publié un avertissement concernant les vidéos deepfakes : « Imaginez voir Vladimir Zelenskyy à la télévision faire une déclaration de reddition. Vous le voyez, vous l'entendez - donc c'est vrai. Mais ce n'est pas la vérité ! C'est une technologie deepfake », écrit-il. "Ce ne sera pas une vraie vidéo, mais créée grâce à des algorithmes d'apprentissage automatique. Les vidéos réalisées grâce à de telles technologies sont presque impossibles à distinguer des vraies.

Les services de renseignement de la défense ukrainiens ont également mis en garde contre la désinformation profonde depuis début mars, affirmant que la Russie pourrait essayer d'utiliser une fausse vidéo générée par l'IA en sa faveur :

Celui qui se répand sur les réseaux sociaux aujourd'hui est en fait assez facile à distinguer de la réalité : sa tête semble avoir été collée sur une photo fixe de son corps, debout sur un podium. Son visage bouge d'une manière assez convaincante - il clignote, après tout, quelque chose que les experts en détection de deepfake prétendaient qu'il n'était pas possible pour l'IA de se répliquer - mais cela ne semble pas assez naturel pour tromper quiconque le regarde pendant plus d'un passage coup d'œil. Il combine la vidéo avec une version IA de sa voix, qui semble guindée et mécanique.

Après le piratage présumé, Ukraine 24 a publié une (vraie) vidéo de Zelenskyy parlant à une caméra de téléphone pour nier les affirmations faites lors du piratage et affirmer que l'Ukraine ne se rendait pas, en fait.

"En ce qui concerne la dernière provocation puérile, que je propose de déposer les armes. Je ne peux proposer de déposer les armes qu'aux militaires de la Fédération de Russie et de rentrer chez nous. Et nous sommes déjà chez nous. Nous défendons notre terre, notre enfants, nos familles. Et nous n'allons absolument pas déposer les armes. Jusqu'à notre victoire." Zelenskyy a déclaré dans son message, selon une traduction de VICE.

Le sénateur américain Marco Rubio a également publié la vidéo de démystification de Zelenskyy sur Twitter. Rubio allègue que le président ukrainien parle de la vidéo deepfake - Rubio a plaidé pour plus de protections Internet contre les deepfakes dans le passé.

Mercredi après-midi, le responsable de la sécurité et de la politique de Facebook, Nathaniel Gleicher, a tweeté que les plateformes de l'entreprise identifiaient et supprimaient la vidéo partout où elle apparaissait :

Depuis l'avènement de la technologie deepfake à usage occasionnel fin 2017, les gens craignent que les deepfakes malveillants ne soient utilisés à des fins politiques aux États-Unis - pour déclencher une guerre, tromper le public ou diffuser de fausses nouvelles plus rapidement que la désinformation déjà endémique sur les réseaux sociaux. par des moyens plus rudimentaires comme du texte et de fausses photos. Plus tôt ce mois-ci, des internautes ont tenté d'affirmer que la Russie avait truqué le président Vladimir Poutine dans des vidéos de réunions, ce qui n'était pas vrai.

En près de cinq ans, un président falsifié n'a encore amené aucun pays à lancer des armes nucléaires, mais au milieu d'une désinformation quasi constante se répandant sur la guerre de la Russie contre l'Ukraine, un piratage d'un média et une vidéo merdique générée par l'IA ne font qu'ajouter à la pile.