Incidents associés

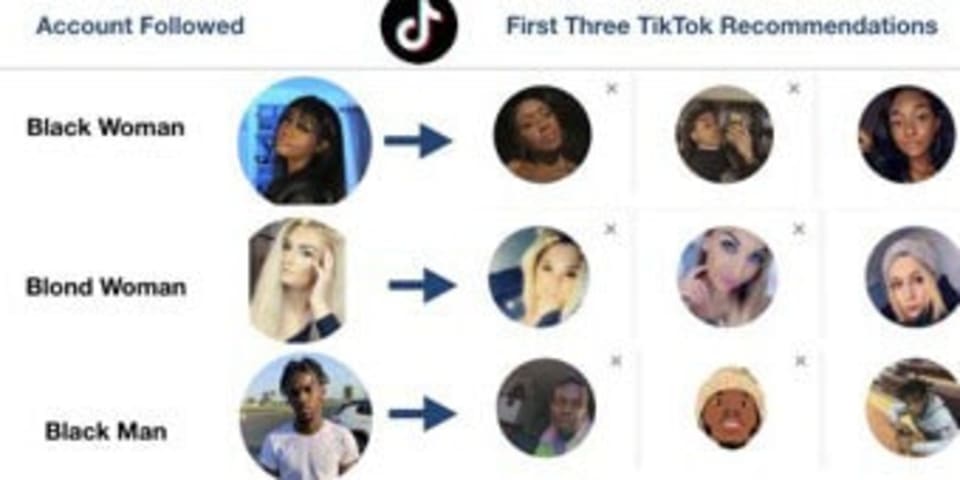

Selon une expérience réalisée par le chercheur en intelligence artificielle Marc Faddoul, l'algorithme utilisé par TikTok pour suggérer aux nouveaux utilisateurs de suivre pourrait avoir un préjugé racial.

Faddoul, chercheur en IA de l'Université de Californie à Berkeley, spécialisé dans l'équité algorithmique, a d'abord souligné ses découvertes sur Twitter cette semaine.

"Une nouveauté TikTok: BULLES DE FITLER BASÉES SUR LE VISAGE", a écrit Faddoul. "Le techlash IA-bias semble n'avoir eu aucun impact sur les nouvelles plates-formes. Suivez un profil aléatoire et TikTok ne recommandera que des personnes qui se ressemblent presque.

Faddoul a expliqué à BuzzFeed News que lorsqu'un utilisateur sur TikTok suit un compte, il lui est alors suggéré une série d'autres comptes qu'il pourrait suivre. Faddoul a déclaré avoir remarqué des similitudes dans ces comptes, des utilisateurs étant de la même race, de la même couleur de cheveux et ayant des apparences similaires.

Faddoul a déclaré avoir répété l'expérience avec un nouveau compte avec des résultats similaires.

"De toute évidence, les recommandations sont très physionomiques", a déclaré Faddoul. "Mais ce n'est pas seulement le sexe et l'ethnicité, vous pouvez obtenir beaucoup plus de profilage facial de niche. TikTok adapte la "recommandation" à la coiffure, au profil corporel, à l'âge, à la façon dont la personne est (dés)habillée et même si elle a un handicap visible.

Un représentant de TikTok a déclaré à BuzzFeed que l'algorithme n'est pas basé sur la race ou l'image du compte, mais sur le contenu du compte. Selon le représentant, cela s'appelle le filtrage collaboratif, un processus similaire utilisé par YouTube et Netflix.

"Notre recommandation de comptes à suivre est basée sur le comportement des utilisateurs : les utilisateurs qui suivent le compte A suivent également le compte B, donc si vous suivez A, vous voudrez probablement également suivre B", a déclaré un représentant à BuzzFeed.

Mais selon Faddoul, si tel est le cas, cela pourrait encore rendre un parti pris racial.

"Un risque est de renforcer un" biais de couverture "avec une boucle de rétroaction", a déclaré Faddoul. "Si les influenceurs les plus populaires sont, disons, blonds, il sera plus facile pour un blond d'avoir des followers que pour un membre d'une minorité sous-représentée. Et la boucle continue..."

Ce n'est pas la première fois que l'entreprise se retrouve dans l'eau chaude, en décembre, TikTok a admis qu'elle enterrait du contenu créé par des utilisateurs homosexuels, gros et handicapés.