Incidents associés

Selon une enquête de la BBC, les femmes à la peau plus foncée sont plus de deux fois plus susceptibles de se faire dire que leurs photos ne respectent pas les règles du passeport britannique lorsqu'elles les soumettent en ligne que les hommes à la peau plus claire.

Une étudiante noire a déclaré qu'on lui avait dit à tort que sa bouche semblait ouverte chaque fois qu'elle téléchargeait cinq photos différentes sur le site Web du gouvernement.

Cela montre comment le "racisme systémique" peut se propager, a déclaré Elaine Owusu.

Le ministère de l'Intérieur a déclaré que l'outil aidait les utilisateurs à obtenir leur passeport plus rapidement.

"Le contrôle indicatif [aide] nos clients à soumettre une photo qui est correcte du premier coup", a déclaré une porte-parole.

"Plus de neuf millions de personnes ont utilisé ce service et nos systèmes s'améliorent.

"Nous continuerons à développer et à évaluer nos systèmes dans le but de rendre la demande de passeport aussi simple que possible pour tous."

Couleur de peau

Le site Web de demande de passeport utilise une vérification automatisée pour détecter les photos de mauvaise qualité qui ne respectent pas les règles du Home Office. Il s'agit notamment d'avoir une expression neutre, une bouche fermée et de regarder directement la caméra.

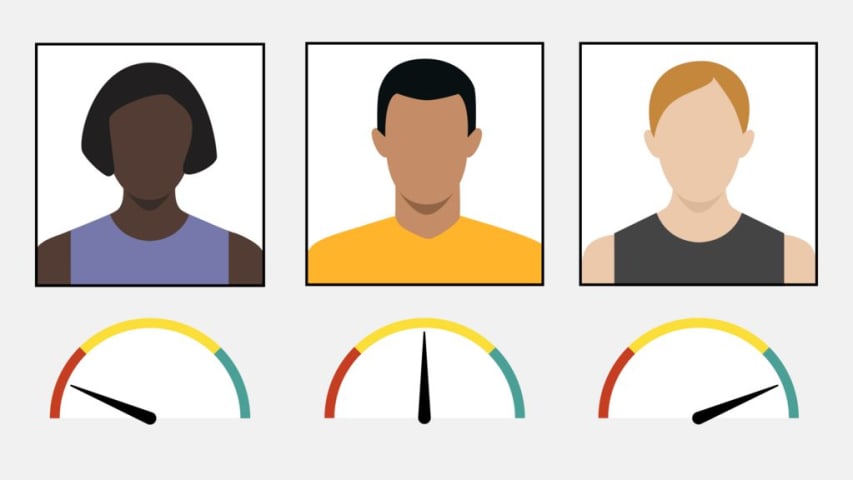

Les recherches de la BBC ont révélé que cette vérification était moins précise sur les personnes à la peau plus foncée. Plus de 1 000 photographies de politiciens du monde entier ont été introduites dans le vérificateur en ligne.

Les résultats ont indiqué :

Les femmes à la peau foncée se font dire que leurs photos sont de mauvaise qualité 22 % du temps, tandis que le chiffre pour les femmes à la peau claire est de 14 %

On dit aux hommes à la peau foncée que leurs photos sont de mauvaise qualité 15% du temps, tandis que le chiffre pour les hommes à la peau claire est de 9%

Les photos des femmes à la peau la plus foncée étaient quatre fois plus susceptibles d'être jugées de mauvaise qualité que les femmes à la peau la plus claire. Mme Owusu a déclaré qu'elle avait réussi à faire approuver une photo après avoir contesté le verdict du site Web, qui impliquait d'écrire une note pour dire sa bouche était en effet fermé.

"Je ne voulais pas payer pour me faire prendre en photo", a déclaré le jeune londonien de 22 ans à la BBC.

"Si l'algorithme ne peut pas lire sur mes lèvres, c'est un problème avec le système, et pas avec moi."

Mais elle ne voit pas cela comme une réussite.

"Je ne devrais pas avoir à me réjouir d'avoir outrepassé un système qui n'a pas été conçu pour moi."

Cela devrait être la norme pour que ces systèmes fonctionnent bien pour tout le monde, a-t-elle ajouté. D'autres raisons invoquées pour que les photos soient jugées de mauvaise qualité incluent "il y a des reflets sur votre visage" et "votre image et l'arrière-plan sont difficiles à distinguer"

Cat Hallam, qui décrit son teint comme étant à la peau foncée, fait partie de celles qui ont connu le problème.

Elle a déclaré à la BBC qu'elle avait tenté de télécharger 10 photographies différentes au cours d'une semaine, et que chacune avait été jugée de "mauvaise" qualité par le site.

"Je suis une technologue en apprentissage, donc j'ai une bonne compréhension des biais dans l'intelligence artificielle", a-t-elle déclaré à la BBC.

"J'ai compris que le logiciel posait problème - ce n'était pas mon appareil photo.

"L'impact des systèmes automatisés sur les communautés ethniques minoritaires est régulièrement négligé, avec des conséquences néfastes."

Des documents publiés dans le cadre d'une demande d'accès à l'information en 2019 avaient précédemment révélé que le ministère de l'Intérieur était au courant de ce problème, mais a décidé que les "performances globales" étaient suffisamment bonnes pour lancer le vérificateur en ligne.

L'histoire des biais dans les technologies de détection et de reconnaissance faciale a commencé au XIXe siècle avec le développement de la photographie. Pendant des années, la composition chimique du film a été conçue pour mieux capturer la peau claire.

Le film couleur était insensible au large éventail de types de peau non blanche et ne montrait souvent pas les détails des visages à la peau plus foncée.

Le grand changement apporté par la photographie numérique était que les images étaient enregistrées sous forme de grilles de nombres représentant les intensités de pixels.

Les ordinateurs pouvaient désormais détecter des motifs dans ces images et y rechercher des visages, mais il fallait leur fournir de nombreuses images de visages pour leur «apprendre» ce qu'il fallait rechercher.

Cela signifie que la précision des systèmes de détection de visage dépend en partie de la diversité des données sur lesquelles ils ont été entraînés.

Ainsi, un ensemble de données de formation avec moins de représentation des femmes et des personnes de couleur produira un système qui ne fonctionnera pas bien pour ces groupes.

Les systèmes de reconnaissance faciale doivent être testés pour des performances équitables dans différentes communautés, mais il existe également d'autres sujets de préoccupation.

La discrimination peut également être intégrée dans la manière dont nous catégorisons les données et mesurons les performances de ces technologies. Les étiquettes que nous utilisons pour classer les groupes raciaux, ethniques et de genre reflètent les normes culturelles et pourraient conduire à l'intégration du racisme et des préjugés dans les systèmes automatisés.

Une chercheuse basée aux États-Unis qui a elle-même mené des études similaires a déclaré que ces systèmes étaient le résultat de développeurs « négligents ».

"Cela ne fait qu'ajouter à la pile croissante de produits qui ne sont pas conçus pour les personnes de couleur et en particulier les femmes à la peau plus foncée", a déclaré Inioluwa Deborah Raji, boursière Mozilla et chercheuse à l'Algorithmic Justice League.

Si un système "ne fonctionne pas pour tout le monde, il ne fonctionne pas", a-t-elle ajouté.

"Le fait que [le ministère de l'Intérieur] savait qu'il y avait des problèmes est une preuve suffisante de sa responsabilité."

Le vérificateur automatisé a été fourni au gouvernement par un fournisseur externe qu'il a refusé de nommer.

En conséquence, la BBC n'a pas pu la contacter pour un commentaire.

Méthodes

La procédure était basée sur l'étude Gender Shades de Joy Buolamwini et Timnit Gebru.

Des photos d'hommes politiques ont été collectées dans les parlements du monde entier. Le sexe et le teint de la peau ont été enregistrés pour chaque photo à l'aide de l'échelle de teint de Fitzpatrick. Chaque image répondait aux normes du Home Office pour une photo de passeport.

Cela a donné une base de données de 1 130 photos de style passeport avec un équilibre entre les tons de peau et les sexes. Chaque photo a été introduite dans le vérificateur de photos automatisé et le score de qualité a été enregistré. Aucune demande de passeport n'a été soumise.

Kirstie Whitaker, responsable du programme pour les outils, les pratiques et les systèmes à l'Institut Alan Turing, a examiné notre code, reproduit indépendamment nos résultats et fourni des commentaires sur la validité des résultats rapportés.