Ce que j'ai appris du concours de pêche de Kaggle

Gidi Shperber Bloqué Débloquer Suivre Suivant 1 mai 2017

TLDR :

Mon partenaire Kaggle et moi avons récemment participé au concours Kaggle "The Nature Conservancy Fisheries Monitoring" (ci-après : "pêcheries"). Cette compétition a eu des résultats très intéressants, notamment, le résultat de référence a devancé la plupart des concurrents. Je crois qu'il y a quelques leçons très importantes que nous pouvons apprendre en tant que scientifiques des données. Vous trouverez ci-dessous des informations sur le concours et certaines des choses que nous en avons apprises.

La compétition

Si récemment, vous avez peut-être entendu parler du concours de pêche de Kaggle, et vous vous êtes peut-être demandé de quoi il s'agissait.

Dans cette compétition, votre objectif (comme dans de nombreuses compétitions Kaggle) était de classer un objet, dans ce cas - de déterminer l'espèce d'un poisson.

pourquoi voudrais-tu faire ça ? Eh bien, pour faire court, les navires sont actuellement équipés de caméras automatiques, pour s'assurer qu'ils n'attrapent que des poissons légitimes comme le thon, et non des animaux protégés comme les requins. L'image est ensuite déchiffrée manuellement

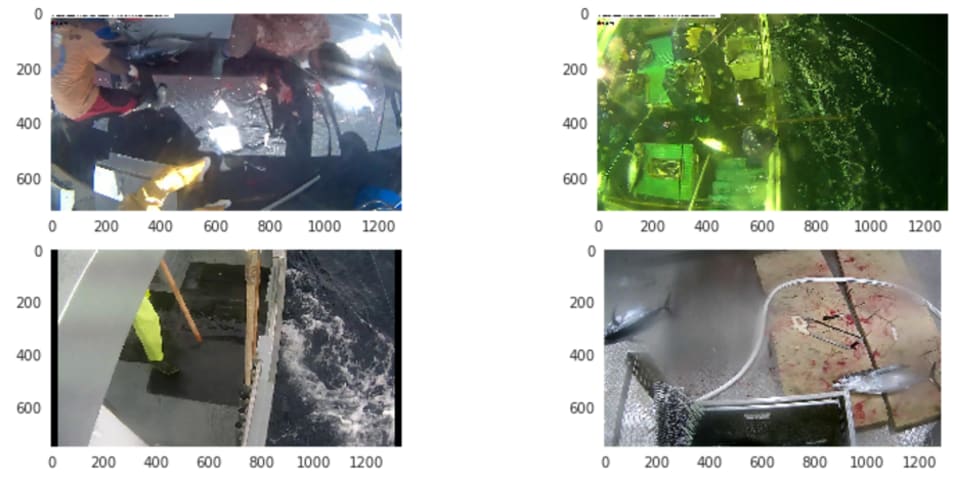

Cependant, le poisson ne vous est pas présenté dans une photo de profil claire, mais il est jeté au hasard autour d'un bateau. Voici quelques exemples d'images :

il y a aussi des images avec plus d'un poisson, ou des images sans poisson du tout.

Il ne s'agit donc pas de la compétition standard "reconnaître la fleur/la feuille/le visage", mais d'une compétition plus difficile.

Et c'est pourquoi j'aime Kaggle : contrairement à de nombreux articles sur l'apprentissage automatique, qui utilisent l'ensemble de données disponible le plus simple (mnist, cifar-10, imagenet pour n'en nommer que quelques-uns), Kaggle vous présente des problèmes réels, qui sont toujours sales, mal étiquetés, flou etc...

Comme dans certains autres concours, il s'agissait d'un concours en deux étapes, dans lequel une petite partie des données de test (images 1K) est disponible, tandis que la majorité de l'ensemble de test (12K images supplémentaires) est publiée 1 semaine avant la date limite du concours. Cette méthode peut empêcher certaines tricheries, mais présente de nombreux problèmes et peut décourager de nombreux concurrents : seuls environ 300 concurrents sur les 2300 partants au total ont soumis une candidature lors de la deuxième étape.

Notre chemin à travers la compétition

D'un coup d'œil rapide, il est facile de voir que l'approche requise ici consiste en deux étapes : d'abord détecter le poisson, puis le classer.

Cependant, pendant la compétition, quelque chose d'étrange est apparu dans les forums de compétition : si vous exécutez un réseau VGG pré-formé sur l'ensemble d'entraînement (comme décrit très clairement ici et discuté plus en détail dans ce grand cours), vous pouvez atteindre une précision d'environ 99 %. C'est étrange, car le VGG a été formé sur des données image-net, qui ne sont pas très similaires aux images ci-dessus. La soumission de ces résultats à Kaggle a montré des résultats qui n'étaient pas mauvais du tout, mais bien inférieurs à 99%.