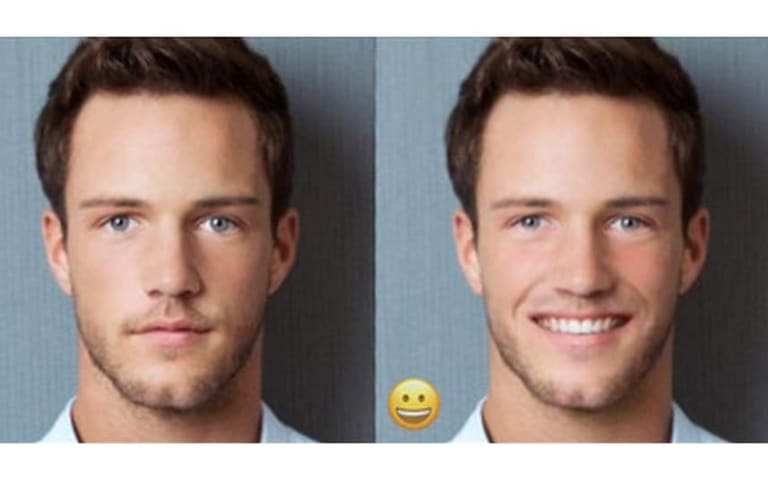

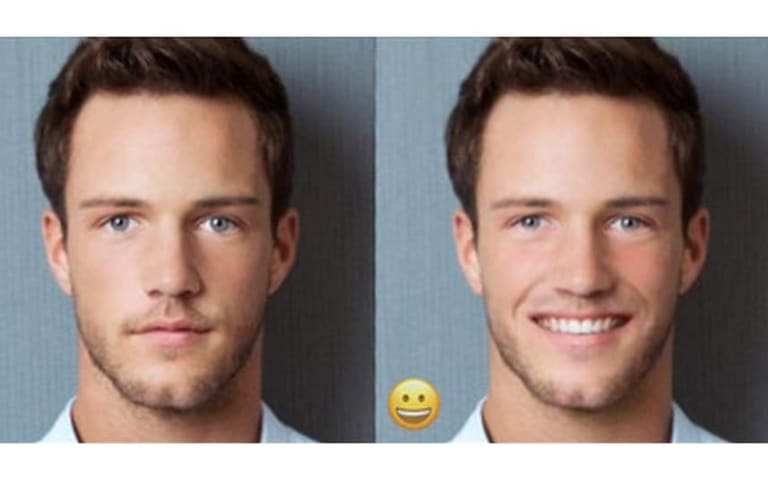

Incident 1336: Le BJP a utilisé des vidéos truquées de Manoj Tiwari pour cibler les électeurs de l'Haryana lors des élections de Delhi de 2020.

Description: En février 2020, le BJP indien a utilisé de fausses vidéos de son dirigeant, Manoj Tiwari, pour influencer les électeurs lors des élections législatives de Delhi. Ces vidéos montraient Tiwari prononçant des messages de campagne préparés à l'avance en haryanvi et en anglais, deux langues qu'il ne parlait pas, grâce à une modification de ses mouvements des lèvres et de sa voix. Diffusées via des milliers de groupes WhatsApp, ces vidéos auraient touché des millions d'électeurs à l'insu de tous.

Editor Notes: This incident reportedly took place in February 2020. The incident ID was created 01/10/2026.

Entités

Voir toutes les entitésAlleged: Unknown deepfake technology developers et Unknown voice cloning technology developers developed an AI system deployed by Unknown disinformation actors , Unknown disinformation actors in India , BJP Delhi IT Cell et The Ideaz Factory, which harmed General public , General public of India , Epistemic integrity , Manoj Tiwari et Electoral integrity.

Systèmes d'IA présumés impliqués: Unknown deepfake technology , Unknown voice cloning technology , Social media platforms et WhatsApp

Statistiques d'incidents

ID

1336

Nombre de rapports

1

Date de l'incident

2020-02-07

Editeurs

Daniel Atherton

Rapports d'incidents

Chronologie du rapport

Loading...

Le 7 février, à la veille des élections législatives à Delhi, deux vidéos du président du Bharatiya Janata Party (BJP), Manoj Tiwari, critiquant le gouvernement sortant de Delhi, dirigé par Arvind Kejriwal, sont devenues virales sur WhatsAp…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Loading...

Deepfake Obama Introduction of Deepfakes

· 29 rapports

Loading...

Biased Google Image Results

· 18 rapports

Loading...

FaceApp Racial Filters

· 23 rapports

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Loading...

Deepfake Obama Introduction of Deepfakes

· 29 rapports

Loading...

Biased Google Image Results

· 18 rapports

Loading...

FaceApp Racial Filters

· 23 rapports