Incidente 909: La campaña Matryoshka supuestamente usa deepfakes para hacerse pasar por académicos y hacer propaganda prorrusa.

Herramientas

Entidades

Ver todas las entidadesEstadísticas de incidentes

Risk Subdomain

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

- Malicious Actors & Misuse

Entity

Human

Timing

Post-deployment

Intent

Intentional

Informes del Incidente

Cronología de Informes

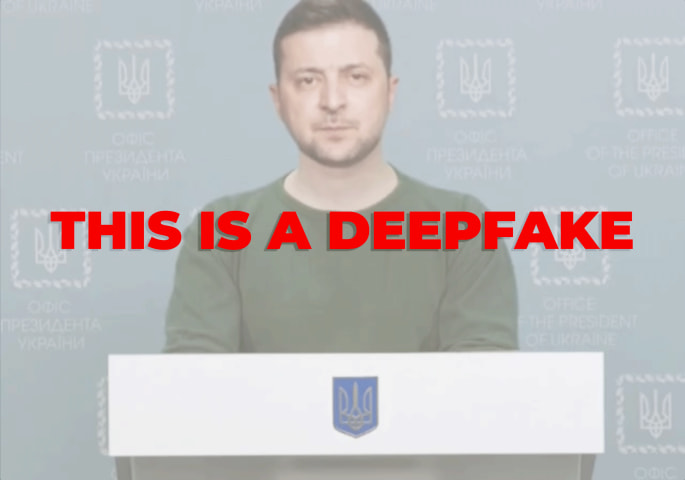

La red de desinformación rusa Matryoshka ha lanzado una nueva campaña destinada a convencer a los usuarios de las redes sociales de que académicos y profesores de las mejores universidades del mundo están pidiendo a Occidente que levante la…

La red de desinformación rusa "Matryoshka" ha lanzado una nueva campaña en la red social Bluesky. Eliot Higgins, fundador del grupo de periodismo de investigación Bellingcat, ha sido uno de los primeros investigadores en detectar su activid…

Los primeros síntomas de desinformación aparecen en la red social Bluesky, con ecos de la campaña prorrusa “Matryoshka” que inundó la red social X de Elon Musk, pero con algunas particularidades.

El colectivo @antibot4navalny, especializado…