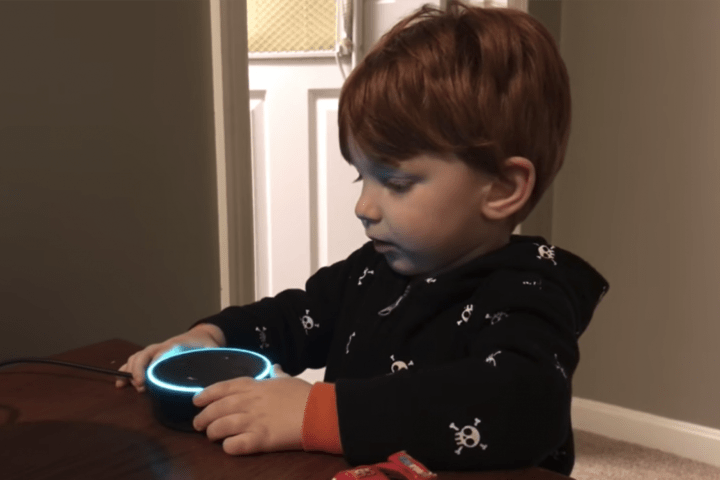

Incidente 791: Un error de la IA de Google lleva a los padres a usar materia fecal en ejercicios de entrenamiento infantil.

Descripción: La función Resumen de IA de Google aconsejó erróneamente a los padres usar heces humanas en un ejercicio de entrenamiento para ir al baño, malinterpretando un método que utiliza crema de afeitar o mantequilla de cacahuete como sustituto. Este incidente es otro ejemplo de un fallo de la IA a la hora de captar matices contextuales que pueden dar lugar a recomendaciones potencialmente dañinas y, en este caso, insalubres. Google ha reconocido el error.

Entidades

Ver todas las entidadesAlleged: Google developed an AI system deployed by Google y AI Overview, which harmed Google , Parents y Google users.

Estadísticas de incidentes

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Informes del Incidente

Cronología de Informes

Loading...

¿Los padres deberían untar heces humanas en globos para enseñarles una lección a sus hijos? La descripción general de la IA de Google dice que sí.

Las búsquedas en Google sobre tácticas de entrenamiento para ir al baño para niños arrojaron …

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents