Incidente 79: Un método de prueba renal supuestamente subestimó el riesgo en pacientes negros

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

79

AI Tangible Harm Level Notes

There is no AI. The harm comes from a formula that uses race as a factor.

Notes (special interest intangible harm)

4.1 - Black patients overlooked by the calculation because of built-in points had their access to critical public healthcare reduced.

Special Interest Intangible Harm

yes

Clasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Unknown/unclear

Physical System

Software only

Level of Autonomy

Low

Nature of End User

Amateur

Public Sector Deployment

No

Data Inputs

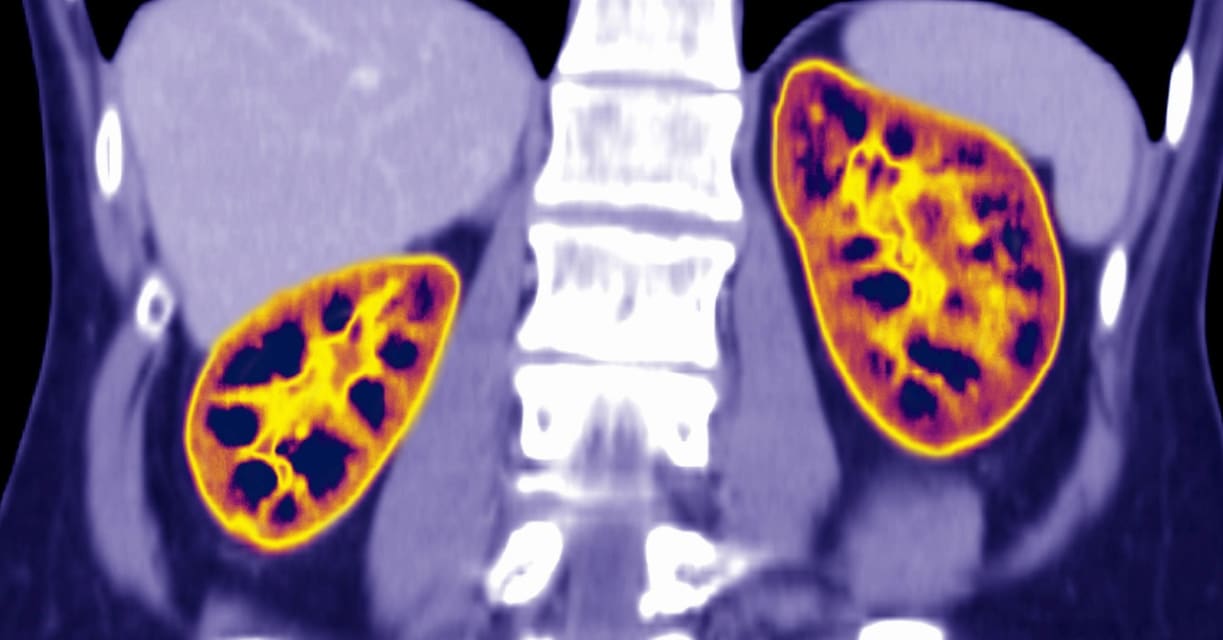

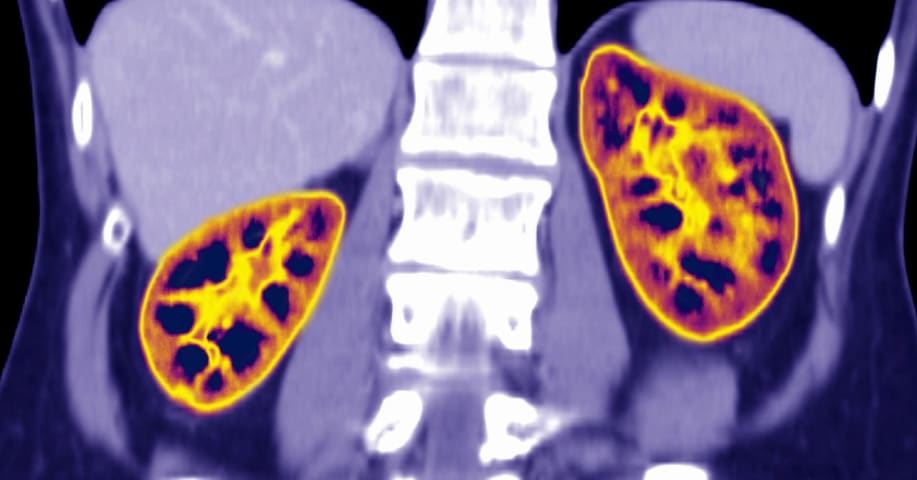

creatinine levels, age, sex, race

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

Durante años, médicos y estudiantes de medicina, muchos de ellos negros, han advertido que la prueba renal más utilizada, cuyos resultados se basan en la raza, es racista y peligrosamente inexacta. Sus llamamientos están cobrando nueva fuer…

ANTECEDENTES: Avanzar en la equidad en salud implica reducir las disparidades en la atenci�ón. Los pacientes afroamericanos con enfermedad renal crónica (CKD, por sus siglas en inglés) tienen peores resultados, incluida la colocación de un a…

LAS PERSONAS NEGRAS EN LOS EE. UU. sufren más enfermedades crónicas y reciben una atención médica inferior en relación con las personas blancas. Las matemáticas con sesgo racial pueden empeorar el problema.

Los médicos a menudo toman decisi…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents