Incidente 59: Sesgos de género en el Traductor de Google

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Specification

Physical System

Software only

Level of Autonomy

Medium

Nature of End User

Amateur

Public Sector Deployment

No

Data Inputs

User entered translation requests

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

59

AI Tangible Harm Level Notes

Although AI was implicated in the adverse outcome, this incident has no tangible harm.

Notes (special interest intangible harm)

The study found biases related to gender and age in Google Translate. Additional biases have been found in Natural Language Processing in general.

Special Interest Intangible Harm

yes

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

La inteligencia artificial y el aprendizaje automático se encuentran en un período de crecimiento asombroso. Sin embargo, existe la preocupación de que estas tecnologías se puedan utilizar, con o sin intención, para perpetuar los prejuicios…

Incluso la inteligencia artificial puede adquirir sesgos contra la raza y el género

Una de las grandes promesas de la inteligencia artificial (IA) es un mundo libre de pequeños prejuicios humanos. La contratación mediante algoritmos daría a…

Los algoritmos de aprendizaje automático están detectando prejuicios raciales y de género profundamente arraigados ocultos en los patrones de uso del lenguaje, dicen los científicos.

Se ha demostrado que una herramienta de inteligencia arti…

En los debates sobre el futuro de la inteligencia artificial, muchos expertos piensan que estos sistemas basados en máquinas son fríamente lógicos y objetivamente racionales. Pero en un nuevo estudio, investigadores de la Universidad de Pri…

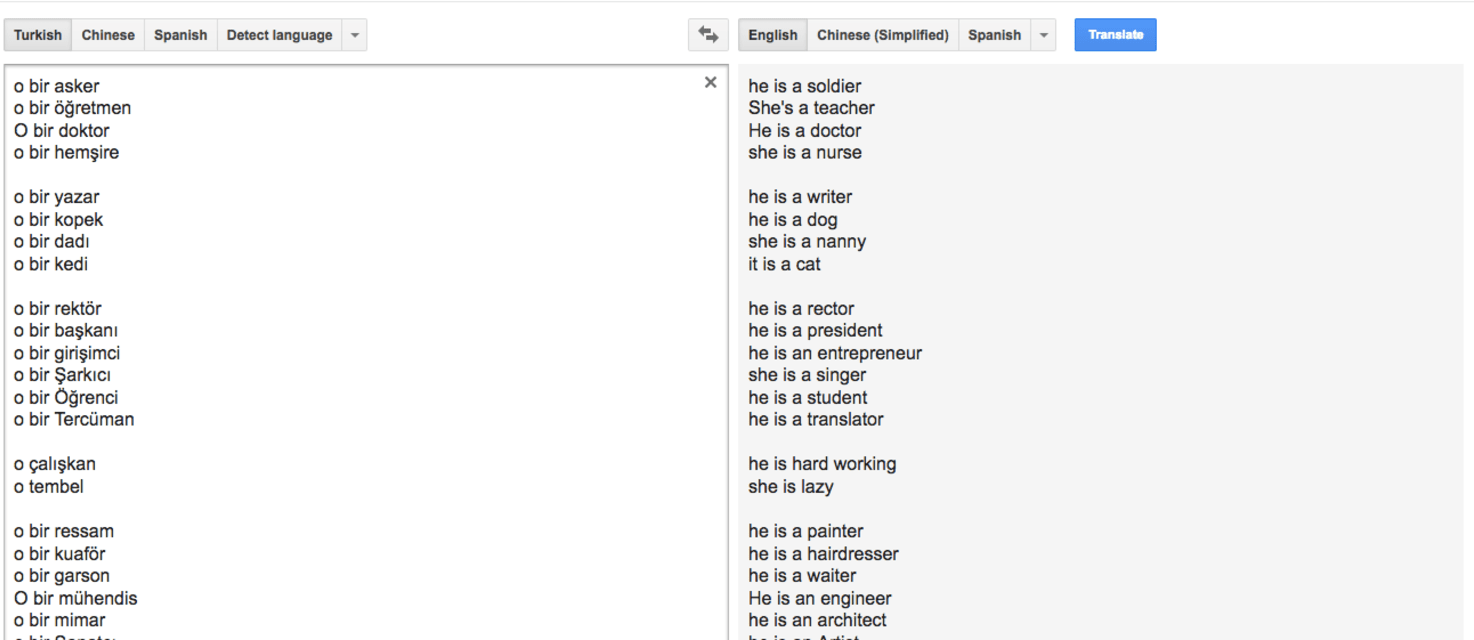

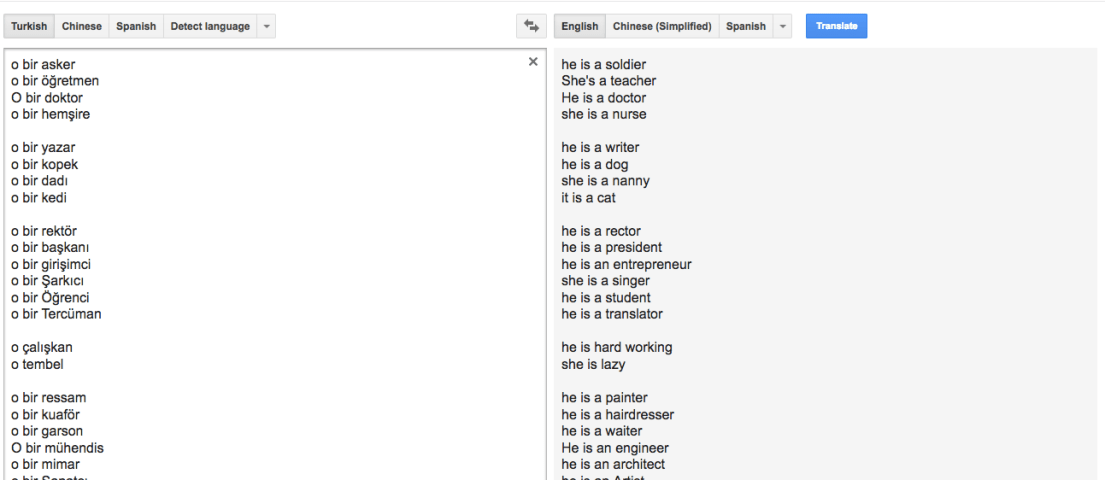

En el idioma turco, hay un pronombre, "o", que cubre todo tipo de tercera persona singular. Ya sea un él, una ella o un eso, es una "o". Ese no es el caso en inglés. Entonces, cuando Google Translate pasa del turco al inglés, solo tiene que…

Gran parte de nuestra vida está determinada por algoritmos. Desde lo que ve en su sección de noticias de Facebook, hasta los libros y chucherías que le recomienda Amazon, hasta los videos inquietantes que YouTube muestra a sus hijos, nuestr…

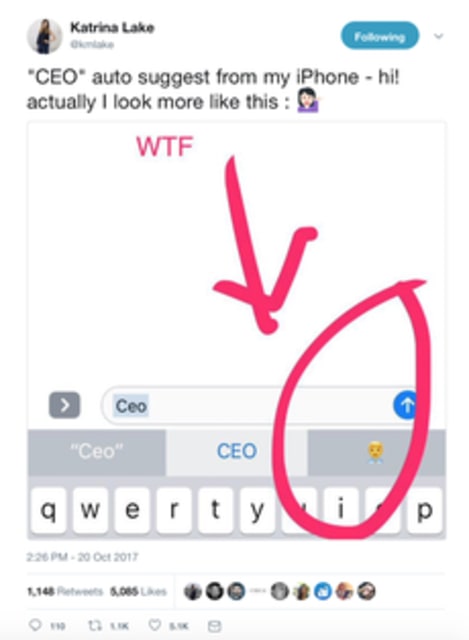

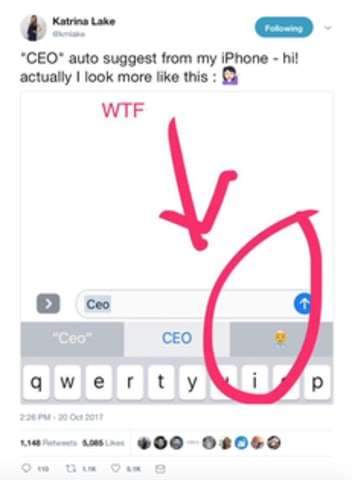

Imagen vía Twitter

Los padres conocen muy bien un desafío particular de criar niños: enseñarles a hacer lo que decimos, no lo que hacemos.

Un desafío similar ha afectado a la inteligencia artificial.

A medida que más aplicaciones y software…

Recientemente, ha habido una creciente preocupación por el sesgo de la máquina, donde los modelos estadísticos entrenados crecen para reflejar asimetrías sociales controvertidas, como el sesgo de género o racial. Recientemente, se ha sugeri…

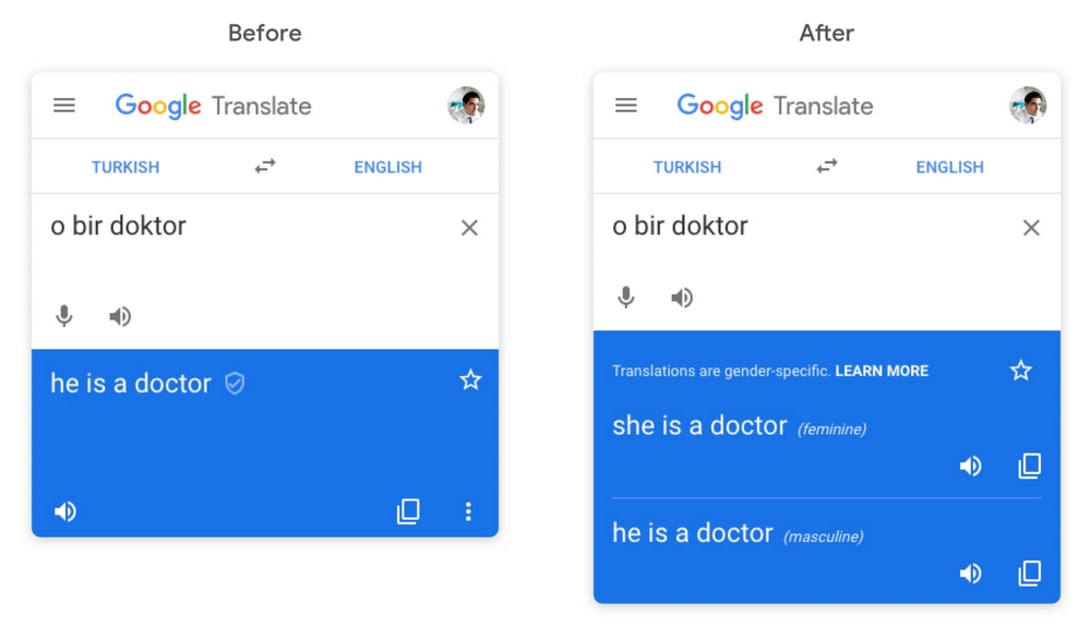

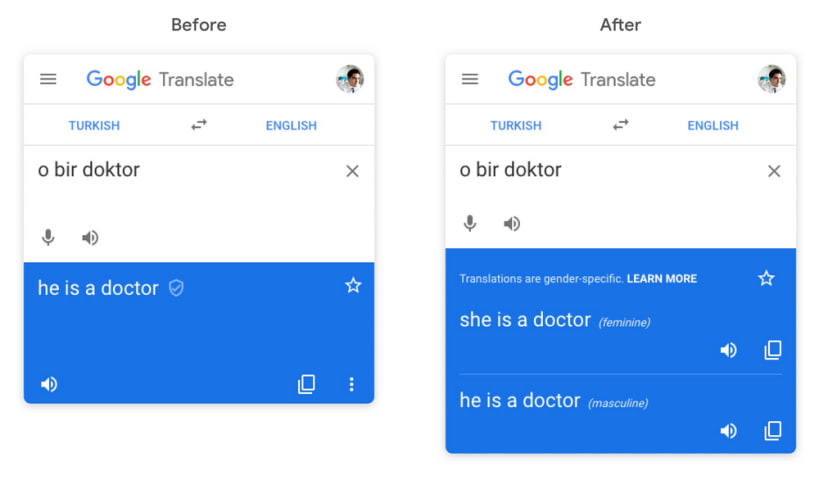

Google está haciendo un esfuerzo para reducir el sesgo de género percibido en Google Translate, anunció hoy. A partir de esta semana, los usuarios que traduzcan palabras y frases en idiomas admitidos obtendrán traducciones tanto en femenino…

Un experimento muestra que Google Translate cambia sistemáticamente el género de las traducciones cuando no se ajustan a los estereotipos. Todo se debe al inglés, dice Google.

Si tuviera que leer una historia sobre historiadores masculinos …

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents