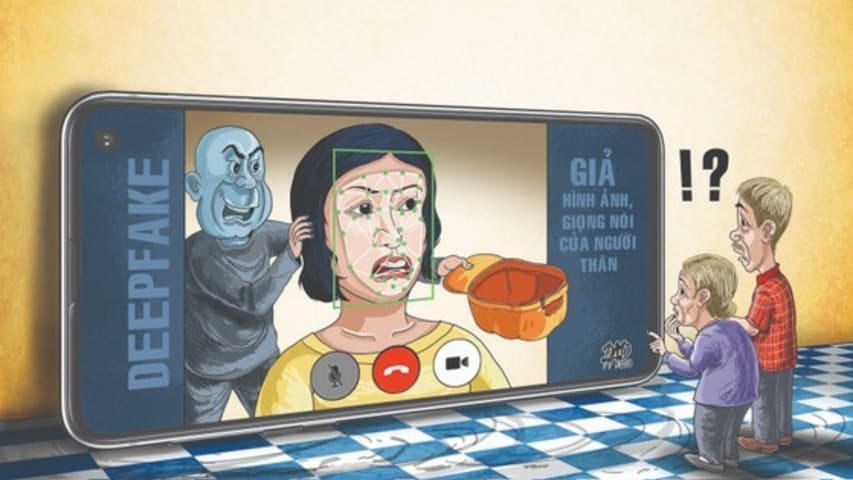

Incidente 509: Estafadores falsificaron videos de seres queridos de víctimas pidiendo dinero a través de Facebook en Vietnam.

Herramientas

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

509

Special Interest Intangible Harm

maybe

Date of Incident Year

2023

Date of Incident Month

03

Date of Incident Day

Estimated Date

No

Risk Subdomain

4.3. Fraud, scams, and targeted manipulation

Risk Domain

- Malicious Actors & Misuse

Entity

Human

Timing

Post-deployment

Intent

Intentional

Informes del Incidente

Cronología de Informes

(DTTCO) - Después de la estafa por mensajes de texto gracias a la transferencia de dinero, ahora los estafadores aplican rápidamente otras tácticas más sofisticadas, a través de videollamadas falsas gracias a la tecnología Deepfake.

engañar…

Después de ser detectados con trucos para enviar mensajes al dinero apropiado, los estafadores ahora usan una herramienta aún más sofisticada llamada Deepfake para hacer videollamadas falsas a las víctimas y solicitar transferencias de dine…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents