Incidente 1281: Presuntos efectos nocivos para la salud tras el uso de consejos médicos generados por ChatGPT en Hyderabad

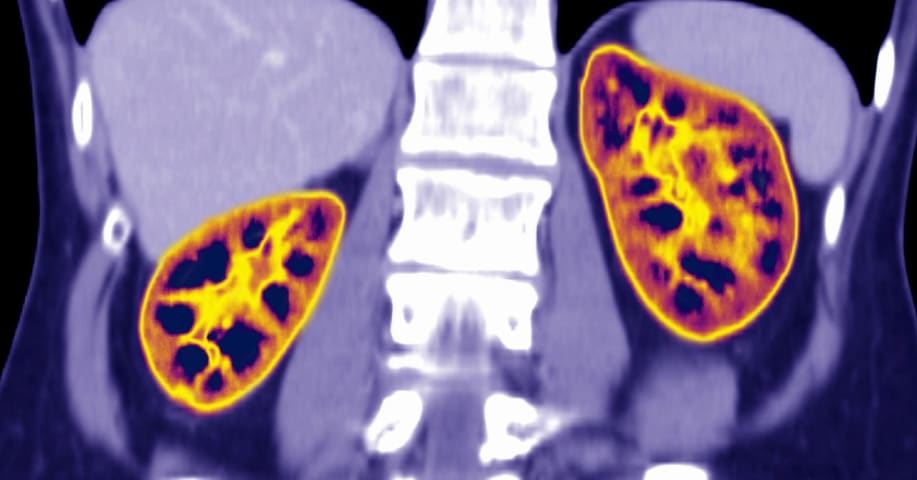

Descripción: Informes de Hyderabad describen dos supuestos daños a pacientes después de que actuaran siguiendo consejos médicos supuestamente generados por ChatGPT en lugar de la guía de un médico. Un receptor de trasplante de riñón supuestamente suspendió la medicación prescrita después del trasplante basándose en una sugerencia de un chatbot y experimentó un fallo del injerto. En otro caso, un hombre con diabetes presuntamente desarrolló hiponatremia grave tras seguir una dieta sin sal recomendada por un chatbot.

Editor Notes: The reporting on this incident seems to draw on three discrete harm events to point to a wider concern in Hyderabad. The case involving an unnamed kidney transplant patient and an elderly man with diabetes are Hyderabad-specific, whereas the third case that seems to appear in the reporting is a reference to a New York case, Incident 1166: ChatGPT Reportedly Suggests Sodium Bromide as Chloride Substitute, Leading to Bromism and Hospitalization.

Entidades

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por OpenAI y ChatGPT, perjudicó a Unnamed patient with diabetes in Hyderabad , Unnamed kidney transplant patient in Hyderabad , OpenAI users , General public of India , General public of Hyderabad , General public y ChatGPT users.

Sistema de IA presuntamente implicado: ChatGPT

Estadísticas de incidentes

ID

1281

Cantidad de informes

2

Fecha del Incidente

2025-11-10

Editores

Daniel Atherton

Informes del Incidente

Cronología de Informes

Loading...

Médicos instan a sus pacientes a dejar de usar chatbots de IA como sustituto de la atención médica

Los profesionales sanitarios de Hyderabad están observando un fuerte aumento de pacientes que siguen los consejos genéricos de un chatbot y p…

Loading...

Hyderabad: Médicos de Hyderabad han advertido a la población sobre la importancia de confiar únicamente en herramientas de inteligencia artificial (IA) como ChatGPT para obtener asesoramiento médico. Hicieron hincapié en que los pacientes, …

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?