A TikTok novelty: FACE-BASED FITLER BUBBLES

The AI-bias techlash seems to have had no impact on newer platforms. Follow a random profile, and TikTok will only recommend people who look almost the same.

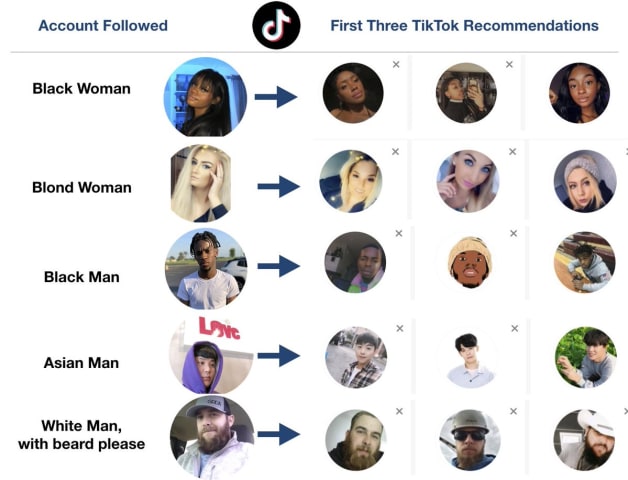

Let’s do the experiment from a fresh account:

Clearly, recommendations are very physiognomic. But it’s not just gender and ethnicity, you can get much more niche facial profiling.

TikTok adapts 'recommendability' on hair style, body profile, age, how (un)dressed the person is, and even whether they have visible disabilities.

FEATURE or BUG?

Similarity is expected from a recommendation engine, but not homogeneity, nor does it have to be based on physical appearance.

TikTok’s assumption is that, if I follow a blond teen, it is because I like blond teens, not for her humour or the music she features.

Social Media have been known to create filter bubbles for political opinions. TikTok seems like the first major platform to create such clear physiognomic bubbles.